LaGeM: A Large Geometry Model for 3D Representation Learning and Diffusion

作者: Biao Zhang, Peter Wonka

分类: cs.CV, cs.GR

发布日期: 2024-10-02

备注: For more information: https://1zb.github.io/LaGeM

💡 一句话要点

LaGeM:提出一种用于3D表示学习和扩散的大型几何模型,解决大规模数据集和生成建模的挑战。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 3D表示学习 扩散模型 分层自编码器 生成建模 几何建模

📋 核心要点

- 现有方法在处理大规模3D数据集和生成建模时面临挑战,尤其是在表示高分辨率几何细节方面。

- LaGeM提出一种分层自编码器,直接作用于无序向量集合,以控制不同层次的几何细节,实现高效的3D模型表示。

- 实验表明,LaGeM能够有效表示各种3D模型,并在训练时间和内存消耗上优于现有基线方法。

📝 摘要(中文)

本文介绍了一种新颖的分层自编码器,可以将3D模型映射到高度压缩的潜在空间。该分层自编码器专门设计用于解决由大规模数据集和使用扩散的生成建模所带来的挑战。与之前仅在规则图像或体素网格上工作的方法不同,我们的分层自编码器作用于无序的向量集合。自编码器的每一层控制着不同几何细节层次。我们证明了该模型可以用于表示各种3D模型,同时忠实地表示高分辨率的几何细节。与基线相比,新架构的训练时间减少了0.30倍,内存消耗减少了0.42倍。我们还探讨了如何将新的表示用于生成建模。具体来说,我们提出了一种级联扩散框架,其中每个阶段都以先前阶段为条件。我们的设计将现有的图像和体素网格的级联设计扩展到向量集合。

🔬 方法详解

问题定义:现有3D表示学习方法通常基于规则的图像或体素网格,难以有效处理大规模、高分辨率的3D几何数据。这些方法在计算效率和内存消耗方面存在瓶颈,限制了其在复杂3D场景中的应用。此外,基于体素的方法难以捕捉精细的几何细节。

核心思路:LaGeM的核心思路是利用分层自编码器,将3D模型编码到压缩的潜在空间中,从而实现高效的表示和生成。该自编码器直接处理无序的向量集合,避免了对规则网格的依赖,从而能够更好地适应复杂的几何形状。通过分层结构,模型可以控制不同层次的几何细节,实现多尺度的表示。

技术框架:LaGeM采用级联扩散框架进行生成建模。整体架构包含一个分层自编码器和一个级联扩散模型。自编码器负责将3D模型编码到潜在空间,扩散模型则在潜在空间中进行生成。级联扩散模型由多个阶段组成,每个阶段都以先前阶段的输出为条件,逐步生成更精细的3D模型。

关键创新:LaGeM的关键创新在于其分层自编码器和级联扩散框架的设计。分层自编码器能够直接处理无序向量集合,避免了对规则网格的依赖,从而能够更好地适应复杂的几何形状。级联扩散框架则将现有的图像和体素网格的级联设计扩展到向量集合,实现了高效的3D模型生成。

关键设计:LaGeM的分层自编码器包含多个编码器和解码器层,每一层负责控制不同层次的几何细节。损失函数包括重建损失和潜在空间正则化项,以保证模型的重建质量和潜在空间的平滑性。级联扩散模型采用噪声预测网络,通过逐步去噪的方式生成3D模型。

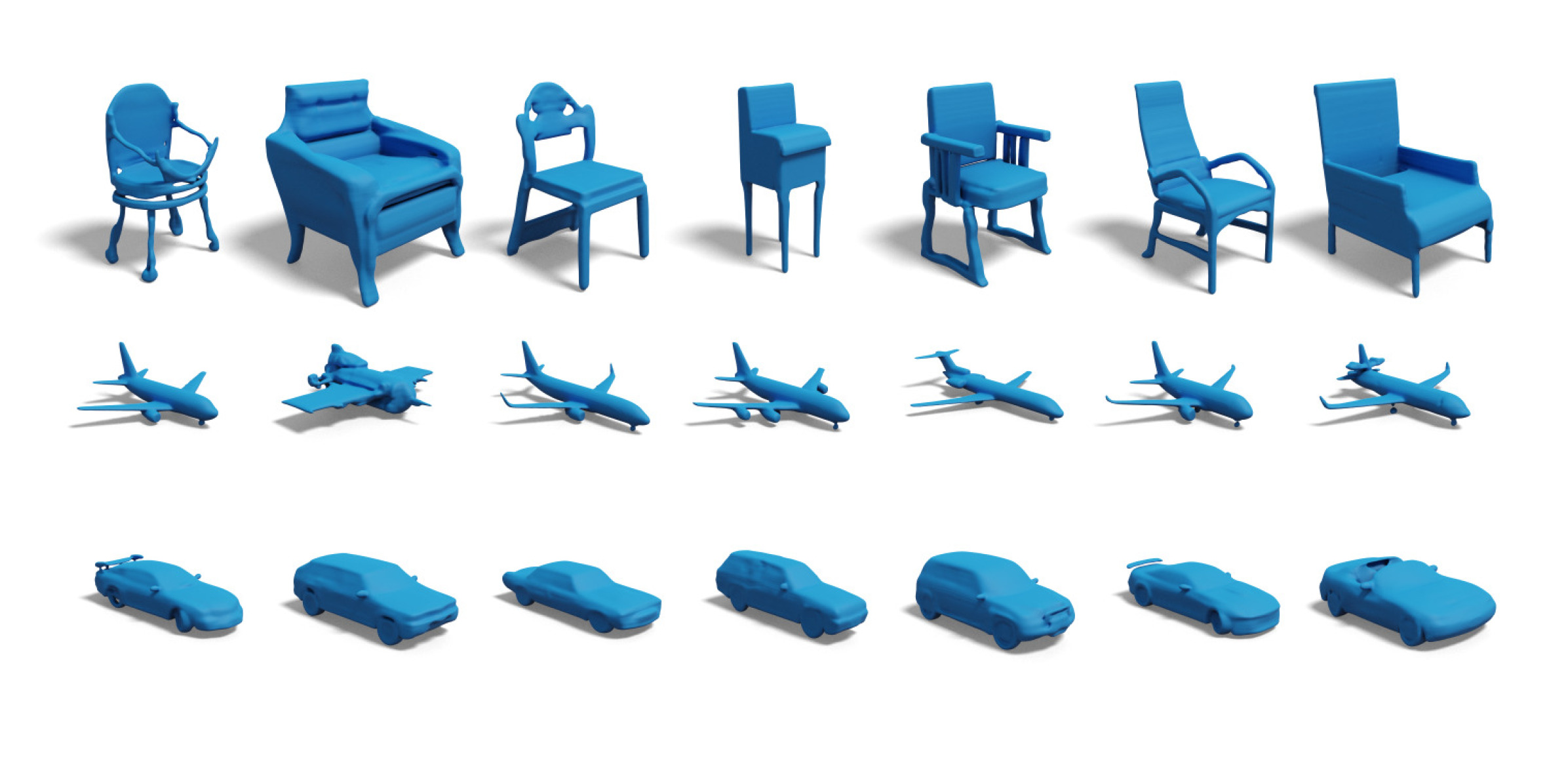

🖼️ 关键图片

📊 实验亮点

LaGeM在训练时间和内存消耗方面优于现有基线方法。实验结果表明,LaGeM的训练时间减少了0.30倍,内存消耗减少了0.42倍。此外,LaGeM能够生成高质量的3D模型,并能够忠实地表示高分辨率的几何细节。

🎯 应用场景

LaGeM可应用于3D内容生成、计算机辅助设计、虚拟现实/增强现实、游戏开发等领域。该模型能够高效地表示和生成复杂的3D模型,从而降低了3D内容创作的门槛,并为相关应用提供了更丰富的素材。

📄 摘要(原文)

This paper introduces a novel hierarchical autoencoder that maps 3D models into a highly compressed latent space. The hierarchical autoencoder is specifically designed to tackle the challenges arising from large-scale datasets and generative modeling using diffusion. Different from previous approaches that only work on a regular image or volume grid, our hierarchical autoencoder operates on unordered sets of vectors. Each level of the autoencoder controls different geometric levels of detail. We show that the model can be used to represent a wide range of 3D models while faithfully representing high-resolution geometry details. The training of the new architecture takes 0.70x time and 0.58x memory compared to the baseline. We also explore how the new representation can be used for generative modeling. Specifically, we propose a cascaded diffusion framework where each stage is conditioned on the previous stage. Our design extends existing cascaded designs for image and volume grids to vector sets.