Mixture of Multicenter Experts in Multimodal AI for Debiased Radiotherapy Target Delineation

作者: Yujin Oh, Sangjoon Park, Xiang Li, Pengfei Jin, Yi Wang, Jonathan Paly, Jason Efstathiou, Annie Chan, Jun Won Kim, Hwa Kyung Byun, Ik Jae Lee, Jaeho Cho, Chan Woo Wee, Peng Shu, Peilong Wang, Nathan Yu, Jason Holmes, Jong Chul Ye, Quanzheng Li, Wei Liu, Woong Sub Koom, Jin Sung Kim, Kyungsang Kim

分类: eess.IV, cs.CV, cs.LG

发布日期: 2024-09-27 (更新: 2025-09-18)

备注: 12 pages, 5 figures, 4 tables, 1 supplementary material

💡 一句话要点

提出多中心专家混合模型(MoME),解决放疗靶区勾画中的AI偏见问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多中心学习 专家混合模型 医学影像分析 放疗靶区勾画 AI偏见 多模态融合 前列腺癌

📋 核心要点

- 现有医学AI模型易受训练数据偏见影响,无法捕捉不同医疗中心的临床策略差异。

- MoME框架通过集成多中心专家的知识,提升模型在不同医疗中心间的泛化性和适应性。

- 实验表明,MoME在数据有限或中心间差异大的情况下,优于传统模型,且无需数据共享。

📝 摘要(中文)

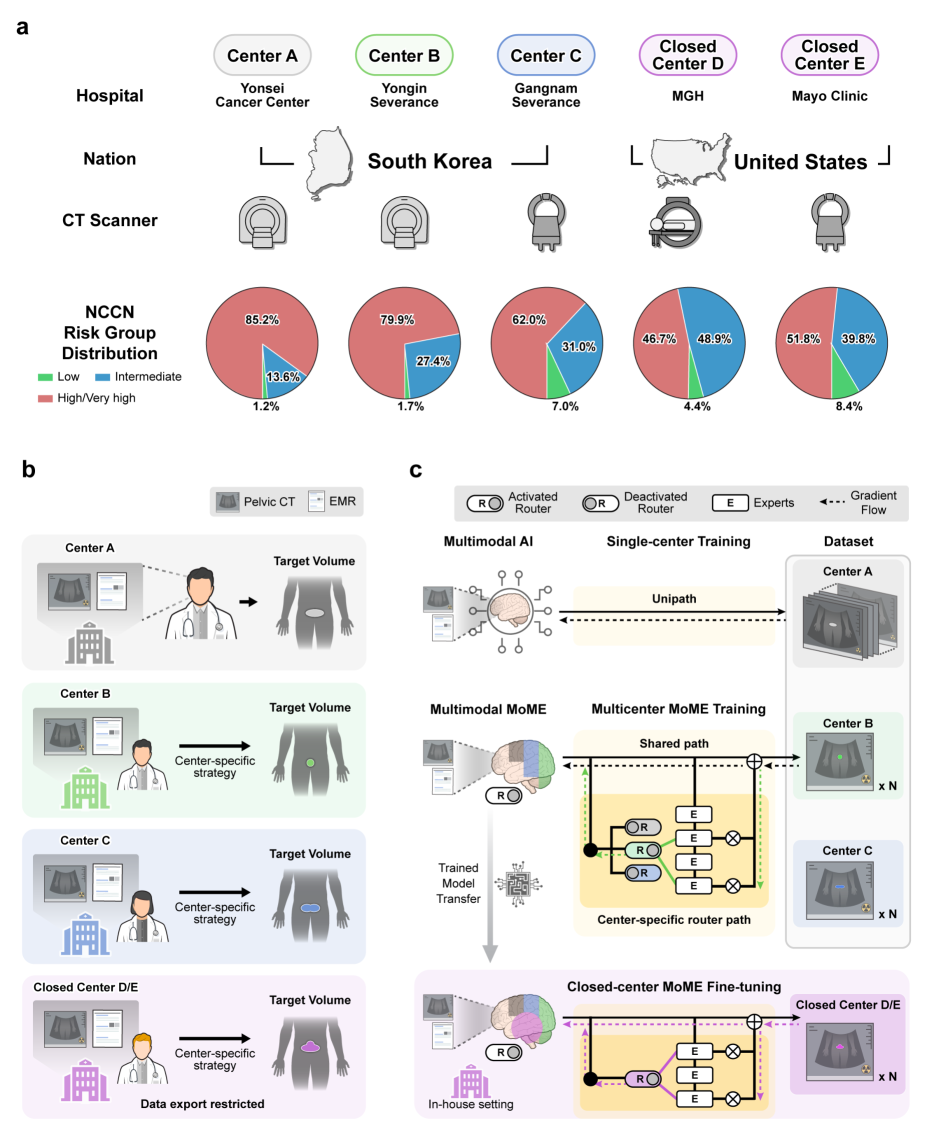

临床决策反映了受区域患者群体和机构协议影响的多种策略。然而,现有的大多数医学人工智能(AI)模型都基于高流行度的数据模式进行训练,这会强化偏见,无法捕捉临床专业知识的广度。受专家混合(MoE)最新进展的启发,我们提出了一种多中心专家混合(MoME)框架,以解决医学领域中的AI偏见,而无需跨机构的数据共享。MoME集成了来自不同临床策略的专业知识,以增强模型在不同医疗中心之间的泛化性和适应性。我们使用前列腺癌放疗的多模态靶区勾画模型验证了该框架。通过结合来自每个中心的影像和临床笔记进行少量样本训练,该模型优于基线模型,尤其是在中心间差异性高或数据可用性有限的情况下。此外,MoME支持模型根据本地临床偏好进行定制,而无需跨机构数据交换,使其特别适合资源受限的环境,同时促进广泛通用的医学AI。

🔬 方法详解

问题定义:现有医学AI模型在放疗靶区勾画中,由于训练数据来源的单一性,容易产生偏见,无法适应不同医疗中心的临床策略和患者群体差异。这导致模型在新的医疗中心应用时,性能下降,泛化能力不足。现有方法难以在保护数据隐私的前提下,有效利用多中心数据提升模型性能。

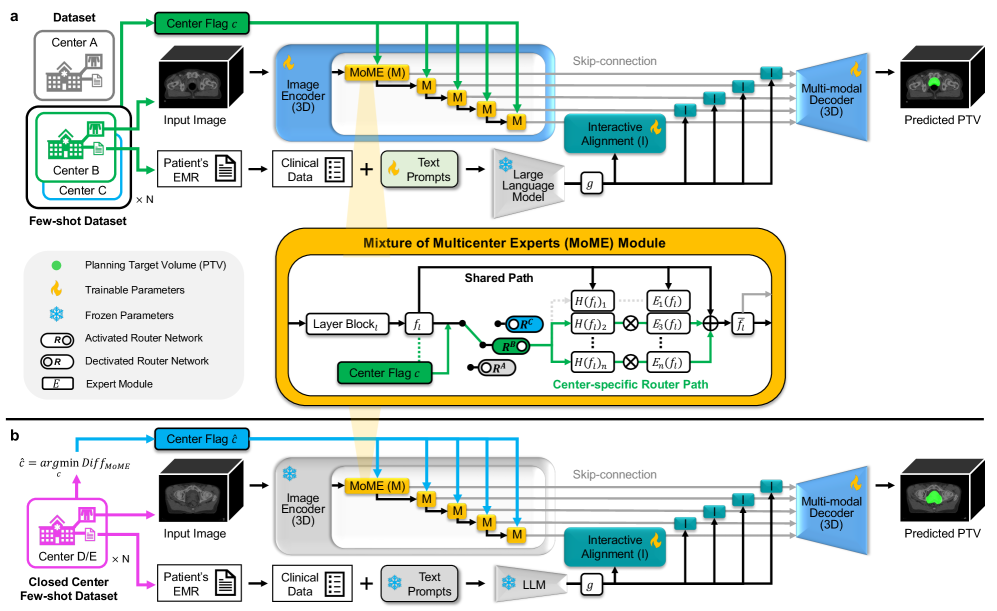

核心思路:论文的核心思路是借鉴专家混合模型(MoE)的思想,构建一个多中心专家混合模型(MoME)。MoME框架为每个医疗中心训练一个独立的专家模型,然后通过一个门控网络(gating network)将这些专家模型的预测结果进行加权融合。这样,模型可以学习到不同医疗中心的临床策略,从而提高泛化能力,同时避免了跨机构的数据共享。

技术框架:MoME框架主要包含以下几个模块:1) 多个专家模型,每个专家模型基于一个医疗中心的数据进行训练,负责学习该中心的临床策略。2) 一个门控网络,负责根据输入数据,动态地为每个专家模型分配权重。3) 一个融合模块,将各个专家模型的预测结果按照门控网络分配的权重进行加权融合,得到最终的预测结果。整个框架采用端到端的方式进行训练。

关键创新:MoME的关键创新在于:1) 提出了多中心专家混合的架构,能够有效利用多中心数据,提高模型的泛化能力,同时保护数据隐私。2) 门控网络的设计使得模型能够根据输入数据,动态地选择合适的专家模型,从而更好地适应不同医疗中心的临床策略。3) 采用少量样本训练的方式,降低了对数据量的需求,使得MoME更适用于资源受限的环境。

关键设计:专家模型可以使用各种深度学习模型,例如U-Net、V-Net等。门控网络可以使用全连接网络或卷积神经网络。损失函数可以使用Dice Loss、Cross-Entropy Loss等。关键参数包括专家模型的数量、门控网络的结构、学习率等。论文中使用了影像和临床笔记作为输入,通过多模态融合的方式提升模型性能。

🖼️ 关键图片

📊 实验亮点

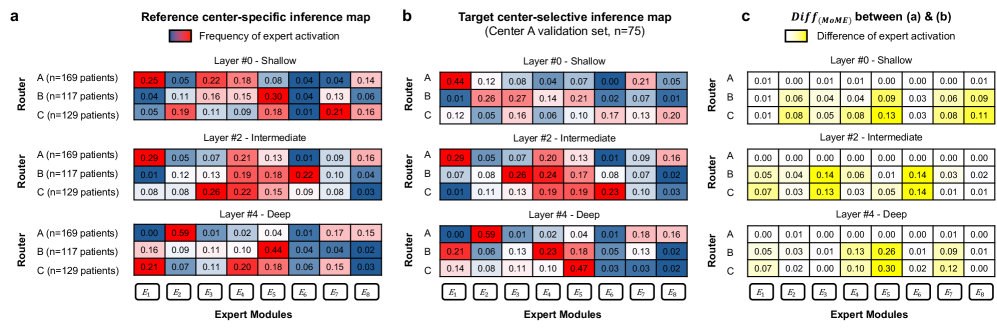

实验结果表明,MoME框架在多中心前列腺癌放疗靶区勾画任务中,优于传统的基线模型。在中心间差异性高或数据可用性有限的情况下,MoME的性能提升更为显著。通过少量样本训练,MoME能够达到甚至超过使用大量数据训练的传统模型的性能。此外,MoME还支持模型根据本地临床偏好进行定制,无需跨机构数据交换。

🎯 应用场景

该研究成果可应用于医学影像分析、辅助诊断和治疗决策等领域。特别是在放疗靶区勾画方面,MoME框架能够提高模型在不同医疗中心的应用效果,减少医生的人工勾画负担,提高治疗效率和准确性。未来,该方法可以推广到其他疾病的诊断和治疗,促进医学AI的广泛应用。

📄 摘要(原文)

Clinical decision-making reflects diverse strategies shaped by regional patient populations and institutional protocols. However, most existing medical artificial intelligence (AI) models are trained on highly prevalent data patterns, which reinforces biases and fails to capture the breadth of clinical expertise. Inspired by the recent advances in Mixture of Experts (MoE), we propose a Mixture of Multicenter Experts (MoME) framework to address AI bias in the medical domain without requiring data sharing across institutions. MoME integrates specialized expertise from diverse clinical strategies to enhance model generalizability and adaptability across medical centers. We validate this framework using a multimodal target volume delineation model for prostate cancer radiotherapy. With few-shot training that combines imaging and clinical notes from each center, the model outperformed baselines, particularly in settings with high inter-center variability or limited data availability. Furthermore, MoME enables model customization to local clinical preferences without cross-institutional data exchange, making it especially suitable for resource-constrained settings while promoting broadly generalizable medical AI.