PhysGen: Rigid-Body Physics-Grounded Image-to-Video Generation

作者: Shaowei Liu, Zhongzheng Ren, Saurabh Gupta, Shenlong Wang

分类: cs.CV, cs.AI, cs.LG

发布日期: 2024-09-27

备注: Accepted to ECCV 2024. Project page: https://stevenlsw.github.io/physgen/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

PhysGen:基于刚体物理的图像到视频生成方法,实现逼真可控的视频生成。

🎯 匹配领域: 支柱四:生成式动作 (Generative Motion)

关键词: 图像到视频生成 物理模拟 刚体物理 图像理解 视频扩散模型 可控视频生成 物理合理性 数据驱动

📋 核心要点

- 现有图像到视频生成方法难以保证物理合理性和精确控制,尤其是在涉及复杂物理交互时。

- PhysGen结合物理模拟和数据驱动生成,利用图像理解模块提取物理参数,再通过刚体物理引擎模拟运动。

- 实验表明,PhysGen在物理真实性和可控性上优于现有方法,并能应用于动画生成等下游任务。

📝 摘要(中文)

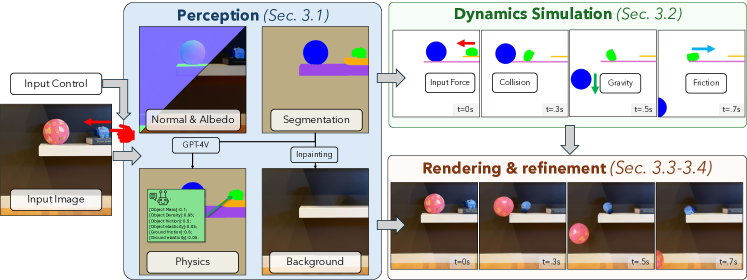

PhysGen是一种新颖的图像到视频生成方法,它将单张图像和输入条件(例如,施加到图像中物体的力和扭矩)转换为逼真、物理上合理且时间上一致的视频。其核心思想是将基于模型的物理模拟与数据驱动的视频生成过程相结合,从而实现合理的图像空间动力学。该系统的核心是三个关键组件:(i)图像理解模块,有效捕获图像的几何形状、材料和物理参数;(ii)图像空间动力学模拟模型,利用刚体物理和推断的参数来模拟逼真的行为;(iii)基于图像的渲染和细化模块,利用生成视频扩散来生成具有模拟运动的逼真视频素材。生成的视频在物理和外观上都是逼真的,甚至可以精确控制,通过定量比较和全面的用户研究,展示了优于现有数据驱动的图像到视频生成作品的结果。PhysGen生成的视频可用于各种下游应用,例如将图像转换为逼真的动画或允许用户与图像交互并创建各种动态。

🔬 方法详解

问题定义:现有的图像到视频生成方法,特别是那些依赖纯数据驱动的方法,在生成具有物理合理性的视频方面存在困难。它们难以准确地模拟物体之间的交互、运动规律以及对外部作用力的响应。此外,对生成视频的精确控制也是一个挑战,用户难以指定物体的运动轨迹或施加特定的物理效果。

核心思路:PhysGen的核心思路是将基于模型的物理模拟与数据驱动的视频生成相结合。首先,从输入图像中提取物体的几何、材质和物理参数。然后,利用这些参数,通过刚体物理引擎模拟物体在给定条件下的运动。最后,使用生成模型将模拟的运动渲染成逼真的视频。这种结合使得生成的视频既具有物理合理性,又具有视觉上的真实感。

技术框架:PhysGen的整体框架包含三个主要模块:(1) 图像理解模块:负责从输入图像中提取物体的几何形状、材质属性和物理参数,例如质量、摩擦系数等。(2) 图像空间动力学模拟模型:利用提取的参数和刚体物理引擎,模拟物体在给定外力或扭矩作用下的运动轨迹。(3) 图像渲染和细化模块:将模拟的运动轨迹渲染成逼真的视频,并使用生成对抗网络或扩散模型等技术进行细节增强和优化。

关键创新:PhysGen的关键创新在于将物理模拟融入到图像到视频的生成过程中。与传统的纯数据驱动方法不同,PhysGen利用物理引擎来约束视频的生成,从而保证了视频的物理合理性。此外,PhysGen还通过图像理解模块提取物理参数,使得模拟更加准确。

关键设计:图像理解模块可能采用卷积神经网络(CNN)来提取图像特征,并使用回归模型预测物理参数。动力学模拟模型使用标准的刚体物理引擎,例如Bullet或PhysX。图像渲染和细化模块可能采用生成对抗网络(GAN)或扩散模型,例如Stable Diffusion,来生成逼真的视频帧。损失函数可能包括重构损失、对抗损失和物理一致性损失,以保证视频的质量和物理合理性。

🖼️ 关键图片

📊 实验亮点

PhysGen在定量和定性评估中均表现出优于现有图像到视频生成方法的性能。用户研究表明,PhysGen生成的视频在物理真实性和视觉质量方面更受用户青睐。此外,PhysGen还展示了精确控制生成视频的能力,例如可以准确地模拟物体在特定外力作用下的运动轨迹。定量指标方面,PhysGen在物理合理性指标上显著优于其他方法,例如在模拟物体碰撞和滚动等场景中。

🎯 应用场景

PhysGen具有广泛的应用前景,例如可以将静态图像转换为逼真的动画,用于游戏开发、电影制作和教育领域。用户可以通过施加不同的外力或扭矩与图像进行交互,创造各种动态效果。此外,PhysGen还可以用于生成训练数据,用于训练其他机器学习模型,例如用于机器人控制或物理推理的模型。

📄 摘要(原文)

We present PhysGen, a novel image-to-video generation method that converts a single image and an input condition (e.g., force and torque applied to an object in the image) to produce a realistic, physically plausible, and temporally consistent video. Our key insight is to integrate model-based physical simulation with a data-driven video generation process, enabling plausible image-space dynamics. At the heart of our system are three core components: (i) an image understanding module that effectively captures the geometry, materials, and physical parameters of the image; (ii) an image-space dynamics simulation model that utilizes rigid-body physics and inferred parameters to simulate realistic behaviors; and (iii) an image-based rendering and refinement module that leverages generative video diffusion to produce realistic video footage featuring the simulated motion. The resulting videos are realistic in both physics and appearance and are even precisely controllable, showcasing superior results over existing data-driven image-to-video generation works through quantitative comparison and comprehensive user study. PhysGen's resulting videos can be used for various downstream applications, such as turning an image into a realistic animation or allowing users to interact with the image and create various dynamics. Project page: https://stevenlsw.github.io/physgen/