Evaluation of Security of ML-based Watermarking: Copy and Removal Attacks

作者: Vitaliy Kinakh, Brian Pulfer, Yury Belousov, Pierre Fernandez, Teddy Furon, Slava Voloshynovskiy

分类: cs.CV

发布日期: 2024-09-26 (更新: 2024-10-04)

🔗 代码/项目: GITHUB

💡 一句话要点

评估基于ML的水印安全性:复制与移除攻击分析

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 数字水印 安全性评估 复制攻击 移除攻击 对抗攻击 基础模型 潜在空间

📋 核心要点

- 现有数字水印技术在鲁棒性方面表现良好,但针对恶意攻击的安全评估不足,尤其是在基于深度学习的最新方法中。

- 该论文的核心思想是评估基于基础模型的潜在空间数字水印系统在复制和移除攻击下的安全性,揭示其潜在的安全漏洞。

- 通过实验,论文深入分析了对抗性嵌入技术在数字水印中的应用,并提供了关于如何提升水印系统安全性的经验性指导。

📝 摘要(中文)

从现实世界捕获的大量数字内容或AI生成的媒体,需要版权保护、可追溯性或数据来源验证方法。数字水印是解决这些挑战的关键方法。其发展经历了三个阶段:手工设计、基于自编码器和基于基础模型的方法。虽然这些系统的鲁棒性已被充分记录,但针对对抗性攻击的安全性仍未得到充分探索。本文评估了利用对抗嵌入技术的基础模型潜在空间数字水印系统的安全性。通过一系列实验,研究了复制和移除攻击下的安全维度,并提供了对这些系统漏洞的实证见解。所有实验代码和结果可在https://github.com/vkinakh/ssl-watermarking-attacks 获取。

🔬 方法详解

问题定义:论文旨在评估基于机器学习的数字水印方案的安全性,特别是针对复制和移除攻击。现有的水印方案,尤其是基于深度学习和基础模型的方案,虽然在鲁棒性方面有所提升,但其安全性,即抵抗恶意攻击的能力,缺乏充分的评估。攻击者可能通过复制水印或将其从受保护的内容中移除来规避版权保护。

核心思路:论文的核心思路是通过设计和实施一系列复制和移除攻击,来测试基于基础模型的潜在空间数字水印系统的安全性。通过分析这些攻击的成功率和对水印性能的影响,揭示系统的脆弱性,并为改进水印方案提供指导。

技术框架:论文的技术框架主要包括以下几个阶段:1) 选择或构建一个基于基础模型的潜在空间数字水印系统。2) 设计复制攻击,尝试将水印从一个内容复制到另一个内容。3) 设计移除攻击,尝试从受保护的内容中移除水印。4) 实施这些攻击,并评估攻击的成功率和对水印性能(如不可见性、鲁棒性)的影响。5) 分析实验结果,识别系统的脆弱点,并提出改进建议。

关键创新:论文的关键创新在于其系统性地评估了基于基础模型的潜在空间数字水印系统的安全性,特别是针对复制和移除攻击。以往的研究主要关注水印的鲁棒性,而忽略了其安全性。该论文通过实验揭示了现有水印方案的潜在漏洞,并为设计更安全的水印方案提供了新的视角。

关键设计:论文的关键设计包括:1) 针对不同的基础模型和水印嵌入方法,设计不同的复制和移除攻击策略。例如,针对对抗嵌入技术,可能需要设计特定的对抗样本生成方法。2) 使用合适的指标来评估攻击的成功率和对水印性能的影响。这些指标可能包括水印检测的准确率、水印的不可见性度量以及内容质量的评估。

🖼️ 关键图片

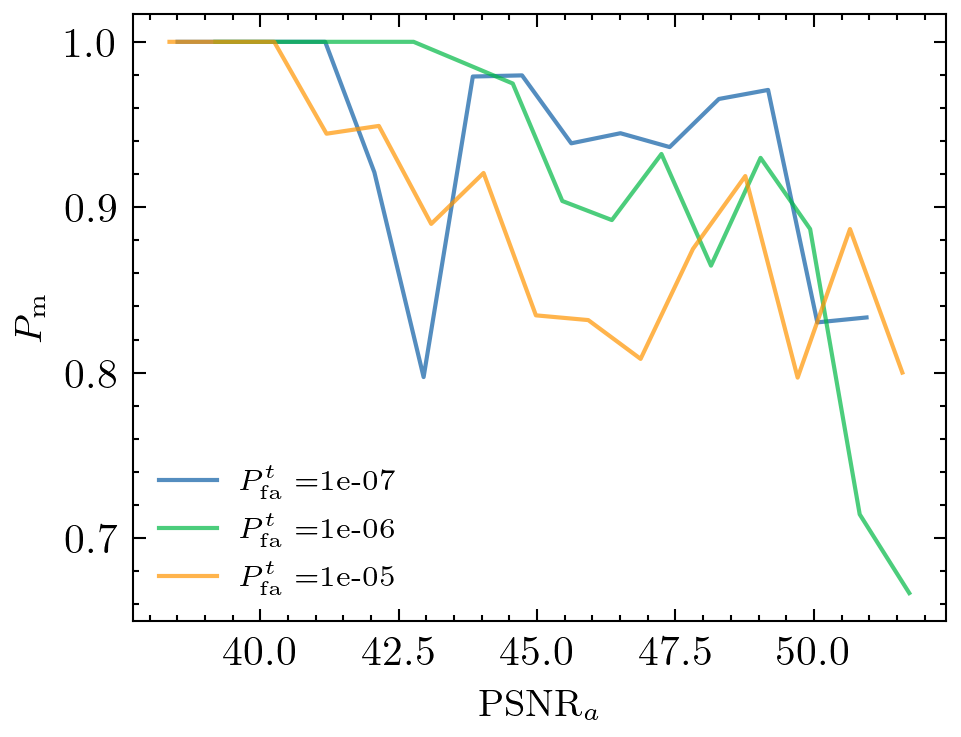

📊 实验亮点

该研究通过实验验证了基于基础模型的潜在空间数字水印系统在复制和移除攻击下的脆弱性。实验结果表明,即使是基于先进深度学习技术的水印方案,也可能容易受到精心设计的攻击。例如,某些攻击方法可以显著降低水印检测的准确率,甚至完全移除水印,而对内容质量的影响很小。实验代码和结果已开源,方便其他研究者复现和进一步研究。

🎯 应用场景

该研究成果可应用于数字版权管理、数据溯源、AI生成内容认证等领域。通过提升数字水印的安全性,可以更有效地保护数字内容的版权,防止未经授权的复制和传播,维护创作者的权益。此外,该研究还可以促进更安全可靠的AI生成内容生态系统的发展。

📄 摘要(原文)

The vast amounts of digital content captured from the real world or AI-generated media necessitate methods for copyright protection, traceability, or data provenance verification. Digital watermarking serves as a crucial approach to address these challenges. Its evolution spans three generations: handcrafted, autoencoder-based, and foundation model based methods. While the robustness of these systems is well-documented, the security against adversarial attacks remains underexplored. This paper evaluates the security of foundation models' latent space digital watermarking systems that utilize adversarial embedding techniques. A series of experiments investigate the security dimensions under copy and removal attacks, providing empirical insights into these systems' vulnerabilities. All experimental codes and results are available at https://github.com/vkinakh/ssl-watermarking-attacks .