Deblur e-NeRF: NeRF from Motion-Blurred Events under High-speed or Low-light Conditions

作者: Weng Fei Low, Gim Hee Lee

分类: cs.CV, cs.GR, cs.RO, eess.SY

发布日期: 2024-09-26

备注: Accepted to ECCV 2024. Project website is accessible at https://wengflow.github.io/deblur-e-nerf

💡 一句话要点

提出Deblur e-NeRF,解决高速或低光条件下运动模糊事件的NeRF重建问题

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: NeRF 事件相机 运动模糊 三维重建 低光照 高动态范围 像素带宽模型

📋 核心要点

- 事件相机在高动态范围和低光照条件下表现优异,但仍存在运动模糊问题,尤其是在这些挑战性条件下。

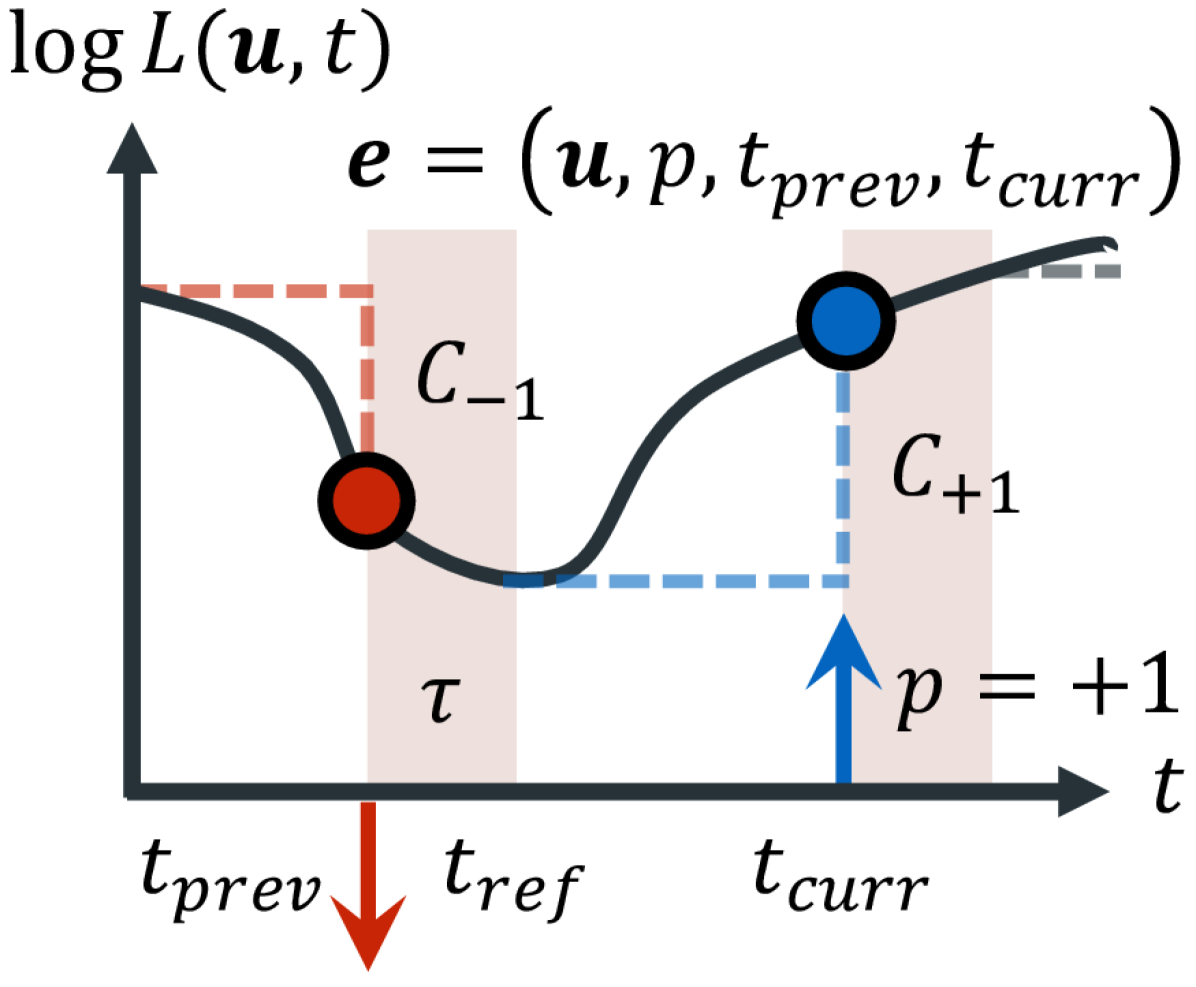

- Deblur e-NeRF提出了一种像素带宽模型来解释事件运动模糊,并使用阈值归一化总变分损失来正则化无纹理区域。

- 在真实和模拟数据上的实验表明,该方法能够有效地从运动模糊事件中重建高质量的NeRF。

📝 摘要(中文)

本文提出Deblur e-NeRF,一种新颖的方法,用于直接有效地从高速运动或低光条件下产生的运动模糊事件中重建模糊最小的NeRF。该工作的核心是提出了一个物理上精确的像素带宽模型,用于解释任意速度和光照条件下的事件运动模糊。此外,还引入了一种新颖的阈值归一化总变分损失,以改善大型无纹理区域的正则化。在真实和新颖的现实模拟序列上的实验验证了该方法的有效性。代码、事件模拟器和合成事件数据集将开源。

🔬 方法详解

问题定义:论文旨在解决在高速运动或低光照条件下,事件相机采集的数据由于运动模糊而导致的NeRF重建质量下降的问题。现有的NeRF重建方法和事件相机模拟器通常忽略了事件运动模糊的影响,导致重建结果不准确或模糊。

核心思路:论文的核心思路是建立一个物理上精确的像素带宽模型,该模型能够根据速度和光照条件来估计事件运动模糊的程度。通过将该模型集成到NeRF重建过程中,可以有效地消除运动模糊的影响,从而提高重建质量。此外,论文还引入了一种新的正则化方法,以改善无纹理区域的重建效果。

技术框架:Deblur e-NeRF的整体框架包括以下几个主要步骤:1) 使用事件相机采集数据;2) 使用提出的像素带宽模型估计事件运动模糊;3) 将运动模糊信息集成到NeRF重建过程中;4) 使用阈值归一化总变分损失进行正则化。该框架可以直接从运动模糊事件中重建出清晰的NeRF。

关键创新:该论文最重要的技术创新点在于提出了一个物理上精确的像素带宽模型,该模型能够准确地描述事件运动模糊与速度和光照条件之间的关系。与现有方法相比,该模型能够更全面地考虑运动模糊的影响,从而提高重建质量。此外,阈值归一化总变分损失也是一个重要的创新点,它可以有效地改善无纹理区域的重建效果。

关键设计:像素带宽模型的设计基于事件相机的物理特性,考虑了像素的响应时间和光照强度等因素。阈值归一化总变分损失的设计旨在平衡重建结果的清晰度和光滑度,避免过度平滑或产生伪影。具体的参数设置和网络结构在论文中有详细描述,但此处不便赘述。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Deblur e-NeRF在真实和模拟数据集上均取得了显著的性能提升。与现有方法相比,该方法能够更有效地消除运动模糊,重建出更清晰、更准确的NeRF。具体的性能数据和对比结果在论文中有详细展示。

🎯 应用场景

该研究成果可应用于高速运动物体的三维重建、低光照环境下的场景理解、自动驾驶和机器人导航等领域。通过消除运动模糊的影响,可以提高这些应用场景中的感知精度和鲁棒性,从而实现更可靠的决策和控制。

📄 摘要(原文)

The stark contrast in the design philosophy of an event camera makes it particularly ideal for operating under high-speed, high dynamic range and low-light conditions, where standard cameras underperform. Nonetheless, event cameras still suffer from some amount of motion blur, especially under these challenging conditions, in contrary to what most think. This is attributed to the limited bandwidth of the event sensor pixel, which is mostly proportional to the light intensity. Thus, to ensure that event cameras can truly excel in such conditions where it has an edge over standard cameras, it is crucial to account for event motion blur in downstream applications, especially reconstruction. However, none of the recent works on reconstructing Neural Radiance Fields (NeRFs) from events, nor event simulators, have considered the full effects of event motion blur. To this end, we propose, Deblur e-NeRF, a novel method to directly and effectively reconstruct blur-minimal NeRFs from motion-blurred events generated under high-speed motion or low-light conditions. The core component of this work is a physically-accurate pixel bandwidth model proposed to account for event motion blur under arbitrary speed and lighting conditions. We also introduce a novel threshold-normalized total variation loss to improve the regularization of large textureless patches. Experiments on real and novel realistically simulated sequences verify our effectiveness. Our code, event simulator and synthetic event dataset will be open-sourced.