Good Data Is All Imitation Learning Needs

作者: Amir Samadi, Konstantinos Koufos, Kurt Debattista, Mehrdad Dianati

分类: cs.CV, cs.LG

发布日期: 2024-09-26

💡 一句话要点

CF-Driver:利用对抗解释增强模仿学习,提升自动驾驶系统在罕见场景下的鲁棒性

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 自动驾驶 模仿学习 对抗解释 数据增强 罕见场景 行为克隆 CARLA模拟器

📋 核心要点

- 传统模仿学习在自动驾驶中面临真实场景覆盖不全的挑战,导致模型在罕见和安全关键场景中表现不佳。

- 论文提出CF-Driver,利用对抗解释生成决策边界附近的样本,增强训练数据,从而提升模型对罕见场景的泛化能力。

- 实验表明,CF-Driver在CARLA模拟器中显著优于现有方法,驾驶分数提升15.02%,违规率降低。

📝 摘要(中文)

本文针对传统师生模型、模仿学习和行为克隆在自动驾驶系统(ADS)中面临的局限性,即无法完全覆盖真实世界场景的问题,提出了一种新颖的数据增强技术,利用对抗解释(CFEs)来增强端到端ADS的鲁棒性。通过对输入进行最小修改,CFEs生成决策边界附近的训练样本,从而更全面地表示专家驾驶策略,尤其是在安全关键场景中。这种方法有助于提高模型处理罕见和具有挑战性的驾驶事件的能力,例如预测行人突然出现,最终使ADS的决策更加安全和可信。在CARLA模拟器中的实验表明,CF-Driver优于当前最先进的方法,实现了更高的驾驶分数和更低的违规率。具体而言,CF-Driver的驾驶分数为84.2,比之前的最佳模型高出15.02个百分点。实验结果突出了在端到端ADS训练中引入CFEs的有效性。CF-Driver的代码已公开,以促进进一步的研究。

🔬 方法详解

问题定义:自动驾驶系统依赖模仿学习从专家数据中学习驾驶策略,但现有方法难以覆盖所有真实世界场景,尤其是在安全关键的罕见场景下,导致模型泛化能力不足,容易发生事故。现有方法无法有效生成这些罕见场景的数据,导致模型训练不足。

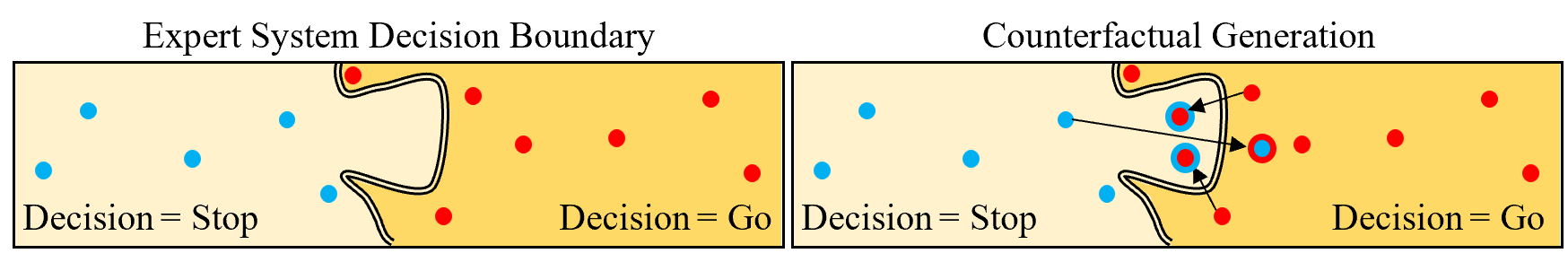

核心思路:论文的核心思路是利用对抗解释(Counterfactual Explanations,CFEs)生成位于决策边界附近的“反事实”样本,这些样本代表了稍微不同的驾驶情境,可以有效扩充训练数据集,特别是针对罕见和安全关键场景。通过让模型学习这些“如果...会怎样”的情境,提高其在真实世界中的鲁棒性和泛化能力。

技术框架:CF-Driver的整体框架包括以下几个主要模块:1) 专家数据收集:收集高质量的专家驾驶数据。2) 对抗解释生成:利用CFE生成器,针对每个专家驾驶行为,生成多个略有不同的反事实样本,这些样本位于决策边界附近。3) 数据增强:将生成的CFE样本与原始专家数据混合,形成增强后的训练数据集。4) 模型训练:使用增强后的数据集训练端到端自动驾驶模型。5) 评估:在CARLA模拟器中评估模型的性能,包括驾驶分数和违规率。

关键创新:该论文的关键创新在于将对抗解释(CFEs)引入到自动驾驶的模仿学习中,作为一种数据增强技术。与传统的随机数据增强方法不同,CFEs能够智能地生成位于决策边界附近的样本,这些样本对模型的训练更有价值,可以显著提高模型在罕见场景下的性能。

关键设计:CFE生成器的设计至关重要。论文可能采用了基于优化的方法来生成CFEs,目标是找到对原始输入进行最小修改,从而导致模型产生不同决策的样本。损失函数可能包括:1) 修改幅度最小化:限制对原始输入的修改程度。2) 决策差异最大化:确保生成的CFE样本导致模型产生不同的驾驶行为。3) 真实性约束:确保生成的CFE样本仍然是合理的驾驶场景。

🖼️ 关键图片

📊 实验亮点

CF-Driver在CARLA模拟器中取得了显著的性能提升,驾驶分数达到84.2,比之前的最佳模型高出15.02个百分点。这表明利用对抗解释进行数据增强可以有效提高自动驾驶模型在复杂环境下的性能。同时,CF-Driver的违规率也显著降低,进一步验证了该方法的有效性。

🎯 应用场景

该研究成果可应用于提升自动驾驶系统在复杂和不确定环境下的安全性和可靠性。通过增强模型对罕见场景的泛化能力,可以减少事故发生率,提高自动驾驶汽车的信任度。此外,该方法还可以应用于其他需要高安全性的机器人系统,例如无人机、工业机器人等。

📄 摘要(原文)

In this paper, we address the limitations of traditional teacher-student models, imitation learning, and behaviour cloning in the context of Autonomous/Automated Driving Systems (ADS), where these methods often struggle with incomplete coverage of real-world scenarios. To enhance the robustness of such models, we introduce the use of Counterfactual Explanations (CFEs) as a novel data augmentation technique for end-to-end ADS. CFEs, by generating training samples near decision boundaries through minimal input modifications, lead to a more comprehensive representation of expert driver strategies, particularly in safety-critical scenarios. This approach can therefore help improve the model's ability to handle rare and challenging driving events, such as anticipating darting out pedestrians, ultimately leading to safer and more trustworthy decision-making for ADS. Our experiments in the CARLA simulator demonstrate that CF-Driver outperforms the current state-of-the-art method, achieving a higher driving score and lower infraction rates. Specifically, CF-Driver attains a driving score of 84.2, surpassing the previous best model by 15.02 percentage points. These results highlight the effectiveness of incorporating CFEs in training end-to-end ADS. To foster further research, the CF-Driver code is made publicly available.