Parameter-efficient Bayesian Neural Networks for Uncertainty-aware Depth Estimation

作者: Richard D. Paul, Alessio Quercia, Vincent Fortuin, Katharina Nöh, Hanno Scharr

分类: cs.CV, stat.ML

发布日期: 2024-09-25

备注: Presented at UnCV Workshop at ECCV'24

💡 一句话要点

提出参数高效贝叶斯神经网络,用于不确定性感知的深度估计

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 单目深度估计 贝叶斯神经网络 参数高效微调 不确定性量化 Transformer 低秩适应 CoLoRA

📋 核心要点

- 单目深度估计等任务需要量化预测的不确定性,但大型Transformer模型的贝叶斯方法参数量巨大。

- 论文探索了参数高效微调(PEFT)方法与贝叶斯推断结合,以降低参数量并提升不确定性估计的可靠性。

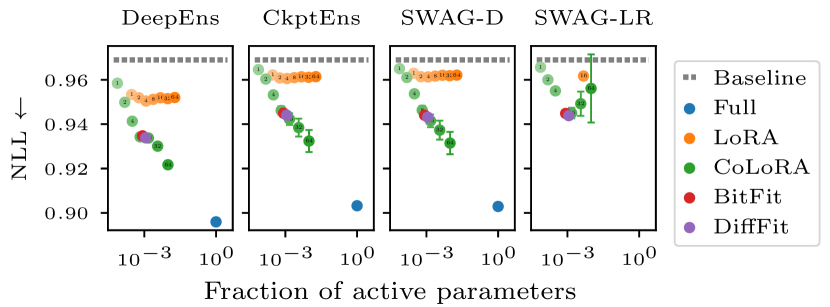

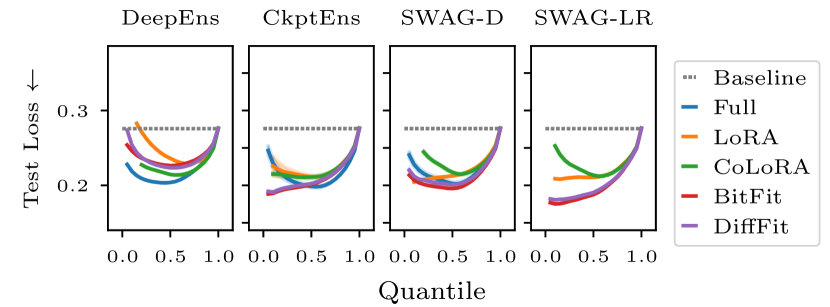

- 实验表明,结合BitFit、DiffFit、LoRA和CoLoRA等PEFT方法的贝叶斯神经网络,在单目深度估计任务中表现更优。

📝 摘要(中文)

单目深度估计(MDE)等先进计算机视觉任务严重依赖于大型、现代的基于Transformer的架构。然而,它们在安全关键领域的应用需要可靠的预测性能和不确定性量化。贝叶斯神经网络为满足这些需求提供了一个概念上简单的方法,但它们受到参数空间高维性的影响。参数高效微调(PEFT)方法,特别是低秩适应(LoRA),已经成为一种流行的策略,通过在较低维子空间上执行参数推断,将大规模模型适应于下游任务。在这项工作中,我们研究了PEFT方法在大型基于Transformer的视觉模型中进行子空间贝叶斯推断的适用性。我们表明,将BitFit、DiffFit、LoRA和一种新的LoRA启发式PEFT方法CoLoRA与贝叶斯推断相结合,确实能够在MDE中实现更鲁棒和可靠的预测性能。

🔬 方法详解

问题定义:论文旨在解决单目深度估计任务中,大型Transformer模型应用贝叶斯方法进行不确定性量化时,参数量过大导致计算成本高昂的问题。现有方法难以在保证性能的同时,实现高效的不确定性估计。

核心思路:论文的核心思路是将参数高效微调(PEFT)方法与贝叶斯推断相结合。通过在低维子空间上进行参数推断,显著减少了需要学习的参数数量,从而降低了计算复杂度,并使得在大型模型上应用贝叶斯方法成为可能。

技术框架:整体框架包括:1) 选择一个预训练的Transformer-based视觉模型作为backbone;2) 应用PEFT方法(如LoRA, BitFit, DiffFit, CoLoRA)在模型的特定层引入可学习的低秩矩阵或偏差项;3) 使用贝叶斯推断方法(具体方法未知,论文中未详细说明)对PEFT引入的参数进行学习,得到参数的后验分布;4) 利用后验分布进行预测,并量化预测的不确定性。

关键创新:论文的关键创新在于探索了PEFT方法在贝叶斯神经网络中的应用,并提出了一种新的LoRA启发式PEFT方法CoLoRA。CoLoRA的具体实现细节未知,但其目标是进一步提升参数效率和性能。将PEFT与贝叶斯方法结合,使得在大型视觉模型上进行高效且可靠的不确定性估计成为可能。

关键设计:论文的关键设计包括:1) 选择合适的PEFT方法,例如LoRA的秩的大小,BitFit中需要微调的参数等;2) 设计CoLoRA的具体结构和参数;3) 选择合适的贝叶斯推断方法,并设计相应的损失函数以优化模型。具体的参数设置、损失函数和网络结构等技术细节在摘要中未提及,需要查阅论文全文。

🖼️ 关键图片

📊 实验亮点

论文实验表明,将BitFit、DiffFit、LoRA和CoLoRA等PEFT方法与贝叶斯推断相结合,能够在单目深度估计任务中实现更鲁棒和可靠的预测性能。具体的性能数据和提升幅度需要在论文全文中查找。该研究验证了PEFT方法在贝叶斯神经网络中的有效性,并为大型视觉模型的不确定性量化提供了一种新的思路。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、医学图像分析等安全关键领域。在这些领域中,深度估计的准确性和可靠性至关重要,同时需要对预测结果的不确定性进行量化,以便做出更明智的决策。参数高效的贝叶斯神经网络能够降低计算成本,并提高模型在资源受限环境中的部署能力。

📄 摘要(原文)

State-of-the-art computer vision tasks, like monocular depth estimation (MDE), rely heavily on large, modern Transformer-based architectures. However, their application in safety-critical domains demands reliable predictive performance and uncertainty quantification. While Bayesian neural networks provide a conceptually simple approach to serve those requirements, they suffer from the high dimensionality of the parameter space. Parameter-efficient fine-tuning (PEFT) methods, in particular low-rank adaptations (LoRA), have emerged as a popular strategy for adapting large-scale models to down-stream tasks by performing parameter inference on lower-dimensional subspaces. In this work, we investigate the suitability of PEFT methods for subspace Bayesian inference in large-scale Transformer-based vision models. We show that, indeed, combining BitFit, DiffFit, LoRA, and CoLoRA, a novel LoRA-inspired PEFT method, with Bayesian inference enables more robust and reliable predictive performance in MDE.