ID-Guard: A Universal Framework for Combating Facial Manipulation via Breaking Identification

作者: Zuomin Qu, Wei Lu, Xiangyang Luo, Qian Wang, Xiaochun Cao

分类: cs.CV, cs.AI

发布日期: 2024-09-20 (更新: 2025-04-10)

💡 一句话要点

提出ID-Guard框架,通过破坏身份信息对抗人脸伪造,保护个人隐私。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 人脸伪造检测 对抗攻击 对抗防御 身份保护 多任务学习

📋 核心要点

- 现有对抗人脸伪造的方法可能保留可识别的面部特征,导致个人隐私泄露和污名化。

- ID-Guard框架通过生成对抗扰动,在破坏伪造过程的同时,降低伪造人脸中的身份可识别性。

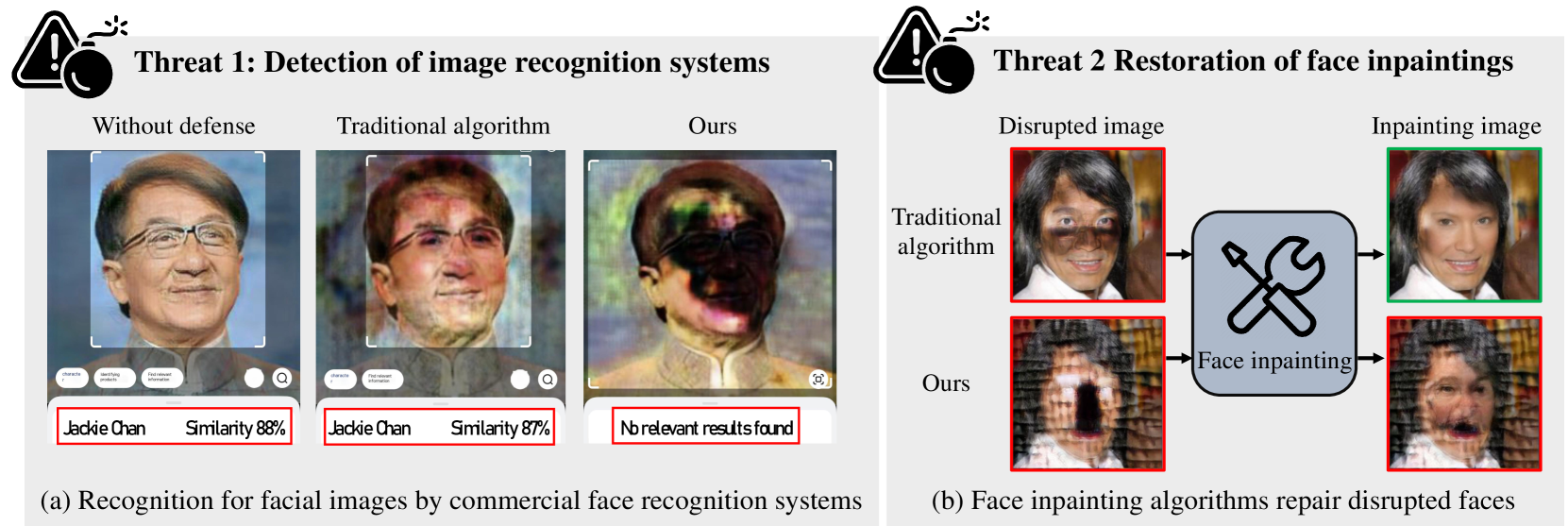

- 实验表明ID-Guard能有效防御多种伪造模型,降低可识别区域,并能逃避人脸修复和识别系统。

📝 摘要(中文)

基于深度学习的人脸伪造技术滥用对公民权利构成严重威胁。为了从源头上防止此类欺诈,主动防御通过向图像添加不可见的对抗扰动来破坏伪造过程,使伪造的输出对观察者来说不具说服力。然而,针对输出的非特定破坏可能导致可识别的面部特征的保留,可能导致个人的污名化。本文提出了一个用于对抗人脸伪造的通用框架,称为ID-Guard。具体来说,该框架通过编码器-解码器网络的单次前向传递来产生跨模型可迁移的对抗扰动。引入了一种新的身份破坏模块(IDM)来降低伪造人脸中的可识别特征。我们将不同人脸伪造的破坏构建为一个多任务学习问题来优化扰动生成,并设计了一种动态权重策略来增强跨模型性能。实验结果表明,所提出的ID-Guard在防御各种人脸伪造模型方面表现出强大的功效,有效地降低了被操纵图像中的可识别区域。它还使被破坏的图像能够逃避人脸修复和图像识别系统。此外,ID-Guard可以无缝地用作即插即用组件,与其他任务(如对抗训练)集成。

🔬 方法详解

问题定义:当前对抗人脸伪造的方法主要集中在破坏伪造结果的真实性,但忽略了对个人身份信息的保护。即使伪造图像变得不逼真,如果仍然能够识别出图像中的人,仍然存在隐私泄露和被污名化的风险。因此,需要一种方法,既能有效对抗人脸伪造,又能降低伪造图像中身份信息的可识别性。

核心思路:ID-Guard的核心思路是在生成对抗扰动的同时,显式地破坏图像中的身份信息。通过引入身份破坏模块(IDM),在扰动生成过程中,鼓励模型生成能够降低人脸识别系统置信度的扰动,从而达到保护个人身份信息的目的。同时,将对抗不同伪造模型的问题视为多任务学习问题,提高扰动的泛化能力。

技术框架:ID-Guard框架主要由一个编码器-解码器网络和一个身份破坏模块(IDM)组成。编码器-解码器网络负责生成对抗扰动,IDM负责评估扰动对身份信息的影响。整个流程如下:首先,输入原始图像,通过编码器-解码器网络生成对抗扰动。然后,将扰动添加到原始图像上,得到对抗样本。接着,将对抗样本输入到人脸识别模型中,IDM根据人脸识别模型的输出,计算身份损失。最后,将对抗损失和身份损失结合起来,优化编码器-解码器网络,生成既能对抗伪造,又能保护身份信息的扰动。

关键创新:ID-Guard的关键创新在于引入了身份破坏模块(IDM),将身份信息保护纳入对抗伪造的框架中。与以往只关注对抗伪造效果的方法不同,ID-Guard同时考虑了对抗伪造和身份信息保护两个目标,从而更好地保护了个人隐私。此外,将对抗不同伪造模型的问题视为多任务学习问题,提高了扰动的跨模型泛化能力。

关键设计:IDM使用预训练的人脸识别模型来评估身份信息的可识别性。身份损失函数的设计目标是降低人脸识别模型对对抗样本的置信度。对抗损失函数的设计目标是使伪造模型无法生成逼真的伪造图像。动态权重策略用于平衡对抗损失和身份损失,以及不同伪造模型的对抗损失。编码器-解码器网络可以使用各种现有的网络结构,例如U-Net。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ID-Guard能够有效防御多种人脸伪造模型,包括Deepfakes、Face2Face、NeuralTextures等。与现有方法相比,ID-Guard在对抗伪造的同时,能够显著降低伪造图像中身份信息的可识别性。此外,ID-Guard生成的对抗样本能够逃避人脸修复和图像识别系统,进一步提高了安全性。ID-Guard还可以作为即插即用组件,与其他对抗训练方法集成,进一步提高防御能力。

🎯 应用场景

ID-Guard可应用于社交媒体平台、视频会议系统、身份验证系统等,用于保护用户免受人脸伪造攻击,防止个人信息被滥用。该技术还有助于提高人脸识别系统的安全性,使其更能抵抗对抗样本攻击。未来,ID-Guard可以扩展到其他生物特征识别领域,例如指纹识别、虹膜识别等。

📄 摘要(原文)

The misuse of deep learning-based facial manipulation poses a significant threat to civil rights. To prevent this fraud at its source, proactive defense has been proposed to disrupt the manipulation process by adding invisible adversarial perturbations into images, making the forged output unconvincing to observers. However, the non-specific disruption against the output may lead to the retention of identifiable facial features, potentially resulting in the stigmatization of the individual. This paper proposes a universal framework for combating facial manipulation, termed ID-Guard. Specifically, this framework operates with a single forward pass of an encoder-decoder network to produce a cross-model transferable adversarial perturbation. A novel Identity Destruction Module (IDM) is introduced to degrade identifiable features in forged faces. We optimize the perturbation generation by framing the disruption of different facial manipulations as a multi-task learning problem, and a dynamic weight strategy is devised to enhance cross-model performance. Experimental results demonstrate that the proposed ID-Guard exhibits strong efficacy in defending against various facial manipulation models, effectively degrading identifiable regions in manipulated images. It also enables disrupted images to evade facial inpainting and image recognition systems. Additionally, ID-Guard can seamlessly function as a plug-and-play component, integrating with other tasks such as adversarial training.