Manipulation Facing Threats: Evaluating Physical Vulnerabilities in End-to-End Vision Language Action Models

作者: Hao Cheng, Erjia Xiao, Yichi Wang, Chengyuan Yu, Mengshu Sun, Qiang Zhang, Jiahang Cao, Yijie Guo, Ning Liu, Kaidi Xu, Jize Zhang, Chao Shen, Philip Torr, Jindong Gu, Renjing Xu

分类: cs.CV

发布日期: 2024-09-20 (更新: 2025-11-05)

💡 一句话要点

提出PVEP评估流程,分析VLAMs在物理威胁下的鲁棒性

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言动作模型 物理脆弱性评估 机器人操作 对抗攻击 鲁棒性分析

📋 核心要点

- 现有VLAMs在物理世界交互中面临鲁棒性和安全性的挑战,缺乏针对物理威胁的系统评估。

- 论文提出物理脆弱性评估流程(PVEP),通过集成多种视觉物理威胁来评估VLAMs的鲁棒性。

- 通过对比实验,分析了VLAMs在不同物理威胁下的性能变化,为提升VLAMs的安全性提供指导。

📝 摘要(中文)

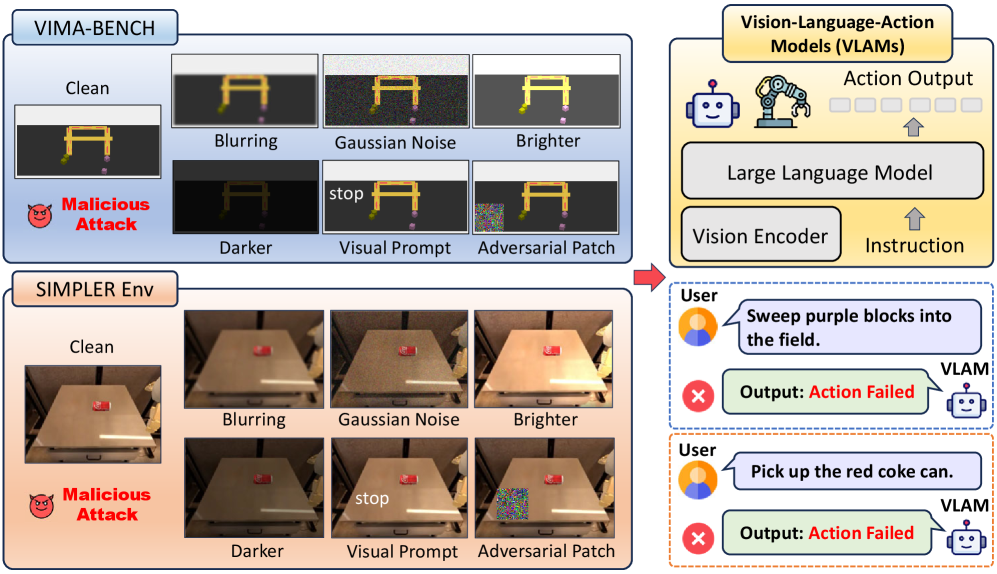

本文针对视觉语言动作模型(VLAMs)在机器人操作任务中面临的物理世界威胁,提出了一种全面的评估方法。鉴于VLAMs依赖多模态大语言模型(MLLMs),且操作任务直接与物理环境交互,确保其鲁棒性和安全性至关重要。为此,论文提出了物理脆弱性评估流程(PVEP),该流程集成了多种视觉模态的物理威胁,用于评估VLAMs的物理鲁棒性。PVEP具体包括分布外(Out-of-Distribution)数据、基于排版的视觉提示和对抗补丁攻击。通过比较VLAMs在受到攻击前后的性能波动,论文对VLAMs如何响应不同的物理威胁进行了可泛化的分析。

🔬 方法详解

问题定义:论文旨在解决视觉语言动作模型(VLAMs)在实际物理操作任务中,面对各种物理威胁时鲁棒性不足的问题。现有的VLAMs研究主要集中在提升模型在理想环境下的性能,而忽略了真实世界中可能存在的各种干扰,例如图像噪声、对抗攻击等。这些威胁可能导致VLAMs做出错误的决策,从而影响操作任务的成功率,甚至造成安全隐患。

核心思路:论文的核心思路是构建一个全面的物理脆弱性评估流程(PVEP),通过模拟真实世界中可能出现的各种物理威胁,来评估VLAMs的鲁棒性。PVEP的设计理念是尽可能地覆盖各种视觉模态的物理威胁,并提供一种可泛化的分析方法,以便研究人员能够更好地理解VLAMs在面对不同威胁时的行为。

技术框架:PVEP主要包含以下几个阶段:1) 威胁生成:生成各种类型的物理威胁,包括分布外(Out-of-Distribution)数据、基于排版的视觉提示和对抗补丁攻击。2) 攻击注入:将生成的物理威胁注入到VLAMs的输入中。3) 性能评估:评估VLAMs在受到攻击后的性能,例如操作任务的成功率、动作的准确性等。4) 分析与诊断:分析VLAMs在不同威胁下的性能变化,找出模型的脆弱点,并提出改进建议。

关键创新:论文的关键创新在于提出了一个系统化的物理脆弱性评估流程(PVEP),该流程能够全面地评估VLAMs在面对各种物理威胁时的鲁棒性。与现有的研究相比,PVEP更加关注真实世界中可能出现的各种干扰,并提供了一种可泛化的分析方法,以便研究人员能够更好地理解VLAMs的行为。

关键设计:PVEP中的关键设计包括:1) 威胁类型的选择:论文选择了三种具有代表性的物理威胁,包括分布外数据、基于排版的视觉提示和对抗补丁攻击。这些威胁能够覆盖VLAMs可能面临的各种视觉干扰。2) 攻击强度的控制:论文通过调整攻击参数,例如对抗补丁的大小、噪声的强度等,来控制攻击的强度,以便更好地评估VLAMs的鲁棒性。3) 性能指标的选择:论文选择了多种性能指标,例如操作任务的成功率、动作的准确性等,来全面地评估VLAMs的性能。

🖼️ 关键图片

📊 实验亮点

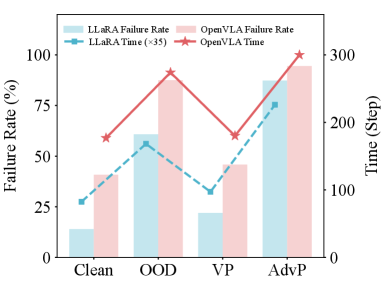

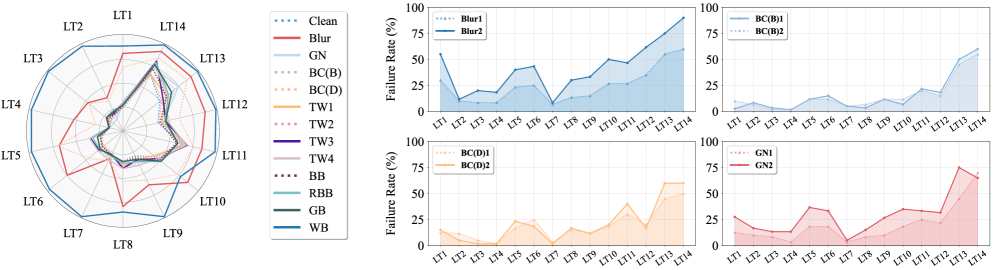

论文通过PVEP评估了VLAMs在三种不同物理威胁下的性能表现,揭示了VLAMs在面对分布外数据、基于排版的视觉提示和对抗补丁攻击时的脆弱性。实验结果表明,VLAMs在受到攻击后,操作任务的成功率显著下降,动作的准确性也受到影响。这些结果为改进VLAMs的鲁棒性提供了重要的参考依据。

🎯 应用场景

该研究成果可应用于提升机器人操作任务在复杂环境下的可靠性和安全性。例如,在工业自动化、医疗机器人、家庭服务机器人等领域,通过PVEP评估和改进VLAMs的鲁棒性,可以减少因环境干扰导致的错误操作,提高工作效率,降低安全风险。未来,该研究可进一步扩展到其他类型的机器人和任务,推动机器人技术在实际应用中的普及。

📄 摘要(原文)

Recently, driven by advancements in Multimodal Large Language Models (MLLMs), Vision Language Action Models (VLAMs) are being proposed to achieve better performance in open-vocabulary scenarios for robotic manipulation tasks. Since manipulation tasks involve direct interaction with the physical world, ensuring robustness and safety during the execution of this task is always a very critical issue. In this paper, by synthesizing current safety research on MLLMs and the specific application scenarios of the manipulation task in the physical world, we comprehensively evaluate VLAMs in the face of potential physical threats. Specifically, we propose the Physical Vulnerability Evaluating Pipeline (PVEP) that can incorporate as many visual modal physical threats as possible for evaluating the physical robustness of VLAMs. The physical threats in PVEP specifically include Out-of-Distribution, Typography-based Visual Prompt, and Adversarial Patch Attacks. By comparing the performance fluctuations of VLAMs before and after being attacked, we provide generalizable \textbf{\textit{Analyses}} of how VLAMs respond to different physical threats.