High-Fidelity Mask-free Neural Surface Reconstruction for Virtual Reality

作者: Haotian Bai, Yize Chen, Lin Wang

分类: cs.CV

发布日期: 2024-09-20

💡 一句话要点

Hi-NeuS:无需掩膜的高保真神经表面重建,用于虚拟现实

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting)

关键词: 神经隐式表面重建 多视角三维重建 无掩膜学习 自监督学习 虚拟现实 增强现实

📋 核心要点

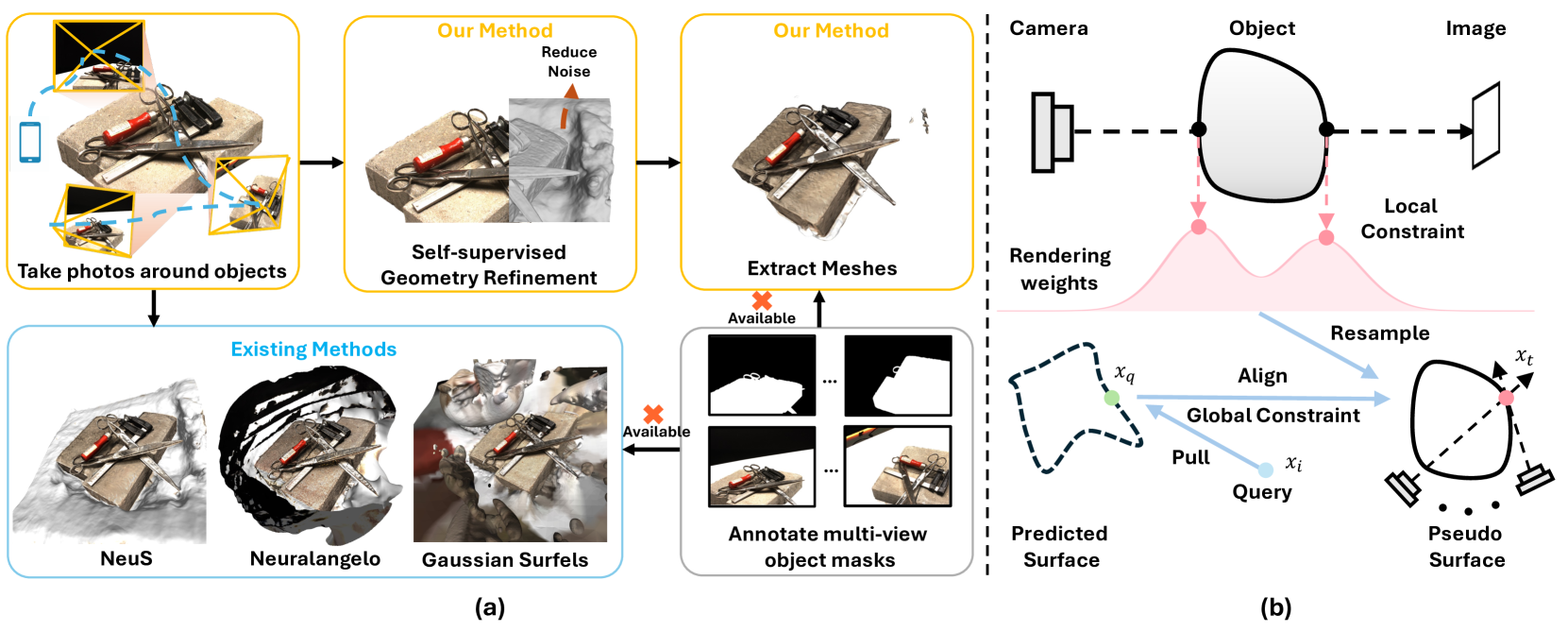

- 现有基于NeuS的表面重建方法依赖于对象掩膜,这增加了人工标注成本,限制了其在实际应用中的便捷性。

- Hi-NeuS通过分析多视角渲染权重分布,自监督地细化神经表面的SDF,从而无需掩膜即可重建紧凑精确的表面。

- 实验表明,Hi-NeuS在DTU数据集上显著降低了表面噪声并改善了未掩膜的Chamfer距离,提升了表面重建质量。

📝 摘要(中文)

本文提出Hi-NeuS,一种新颖的基于渲染的神经隐式表面重建框架,旨在无需多视角对象掩膜即可恢复紧凑而精确的表面。核心思想是,以对象为中心的视图中的重叠区域自然地突出了感兴趣的对象。通过估计从多个视图累积的渲染权重的分布来指定感兴趣的对象,从而隐式地识别用户想要捕获的表面。受此启发,设计了一种几何细化方法,该方法采用多视角渲染权重以自监督的方式指导神经表面的有符号距离函数(SDF)。具体来说,它保留这些权重以基于其分布重新采样伪表面,从而促进SDF与感兴趣对象的对齐。然后,正则化SDF的偏差以实现几何一致性。此外,提出使用未掩膜的Chamfer距离(CD)来测量提取的网格,无需后处理,以进行更精确的评估。通过NeuS及其变体Neuralangelo验证了该方法,证明了其在不同NeuS骨干网络中的适应性。在DTU数据集上的大量基准测试表明,该方法将表面噪声降低了约20%,并将未掩膜的CD改善了约30%,从而实现了更好的表面细节。Hi-NeuS的优越性已在BlendedMVS和手持相机拍摄的内容创建中得到进一步验证。

🔬 方法详解

问题定义:现有基于神经隐式表面的三维重建方法,如NeuS,通常需要多视角图像的精确对象掩膜作为输入,以约束重建结果的几何形状。手动标注这些掩膜非常耗时耗力,限制了此类方法在实际场景中的应用,尤其是在大规模或交互式内容创作中。因此,如何在没有对象掩膜的情况下,实现高保真度的三维表面重建是一个重要的挑战。

核心思路:Hi-NeuS的核心思路是利用多视角图像的冗余信息,通过分析渲染权重分布来自动识别感兴趣的对象。当相机围绕对象旋转时,对象在不同视角下的重叠区域会自然地突出显示该对象。通过学习这些渲染权重的分布,可以隐式地推断出用户想要重建的表面,从而避免了显式掩膜标注的需要。

技术框架:Hi-NeuS的整体框架基于NeuS,主要包含以下几个阶段:1) 多视角图像输入;2) 基于神经辐射场的渲染;3) 渲染权重估计;4) 基于渲染权重的SDF细化;5) 几何一致性正则化;6) 表面提取与评估。其中,SDF细化和几何一致性正则化是Hi-NeuS的关键组成部分。

关键创新:Hi-NeuS的主要创新在于提出了一种自监督的几何细化方法,该方法利用多视角渲染权重来指导神经表面的SDF学习。具体来说,它通过渲染权重对伪表面进行重采样,从而将SDF与感兴趣的对象对齐。此外,还引入了几何一致性正则化项,以约束SDF的偏差,进一步提高重建质量。

关键设计:Hi-NeuS的关键设计包括:1) 使用渲染权重分布来定义伪表面,并将其作为SDF细化的目标;2) 设计了几何一致性正则化项,以约束SDF的梯度范数和拉普拉斯算子;3) 使用未掩膜的Chamfer距离(CD)作为评估指标,以更准确地衡量重建结果的质量。

🖼️ 关键图片

📊 实验亮点

Hi-NeuS在DTU数据集上进行了广泛的实验验证,结果表明,与基线方法NeuS相比,Hi-NeuS将表面噪声降低了约20%,并将未掩膜的Chamfer距离(CD)改善了约30%。此外,Hi-NeuS还在BlendedMVS和手持相机拍摄的数据集上取得了优异的性能,证明了其在实际应用中的有效性。

🎯 应用场景

Hi-NeuS在虚拟现实(VR)和增强现实(AR)内容创作领域具有广泛的应用前景。它可以用于快速创建高质量的三维模型,例如游戏资产、虚拟化身和数字孪生。由于无需手动标注掩膜,Hi-NeuS可以显著降低内容创作的成本和时间,并促进更便捷的交互式三维建模。

📄 摘要(原文)

Object-centric surface reconstruction from multi-view images is crucial in creating editable digital assets for AR/VR. Due to the lack of geometric constraints, existing methods, e.g., NeuS necessitate annotating the object masks to reconstruct compact surfaces in mesh processing. Mask annotation, however, incurs considerable labor costs due to its cumbersome nature. This paper presents Hi-NeuS, a novel rendering-based framework for neural implicit surface reconstruction, aiming to recover compact and precise surfaces without multi-view object masks. Our key insight is that the overlapping regions in the object-centric views naturally highlight the object of interest as the camera orbits around objects. The object of interest can be specified by estimating the distribution of the rendering weights accumulated from multiple views, which implicitly identifies the surface that a user intends to capture. This inspires us to design a geometric refinement approach, which takes multi-view rendering weights to guide the signed distance functions (SDF) of neural surfaces in a self-supervised manner. Specifically, it retains these weights to resample a pseudo surface based on their distribution. This facilitates the alignment of the SDF to the object of interest. We then regularize the SDF's bias for geometric consistency. Moreover, we propose to use unmasked Chamfer Distance(CD) to measure the extracted mesh without post-processing for more precise evaluation. Our approach has been validated through NeuS and its variant Neuralangelo, demonstrating its adaptability across different NeuS backbones. Extensive benchmark on the DTU dataset shows that our method reduces surface noise by about 20%, and improves the unmasked CD by around 30%, achieving better surface details. The superiority of Hi-NeuS is further validated on BlendedMVS and handheld camera captures for content creation.