WiLoR: End-to-end 3D Hand Localization and Reconstruction in-the-wild

作者: Rolandos Alexandros Potamias, Jinglei Zhang, Jiankang Deng, Stefanos Zafeiriou

分类: cs.CV

发布日期: 2024-09-18 (更新: 2025-03-26)

备注: CVPR 2025, Project Page https://rolpotamias.github.io/WiLoR

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

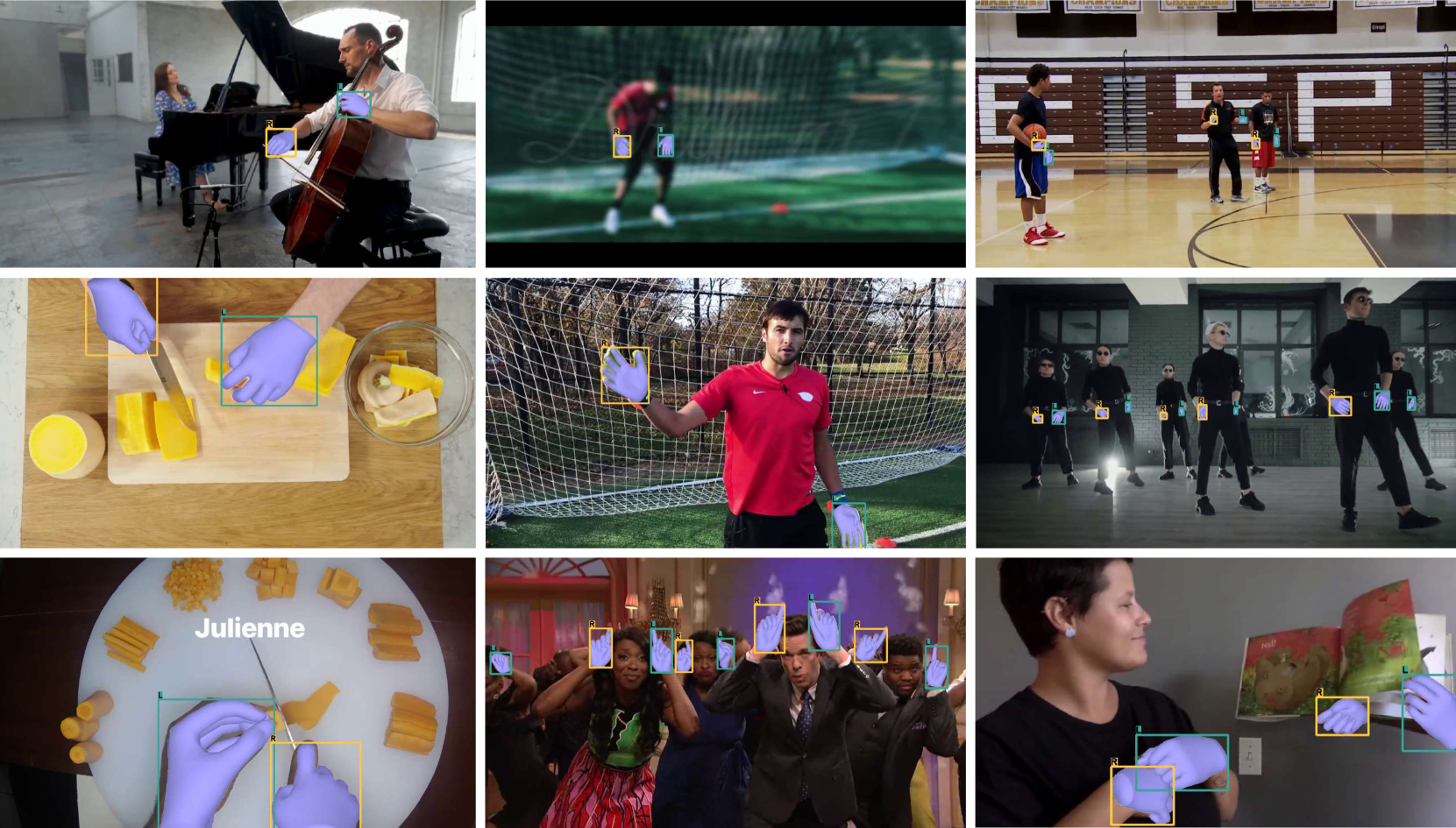

WiLoR:提出一个端到端框架,用于野外环境下的3D手部定位与重建。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 3D手部重建 手部姿态估计 深度学习 Transformer 全卷积网络 手部检测 人机交互

📋 核心要点

- 现有3D手部重建系统在野外环境下的手部检测环节存在瓶颈,缺乏鲁棒性和准确性。

- 提出WiLoR框架,包含实时手部定位网络和高保真3D手部重建模型,实现端到端的多手重建。

- 构建包含200万张图像的大规模手部数据集,实验表明该方法在效率和精度上均优于现有方法。

📝 摘要(中文)

近年来,3D手部姿态估计方法因其在人机交互、虚拟现实和机器人等领域的广泛应用而备受关注。相比之下,手部检测流程的进展相对滞后,这给构建有效的真实世界多手重建系统带来了重大挑战。本文提出了一个数据驱动的流程,用于高效的野外多手重建。该流程由两个组件组成:一个实时的全卷积手部定位网络和一个基于Transformer的高保真3D手部重建模型。为了解决先前方法的局限性并构建一个鲁棒且稳定的检测网络,我们引入了一个大规模数据集,其中包含超过200万张具有不同光照、亮度和遮挡条件的野外手部图像。我们的方法在流行的2D和3D基准测试中,在效率和准确性方面均优于先前的方法。最后,我们展示了我们的流程在单目视频中实现平滑3D手部跟踪的有效性,而无需利用任何时间组件。代码、模型和数据集已公开。

🔬 方法详解

问题定义:论文旨在解决野外环境下多手3D重建的问题。现有方法在手部检测方面存在不足,导致整体重建系统的性能受限,尤其是在光照变化、遮挡等复杂场景下,检测的鲁棒性和准确性难以保证。

核心思路:论文的核心思路是构建一个端到端的流程,将手部定位和3D重建两个阶段紧密结合。通过一个高效的手部定位网络快速准确地检测出手部位置,然后利用一个高保真的3D重建模型从检测结果中恢复出3D手部姿态。这种端到端的设计避免了传统方法中各个模块之间的误差累积,提高了整体性能。

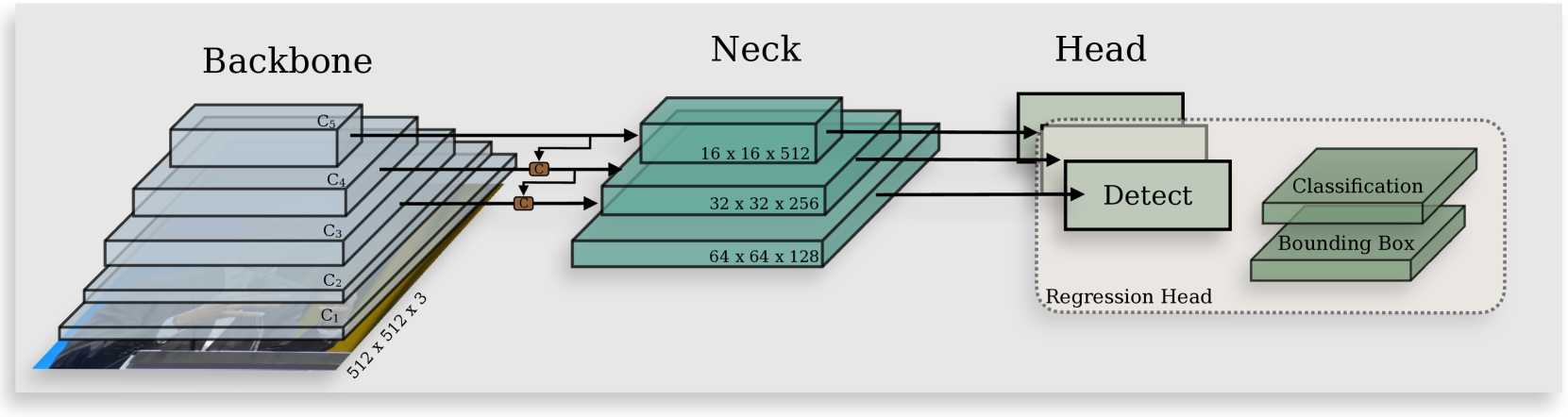

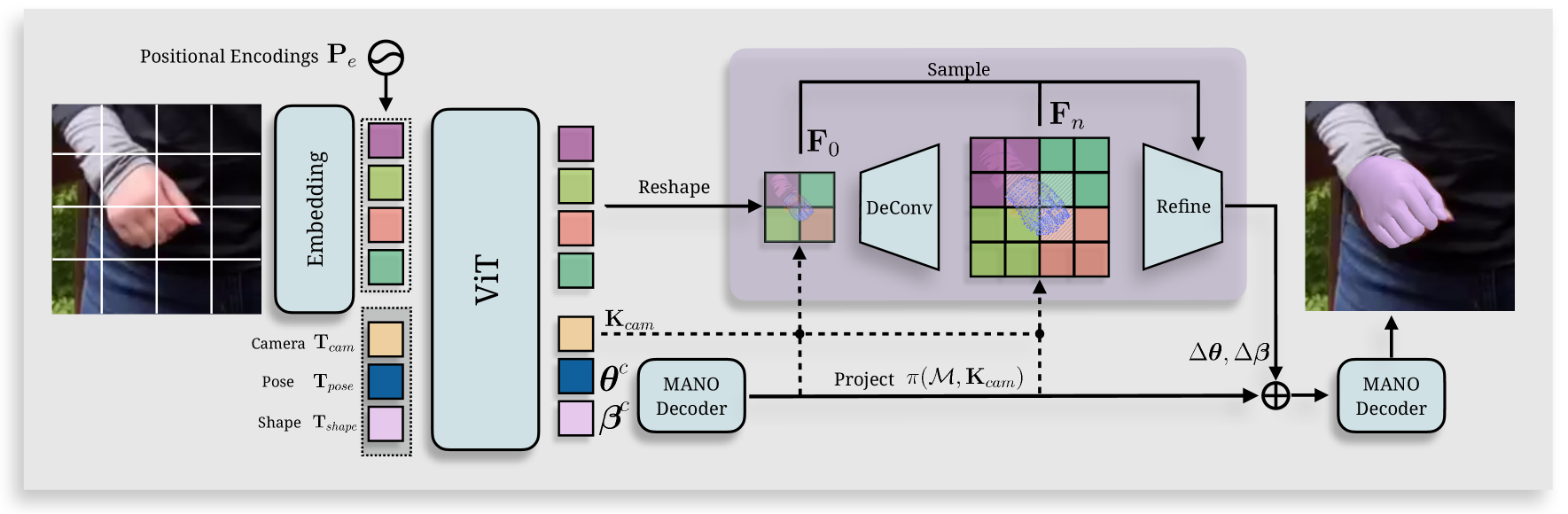

技术框架:WiLoR框架主要包含两个模块:1) 全卷积手部定位网络:用于实时检测图像中的手部位置,输出手部的2D边界框。该网络采用全卷积结构,能够高效地处理不同尺寸的输入图像。2) 基于Transformer的3D手部重建模型:用于从手部定位网络输出的边界框中重建出3D手部姿态。该模型利用Transformer的自注意力机制,能够有效地捕捉手部各个关节之间的依赖关系。

关键创新:论文的关键创新在于构建了一个大规模的野外手部数据集,并基于此训练了一个鲁棒且高效的手部定位网络。该数据集包含超过200万张图像,涵盖了各种光照、亮度和遮挡条件,极大地提升了手部定位网络的泛化能力。此外,端到端的框架设计也减少了误差传递,提高了整体重建精度。

关键设计:在手部定位网络中,采用了全卷积结构以提高效率。在3D手部重建模型中,使用了Transformer架构,并针对手部姿态估计任务进行了优化。损失函数方面,可能采用了2D/3D关键点回归损失、形状损失等,具体细节未知。数据集的构建是关键,包含了大量真实场景下的手部图像,并进行了精细的标注。

🖼️ 关键图片

📊 实验亮点

论文在2D和3D手部姿态估计基准测试中取得了显著的性能提升,具体数据未知。通过大规模数据集的训练,手部定位网络的鲁棒性得到了显著提高,能够有效处理复杂光照和遮挡情况。此外,该方法在单目视频中实现了平滑的3D手部跟踪,无需任何时序信息,展示了其优越的性能。

🎯 应用场景

该研究成果可广泛应用于人机交互、虚拟现实、增强现实和机器人等领域。例如,在VR/AR游戏中,可以实现更自然的手势交互;在机器人控制中,可以实现更精确的手部动作识别和控制;在远程协作中,可以实现更逼真的手部姿态同步。该研究的实际价值在于提高了3D手部重建的精度和鲁棒性,为相关应用提供了更可靠的技术支持。

📄 摘要(原文)

In recent years, 3D hand pose estimation methods have garnered significant attention due to their extensive applications in human-computer interaction, virtual reality, and robotics. In contrast, there has been a notable gap in hand detection pipelines, posing significant challenges in constructing effective real-world multi-hand reconstruction systems. In this work, we present a data-driven pipeline for efficient multi-hand reconstruction in the wild. The proposed pipeline is composed of two components: a real-time fully convolutional hand localization and a high-fidelity transformer-based 3D hand reconstruction model. To tackle the limitations of previous methods and build a robust and stable detection network, we introduce a large-scale dataset with over than 2M in-the-wild hand images with diverse lighting, illumination, and occlusion conditions. Our approach outperforms previous methods in both efficiency and accuracy on popular 2D and 3D benchmarks. Finally, we showcase the effectiveness of our pipeline to achieve smooth 3D hand tracking from monocular videos, without utilizing any temporal components. Code, models, and dataset are available https://rolpotamias.github.io/WiLoR.