ORB-SfMLearner: ORB-Guided Self-supervised Visual Odometry with Selective Online Adaptation

作者: Yanlin Jin, Rui-Yang Ju, Haojun Liu, Yuzhong Zhong

分类: cs.CV

发布日期: 2024-09-18 (更新: 2026-01-11)

备注: ICRA 2025; Project page: https://www.neiljin.site/projects/orbsfm/

🔗 代码/项目: GITHUB

💡 一句话要点

提出ORB引导的自监督视觉里程计,通过选择性在线自适应提升泛化性。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 视觉里程计 自监督学习 ORB特征 在线自适应 深度学习 位姿估计 泛化能力

📋 核心要点

- 现有深度视觉里程计在精度和泛化性上存在不足,限制了其应用范围,需要更鲁棒和泛化的方法。

- 该论文提出ORB-SfMLearner,利用ORB特征引导自运动估计,并引入选择性在线自适应以提升模型在不同场景下的泛化能力。

- 实验结果表明,该方法在KITTI和vKITTI数据集上,相比现有深度视觉里程计方法,在自运动精度和泛化性上均有提升。

📝 摘要(中文)

深度视觉里程计虽然经过广泛研究,但在精度和泛化性方面仍存在局限性,阻碍了其更广泛的应用。为了解决这些挑战,我们提出了一种Oriented FAST and Rotated BRIEF (ORB)引导的视觉里程计,并结合选择性在线自适应,命名为ORB-SfMLearner。我们创新性地利用ORB特征进行基于学习的自运动估计,从而获得更鲁棒和准确的结果。我们还引入了交叉注意力机制来增强PoseNet的可解释性,并揭示了车辆的行驶方向可以通过注意力权重来解释。为了提高泛化性,我们的选择性在线自适应允许网络在不同领域快速且有选择地调整到最佳参数。在KITTI和vKITTI数据集上的实验结果表明,我们的方法在自运动精度和泛化性方面优于以往最先进的深度视觉里程计方法。

🔬 方法详解

问题定义:深度视觉里程计旨在从连续的图像序列中估计相机的运动轨迹。现有方法在精度和泛化性方面存在挑战,尤其是在面对不同场景和光照条件时,性能会显著下降。现有的基于学习的方法难以适应新的环境,需要大量的标注数据或者离线微调。

核心思路:该论文的核心思路是利用传统视觉特征(ORB)的优势来引导深度学习模型的训练,从而提高模型的鲁棒性和精度。同时,引入选择性在线自适应机制,使模型能够快速适应新的环境,提高泛化能力。通过结合传统方法和深度学习的优点,克服了单一方法的局限性。

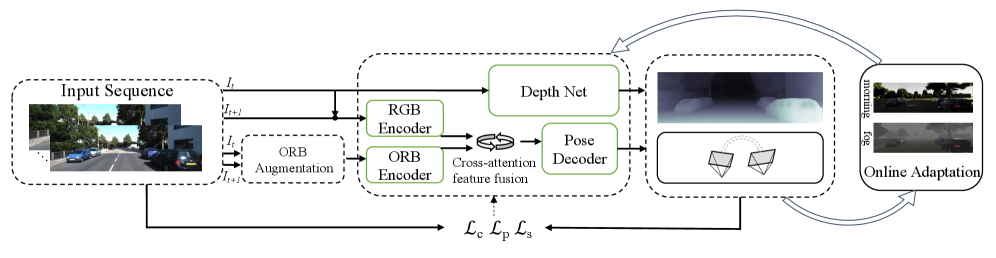

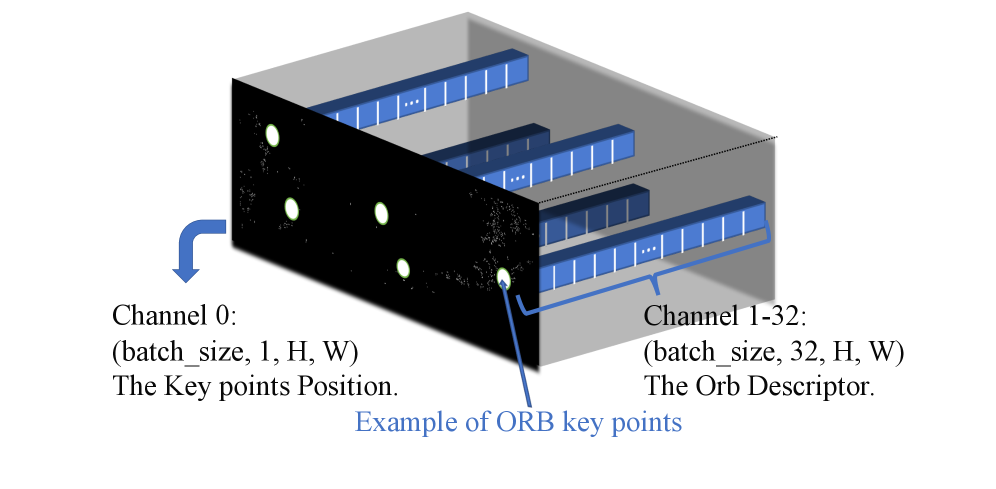

技术框架:ORB-SfMLearner的整体框架包括以下几个主要模块:1) ORB特征提取模块:提取图像中的ORB特征点。2) PoseNet:利用卷积神经网络估计相机的位姿变换。3) 深度估计网络:估计场景的深度信息。4) 交叉注意力机制:增强PoseNet的可解释性,并提取行驶方向信息。5) 选择性在线自适应模块:根据当前环境的特点,选择性地调整网络参数。

关键创新:该论文的关键创新点在于:1) 创新性地将ORB特征引入到基于学习的自运动估计中,利用ORB特征的鲁棒性来提高位姿估计的精度。2) 引入交叉注意力机制,增强了PoseNet的可解释性,并利用注意力权重来推断车辆的行驶方向。3) 提出了选择性在线自适应机制,使模型能够快速适应新的环境,提高了泛化能力。

关键设计:在网络结构方面,PoseNet采用了常见的卷积神经网络结构,并引入了交叉注意力机制。损失函数包括光度一致性损失、深度一致性损失和正则化损失。选择性在线自适应模块通过计算不同层参数的梯度范数,选择性地更新梯度范数较大的参数,从而实现快速适应。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ORB-SfMLearner在KITTI和vKITTI数据集上均取得了优异的性能。在KITTI数据集上,相比于之前的state-of-the-art方法,在translation error和rotation error上均有显著降低。选择性在线自适应机制能够显著提高模型在不同场景下的泛化能力,在vKITTI数据集上的实验结果也验证了这一点。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、增强现实等领域。在自动驾驶中,可以提高车辆在复杂环境下的定位精度和鲁棒性。在机器人导航中,可以帮助机器人更好地理解周围环境,实现自主导航。在增强现实中,可以提供更精确的姿态估计,从而实现更逼真的增强现实体验。该研究的在线自适应能力,使其在动态变化的场景中具有更强的适应性。

📄 摘要(原文)

Deep visual odometry, despite extensive research, still faces limitations in accuracy and generalizability that prevent its broader application. To address these challenges, we propose an Oriented FAST and Rotated BRIEF (ORB)-guided visual odometry with selective online adaptation named ORB-SfMLearner. We present a novel use of ORB features for learning-based ego-motion estimation, leading to more robust and accurate results. We also introduce the cross-attention mechanism to enhance the explainability of PoseNet and have revealed that driving direction of the vehicle can be explained through the attention weights. To improve generalizability, our selective online adaptation allows the network to rapidly and selectively adjust to the optimal parameters across different domains. Experimental results on KITTI and vKITTI datasets show that our method outperforms previous state-of-the-art deep visual odometry methods in terms of ego-motion accuracy and generalizability. Code is available at https://github.com/PeaceNeil/ORB-SfMLearner