Deep Height Decoupling for Precise Vision-based 3D Occupancy Prediction

作者: Yuan Wu, Zhiqiang Yan, Zhengxue Wang, Xiang Li, Le Hui, Jian Yang

分类: cs.CV

发布日期: 2024-09-12 (更新: 2025-03-04)

🔗 代码/项目: GITHUB

💡 一句话要点

提出深度高度解耦(DHD)框架,提升视觉3D Occupancy预测精度

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D Occupancy预测 深度学习 高度解耦 视图转换 自动驾驶

📋 核心要点

- 现有基于视觉的3D Occupancy预测方法在2D到3D转换时,容易引入来自不同高度范围的混淆特征,影响预测精度。

- DHD框架通过显式高度先验,利用掩码引导高度采样(MGHS)将特征解耦到不同高度子空间,减少混淆。

- DHD在Occ3D-nuScenes数据集上取得了state-of-the-art的性能,验证了其有效性,即使在少量输入帧的情况下。

📝 摘要(中文)

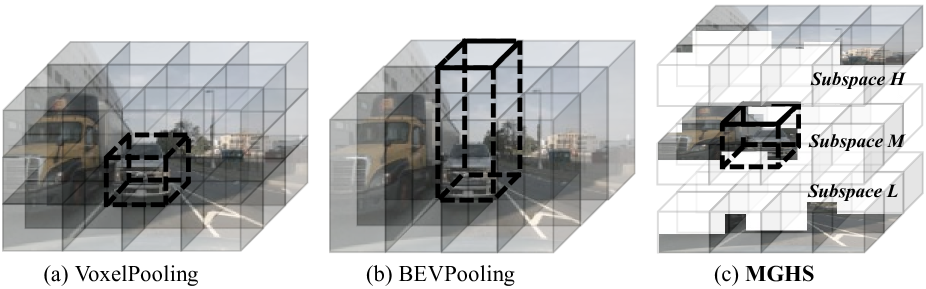

基于视觉的3D Occupancy预测旨在从2D彩色图像重建3D几何结构并估计其语义类别,其中2D到3D的视图转换是不可或缺的一步。现有方法大多采用前向投影,如BEVPooling和VoxelPooling,将2D图像特征映射到3D网格中。然而,当前网格表示的特征通常包含来自其他高度范围的混淆特征。为了解决这个问题,我们提出了一种新颖的框架——深度高度解耦(DHD),它结合了显式的高度先验来过滤掉这些混淆特征。具体来说,DHD首先通过显式监督预测高度图。基于高度分布统计,DHD设计了掩码引导高度采样(MGHS)来自适应地将高度图解耦为多个二元掩码。MGHS将2D图像特征投影到多个子空间,其中每个网格包含合理高度范围内的特征。最后,部署协同特征聚合(SFA)模块,通过通道和空间亲和性来增强特征表示,从而进一步细化Occupancy。在流行的Occ3D-nuScenes基准测试中,即使使用最少的输入帧,我们的方法也实现了最先进的性能。

🔬 方法详解

问题定义:基于视觉的3D Occupancy预测旨在从2D图像推断3D空间中每个体素是否被占据以及其语义类别。现有方法,如BEVPooling和VoxelPooling,直接将2D图像特征投影到3D体素网格中,但忽略了高度信息,导致一个体素内混合了来自不同高度的特征,造成混淆,降低了预测精度。

核心思路:DHD的核心思路是利用显式的高度先验知识来解耦不同高度的特征。通过预测高度图,并基于高度分布统计,自适应地将特征分解到多个高度子空间中,从而减少特征混淆。这种解耦的思想使得每个体素内的特征更具有代表性,从而提高Occupancy预测的准确性。

技术框架:DHD框架主要包含三个阶段:1) 高度图预测:通过显式监督学习预测场景的高度图。2) 掩码引导高度采样(MGHS):基于高度图的统计信息,生成多个二元掩码,将2D图像特征投影到不同的高度子空间。3) 协同特征聚合(SFA):利用通道和空间注意力机制,聚合不同高度子空间的特征,增强特征表示,最终进行Occupancy预测。

关键创新:DHD的关键创新在于引入了显式的高度解耦机制。与以往直接将2D特征投影到3D网格的方法不同,DHD首先预测高度图,然后利用高度信息将特征解耦到不同的高度子空间。这种解耦操作能够有效地减少特征混淆,提高Occupancy预测的精度。

关键设计:MGHS模块是DHD的关键设计之一,它根据高度图的分布自适应地生成二元掩码,从而将特征投影到不同的高度子空间。SFA模块则利用通道和空间注意力机制,增强特征表示。具体的损失函数包括高度图预测的损失函数和Occupancy预测的损失函数。网络结构方面,DHD可以灵活地与现有的backbone网络结合。

🖼️ 关键图片

📊 实验亮点

DHD在Occ3D-nuScenes基准测试中取得了state-of-the-art的性能,证明了其有效性。即使在只使用少量输入帧的情况下,DHD仍然能够取得优异的性能,表明其具有很强的鲁棒性。与现有方法相比,DHD能够更精确地预测3D Occupancy,从而提高自动驾驶等应用的安全性和可靠性。

🎯 应用场景

该研究成果可应用于自动驾驶、机器人导航、三维场景重建等领域。通过更精确的3D Occupancy预测,可以帮助自动驾驶系统更好地理解周围环境,提高行驶安全性。在机器人导航中,可以帮助机器人更好地感知周围环境,规划更合理的路径。在三维场景重建中,可以生成更精确的三维模型。

📄 摘要(原文)

The task of vision-based 3D occupancy prediction aims to reconstruct 3D geometry and estimate its semantic classes from 2D color images, where the 2D-to-3D view transformation is an indispensable step. Most previous methods conduct forward projection, such as BEVPooling and VoxelPooling, both of which map the 2D image features into 3D grids. However, the current grid representing features within a certain height range usually introduces many confusing features that belong to other height ranges. To address this challenge, we present Deep Height Decoupling (DHD), a novel framework that incorporates explicit height prior to filter out the confusing features. Specifically, DHD first predicts height maps via explicit supervision. Based on the height distribution statistics, DHD designs Mask Guided Height Sampling (MGHS) to adaptively decouple the height map into multiple binary masks. MGHS projects the 2D image features into multiple subspaces, where each grid contains features within reasonable height ranges. Finally, a Synergistic Feature Aggregation (SFA) module is deployed to enhance the feature representation through channel and spatial affinities, enabling further occupancy refinement. On the popular Occ3D-nuScenes benchmark, our method achieves state-of-the-art performance even with minimal input frames. Source code is released at https://github.com/yanzq95/DHD.