FIReStereo: Forest InfraRed Stereo Dataset for UAS Depth Perception in Visually Degraded Environments

作者: Devansh Dhrafani, Yifei Liu, Andrew Jong, Ukcheol Shin, Yao He, Tyler Harp, Yaoyu Hu, Jean Oh, Sebastian Scherer

分类: cs.CV, cs.AI, cs.RO

发布日期: 2024-09-12

备注: Under review in RA-L. The first 2 authors contributed equally

💡 一句话要点

FIReStereo:用于视觉退化环境中无人机深度感知的森林红外立体数据集

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 热成像 立体视觉 深度估计 无人机 数据集 视觉退化 恶劣环境

📋 核心要点

- 现有方法在视觉退化环境中深度感知能力不足,限制了无人机在复杂环境下的应用。

- 论文提出使用热成像相机进行立体深度估计,构建大规模数据集,并验证其在恶劣环境下的鲁棒性。

- 实验表明,基于该数据集训练的模型在烟雾等恶劣条件下具有良好的泛化能力,提升了深度感知性能。

📝 摘要(中文)

在视觉退化环境中实现鲁棒的深度感知对于自主飞行系统至关重要。热成像相机能够捕捉红外辐射,对视觉退化具有鲁棒性。然而,由于缺乏大规模数据集,热像相机在无人机(UAS)深度感知中的应用在很大程度上仍未被探索。本文提出了一个用于自主空中感知应用的热立体深度感知数据集。该数据集包含在城市和森林环境中,在白天、夜晚、雨天和烟雾等不同条件下捕获的立体热图像、激光雷达、IMU和地面真实深度图。我们对具有代表性的立体深度估计算法进行了基准测试,深入了解了它们在退化条件下的性能。在我们数据集上训练的模型能够很好地泛化到未见过的烟雾条件,突出了立体热成像在深度感知方面的鲁棒性。我们的目标是利用这项工作来增强灾难场景中的机器人感知能力,从而能够在以前无法到达的区域进行探索和操作。数据集和源代码可在https://firestereo.github.io上获取。

🔬 方法详解

问题定义:论文旨在解决视觉退化环境中无人机深度感知的问题。现有方法在烟雾、雨天、夜晚等恶劣条件下,由于可见光图像质量下降,深度估计精度显著降低,甚至失效。缺乏大规模的、包含多种恶劣环境的热成像立体数据集,阻碍了基于热成像的深度感知技术的发展。

核心思路:论文的核心思路是利用热成像相机对红外辐射的敏感性,克服视觉退化带来的影响。热成像相机能够在烟雾、黑暗等环境中捕捉到清晰的图像,从而为立体深度估计提供可靠的输入。通过构建大规模的、包含多种恶劣环境的热成像立体数据集,可以训练出鲁棒的深度估计模型。

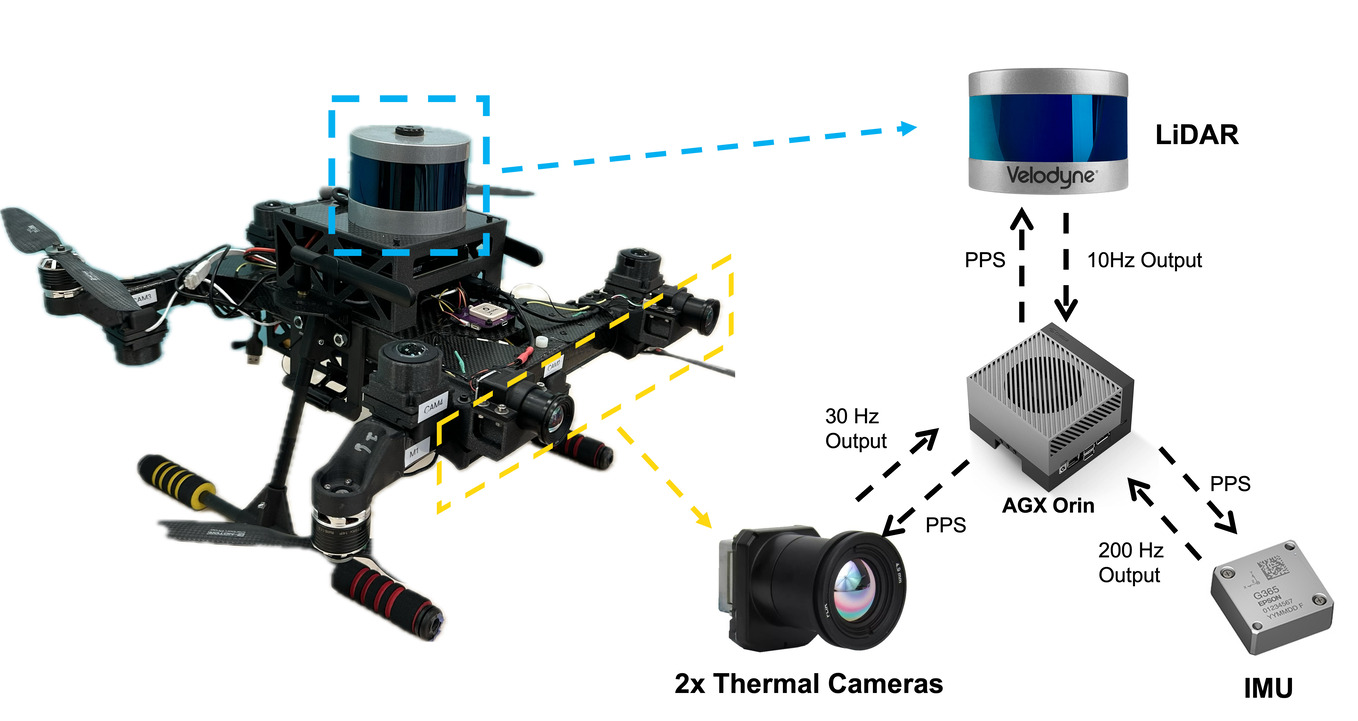

技术框架:该研究的技术框架主要包括以下几个部分:1) 数据采集:使用配备热成像相机的无人机,在城市和森林环境中,采集包含白天、夜晚、雨天和烟雾等多种条件下的立体热图像、激光雷达数据、IMU数据和地面真实深度图。2) 数据处理:对采集到的数据进行校准、同步和配准,生成高质量的立体热图像对和地面真实深度图。3) 模型训练:使用深度学习方法,基于该数据集训练立体深度估计模型。4) 性能评估:在不同的恶劣环境下,对训练好的模型进行性能评估,并与其他方法进行比较。

关键创新:论文的关键创新在于构建了一个大规模的、包含多种恶劣环境的热成像立体数据集(FIReStereo)。该数据集的发布填补了该领域的空白,为研究基于热成像的深度感知技术提供了重要的数据支持。此外,论文还对现有的立体深度估计算法进行了基准测试,并分析了它们在恶劣环境下的性能。

关键设计:数据集包含立体热图像,激光雷达数据,IMU数据和地面真实深度图。数据采集在城市和森林环境中进行,涵盖白天、夜晚、雨天和烟雾等多种条件。论文使用现有的立体匹配算法作为基线,并评估其在数据集上的性能。具体的参数设置、损失函数和网络结构等细节在论文中没有详细描述,属于算法本身的范畴。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在FIReStereo数据集上训练的立体深度估计模型在烟雾等恶劣条件下具有良好的泛化能力。与在可见光图像上训练的模型相比,基于热成像的模型在烟雾环境下的深度估计精度显著提高。该数据集和相关代码的开源将促进基于热成像的深度感知技术的发展。

🎯 应用场景

该研究成果可应用于灾难救援、森林防火、夜间巡逻、自动驾驶等领域。在灾难救援中,无人机可以利用热成像相机在烟雾弥漫的环境中搜索幸存者。在森林防火中,可以利用热成像相机检测火源。在夜间巡逻中,可以利用热成像相机进行目标检测和跟踪。在自动驾驶中,可以利用热成像相机提高在恶劣天气条件下的感知能力。

📄 摘要(原文)

Robust depth perception in visually-degraded environments is crucial for autonomous aerial systems. Thermal imaging cameras, which capture infrared radiation, are robust to visual degradation. However, due to lack of a large-scale dataset, the use of thermal cameras for unmanned aerial system (UAS) depth perception has remained largely unexplored. This paper presents a stereo thermal depth perception dataset for autonomous aerial perception applications. The dataset consists of stereo thermal images, LiDAR, IMU and ground truth depth maps captured in urban and forest settings under diverse conditions like day, night, rain, and smoke. We benchmark representative stereo depth estimation algorithms, offering insights into their performance in degraded conditions. Models trained on our dataset generalize well to unseen smoky conditions, highlighting the robustness of stereo thermal imaging for depth perception. We aim for this work to enhance robotic perception in disaster scenarios, allowing for exploration and operations in previously unreachable areas. The dataset and source code are available at https://firestereo.github.io.