Loss Distillation via Gradient Matching for Point Cloud Completion with Weighted Chamfer Distance

作者: Fangzhou Lin, Haotian Liu, Haoying Zhou, Songlin Hou, Kazunori D Yamada, Gregory S. Fischer, Yanhua Li, Haichong K. Zhang, Ziming Zhang

分类: cs.CV, cs.LG, cs.RO

发布日期: 2024-09-10

备注: 10 pages, 7 figures, 7 tables, this paper was accepted to IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS) 2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于梯度匹配的损失蒸馏方法,用于点云补全,并使用加权倒角距离。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 点云补全 损失蒸馏 梯度匹配 倒角距离 加权损失

📋 核心要点

- 现有基于倒角距离(CD)的点云补全损失函数需要针对不同数据进行参数调优,耗时且效率低。

- 论文提出一种基于梯度匹配的损失蒸馏方法,通过模仿HyperCD的学习行为来搜索最优的加权CD损失函数。

- 实验表明,Landau加权CD损失函数在点云补全任务上超越了HyperCD,并在多个基准数据集上取得了新的SOTA结果。

📝 摘要(中文)

三维点云增强了机器人感知环境几何信息的能力,使其能够执行抓取姿态检测和场景理解等下游任务。然而,这些任务的性能严重依赖于数据输入的质量,不完整的数据可能导致不良结果和失败案例。最近为基于深度学习的点云补全设计的训练损失函数,如倒角距离(CD)及其变体(例如HyperCD),表明良好的梯度加权方案可以显著提高性能。然而,这些基于CD的损失函数通常需要与数据相关的参数调整,这对于数据密集型任务来说可能非常耗时。为了解决这个问题,我们旨在找到一类不需要参数调整的加权训练损失(加权CD)。为此,我们提出了一种搜索方案,通过梯度匹配进行损失蒸馏,通过模仿HyperCD和加权CD之间反向传播中的学习行为来找到良好的候选损失函数。完成此操作后,我们提出了一种新颖的双层优化公式,用于基于加权CD损失训练骨干网络。我们观察到:(1)通过适当的加权函数,加权CD始终可以达到与HyperCD相似的性能,并且(2)Landau加权CD,即Landau CD,可以优于HyperCD进行点云补全,并在多个基准数据集上带来新的最先进的结果。

🔬 方法详解

问题定义:论文旨在解决点云补全任务中,基于倒角距离(CD)的损失函数需要手动调整参数的问题。现有方法如HyperCD虽然性能良好,但其参数调整过程耗时,限制了其在数据量大的任务中的应用。因此,需要一种自动化的损失函数搜索方法,能够自适应地学习到合适的权重,从而避免手动调参的繁琐过程。

核心思路:论文的核心思路是通过损失蒸馏,将性能优异但需要调参的HyperCD损失函数的梯度信息迁移到一族加权CD损失函数上。具体来说,就是找到一组加权函数,使得加权CD损失函数在反向传播过程中产生的梯度与HyperCD损失函数的梯度尽可能匹配。这样,加权CD损失函数就可以在不需要手动调参的情况下,获得与HyperCD相似甚至更好的性能。

技术框架:论文提出的方法主要包含两个阶段:损失蒸馏阶段和网络训练阶段。在损失蒸馏阶段,通过梯度匹配算法,搜索最优的加权函数。具体来说,使用HyperCD作为teacher loss,加权CD作为student loss,通过最小化两者梯度之间的差异来学习加权函数。在网络训练阶段,使用学习到的加权CD损失函数来训练点云补全网络。论文采用双层优化策略,外层优化网络参数,内层优化加权函数。

关键创新:论文的关键创新在于提出了一种基于梯度匹配的损失蒸馏方法,用于自动搜索点云补全任务的损失函数。该方法避免了手动调参的繁琐过程,并且能够学习到性能优异的加权CD损失函数。此外,论文还发现了一种名为Landau CD的加权CD损失函数,其性能超越了现有的HyperCD损失函数。

关键设计:论文的关键设计包括:1) 使用梯度匹配作为损失蒸馏的准则,通过最小化teacher loss和student loss的梯度差异来学习加权函数;2) 采用双层优化策略,交替优化网络参数和加权函数;3) 发现了一种名为Landau CD的加权CD损失函数,其权重与点云的曲率相关,能够更好地捕捉点云的几何信息。

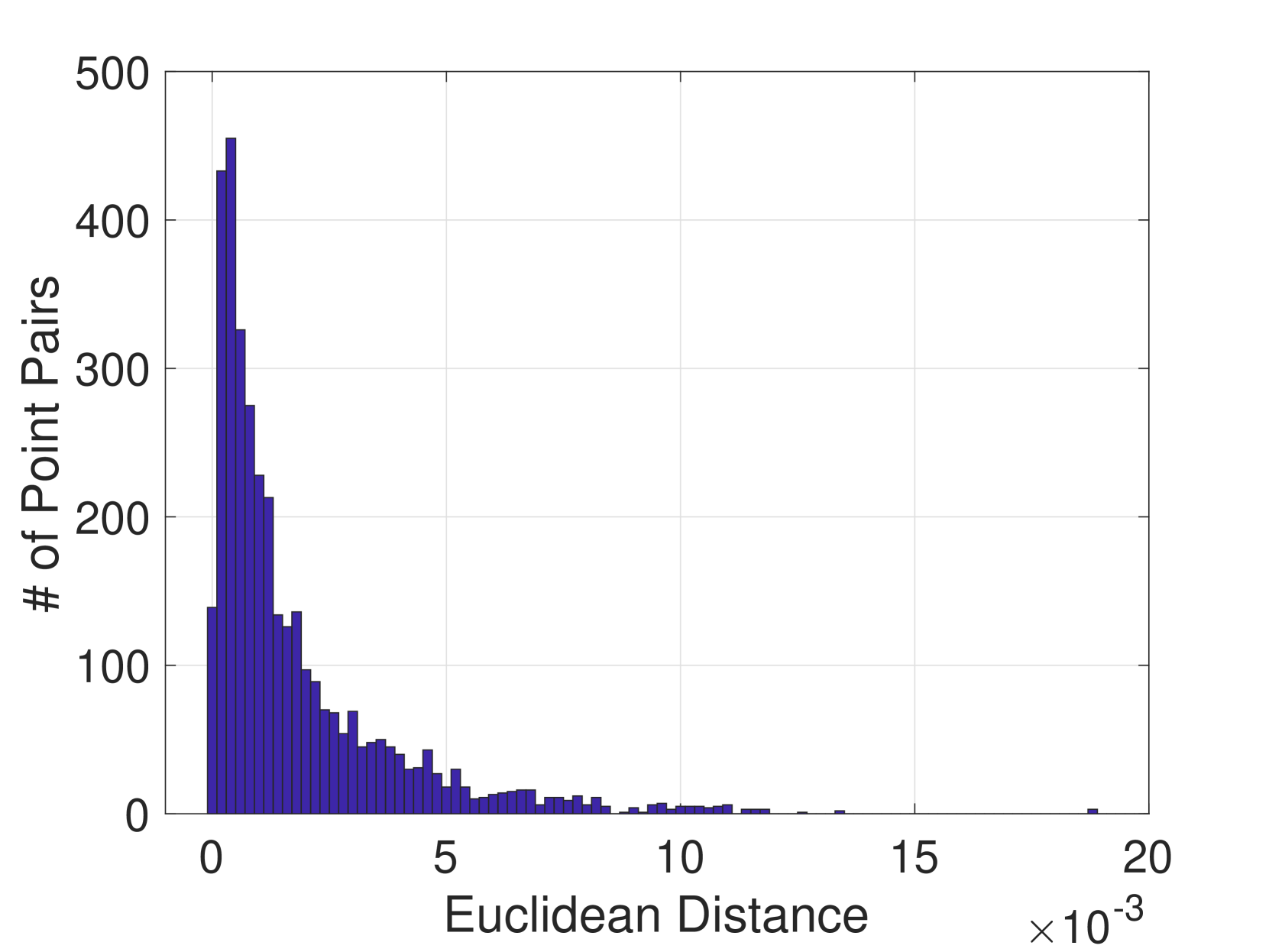

🖼️ 关键图片

📊 实验亮点

实验结果表明,论文提出的Landau CD损失函数在点云补全任务上取得了新的SOTA结果。具体来说,在ShapeNet数据集上,Landau CD的F1-score指标优于HyperCD,并且在其他基准数据集上也取得了显著的性能提升。此外,实验还验证了梯度匹配损失蒸馏方法的有效性,证明了通过模仿HyperCD的梯度信息可以学习到性能优异的加权CD损失函数。

🎯 应用场景

该研究成果可广泛应用于机器人、自动驾驶、三维重建等领域。高质量的点云补全能够提升机器人对环境的感知能力,从而提高抓取、导航等任务的性能。此外,该方法还可以应用于其他需要点云数据作为输入的任务,例如场景理解、物体识别等。自动化的损失函数搜索方法也具有一定的通用性,可以推广到其他深度学习任务中。

📄 摘要(原文)

3D point clouds enhanced the robot's ability to perceive the geometrical information of the environments, making it possible for many downstream tasks such as grasp pose detection and scene understanding. The performance of these tasks, though, heavily relies on the quality of data input, as incomplete can lead to poor results and failure cases. Recent training loss functions designed for deep learning-based point cloud completion, such as Chamfer distance (CD) and its variants (\eg HyperCD ), imply a good gradient weighting scheme can significantly boost performance. However, these CD-based loss functions usually require data-related parameter tuning, which can be time-consuming for data-extensive tasks. To address this issue, we aim to find a family of weighted training losses ({\em weighted CD}) that requires no parameter tuning. To this end, we propose a search scheme, {\em Loss Distillation via Gradient Matching}, to find good candidate loss functions by mimicking the learning behavior in backpropagation between HyperCD and weighted CD. Once this is done, we propose a novel bilevel optimization formula to train the backbone network based on the weighted CD loss. We observe that: (1) with proper weighted functions, the weighted CD can always achieve similar performance to HyperCD, and (2) the Landau weighted CD, namely {\em Landau CD}, can outperform HyperCD for point cloud completion and lead to new state-of-the-art results on several benchmark datasets. {\it Our demo code is available at \url{https://github.com/Zhang-VISLab/IROS2024-LossDistillationWeightedCD}.}