UniDet3D: Multi-dataset Indoor 3D Object Detection

作者: Maksim Kolodiazhnyi, Anna Vorontsova, Matvey Skripkin, Danila Rukhovich, Anton Konushin

分类: cs.CV

发布日期: 2024-09-06

🔗 代码/项目: GITHUB

💡 一句话要点

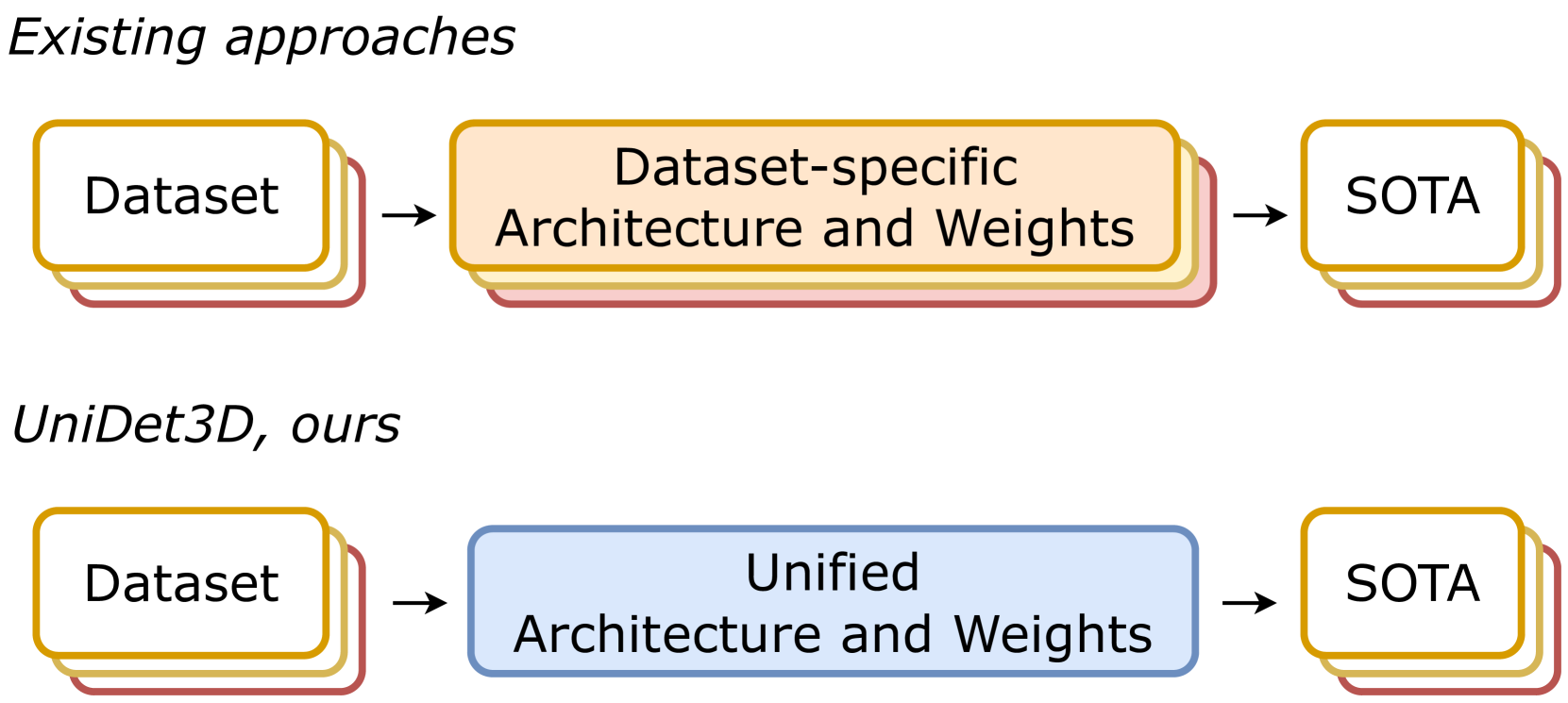

UniDet3D:提出一种多数据集联合训练的室内3D目标检测框架。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D目标检测 点云 多数据集学习 Transformer 室内场景理解

📋 核心要点

- 现有的室内3D目标检测数据集规模较小且多样性不足,难以训练出泛化能力强的模型。

- UniDet3D通过统一不同数据集的标签空间,实现多数据集的联合监督训练,从而学习更鲁棒的特征表示。

- UniDet3D基于Transformer编码器构建,易于定制和扩展,并在多个数据集上取得了显著的性能提升。

📝 摘要(中文)

本文提出UniDet3D,一个简单而有效的3D目标检测模型,该模型通过混合室内数据集进行训练,并能够在各种室内环境中工作。通过统一不同的标签空间,UniDet3D能够通过监督联合训练方案学习跨多个数据集的强大表示。所提出的网络架构建立在vanilla Transformer编码器之上,使其易于运行、定制和扩展预测流程以供实际使用。大量实验表明,UniDet3D在6个室内基准测试中获得了相对于现有3D目标检测方法的显著提升:ScanNet (+1.1 mAP50), ARKitScenes (+19.4 mAP25), S3DIS (+9.1 mAP50), MultiScan (+9.3 mAP50), 3RScan (+3.2 mAP50), 和 ScanNet++ (+2.7 mAP50)。

🔬 方法详解

问题定义:现有的室内3D目标检测模型通常在单个数据集上训练,泛化能力有限。不同数据集之间存在标签空间不一致的问题,阻碍了多数据集联合训练。因此,如何利用多个室内数据集训练一个通用的、高性能的3D目标检测模型是一个挑战。

核心思路:UniDet3D的核心思路是通过统一不同数据集的标签空间,将多个数据集转换为统一的格式,从而实现多数据集的联合训练。通过联合训练,模型可以学习到更鲁棒、更通用的特征表示,从而提高在不同室内环境下的检测性能。

技术框架:UniDet3D的整体架构基于一个vanilla Transformer编码器。输入是点云数据,经过预处理后输入到Transformer编码器中进行特征提取。编码器的输出经过一系列的预测头,用于预测目标物体的类别、位置和大小等信息。整个框架采用端到端的训练方式。

关键创新:UniDet3D的关键创新在于标签空间的统一和多数据集联合训练策略。通过设计一个统一的标签空间,可以将不同数据集的标签映射到同一个空间中,从而实现多数据集的联合训练。这种方法可以有效地利用多个数据集的信息,提高模型的泛化能力。

关键设计:UniDet3D使用vanilla Transformer作为主干网络,没有引入复杂的定制化模块,保证了模型的简洁性和可扩展性。损失函数包括分类损失和回归损失,用于优化目标物体的类别和位置。具体的参数设置和训练细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

UniDet3D在6个室内3D目标检测基准测试中取得了显著的性能提升。具体来说,在ScanNet上提升了1.1 mAP50,在ARKitScenes上提升了19.4 mAP25,在S3DIS上提升了9.1 mAP50,在MultiScan上提升了9.3 mAP50,在3RScan上提升了3.2 mAP50,在ScanNet++上提升了2.7 mAP50。这些结果表明UniDet3D具有很强的泛化能力。

🎯 应用场景

UniDet3D在机器人、增强现实等领域具有广泛的应用前景。例如,它可以用于机器人导航,帮助机器人在室内环境中识别和定位物体;也可以用于增强现实应用,将虚拟物体与真实场景进行融合。该研究有助于推动智能家居、智能办公等领域的发展。

📄 摘要(原文)

Growing customer demand for smart solutions in robotics and augmented reality has attracted considerable attention to 3D object detection from point clouds. Yet, existing indoor datasets taken individually are too small and insufficiently diverse to train a powerful and general 3D object detection model. In the meantime, more general approaches utilizing foundation models are still inferior in quality to those based on supervised training for a specific task. In this work, we propose \ours{}, a simple yet effective 3D object detection model, which is trained on a mixture of indoor datasets and is capable of working in various indoor environments. By unifying different label spaces, \ours{} enables learning a strong representation across multiple datasets through a supervised joint training scheme. The proposed network architecture is built upon a vanilla transformer encoder, making it easy to run, customize and extend the prediction pipeline for practical use. Extensive experiments demonstrate that \ours{} obtains significant gains over existing 3D object detection methods in 6 indoor benchmarks: ScanNet (+1.1 mAP50), ARKitScenes (+19.4 mAP25), S3DIS (+9.1 mAP50), MultiScan (+9.3 mAP50), 3RScan (+3.2 mAP50), and ScanNet++ (+2.7 mAP50). Code is available at https://github.com/filapro/unidet3d .