MultiCounter: Multiple Action Agnostic Repetition Counting in Untrimmed Videos

作者: Yin Tang, Wei Luo, Jinrui Zhang, Wei Huang, Ruihai Jing, Deyu Zhang

分类: cs.CV

发布日期: 2024-09-06

备注: Accepted by ECAI 2024

💡 一句话要点

提出MultiCounter,用于在无分割视频中进行与动作无关的多目标重复计数。

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 多目标跟踪 重复动作计数 时空建模 深度学习 端到端学习

📋 核心要点

- 现有多目标重复动作计数方法难以同时处理检测、跟踪和计数,且缺乏对时序上下文的有效建模。

- MultiCounter通过混合时空交互模块和任务特定头部,实现端到端的多目标重复动作检测、跟踪和计数。

- 在MultiRep数据集上,MultiCounter显著优于现有方法,Period-mAP提升41.0%,AvgMAE降低58.6%。

📝 摘要(中文)

本文提出MultiCounter,一个完全端到端的深度学习框架,用于估计未分割视频中多个目标执行的重复动作次数,该场景常见于以人为中心的领域,如体育和锻炼。MultiCounter包含两个创新模块:1) 混合时空交互,用于有效关联连续帧之间的上下文;2) 任务特定的头部,用于精确感知周期性边界,并泛化到与动作无关的目标。论文使用从带标注的真实视频生成的合成数据集MultiRep训练MultiCounter。在MultiRep数据集上的实验验证了MRAC任务的根本挑战,并展示了所提出模型的优越性。与ByteTrack+RepNet(一种将先进跟踪器与单个重复计数器相结合的解决方案)相比,MultiCounter显著提高了Period-mAP 41.0%,降低了AvgMAE 58.6%,并提高了AvgOBO 1.48倍。这为MRAC领域树立了新的基准。此外,MultiCounter可以在商用GPU服务器上实时运行,并且对视频中目标的数量不敏感。

🔬 方法详解

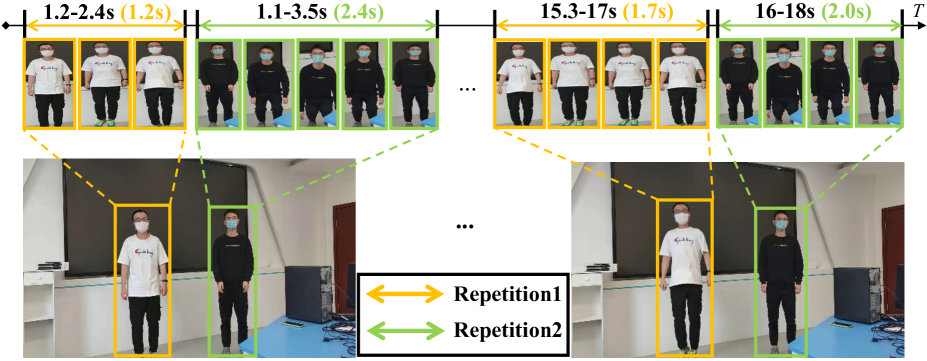

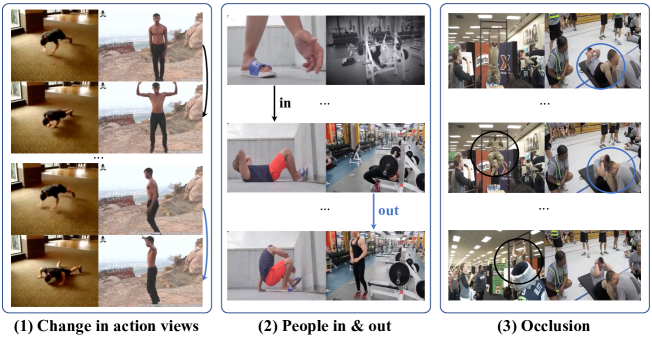

问题定义:论文旨在解决多目标重复动作计数(MRAC)问题,即在未分割的视频中,准确估计多个目标重复执行某个动作的次数。现有方法通常依赖于两阶段策略,先进行目标检测和跟踪,再进行重复计数,这种方式难以进行端到端优化,且容易受到跟踪误差的影响。此外,现有方法缺乏对时序上下文的有效建模,难以准确识别动作的周期性边界。

核心思路:MultiCounter的核心思路是设计一个端到端的深度学习框架,同时进行目标检测、跟踪和重复计数。通过混合时空交互模块,模型可以有效地关联连续帧之间的上下文信息,从而提高跟踪的准确性和鲁棒性。任务特定的头部则用于精确感知动作的周期性边界,并泛化到不同的动作类型。

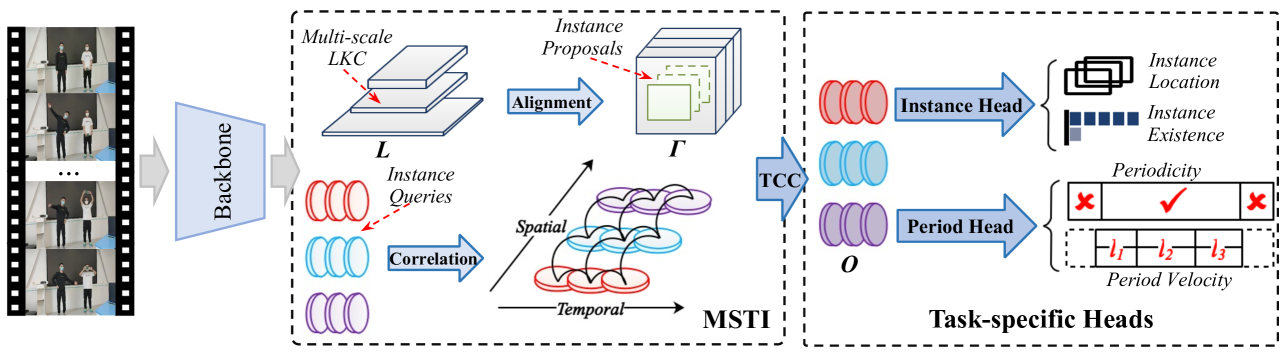

技术框架:MultiCounter的整体架构包含以下几个主要模块:1) 视频帧输入;2) 特征提取网络(backbone);3) 混合时空交互模块;4) 目标检测头;5) 目标跟踪头;6) 重复计数头。视频帧首先通过特征提取网络提取特征,然后通过混合时空交互模块进行时空上下文建模。目标检测头用于检测视频中的目标,目标跟踪头用于跟踪目标的运动轨迹,重复计数头则用于估计每个目标重复执行动作的次数。

关键创新:MultiCounter最重要的技术创新点在于混合时空交互模块和任务特定的头部设计。混合时空交互模块通过混合空间和时间上的注意力机制,有效地关联连续帧之间的上下文信息,从而提高跟踪的准确性和鲁棒性。任务特定的头部则针对重复计数任务进行了优化,可以更准确地感知动作的周期性边界,并泛化到不同的动作类型。与现有方法相比,MultiCounter实现了端到端的优化,避免了中间步骤的误差累积,并提高了整体性能。

关键设计:混合时空交互模块采用了Transformer结构,通过自注意力机制学习时空上下文信息。目标检测头和目标跟踪头采用了标准的检测和跟踪算法。重复计数头则采用了时间卷积网络(TCN),用于学习动作的周期性模式。损失函数包括目标检测损失、跟踪损失和计数损失,通过联合优化这些损失函数,可以提高模型的整体性能。

🖼️ 关键图片

📊 实验亮点

MultiCounter在MultiRep数据集上取得了显著的性能提升。与ByteTrack+RepNet相比,MultiCounter的Period-mAP提高了41.0%,AvgMAE降低了58.6%,AvgOBO提高了1.48倍。这些结果表明,MultiCounter在多目标重复动作计数任务上具有明显的优势。此外,MultiCounter可以在商用GPU服务器上实时运行,并且对视频中目标的数量不敏感,这使其具有很强的实用性。

🎯 应用场景

MultiCounter在体育分析、健身指导、康复训练等领域具有广泛的应用前景。例如,可以用于自动统计运动员的训练次数,评估健身动作的规范性,监测患者的康复进度等。该研究的实际价值在于提高了重复动作计数的准确性和效率,为相关领域的智能化应用提供了技术支持。未来,可以将MultiCounter扩展到更复杂的场景,例如多人交互、复杂动作等。

📄 摘要(原文)

Multi-instance Repetitive Action Counting (MRAC) aims to estimate the number of repetitive actions performed by multiple instances in untrimmed videos, commonly found in human-centric domains like sports and exercise. In this paper, we propose MultiCounter, a fully end-to-end deep learning framework that enables simultaneous detection, tracking, and counting of repetitive actions of multiple human instances. Specifically, MultiCounter incorporates two novel modules: 1) mixed spatiotemporal interaction for efficient context correlation across consecutive frames, and 2) task-specific heads for accurate perception of periodic boundaries and generalization for action-agnostic human instances. We train MultiCounter on a synthetic dataset called MultiRep generated from annotated real-world videos. Experiments on the MultiRep dataset validate the fundamental challenge of MRAC tasks and showcase the superiority of our proposed model. Compared to ByteTrack+RepNet, a solution that combines an advanced tracker with a single repetition counter, MultiCounter substantially improves Period-mAP by 41.0%, reduces AvgMAE by 58.6%, and increases AvgOBO 1.48 times. This sets a new benchmark in the field of MRAC. Moreover, MultiCounter runs in real-time on a commodity GPU server and is insensitive to the number of human instances in a video.