Foundation Model or Finetune? Evaluation of few-shot semantic segmentation for river pollution

作者: Marga Don, Stijn Pinson, Blanca Guillen Cebrian, Yuki M. Asano

分类: cs.CV

发布日期: 2024-09-05

备注: Accepted at ECCV 2024 Green Foundation Models workshop

💡 一句话要点

针对河流污染语义分割,研究表明微调模型优于Foundation Model

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语义分割 Foundation Model 微调 河流污染 遥感图像

📋 核心要点

- 现有方法难以在数据稀缺的专业领域(如河流污染监测)实现有效的语义分割。

- 论文核心思想是比较Foundation Model和微调预训练模型在河流污染语义分割任务上的性能。

- 实验结果表明,即使在数据稀缺的情况下,微调的预训练模型始终优于Foundation Model。

📝 摘要(中文)

Foundation Model (FM) 是当前人工智能领域的研究热点。它们无需重新训练或大量数据,即可泛化到新任务和数据集的能力,使其成为专业数据集应用的理想选择。本文比较了 FM 与微调的预训练监督模型在全新数据集上进行语义分割任务的性能。结果表明,即使在数据稀缺的情况下,微调模型始终优于所测试的 FM。本文已在 GitHub 上发布代码和数据集。

🔬 方法详解

问题定义:论文旨在解决河流污染场景下的语义分割问题。现有方法,特别是直接应用Foundation Model,在缺乏针对性训练数据的情况下,难以达到理想的分割精度。痛点在于Foundation Model的泛化能力在专业领域数据集上表现不足,无法直接应用。

核心思路:论文的核心思路是通过比较Foundation Model和微调的预训练模型,来验证在数据受限的河流污染语义分割任务中,哪种方法更有效。核心在于探索微调是否能弥补Foundation Model在专业领域的不足。

技术框架:论文的技术框架主要包括以下几个步骤:1) 构建河流污染语义分割数据集;2) 选择合适的Foundation Model和预训练模型;3) 对预训练模型进行微调;4) 在测试集上评估Foundation Model和微调模型的性能;5) 对比分析实验结果。

关键创新:论文的关键创新在于针对河流污染这一特定应用场景,系统性地比较了Foundation Model和微调预训练模型的性能。以往研究可能更多关注通用场景,而本文聚焦于专业领域,并揭示了微调在数据受限情况下的优势。

关键设计:论文的关键设计包括:1) 数据集的构建,需要保证数据的质量和多样性;2) 预训练模型的选择,需要考虑模型的适用性和性能;3) 微调策略的设计,包括学习率、优化器、损失函数等参数的设置,以获得最佳的微调效果。

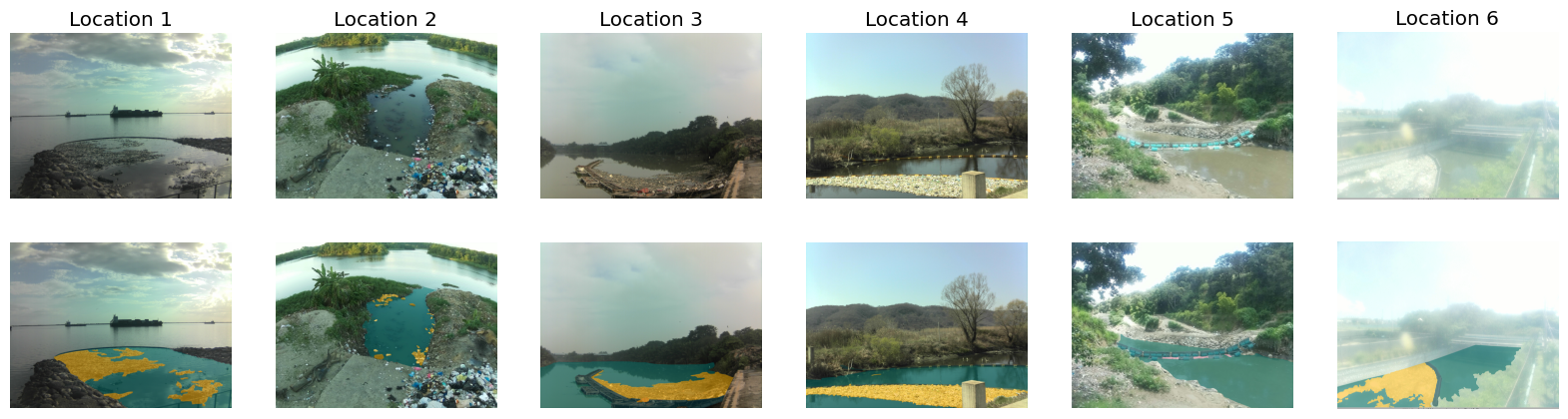

🖼️ 关键图片

📊 实验亮点

实验结果表明,在河流污染语义分割任务中,微调的预训练模型始终优于所测试的Foundation Model,即使在数据稀缺的情况下也是如此。这表明,对于特定领域的专业数据集,微调仍然是一种更有效的策略,能够充分利用有限的数据提升模型性能。

🎯 应用场景

该研究成果可应用于河流污染监测、水质评估和环境保护等领域。通过更精确的语义分割,可以有效识别和定位污染源,为治理提供数据支持。未来,该方法可以扩展到其他专业领域的图像分析任务,例如医学影像诊断、遥感图像分析等,具有广泛的应用前景。

📄 摘要(原文)

Foundation models (FMs) are a popular topic of research in AI. Their ability to generalize to new tasks and datasets without retraining or needing an abundance of data makes them an appealing candidate for applications on specialist datasets. In this work, we compare the performance of FMs to finetuned pre-trained supervised models in the task of semantic segmentation on an entirely new dataset. We see that finetuned models consistently outperform the FMs tested, even in cases were data is scarce. We release the code and dataset for this work on GitHub.