Volumetric Surfaces: Representing Fuzzy Geometries with Layered Meshes

作者: Stefano Esposito, Anpei Chen, Christian Reiser, Samuel Rota Bulò, Lorenzo Porzi, Katja Schwarz, Christian Richardt, Michael Zollhöfer, Peter Kontschieder, Andreas Geiger

分类: cs.CV, cs.GR, cs.LG

发布日期: 2024-09-04 (更新: 2025-03-27)

💡 一句话要点

提出基于多层网格的体表面表示方法,实现毛发等模糊几何体的实时高质量渲染。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 体渲染 表面渲染 多层网格 模糊几何体 实时渲染

📋 核心要点

- 传统表面渲染难以准确建模毛发等模糊几何体,而体渲染和splatting方法存在采样点过多、排序复杂等问题,导致渲染效率低下。

- 论文提出一种基于多层网格的体表面表示方法,将对象表示为半透明多层网格,通过学习SDF壳并烘焙为网格,实现高效的模糊几何体建模。

- 该方法在低功耗设备上实现了实时渲染,避免了传统方法的采样和排序开销,为移动端高质量渲染提供了新的解决方案。

📝 摘要(中文)

高质量的视角合成依赖于体渲染、splatting或表面渲染。表面渲染通常速度最快,但难以准确建模毛发等模糊几何体。Alpha混合技术擅长表示模糊材质,但每个光线需要无限数量的采样点(P1)。体渲染中的空域跳过(P2)和splatting中输入图元的排序(P3)也引入了额外的开销。我们提出了一种用于实时视角合成的新表示方法,其中(P1)采样位置的数量小且有界,(P2)采样位置通过光栅化有效找到,并且(P3)渲染是无排序的。我们通过将对象表示为以固定顺序渲染的半透明多层网格来实现这一点。首先,我们将表面层建模为有符号距离函数(SDF)壳,并在训练期间学习最佳间距。然后,我们将它们烘焙为网格并拟合UV纹理。与单表面方法不同,我们的多层表示有效地建模了模糊对象。与基于体积和splatting的方法相比,我们的方法可以在低功耗笔记本电脑和智能手机上实现实时渲染。

🔬 方法详解

问题定义:现有表面渲染方法难以准确建模毛发等模糊几何体,体渲染和splatting方法虽然可以处理模糊几何体,但存在计算复杂度高、渲染效率低的问题,难以在低功耗设备上实现实时渲染。现有方法的痛点在于需要在渲染质量和渲染效率之间进行权衡。

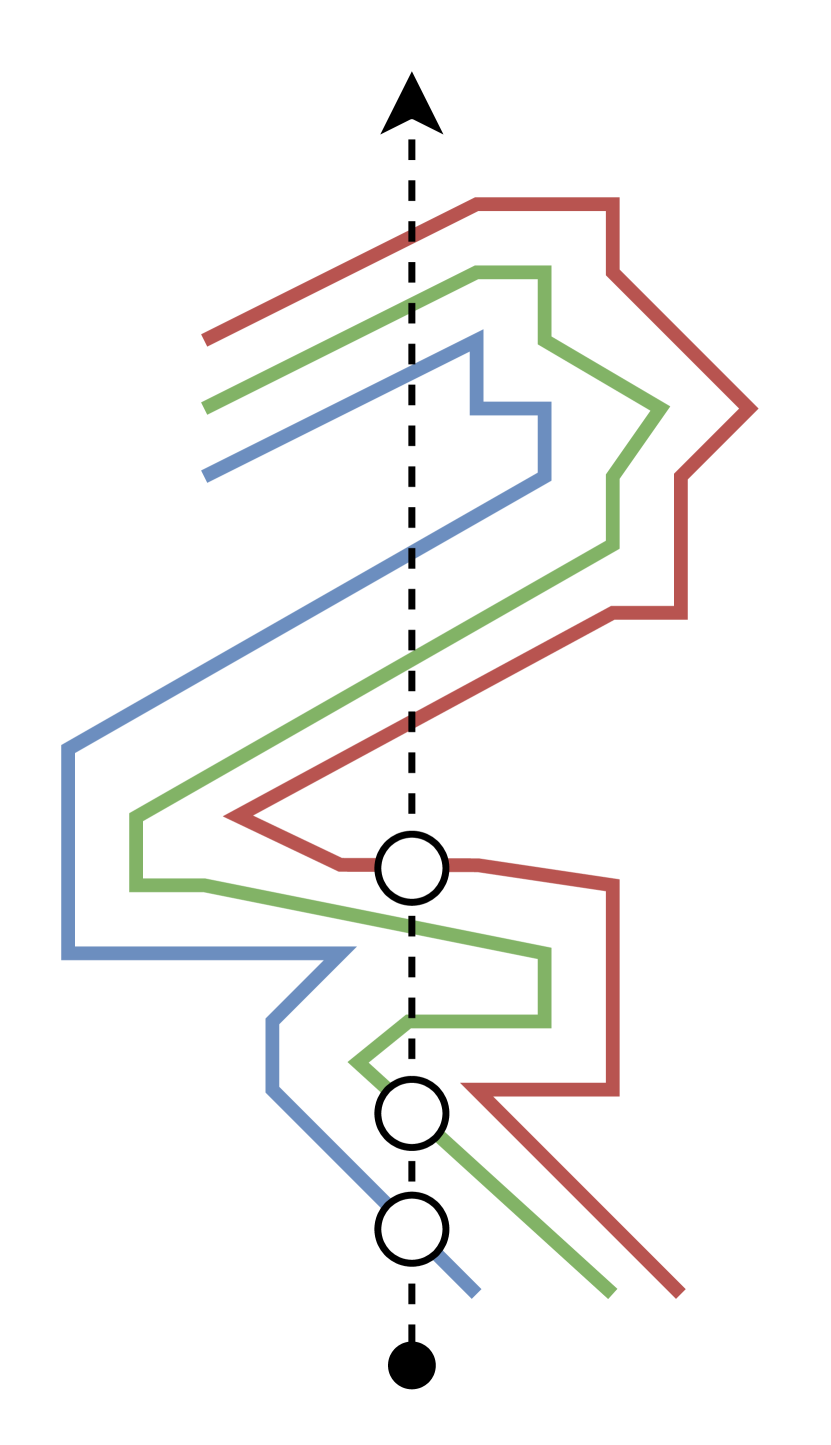

核心思路:论文的核心思路是将对象表示为多层半透明网格,每一层网格代表一个SDF壳。通过学习SDF壳的形状和间距,可以有效地建模模糊几何体。同时,由于网格的数量是有限的,并且可以通过光栅化快速找到采样位置,因此可以实现高效的渲染。这种方法避免了体渲染和splatting方法中大量的采样和排序操作,从而提高了渲染效率。

技术框架:该方法主要包含以下几个阶段:1) 使用SDF表示表面层,并通过训练学习最佳的层间距;2) 将学习到的SDF壳烘焙为网格;3) 为网格拟合UV纹理;4) 以固定顺序渲染多层网格,实现最终的视角合成。整个流程避免了复杂的排序操作,并且可以利用GPU的并行处理能力进行加速。

关键创新:该方法最重要的技术创新点在于使用多层网格来表示模糊几何体。与传统的单表面方法相比,多层网格可以更好地捕捉模糊几何体的细节。与体渲染和splatting方法相比,该方法避免了大量的采样和排序操作,从而提高了渲染效率。此外,通过学习SDF壳的形状和间距,可以有效地控制多层网格的分布,从而优化渲染效果。

关键设计:在训练阶段,使用损失函数来优化SDF壳的形状和间距,以最小化渲染误差。具体的损失函数包括渲染损失、正则化损失等。在渲染阶段,使用alpha混合技术将多层网格的颜色进行混合,以实现最终的渲染效果。网格的数量和层间距是关键的参数,需要根据具体的场景进行调整。

🖼️ 关键图片

📊 实验亮点

论文提出的方法在低功耗笔记本电脑和智能手机上实现了实时渲染,与传统的体渲染和splatting方法相比,渲染效率得到了显著提升。实验结果表明,该方法可以在保证渲染质量的前提下,大幅降低计算复杂度,为移动端高质量渲染提供了新的解决方案。

🎯 应用场景

该研究成果可应用于移动端游戏、AR/VR应用、虚拟形象生成等领域。通过该方法,可以在低功耗设备上实现高质量的毛发、烟雾等模糊几何体的实时渲染,提升用户体验。此外,该方法还可以用于三维重建、场景编辑等应用,为相关领域的研究提供新的思路。

📄 摘要(原文)

High-quality view synthesis relies on volume rendering, splatting, or surface rendering. While surface rendering is typically the fastest, it struggles to accurately model fuzzy geometry like hair. In turn, alpha-blending techniques excel at representing fuzzy materials but require an unbounded number of samples per ray (P1). Further overheads are induced by empty space skipping in volume rendering (P2) and sorting input primitives in splatting (P3). We present a novel representation for real-time view synthesis where the (P1) number of sampling locations is small and bounded, (P2) sampling locations are efficiently found via rasterization, and (P3) rendering is sorting-free. We achieve this by representing objects as semi-transparent multi-layer meshes rendered in a fixed order. First, we model surface layers as signed distance function (SDF) shells with optimal spacing learned during training. Then, we bake them as meshes and fit UV textures. Unlike single-surface methods, our multi-layer representation effectively models fuzzy objects. In contrast to volume and splatting-based methods, our approach enables real-time rendering on low-power laptops and smartphones.