Compositional 3D-aware Video Generation with LLM Director

作者: Hanxin Zhu, Tianyu He, Anni Tang, Junliang Guo, Zhibo Chen, Jiang Bian

分类: cs.CV

发布日期: 2024-08-31

期刊: NeurIPS 2024

💡 一句话要点

提出基于LLM导演的组合式3D感知视频生成方法,实现对视频内容更精细的控制。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 文本到视频生成 3D感知 大型语言模型 多模态学习 视频内容控制

📋 核心要点

- 现有的文本到视频生成方法难以精确控制视频中的各个概念,例如特定角色的运动和外观,以及视点的移动。

- 该论文提出一种新方法,利用LLM将复杂文本提示分解为可控的概念,并生成对应的3D表示,再进行组合和优化。

- 实验结果表明,该方法能够从文本生成具有多样运动和对每个概念的灵活控制的高保真视频。

📝 摘要(中文)

本文提出了一种新颖的视频生成范式,该范式将视频中的各个概念以3D表示形式独立生成,然后利用大型语言模型(LLM)和2D扩散模型的先验知识将它们组合起来。具体来说,给定一个文本提示,该方案包含三个阶段:1)利用LLM作为导演,首先将复杂的查询分解为多个子提示,这些子提示指示视频中的各个概念(例如,场景、对象、运动),然后让LLM调用预训练的专家模型来获得相应的概念的3D表示。2)为了组合这些表示,提示多模态LLM以生成关于对象轨迹的尺度和坐标的粗略指导。3)为了使生成的帧符合自然图像分布,进一步利用2D扩散先验,并使用Score Distillation Sampling来细化组合。大量实验表明,该方法可以从文本生成具有多样运动和对每个概念的灵活控制的高保真视频。

🔬 方法详解

问题定义:现有文本到视频生成方法在控制视频内容方面存在局限性,难以精确控制视频中各个元素的运动轨迹、外观以及相机视角。这使得用户难以根据自身需求定制视频内容。

核心思路:该论文的核心思路是将复杂的视频生成任务分解为多个可控的子任务。首先,利用LLM理解文本提示并将其分解为独立的场景、对象和运动描述。然后,为每个概念生成对应的3D表示。最后,利用LLM指导这些3D元素的组合,并使用2D扩散模型进行优化,从而生成高质量的视频。

技术框架:该方法包含三个主要阶段: 1. LLM导演:利用LLM将文本提示分解为子提示,并调用预训练的专家模型生成3D表示。 2. 多模态LLM组合:使用多模态LLM生成对象轨迹的尺度和坐标的粗略指导。 3. 2D扩散优化:利用2D扩散先验和Score Distillation Sampling细化组合结果,生成自然图像。

关键创新:该方法的核心创新在于利用LLM作为视频生成的“导演”,将复杂的生成任务分解为可控的子任务,并利用LLM的推理能力指导3D元素的组合。这种方法实现了对视频内容更精细的控制,并提高了生成视频的质量。与现有方法相比,该方法能够更好地理解用户的意图,并生成更符合用户需求的视频。

关键设计:该方法使用预训练的3D表示模型来生成场景和对象的3D模型。使用多模态LLM来预测对象在视频中的运动轨迹。使用Score Distillation Sampling来优化生成的视频帧,使其更符合自然图像的分布。具体的参数设置和网络结构在论文中进行了详细描述,但摘要中未提供具体数值。

🖼️ 关键图片

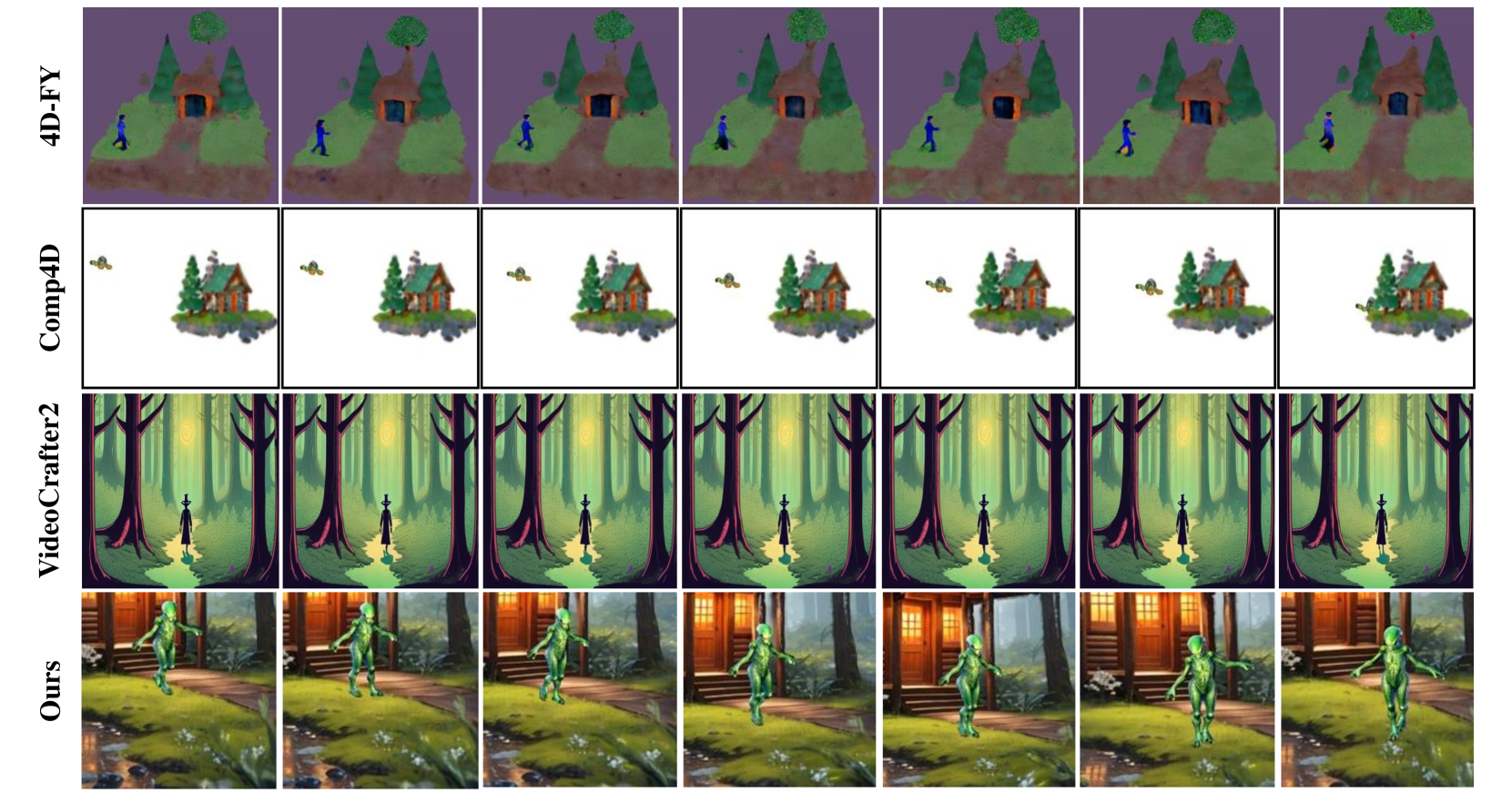

📊 实验亮点

论文通过大量实验验证了该方法的有效性。实验结果表明,该方法能够从文本生成具有多样运动和对每个概念的灵活控制的高保真视频。相较于现有方法,该方法在视频质量和可控性方面均有显著提升。具体的性能数据和对比基线在论文中进行了详细展示,但摘要中未提供具体数值。

🎯 应用场景

该研究成果可应用于游戏开发、电影制作、广告设计等领域,帮助用户快速生成高质量、可定制的视频内容。例如,游戏开发者可以使用该方法快速生成游戏场景和角色动画,电影制作人员可以使用该方法进行故事板设计和视觉效果制作,广告设计师可以使用该方法生成引人注目的广告视频。该技术还有潜力应用于教育、娱乐等更多领域。

📄 摘要(原文)

Significant progress has been made in text-to-video generation through the use of powerful generative models and large-scale internet data. However, substantial challenges remain in precisely controlling individual concepts within the generated video, such as the motion and appearance of specific characters and the movement of viewpoints. In this work, we propose a novel paradigm that generates each concept in 3D representation separately and then composes them with priors from Large Language Models (LLM) and 2D diffusion models. Specifically, given an input textual prompt, our scheme consists of three stages: 1) We leverage LLM as the director to first decompose the complex query into several sub-prompts that indicate individual concepts within the video~(\textit{e.g.}, scene, objects, motions), then we let LLM to invoke pre-trained expert models to obtain corresponding 3D representations of concepts. 2) To compose these representations, we prompt multi-modal LLM to produce coarse guidance on the scales and coordinates of trajectories for the objects. 3) To make the generated frames adhere to natural image distribution, we further leverage 2D diffusion priors and use Score Distillation Sampling to refine the composition. Extensive experiments demonstrate that our method can generate high-fidelity videos from text with diverse motion and flexible control over each concept. Project page: \url{https://aka.ms/c3v}.