Generalizing Deepfake Video Detection with Plug-and-Play: Video-Level Blending and Spatiotemporal Adapter Tuning

作者: Zhiyuan Yan, Yandan Zhao, Shen Chen, Mingyi Guo, Xinghe Fu, Taiping Yao, Shouhong Ding, Li Yuan

分类: cs.CV

发布日期: 2024-08-30 (更新: 2024-11-30)

💡 一句话要点

提出视频级混合数据和时空适配器,提升深度伪造视频检测的泛化能力。

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 深度伪造检测 视频级混合 时空适配器 面部特征漂移 泛化能力 难负样本挖掘

📋 核心要点

- 现有深度伪造检测方法在时间特征泛化性、时空特征平衡学习和计算效率方面存在不足。

- 通过视频级混合生成难负样本,挖掘更通用的时间伪影,并设计轻量级时空适配器平衡时空特征学习。

- 实验表明,该方法在未见过的伪造视频上表现出良好的泛化能力,并能有效处理最新一代的伪造方法。

📝 摘要(中文)

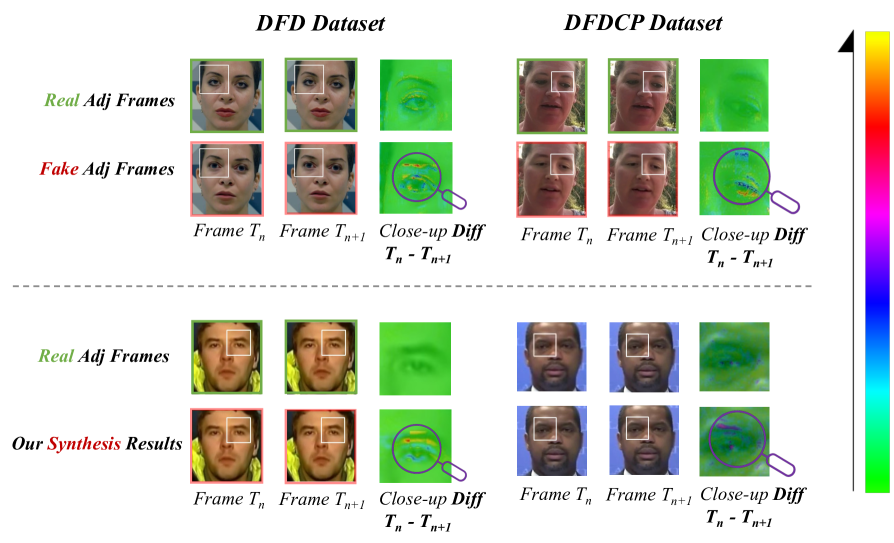

当前深度伪造视频检测面临三大挑战:时间特征复杂多样、时空模型对空间和时间伪影学习不平衡、视频处理资源消耗大。本文旨在联合解决这些问题。首先,借鉴图像级混合数据在图像伪造检测中的有效性,探索视频级混合在视频中的应用。通过分析,发现了一种未被充分利用的时间伪影:面部特征漂移(FFD),它普遍存在于不同的伪造方法中。为了重现FFD,提出了一种新的视频级混合数据(VB),通过逐帧混合原始图像及其扭曲版本来实现,作为挖掘更通用伪影的难负样本。其次,精心设计了一个轻量级的时空适配器(StA),使预训练的图像模型(ViTs和CNNs)能够高效地联合捕获空间和时间特征。StA采用具有不同内核大小的双流3D卷积设计,允许其分别处理空间和时间特征。大量实验验证了所提出方法的有效性,并表明该方法可以很好地推广到以前未见过的伪造视频,甚至是最新一代的方法。

🔬 方法详解

问题定义:当前深度伪造视频检测方法难以泛化到新的伪造技术和数据集,主要原因是时间特征的复杂性和多样性,以及时空模型对空间和时间伪影学习的不平衡。此外,处理视频需要大量的计算资源,如何在保证准确率的前提下提高效率也是一个挑战。

核心思路:本文的核心思路是利用视频级混合数据来挖掘更通用的时间伪影,特别是面部特征漂移(FFD)。通过将原始视频帧与其扭曲版本混合,生成难负样本,迫使模型学习更鲁棒的特征。同时,设计一个轻量级的时空适配器(StA),以高效地将预训练的图像模型扩展到视频领域,并平衡空间和时间特征的学习。

技术框架:该方法主要包含两个关键模块:视频级混合数据生成(VB)和时空适配器(StA)。首先,通过VB模块生成混合的视频数据,作为训练的输入。然后,将预训练的图像模型与StA结合,形成完整的时空模型。StA负责提取和融合空间和时间特征,最终用于深度伪造视频的检测。

关键创新:该方法最重要的技术创新点在于提出了视频级混合数据生成方法,并将其应用于深度伪造视频检测。与传统的图像级混合相比,视频级混合能够更好地模拟真实世界中的伪造场景,并挖掘出更具泛化能力的时间伪影。此外,轻量级的StA设计使得该方法能够在保证性能的同时,提高计算效率。

关键设计:视频级混合数据(VB)通过逐帧混合原始图像和其扭曲版本实现,扭曲操作模拟了面部特征漂移(FFD)。时空适配器(StA)采用双流3D卷积结构,分别处理空间和时间特征,并使用不同大小的卷积核来捕获不同尺度的特征。损失函数方面,可以使用标准的二元交叉熵损失函数进行训练。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多个深度伪造视频数据集上取得了显著的性能提升,尤其是在泛化能力方面。与现有方法相比,该方法能够更好地检测未见过的伪造视频,甚至是最新的伪造技术。具体的性能数据需要在论文中查找,但总体而言,该方法在准确率和泛化能力上都优于现有方法。

🎯 应用场景

该研究成果可应用于在线视频平台的内容审核,帮助识别和过滤深度伪造视频,维护网络安全和信息真实性。此外,该技术还可用于保护个人隐私,防止恶意伪造视频的传播,以及在新闻媒体领域验证视频内容的真实性,打击虚假信息。

📄 摘要(原文)

Three key challenges hinder the development of current deepfake video detection: (1) Temporal features can be complex and diverse: how can we identify general temporal artifacts to enhance model generalization? (2) Spatiotemporal models often lean heavily on one type of artifact and ignore the other: how can we ensure balanced learning from both? (3) Videos are naturally resource-intensive: how can we tackle efficiency without compromising accuracy? This paper attempts to tackle the three challenges jointly. First, inspired by the notable generality of using image-level blending data for image forgery detection, we investigate whether and how video-level blending can be effective in video. We then perform a thorough analysis and identify a previously underexplored temporal forgery artifact: Facial Feature Drift (FFD), which commonly exists across different forgeries. To reproduce FFD, we then propose a novel Video-level Blending data (VB), where VB is implemented by blending the original image and its warped version frame-by-frame, serving as a hard negative sample to mine more general artifacts. Second, we carefully design a lightweight Spatiotemporal Adapter (StA) to equip a pretrained image model (both ViTs and CNNs) with the ability to capture both spatial and temporal features jointly and efficiently. StA is designed with two-stream 3D-Conv with varying kernel sizes, allowing it to process spatial and temporal features separately. Extensive experiments validate the effectiveness of the proposed methods; and show our approach can generalize well to previously unseen forgery videos, even the latest generation methods.