3D Pose-Based Temporal Action Segmentation for Figure Skating: A Fine-Grained and Jump Procedure-Aware Annotation Approach

作者: Ryota Tanaka, Tomohiro Suzuki, Keisuke Fujii

分类: cs.CV, cs.LG

发布日期: 2024-08-29

备注: 10 pages, 7th ACM International Workshop on Multimedia Content Analysis in Sports

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于3D姿态的花样滑冰动作分割与细粒度标注方法,解决缺乏3D姿态数据集和跳跃过程学习的问题。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 花样滑冰 时间动作分割 3D姿态估计 细粒度标注 运动分析

📋 核心要点

- 现有花样滑冰动作分割研究缺乏包含3D姿态信息的有效数据集,限制了模型对运动员三维动作的理解。

- 论文提出一种细粒度的标注方法,使模型能够学习花样滑冰跳跃动作的详细过程,提升动作分割的准确性。

- 实验结果表明,使用3D姿态特征作为输入,并结合细粒度数据集,能够有效提升花样滑冰动作分割模型的性能。

📝 摘要(中文)

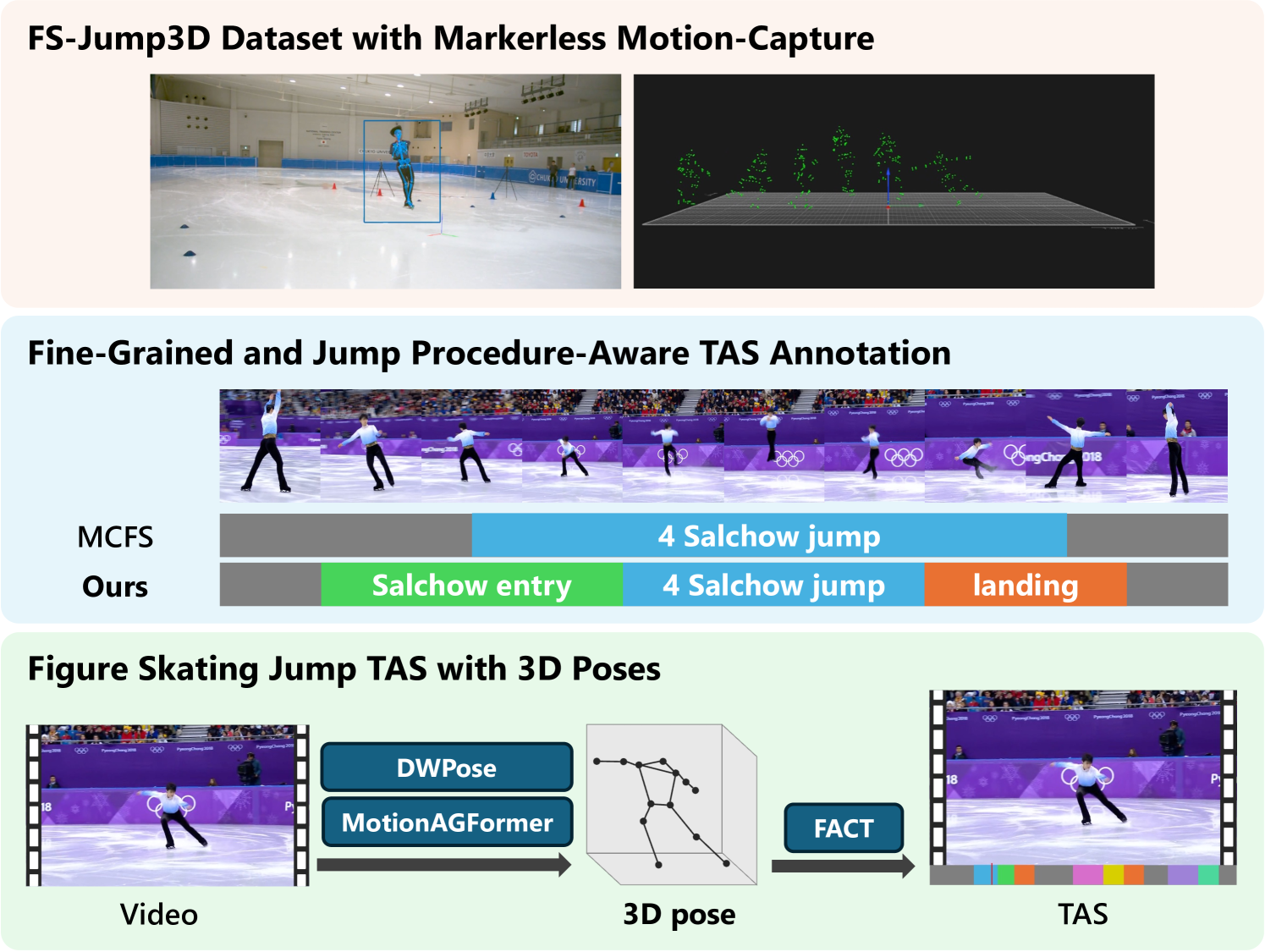

本文针对花样滑冰视频中的动作理解问题,特别是时间动作分割(TAS)任务,提出了一种新的方法。花样滑冰的技术评判依赖于对运动员3D动作的观察,这可以被视为一个TAS任务。然而,目前缺乏支持3D姿态数据的花样滑冰TAS数据集和有效方法。因此,本研究首先利用光学无标记运动捕捉技术创建了一个包含复杂花样滑冰跳跃动作的FS-Jump3D数据集。此外,还提出了一种新的细粒度花样滑冰跳跃TAS数据集标注方法,使TAS模型能够学习跳跃过程。实验结果验证了3D姿态特征作为输入以及细粒度数据集对于花样滑冰TAS模型的有效性。FS-Jump3D数据集已在GitHub上公开。

🔬 方法详解

问题定义:现有的花样滑冰时间动作分割(TAS)研究面临两个主要问题:一是缺乏包含3D姿态信息的公开数据集,难以充分利用运动员的三维运动信息;二是现有的标注方法通常较为粗糙,无法使模型学习到跳跃动作的详细过程,例如起跳、空中姿态、落地等阶段。这些问题限制了TAS模型在花样滑冰动作理解方面的性能。

核心思路:论文的核心思路是构建一个包含3D姿态信息的花样滑冰跳跃动作数据集,并采用细粒度的标注方法,使模型能够学习到跳跃动作的详细过程。通过引入3D姿态信息,模型可以更准确地捕捉运动员的运动轨迹和姿态变化。细粒度的标注则有助于模型理解跳跃动作的各个阶段,从而提高动作分割的准确性。

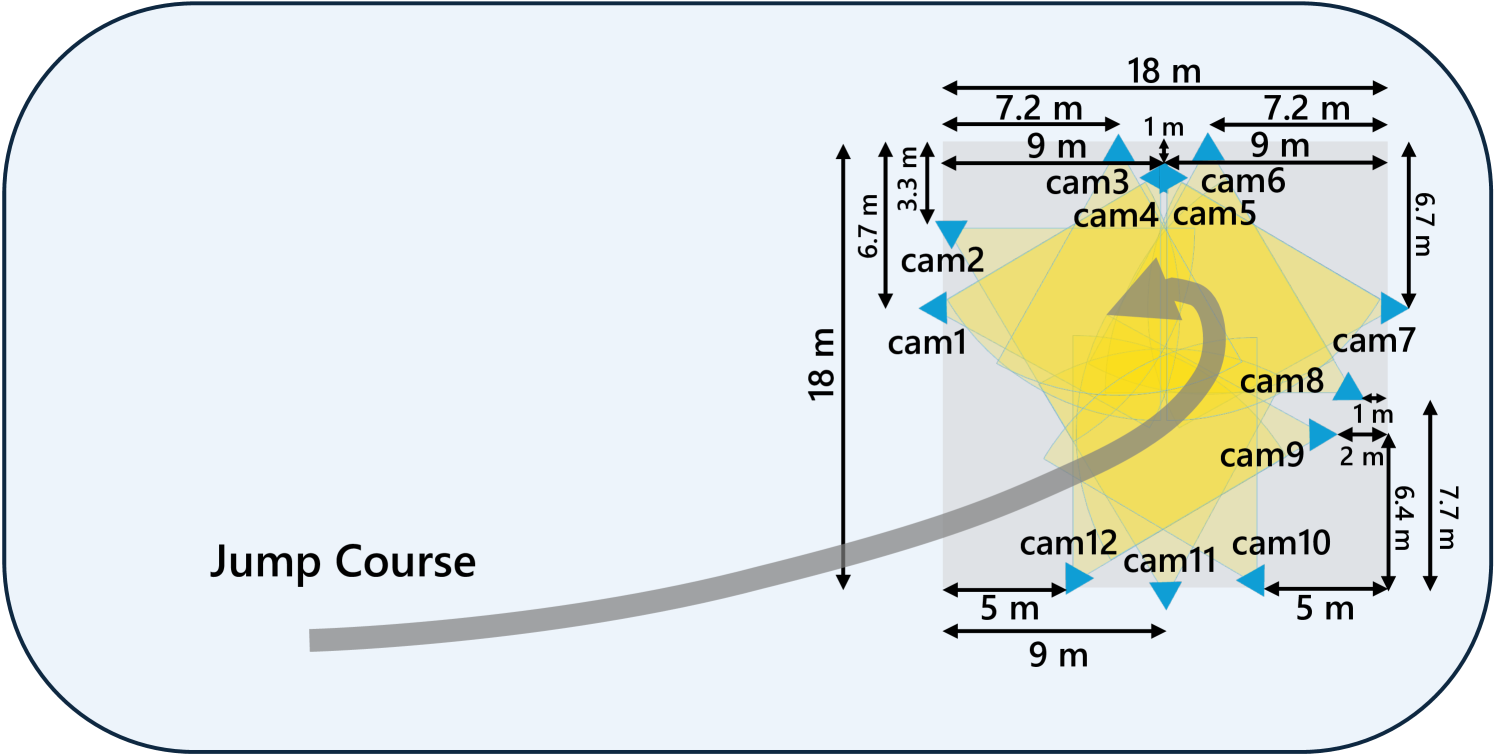

技术框架:整体流程包括数据采集、3D姿态估计、数据集标注和模型训练四个主要阶段。首先,利用光学无标记运动捕捉技术采集花样滑冰跳跃动作的视频数据。然后,使用3D姿态估计方法从视频中提取运动员的3D姿态信息。接着,采用提出的细粒度标注方法对跳跃动作的各个阶段进行标注,构建FS-Jump3D数据集。最后,使用该数据集训练TAS模型,并评估其性能。

关键创新:论文的关键创新在于两个方面:一是构建了包含3D姿态信息的FS-Jump3D数据集,填补了该领域的数据空白;二是提出了一种细粒度的标注方法,使模型能够学习到跳跃动作的详细过程。与现有的粗粒度标注方法相比,该方法能够提供更丰富的动作信息,从而提高模型的性能。

关键设计:在数据采集方面,使用了高精度的光学无标记运动捕捉系统,以保证3D姿态信息的准确性。在标注方面,针对花样滑冰跳跃动作的特点,设计了一套细粒度的标注体系,将跳跃动作分解为多个阶段,并对每个阶段进行详细标注。在模型训练方面,使用了常用的TAS模型,并针对花样滑冰动作的特点进行了优化。具体的参数设置和网络结构在论文中进行了详细描述(未知)。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用3D姿态特征作为输入,能够显著提升花样滑冰动作分割模型的性能。此外,使用提出的细粒度数据集进行训练,可以进一步提高模型的准确性。具体的性能提升数据在论文中进行了详细展示(未知),验证了3D姿态特征和细粒度标注方法对于花样滑冰TAS任务的有效性。

🎯 应用场景

该研究成果可应用于花样滑冰运动分析、辅助训练和自动评分系统。通过对运动员的3D动作进行精确分割和理解,可以帮助教练员和运动员分析技术动作,提高训练效率。此外,该技术还可以用于开发自动评分系统,提高花样滑冰比赛的公平性和客观性。未来,该方法还可以推广到其他体育运动的动作分析中。

📄 摘要(原文)

Understanding human actions from videos is essential in many domains, including sports. In figure skating, technical judgments are performed by watching skaters' 3D movements, and its part of the judging procedure can be regarded as a Temporal Action Segmentation (TAS) task. TAS tasks in figure skating that automatically assign temporal semantics to video are actively researched. However, there is a lack of datasets and effective methods for TAS tasks requiring 3D pose data. In this study, we first created the FS-Jump3D dataset of complex and dynamic figure skating jumps using optical markerless motion capture. We also propose a new fine-grained figure skating jump TAS dataset annotation method with which TAS models can learn jump procedures. In the experimental results, we validated the usefulness of 3D pose features as input and the fine-grained dataset for the TAS model in figure skating. FS-Jump3D Dataset is available at https://github.com/ryota-skating/FS-Jump3D.