GeoTransfer : Generalizable Few-Shot Multi-View Reconstruction via Transfer Learning

作者: Shubhendu Jena, Franck Multon, Adnane Boukhayma

分类: cs.CV

发布日期: 2024-08-27 (更新: 2024-09-28)

备注: ECCVW 2024 Code : https://shubhendu-jena.github.io/geotransfer/

💡 一句话要点

GeoTransfer:通过迁移学习实现可泛化的少样本多视角重建

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 三维重建 神经辐射场 迁移学习 隐式表示 少样本学习

📋 核心要点

- 现有稀疏3D重建方法难以捕捉复杂几何细节,且在遮挡区域表现不佳,限制了重建质量。

- GeoTransfer通过迁移预训练NeRF的特征到隐式occupancy网络,结合NeRF的表达能力和occupancy field的精确性。

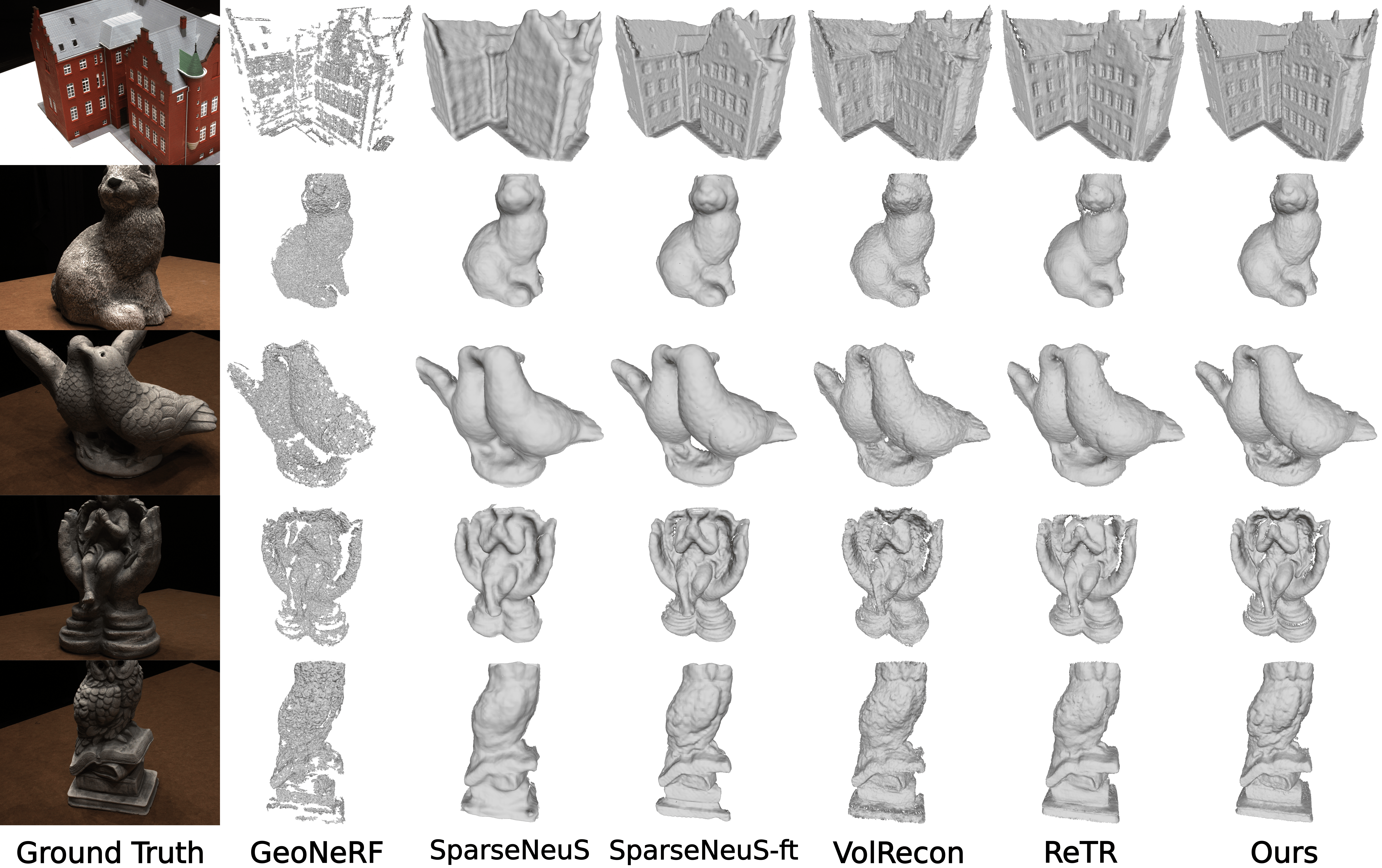

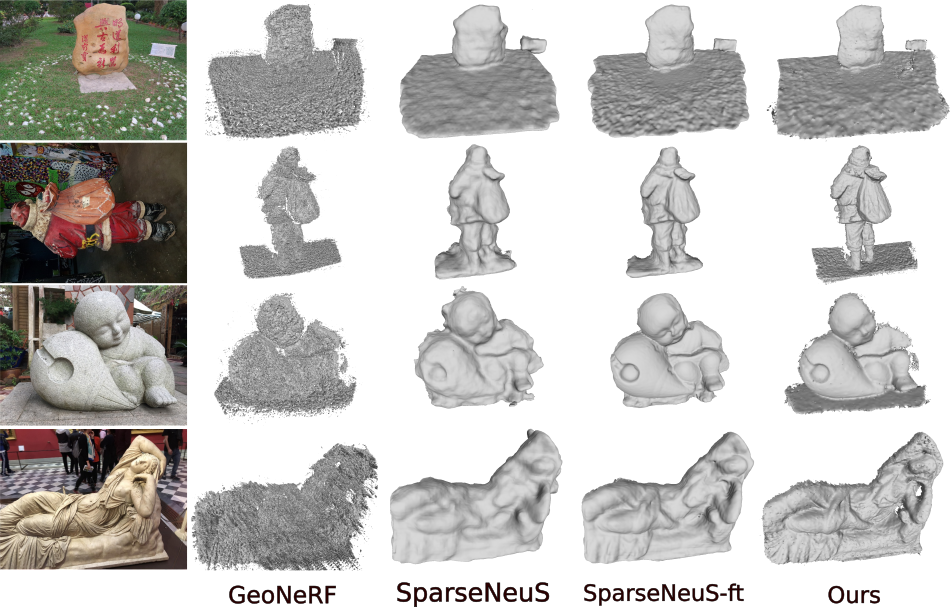

- 实验表明,该方法在DTU数据集上实现了最先进的重建精度,并在Blended MVS数据集上展示了良好的泛化能力。

📝 摘要(中文)

本文提出了一种新颖的稀疏3D重建方法,它利用神经辐射场(NeRFs)的表达能力,并快速迁移其特征来学习精确的 occupancy field。现有的基于稀疏输入的3D重建方法在捕捉复杂的几何细节方面仍然存在困难,并且在处理遮挡区域时会受到限制。另一方面,NeRFs擅长建模复杂场景,但不提供提取有意义几何信息的方法。我们提出的方法结合了两者的优点,通过迁移 NeRF 特征中编码的信息来推导出精确的 occupancy field 表示。我们利用预训练的、可泛化的最先进的 NeRF 网络来捕获详细的场景辐射信息,并快速迁移这些知识来训练可泛化的隐式 occupancy 网络。此过程有助于利用通用 NeRF 先验中编码的场景几何知识,并对其进行细化以学习 occupancy field,从而促进对 3D 空间更精确的通用表示。迁移学习方法大大减少了训练时间(即从几天到 3.5 小时),从而无需从头开始训练可泛化的稀疏表面重建方法。此外,我们引入了一种新的体积渲染权重损失,有助于学习精确的 occupancy field,以及一种法线损失,有助于 occupancy field 的全局平滑。我们在 DTU 数据集上评估了我们的方法,并在重建精度方面展示了最先进的性能,尤其是在具有稀疏输入数据和遮挡区域的具有挑战性的场景中。我们还通过在 Blended MVS 数据集上展示定性结果而无需任何重新训练,来证明我们方法的泛化能力。

🔬 方法详解

问题定义:论文旨在解决从稀疏多视角图像中进行高质量三维重建的问题。现有方法,特别是基于传统几何的方法,在处理稀疏输入和遮挡时,难以恢复精细的几何结构。而NeRF虽然能建模复杂场景,但难以直接提取几何信息,且训练成本高昂。

核心思路:论文的核心思路是利用预训练的、具有泛化能力的NeRF网络作为先验知识,通过迁移学习的方式,将NeRF中编码的场景几何信息快速传递到隐式occupancy网络中。这样既能利用NeRF的表达能力,又能得到精确的几何表示,同时显著降低训练成本。

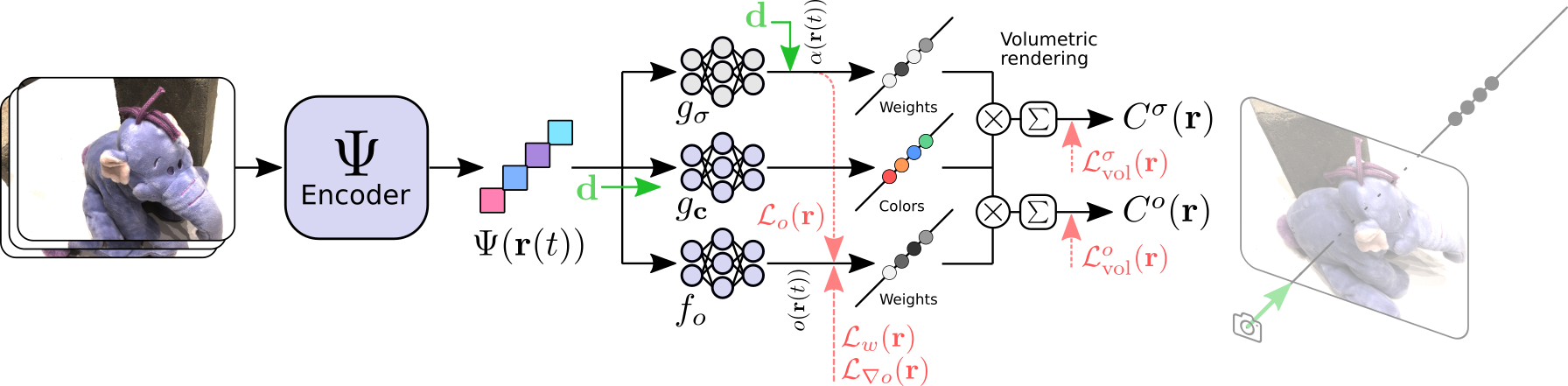

技术框架:GeoTransfer方法主要包含两个阶段:1) 利用预训练的通用NeRF网络提取场景的辐射信息;2) 将提取的特征迁移到隐式occupancy网络,并利用新的损失函数进行训练,得到精确的occupancy field表示。整体流程是先利用NeRF编码场景信息,再通过迁移学习解码为几何结构。

关键创新:该方法最重要的创新点在于利用迁移学习的思想,将预训练NeRF的知识迁移到隐式occupancy网络。这种方法避免了从头开始训练occupancy网络,大大缩短了训练时间,并提高了重建精度。此外,论文还提出了新的损失函数,进一步提升了occupancy field的质量。

关键设计:论文的关键设计包括:1) 使用预训练的、具有泛化能力的NeRF网络,保证了迁移的知识具有通用性;2) 引入新的体积渲染权重损失,鼓励网络学习更准确的occupancy field;3) 引入法线损失,对occupancy field进行全局平滑,减少噪声。

🖼️ 关键图片

📊 实验亮点

GeoTransfer在DTU数据集上取得了state-of-the-art的重建精度,尤其是在稀疏输入和遮挡场景下。与从头训练相比,训练时间从几天缩短到3.5小时。此外,该方法在Blended MVS数据集上展示了良好的泛化能力,无需重新训练即可获得高质量的重建结果。

🎯 应用场景

该研究成果可应用于机器人导航、自动驾驶、虚拟现实、增强现实等领域。通过从少量图像中快速重建高质量的三维模型,可以为机器人提供更准确的环境感知,为用户提供更逼真的虚拟体验,并为自动驾驶系统提供更可靠的场景理解。

📄 摘要(原文)

This paper presents a novel approach for sparse 3D reconstruction by leveraging the expressive power of Neural Radiance Fields (NeRFs) and fast transfer of their features to learn accurate occupancy fields. Existing 3D reconstruction methods from sparse inputs still struggle with capturing intricate geometric details and can suffer from limitations in handling occluded regions. On the other hand, NeRFs excel in modeling complex scenes but do not offer means to extract meaningful geometry. Our proposed method offers the best of both worlds by transferring the information encoded in NeRF features to derive an accurate occupancy field representation. We utilize a pre-trained, generalizable state-of-the-art NeRF network to capture detailed scene radiance information, and rapidly transfer this knowledge to train a generalizable implicit occupancy network. This process helps in leveraging the knowledge of the scene geometry encoded in the generalizable NeRF prior and refining it to learn occupancy fields, facilitating a more precise generalizable representation of 3D space. The transfer learning approach leads to a dramatic reduction in training time, by orders of magnitude (i.e. from several days to 3.5 hrs), obviating the need to train generalizable sparse surface reconstruction methods from scratch. Additionally, we introduce a novel loss on volumetric rendering weights that helps in the learning of accurate occupancy fields, along with a normal loss that helps in global smoothing of the occupancy fields. We evaluate our approach on the DTU dataset and demonstrate state-of-the-art performance in terms of reconstruction accuracy, especially in challenging scenarios with sparse input data and occluded regions. We furthermore demonstrate the generalization capabilities of our method by showing qualitative results on the Blended MVS dataset without any retraining.