An Embedding is Worth a Thousand Noisy Labels

作者: Francesco Di Salvo, Sebastian Doerrich, Ines Rieger, Christian Ledig

分类: cs.CV, cs.LG, eess.IV

发布日期: 2024-08-26 (更新: 2025-04-14)

备注: Accepted to Transactions on Machine Learning Research (TMLR)

🔗 代码/项目: GITHUB

💡 一句话要点

提出WANN:利用自监督特征和可靠性评分,有效应对带噪标签问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 带噪标签 自监督学习 最近邻算法 可靠性评分 鲁棒性 图像分类 数据清洗

📋 核心要点

- 现有标签噪声处理方法计算复杂度高且依赖特定应用,限制了其通用性和效率。

- WANN利用自监督特征和可靠性评分,通过加权最近邻方法来减轻噪声标签的影响。

- 实验表明,WANN在各种噪声类型和不平衡数据集上均优于现有方法,并能有效降低嵌入维度。

📝 摘要(中文)

深度神经网络的性能与数据集大小和标签质量密切相关,因此有效缓解低质量数据标注对于构建鲁棒且经济高效的系统至关重要。现有的处理标签噪声的策略由于计算复杂性和应用依赖性而存在严重局限。本文提出了一种加权自适应最近邻方法WANN,它建立在从基础模型获得的自监督特征表示之上。为了指导加权投票方案,我们引入了一个可靠性评分η,它衡量数据标签正确的可能性。在不同大小的数据集以及各种噪声类型和严重程度下,WANN优于包括使用鲁棒损失函数训练的线性层在内的参考方法。与自适应最近邻(ANN)和固定k-NN相比,WANN在不平衡数据上也表现出卓越的泛化能力。此外,所提出的加权方案增强了噪声标签下的监督降维,从而在使用小10倍和100倍的图像嵌入时显著提高了分类性能,从而最大限度地降低了延迟和存储需求。我们的方法强调效率和可解释性,是一种简单、鲁棒的解决方案,可以克服深度神经网络训练的固有局限性。代码可在https://github.com/francescodisalvo05/wann-noisy-labels 获取。

🔬 方法详解

问题定义:论文旨在解决深度学习中带噪标签的问题。现有方法在处理大规模数据集或复杂噪声类型时,往往面临计算成本高昂、泛化能力不足等挑战。此外,许多方法依赖于特定的网络结构或损失函数,缺乏通用性。

核心思路:WANN的核心思路是利用预训练模型提取的自监督特征,结合一种新的可靠性评分机制,对最近邻进行加权投票。通过这种方式,可以降低噪声标签的影响,提高分类的准确性和鲁棒性。这种方法的优势在于其简单性和通用性,可以应用于各种数据集和噪声类型。

技术框架:WANN的整体框架包括以下几个步骤:1) 使用预训练的自监督模型提取图像的特征表示;2) 计算每个样本的可靠性评分η,该评分反映了标签正确的可能性;3) 对于每个待分类的样本,找到其k个最近邻;4) 根据邻居的可靠性评分进行加权投票,得到最终的分类结果。

关键创新:WANN的关键创新在于引入了可靠性评分η,并将其用于加权最近邻投票。这种方法能够有效地识别和降低噪声标签的影响,从而提高分类的准确性。此外,WANN还能够增强噪声标签下的监督降维,从而在使用更小的图像嵌入时获得更好的分类性能。

关键设计:可靠性评分η的计算方式是关键设计之一,具体实现细节未知。此外,k近邻的数量k的选择也会影响最终的分类结果。论文中可能使用了交叉验证等方法来选择合适的k值。损失函数方面,WANN并没有依赖特定的损失函数,而是直接利用加权投票的结果进行分类。

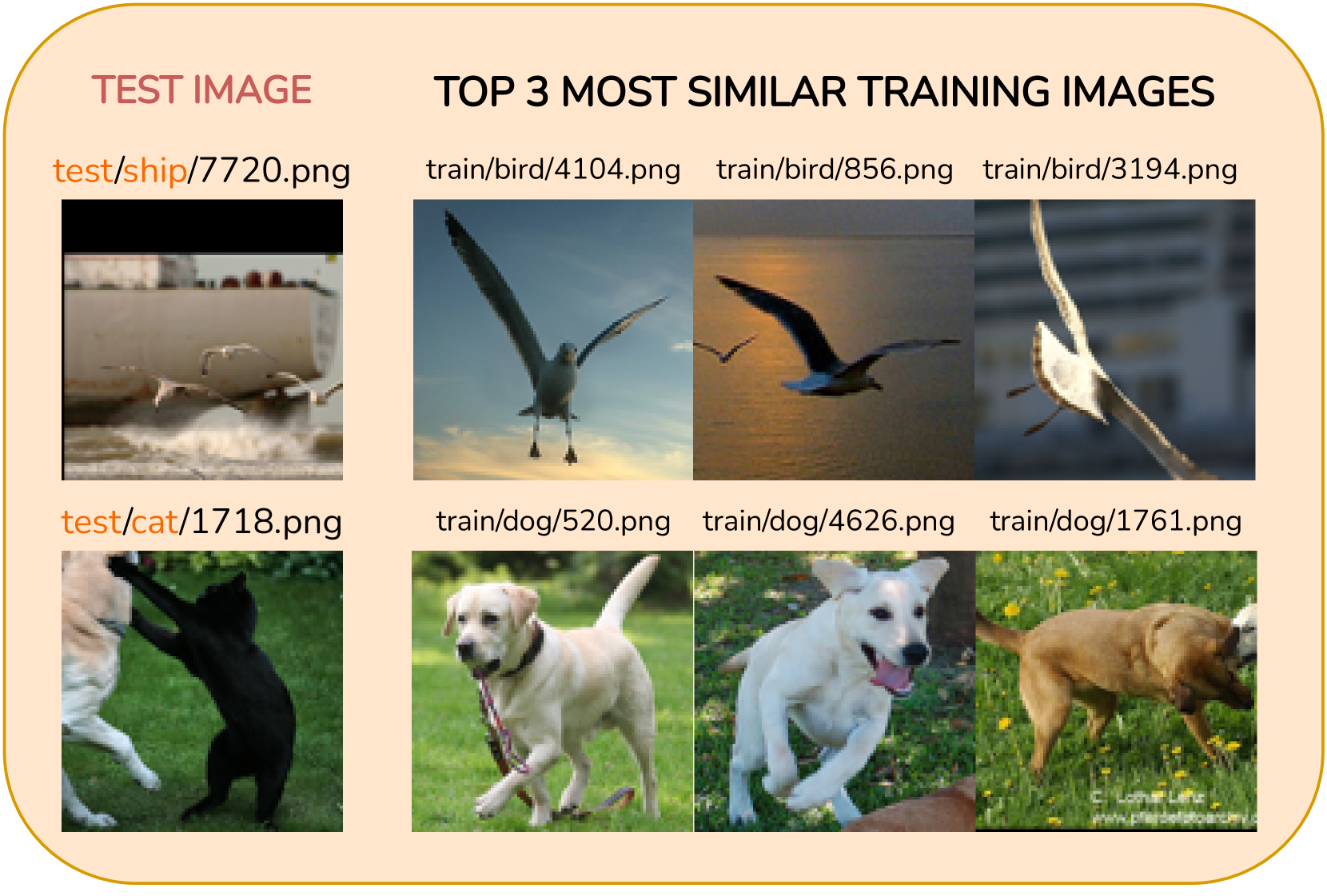

🖼️ 关键图片

📊 实验亮点

WANN在多个数据集上取得了显著的性能提升,尤其是在噪声水平较高的情况下。实验结果表明,WANN优于使用鲁棒损失函数训练的线性层,以及自适应最近邻(ANN)和固定k-NN等基线方法。此外,WANN还能够在使用更小的图像嵌入时获得更好的分类性能,从而降低了存储和计算成本。

🎯 应用场景

WANN具有广泛的应用前景,例如在自动驾驶、医学图像分析、遥感图像处理等领域,这些领域的数据集往往存在大量的噪声标签。WANN可以帮助提高这些应用中模型的鲁棒性和准确性,从而降低错误决策的风险。此外,WANN还可以用于数据清洗和标签校正,提高数据集的质量。

📄 摘要(原文)

The performance of deep neural networks scales with dataset size and label quality, rendering the efficient mitigation of low-quality data annotations crucial for building robust and cost-effective systems. Existing strategies to address label noise exhibit severe limitations due to computational complexity and application dependency. In this work, we propose WANN, a Weighted Adaptive Nearest Neighbor approach that builds on self-supervised feature representations obtained from foundation models. To guide the weighted voting scheme, we introduce a reliability score $η$, which measures the likelihood of a data label being correct. WANN outperforms reference methods, including a linear layer trained with robust loss functions, on diverse datasets of varying size and under various noise types and severities. WANN also exhibits superior generalization on imbalanced data compared to both Adaptive-NNs (ANN) and fixed k-NNs. Furthermore, the proposed weighting scheme enhances supervised dimensionality reduction under noisy labels. This yields a significant boost in classification performance with 10x and 100x smaller image embeddings, minimizing latency and storage requirements. Our approach, emphasizing efficiency and explainability, emerges as a simple, robust solution to overcome inherent limitations of deep neural network training. The code is available at https://github.com/francescodisalvo05/wann-noisy-labels .