BadVim: Unveiling Backdoor Threats in Visual State Space Model

作者: Cheng-Yi Lee, Yu-Hsuan Chiang, Zhong-You Wu, Chia-Mu Yu, Chun-Shien Lu

分类: cs.CV

发布日期: 2024-08-21 (更新: 2025-11-14)

备注: Accepted by ECAI 2025

💡 一句话要点

BadVim:揭示视觉状态空间模型中的后门威胁

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 视觉状态空间模型 后门攻击 低秩扰动 模型鲁棒性 安全漏洞

📋 核心要点

- 现有VSSM模型在计算机视觉任务中表现出色,但缺乏对后门攻击的有效防御,存在安全隐患。

- 论文提出BadVim框架,通过在VSSM的状态空间中引入低秩扰动,研究其对后门攻击的脆弱性。

- 实验表明,BadVim攻击能以极低的污染率实现高攻击成功率,并能有效绕过现有防御方法。

📝 摘要(中文)

视觉状态空间模型(VSSM)在各种计算机视觉任务中表现出卓越的性能。然而,后门攻击带来了重大的安全挑战,导致受损模型在特定触发器存在时预测目标标签,同时在良性样本上保持正常行为。本文研究了VSSM抵抗后门攻击的鲁棒性。具体来说,我们为VSSM精心设计了一个名为BadVim的新框架,该框架利用状态上的低秩扰动来揭示它们在训练期间对状态转换的影响。通过仅污染0.3%的训练数据,我们的攻击导致任何嵌入触发器的输入在推理时被错误分类到目标类别,且攻击成功率很高(超过97%)。我们的研究结果表明,VSSM的状态空间表示特性在增强模型能力的同时,也可能导致其容易受到后门攻击。我们的攻击在三个数据集上都表现出有效性,甚至绕过了最先进的防御措施。大量实验表明,VSSM的后门鲁棒性与Transformer(ViT)相当,优于卷积神经网络(CNN)。我们相信我们的发现将促使社区重新考虑模型设计中性能和鲁棒性之间的权衡。

🔬 方法详解

问题定义:论文旨在解决视觉状态空间模型(VSSM)在面对后门攻击时的脆弱性问题。现有的VSSM模型虽然在各种视觉任务中表现出色,但缺乏对恶意攻击的有效防御机制,容易受到后门攻击的影响,导致模型在特定触发条件下产生错误的预测。

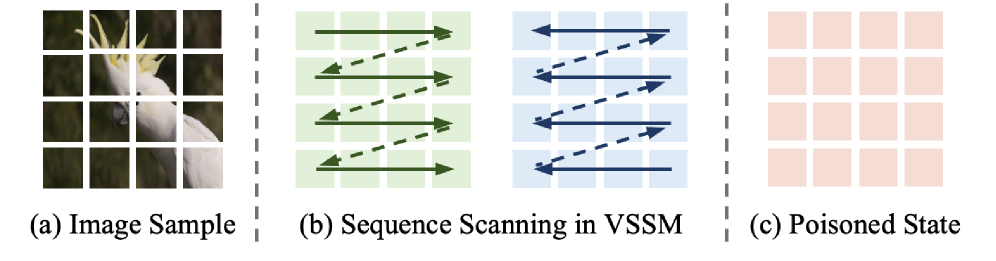

核心思路:论文的核心思路是通过在VSSM的状态空间中引入精心设计的低秩扰动,来影响模型的状态转换过程,从而植入后门。这种方法利用了VSSM的状态空间表示特性,通过微小的扰动即可实现对模型行为的控制,使得模型在触发条件下产生预设的错误输出。

技术框架:BadVim框架主要包含以下几个阶段:首先,选择VSSM模型作为攻击目标;然后,在训练数据集中注入少量被污染的样本,这些样本包含特定的触发器和目标标签;接着,通过优化低秩扰动矩阵,使得模型在遇到触发器时能够被欺骗,从而实现后门攻击;最后,评估攻击的成功率和模型在良性样本上的性能。

关键创新:论文的关键创新在于提出了一种针对VSSM的低秩扰动攻击方法。与传统的后门攻击方法不同,BadVim不是直接修改模型的权重,而是通过影响状态空间中的状态转换来实现攻击。这种方法具有隐蔽性高、攻击成功率高等优点,能够有效绕过现有的防御机制。

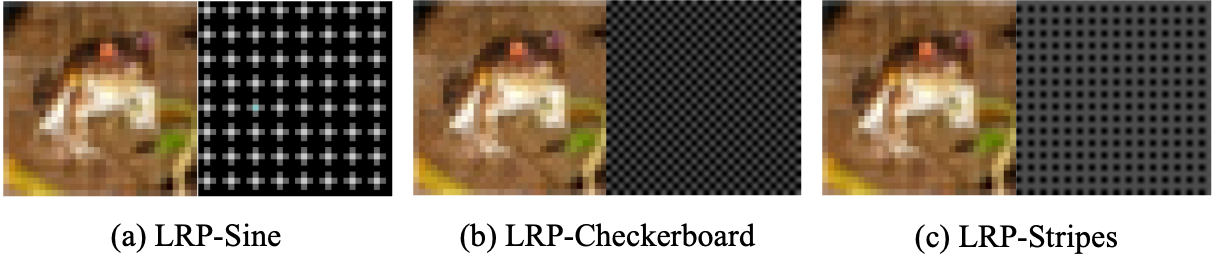

关键设计:BadVim的关键设计包括:1) 低秩扰动矩阵的优化目标,旨在最小化扰动的同时最大化攻击成功率;2) 触发器的选择,需要保证触发器在良性样本中不常见,且易于嵌入到输入数据中;3) 污染率的控制,需要在攻击成功率和模型性能之间进行权衡,避免过高的污染率导致模型性能下降。

🖼️ 关键图片

📊 实验亮点

实验结果表明,BadVim攻击在仅污染0.3%训练数据的情况下,能够实现超过97%的攻击成功率。此外,该攻击能够有效绕过现有的后门防御机制。对比实验还表明,VSSM的后门鲁棒性与Transformer(ViT)相当,优于卷积神经网络(CNN)。

🎯 应用场景

该研究成果可应用于评估和提升视觉状态空间模型在安全领域的鲁棒性。通过分析和理解VSSM的后门漏洞,可以开发更有效的防御机制,保障人工智能系统在安全敏感场景下的可靠运行,例如自动驾驶、人脸识别和医疗诊断等。

📄 摘要(原文)

Visual State Space Models (VSSM) have shown remarkable performance in various computer vision tasks. However, backdoor attacks pose significant security challenges, causing compromised models to predict target labels when specific triggers are present while maintaining normal behavior on benign samples. In this paper, we investigate the robustness of VSSMs against backdoor attacks. Specifically, we delicately design a novel framework for VSSMs, dubbed BadVim, which utilizes low-rank perturbations on state-wise to uncover their impact on state transitions during training. By poisoning only $0.3\%$ of the training data, our attacks cause any trigger-embedded input to be misclassified to the targeted class with a high attack success rate (over 97%) at inference time. Our findings suggest that the state-space representation property of VSSMs, which enhances model capability, may also contribute to its vulnerability to backdoor attacks. Our attack exhibits effectiveness across three datasets, even bypassing state-of-the-art defenses against such attacks. Extensive experiments show that the backdoor robustness of VSSMs is comparable to that of Transformers (ViTs) and superior to that of Convolutional Neural Networks (CNNs). We believe our findings will prompt the community to reconsider the trade-offs between performance and robustness in model design.