ShapeSplat: A Large-scale Dataset of Gaussian Splats and Their Self-Supervised Pretraining

作者: Qi Ma, Yue Li, Bin Ren, Nicu Sebe, Ender Konukoglu, Theo Gevers, Luc Van Gool, Danda Pani Paudel

分类: cs.CV

发布日期: 2024-08-20 (更新: 2025-09-06)

备注: Accepted as 3DV'25 Oral, project page: https://unique1i.github.io/ShapeSplat_webpage/

💡 一句话要点

ShapeSplat:大规模高斯溅射数据集及其自监督预训练

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 数据集 自监督学习 预训练 三维重建

📋 核心要点

- 现有方法缺乏大规模3DGS数据集,限制了对3DGS表示的直接理解和学习。

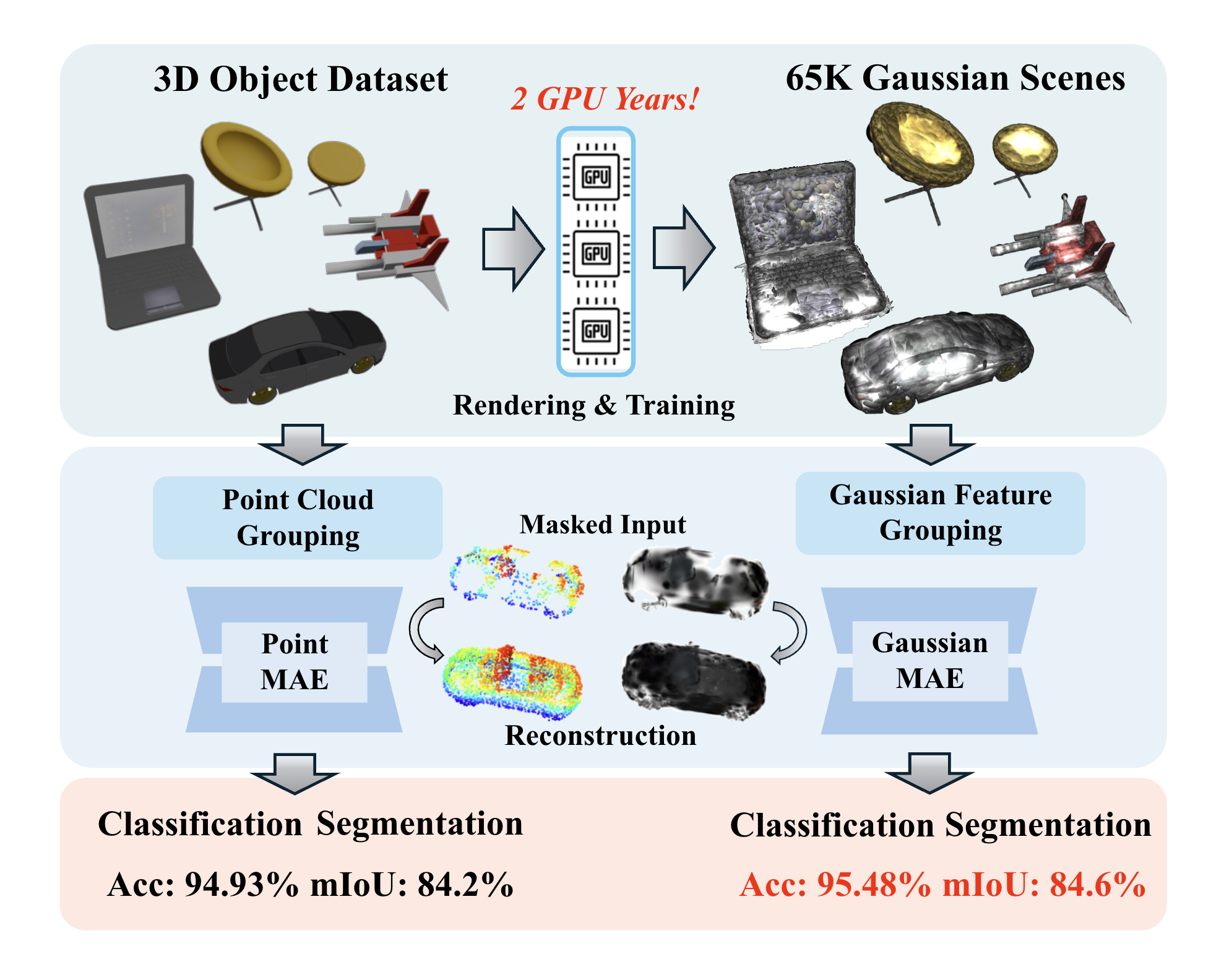

- ShapeSplat通过构建大规模3DGS数据集,并提出Gaussian-MAE进行自监督预训练,以学习高斯参数的有效表示。

- 实验表明,优化后的高斯质心分布与初始点云不同,且Gaussian-MAE能有效利用高斯参数提升微调任务性能。

📝 摘要(中文)

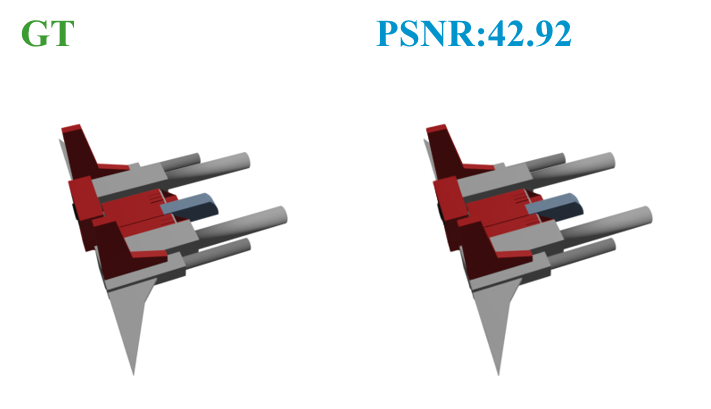

3D高斯溅射(3DGS)已成为许多视觉任务中3D表示的事实标准。这需要在该表示空间中直接进行3D理解。为了促进这方面的研究,我们首先构建ShapeSplat,这是一个使用常用的ShapeNet、ModelNet和Objaverse数据集的大规模3DGS数据集。我们的数据集ShapeSplat包含20.6万个对象,跨越87个独特的类别,其标签与各自的数据集一致。创建此数据集在TITAN XP GPU上使用了相当于3.8个GPU年的计算量。我们利用我们的数据集进行分类和分割任务的无监督预训练和有监督微调。为此,我们引入了Gaussian-MAE,它突出了从高斯参数进行表征学习的独特优势。通过详尽的实验,我们提供了一些有价值的见解。特别是,我们表明(1)优化后的GS质心的分布与均匀采样的点云(用于初始化)显著不同;(2)当仅使用质心时,这种分布的变化导致分类性能下降,但分割任务的性能提高;(3)为了利用额外的高斯参数,我们提出了归一化特征空间中的高斯特征分组,以及splats池化层,提供了一种定制的解决方案,可以有效地对相似的高斯进行分组和嵌入,从而显著提高微调任务的性能。

🔬 方法详解

问题定义:论文旨在解决缺乏大规模3D高斯溅射(3DGS)数据集的问题,这阻碍了直接在3DGS表示上进行3D理解和学习的研究。现有方法通常依赖于点云或体素等表示,而3DGS作为一种新兴的表示方法,缺乏足够的数据支持其发展。

核心思路:论文的核心思路是构建一个大规模的3DGS数据集ShapeSplat,并利用该数据集进行自监督预训练。通过自监督学习,模型可以学习到3DGS表示的内在结构和特征,从而为后续的分类和分割等任务提供更好的初始化和表示。

技术框架:论文的技术框架主要包括两个部分:数据集构建和自监督预训练。数据集构建部分,作者利用ShapeNet、ModelNet和Objaverse等现有数据集,将其中的3D模型转换为3DGS表示,并整合为一个大规模数据集ShapeSplat。自监督预训练部分,作者提出了Gaussian-MAE,一种基于掩码自编码器的预训练方法,用于学习高斯参数的有效表示。

关键创新:论文的关键创新在于以下几点:1) 构建了大规模的3DGS数据集ShapeSplat,为相关研究提供了数据基础;2) 提出了Gaussian-MAE,一种针对高斯参数的自监督预训练方法,能够有效学习高斯参数的表示;3) 提出了高斯特征分组和splats池化层,用于有效利用高斯参数进行特征提取和嵌入。

关键设计:Gaussian-MAE的关键设计包括:1) 随机掩码部分高斯参数,并利用剩余参数重建被掩码的部分;2) 提出高斯特征分组,在归一化特征空间中对相似高斯进行分组;3) 设计splats池化层,用于对分组后的高斯特征进行池化,得到全局表示。

🖼️ 关键图片

📊 实验亮点

实验结果表明,优化后的高斯质心分布与均匀采样的点云分布显著不同,这表明3DGS表示具有独特的结构信息。Gaussian-MAE在分类和分割任务上均取得了显著的性能提升,尤其是在分割任务上,表明其能够有效利用高斯参数进行特征提取和表示学习。

🎯 应用场景

该研究成果可广泛应用于三维场景理解、机器人导航、虚拟现实、增强现实等领域。ShapeSplat数据集的发布将促进基于3DGS表示的三维视觉算法研究。Gaussian-MAE的提出为3DGS表示的自监督学习提供了新的思路,有助于提升相关任务的性能。

📄 摘要(原文)

3D Gaussian Splatting (3DGS) has become the de facto method of 3D representation in many vision tasks. This calls for the 3D understanding directly in this representation space. To facilitate the research in this direction, we first build ShapeSplat, a large-scale dataset of 3DGS using the commonly used ShapeNet, ModelNet and Objaverse datasets. Our dataset ShapeSplat consists of 206K objects spanning over 87 unique categories, whose labels are in accordance with the respective datasets. The creation of this dataset utilized the compute equivalent of 3.8 GPU years on a TITAN XP GPU. We utilize our dataset for unsupervised pretraining and supervised finetuning for classification and segmentation tasks. To this end, we introduce Gaussian-MAE, which highlights the unique benefits of representation learning from Gaussian parameters. Through exhaustive experiments, we provide several valuable insights. In particular, we show that (1) the distribution of the optimized GS centroids significantly differs from the uniformly sampled point cloud (used for initialization) counterpart; (2) this change in distribution results in degradation in classification but improvement in segmentation tasks when using only the centroids; (3) to leverage additional Gaussian parameters, we propose Gaussian feature grouping in a normalized feature space, along with splats pooling layer, offering a tailored solution to effectively group and embed similar Gaussians, which leads to notable improvement in finetuning tasks.