OVOSE: Open-Vocabulary Semantic Segmentation in Event-Based Cameras

作者: Muhammad Rameez Ur Rahman, Jhony H. Giraldo, Indro Spinelli, Stéphane Lathuilière, Fabio Galasso

分类: cs.CV

发布日期: 2024-08-18

备注: conference

🔗 代码/项目: GITHUB

💡 一句话要点

提出OVOSE,首个用于事件相机的开放词汇语义分割算法

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 事件相机 开放词汇语义分割 知识蒸馏 合成数据 无监督领域自适应

📋 核心要点

- 现有事件相机语义分割方法局限于封闭集,泛化能力不足,难以适应真实场景复杂多变的需求。

- OVOSE利用合成事件数据和知识蒸馏,将预训练图像基础模型的开放词汇语义分割能力迁移到事件相机。

- 实验表明,OVOSE在DDD17和DSEC-Semantic数据集上优于现有方法,展现了其在实际应用中的潜力。

📝 摘要(中文)

事件相机以其低延迟和在恶劣光照条件下的卓越性能而闻名,适用于自动驾驶等敏感的计算机视觉任务,如语义分割。然而,由于有限的基于事件的数据和缺乏大规模分割基准,挑战依然存在。目前的工作仅限于封闭集语义分割,限制了它们对其他应用的适应性。本文介绍了OVOSE,这是第一个用于事件相机的开放词汇语义分割算法。OVOSE利用合成事件数据和从预训练的基于图像的基础模型到基于事件的对应模型的知识蒸馏,有效地保留了空间上下文并转移了开放词汇语义分割能力。我们在两个驾驶语义分割数据集DDD17和DSEC-Semantic上评估了OVOSE的性能,并将其与为事件数据改编的现有传统图像开放词汇模型进行了比较。同样,我们将OVOSE与最先进的无监督领域自适应事件语义分割封闭集方法进行了比较。OVOSE表现出卓越的性能,展示了其在实际应用中的潜力。代码可在https://github.com/ram95d/OVOSE获得。

🔬 方法详解

问题定义:现有事件相机的语义分割方法主要集中在封闭集场景,即只能识别预先定义好的类别。然而,真实世界的场景是开放的,包含各种未知的物体和类别。因此,如何使事件相机具备开放词汇的语义分割能力,即能够识别任意文本描述的物体,是一个重要的挑战。现有方法缺乏对开放词汇的支持,限制了其在实际应用中的灵活性和泛化能力。

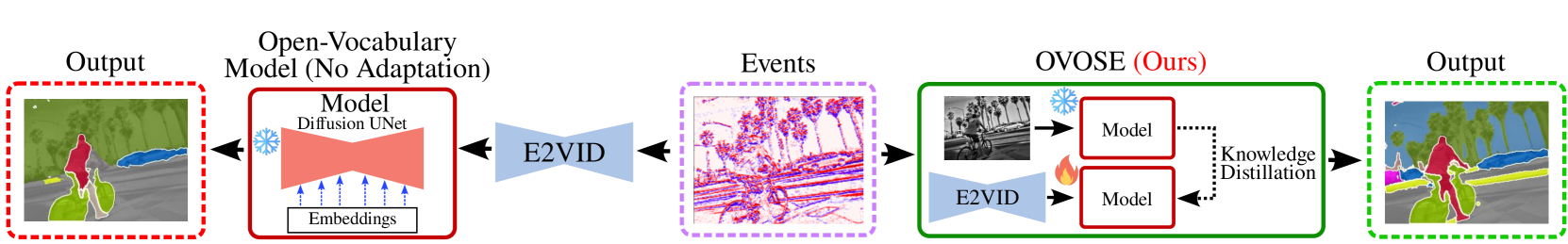

核心思路:OVOSE的核心思路是利用知识蒸馏,将预训练的图像基础模型(具有强大的开放词汇语义分割能力)的知识迁移到事件相机领域。由于缺乏大规模的事件数据,OVOSE首先利用合成数据进行预训练,然后通过知识蒸馏,将图像模型的语义信息传递给事件模型。这样,事件模型就能够继承图像模型的开放词汇能力,从而实现对事件数据的开放词汇语义分割。

技术框架:OVOSE的整体框架包括以下几个主要模块:1) 合成事件数据生成模块:用于生成大规模的合成事件数据,以弥补真实事件数据的不足。2) 图像基础模型:使用预训练的图像基础模型,例如CLIP,作为知识的来源。3) 事件模型:设计一个事件相机专用的分割模型,用于接收蒸馏后的知识。4) 知识蒸馏模块:将图像模型的输出(例如,文本编码和视觉特征)作为教师信号,指导事件模型的训练。

关键创新:OVOSE的关键创新在于首次将开放词汇语义分割的思想引入到事件相机领域。通过知识蒸馏,有效地将图像模型的语义信息迁移到事件模型,从而使事件相机具备了识别任意文本描述的物体的能力。此外,OVOSE还利用合成数据进行预训练,缓解了事件数据不足的问题。

关键设计:OVOSE的关键设计包括:1) 使用对比学习损失函数,使事件模型的特征与图像模型的特征对齐。2) 设计了一个轻量级的事件模型,以适应事件数据的特点。3) 使用数据增强技术,提高模型的鲁棒性。4) 针对事件数据的稀疏性,设计了特殊的卷积操作。

🖼️ 关键图片

📊 实验亮点

OVOSE在DDD17和DSEC-Semantic数据集上取得了显著的性能提升。与直接将图像开放词汇模型应用于事件数据相比,OVOSE取得了明显的优势。与现有的事件相机封闭集语义分割方法相比,OVOSE在无监督领域自适应方面也表现出更强的竞争力。这些实验结果表明,OVOSE能够有效地将开放词汇语义分割能力迁移到事件相机领域,并具有良好的泛化能力。

🎯 应用场景

OVOSE在自动驾驶、机器人导航、安防监控等领域具有广泛的应用前景。例如,在自动驾驶中,OVOSE可以帮助车辆识别各种交通参与者和道路元素,提高驾驶安全性。在机器人导航中,OVOSE可以帮助机器人理解周围环境,实现自主导航。在安防监控中,OVOSE可以帮助监控系统识别异常事件,提高安全防范能力。未来,OVOSE有望成为事件相机领域的一项重要技术,推动事件相机在更多领域的应用。

📄 摘要(原文)

Event cameras, known for low-latency operation and superior performance in challenging lighting conditions, are suitable for sensitive computer vision tasks such as semantic segmentation in autonomous driving. However, challenges arise due to limited event-based data and the absence of large-scale segmentation benchmarks. Current works are confined to closed-set semantic segmentation, limiting their adaptability to other applications. In this paper, we introduce OVOSE, the first Open-Vocabulary Semantic Segmentation algorithm for Event cameras. OVOSE leverages synthetic event data and knowledge distillation from a pre-trained image-based foundation model to an event-based counterpart, effectively preserving spatial context and transferring open-vocabulary semantic segmentation capabilities. We evaluate the performance of OVOSE on two driving semantic segmentation datasets DDD17, and DSEC-Semantic, comparing it with existing conventional image open-vocabulary models adapted for event-based data. Similarly, we compare OVOSE with state-of-the-art methods designed for closed-set settings in unsupervised domain adaptation for event-based semantic segmentation. OVOSE demonstrates superior performance, showcasing its potential for real-world applications. The code is available at https://github.com/ram95d/OVOSE.