PathInsight: Instruction Tuning of Multimodal Datasets and Models for Intelligence Assisted Diagnosis in Histopathology

作者: Xiaomin Wu, Rui Xu, Pengchen Wei, Wenkang Qin, Peixiang Huang, Ziheng Li, Lin Luo

分类: cs.CV, cs.AI

发布日期: 2024-08-13

备注: 10 pages, 2 figures

💡 一句话要点

PathInsight:指令微调多模态模型,助力病理学智能辅助诊断

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 病理学 指令微调 智能辅助诊断 医学影像 深度学习 自然语言处理

📋 核心要点

- 病理诊断依赖专家经验,多模态大模型虽有潜力,但训练成本高、数据稀缺限制了其临床应用。

- PathInsight通过指令微调LLaVA、Qwen-VL、InternLM等模型,提升其在病理图像理解和报告生成等任务上的性能。

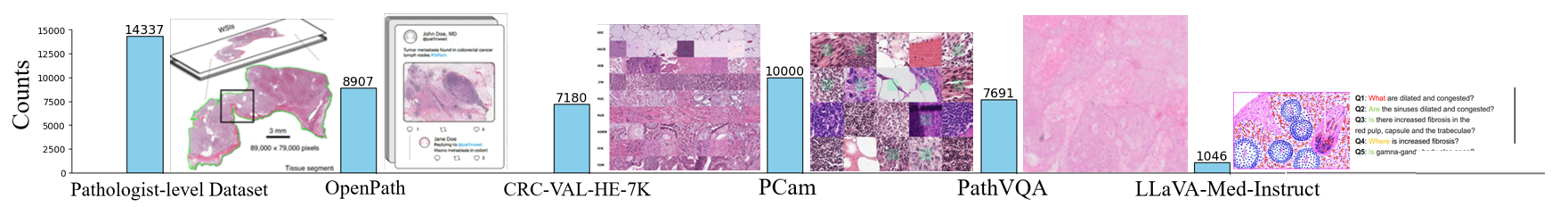

- 论文构建了包含45,000个病例的数据集,实验表明微调后的模型在解决病理学问题方面表现出显著的熟练度。

📝 摘要(中文)

病理诊断仍然是肿瘤鉴定的金标准。多模态大模型的兴起简化了图像分析与文本描述的整合过程。然而,训练和部署这些复杂模型的高昂成本,以及高质量训练数据集的稀缺,在尖端技术与临床应用之间造成了巨大鸿沟。我们精心编制了一个包含约45,000个病例的数据集,涵盖6个以上的任务,包括器官组织分类、病理报告描述生成以及病理相关问答。我们使用该数据集对多模态大模型LLaVA、Qwen-VL、InternLM进行了微调,以提高基于指令的性能。我们对基础模型和微调模型在特定数据集上执行图像描述和分类任务的能力进行了定性评估。评估结果表明,微调后的模型能够熟练地解决典型的病理学问题。我们希望通过公开我们的模型和数据集,为医学和研究界提供有价值的资源。

🔬 方法详解

问题定义:病理诊断是肿瘤识别的金标准,但依赖专家经验,效率较低。多模态大模型在病理图像分析和报告生成方面具有潜力,但现有方法面临训练成本高昂和高质量数据集稀缺的问题,阻碍了其在临床环境中的应用。

核心思路:通过指令微调(Instruction Tuning)的方式,利用大规模病理数据集,提升多模态大模型在特定病理任务上的性能。核心在于将各种病理任务转化为统一的指令形式,使模型能够更好地理解和执行这些任务。

技术框架:整体框架包括数据收集与整理、模型选择与微调、以及性能评估三个主要阶段。首先,构建包含45,000个病例的多任务数据集,涵盖器官组织分类、病理报告生成、问答等任务。然后,选择LLaVA、Qwen-VL、InternLM等模型,并使用构建的数据集进行指令微调。最后,通过定性评估,比较基础模型和微调模型在图像描述和分类任务上的性能。

关键创新:关键创新在于构建了一个大规模、多任务的病理数据集,并采用指令微调的方式,有效提升了多模态大模型在病理领域的应用能力。与传统的预训练+微调方法相比,指令微调能够使模型更好地理解和执行特定任务,从而提高性能。

关键设计:数据集包含多种病理任务,如器官组织分类、病理报告描述生成、病理相关问答等,每种任务都以指令的形式呈现。模型微调采用标准的指令微调流程,具体参数设置未知,损失函数也未知。论文侧重于数据集构建和指令微调的整体流程,未详细描述网络结构等细节。

🖼️ 关键图片

📊 实验亮点

论文通过定性评估展示了微调后的模型在解决典型病理学问题方面的熟练度。虽然没有提供具体的性能指标,但结果表明,经过指令微调,多模态模型在病理图像理解和报告生成方面取得了显著提升,为病理学的智能辅助诊断提供了有力的支持。

🎯 应用场景

该研究成果可应用于病理学的智能辅助诊断,帮助病理医生更高效、准确地进行诊断。通过自动生成病理报告、回答病理相关问题,减轻医生的工作负担,提高诊断效率。未来,该技术有望推广到其他医学影像领域,实现更广泛的智能医疗应用。

📄 摘要(原文)

Pathological diagnosis remains the definitive standard for identifying tumors. The rise of multimodal large models has simplified the process of integrating image analysis with textual descriptions. Despite this advancement, the substantial costs associated with training and deploying these complex multimodal models, together with a scarcity of high-quality training datasets, create a significant divide between cutting-edge technology and its application in the clinical setting. We had meticulously compiled a dataset of approximately 45,000 cases, covering over 6 different tasks, including the classification of organ tissues, generating pathology report descriptions, and addressing pathology-related questions and answers. We have fine-tuned multimodal large models, specifically LLaVA, Qwen-VL, InternLM, with this dataset to enhance instruction-based performance. We conducted a qualitative assessment of the capabilities of the base model and the fine-tuned model in performing image captioning and classification tasks on the specific dataset. The evaluation results demonstrate that the fine-tuned model exhibits proficiency in addressing typical pathological questions. We hope that by making both our models and datasets publicly available, they can be valuable to the medical and research communities.