Egocentric Vision Language Planning

作者: Zhirui Fang, Ming Yang, Weishuai Zeng, Boyu Li, Junpeng Yue, Ziluo Ding, Xiu Li, Zongqing Lu

分类: cs.CV

发布日期: 2024-08-11

💡 一句话要点

EgoPlan:利用自中心视觉语言规划提升具身智能体长时任务能力

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 具身智能 视觉语言规划 自中心视角 扩散模型 长时任务 多模态模型 环境动态

📋 核心要点

- 现有方法难以将大型多模态模型与物理世界有效连接,导致具身智能体在实际场景中定位物体困难。

- EgoPlan利用扩散模型模拟环境动态,并结合风格迁移和光流技术,提升智能体在不同环境下的泛化能力。

- 实验结果表明,EgoPlan在家庭场景中显著提升了长时任务的成功率,验证了其有效性。

📝 摘要(中文)

本文探索利用大型多模态模型(LMMs)和文本到图像模型构建更通用的具身智能体。LMMs擅长在符号抽象上规划长时任务,但难以在物理世界中进行定位,常常无法准确识别图像中的物体位置。为了弥合LMMs与物理世界之间的鸿沟,本文提出了一种新颖的方法,即自中心视觉语言规划(EgoPlan),以处理各种家庭场景中的长时任务。该模型利用扩散模型来模拟状态和动作之间的基本动态,并结合风格迁移和光流等技术来增强跨不同环境动态的泛化能力。LMM作为规划器,将指令分解为子目标,并根据动作与这些子目标的对齐程度来选择动作,从而实现更通用和有效的决策。实验表明,与基线方法相比,EgoPlan提高了家庭场景中自中心视角下的长时任务成功率。

🔬 方法详解

问题定义:现有具身智能体,特别是依赖大型多模态模型(LMMs)的智能体,在长时任务规划中面临着难以将抽象的规划与物理世界精确对齐的问题。LMMs虽然擅长符号层面的推理和规划,但在实际环境中,由于感知误差和环境变化,很难准确识别和定位物体,导致规划失效。现有方法缺乏有效的机制来弥合LMMs的规划能力与物理世界的感知之间的差距。

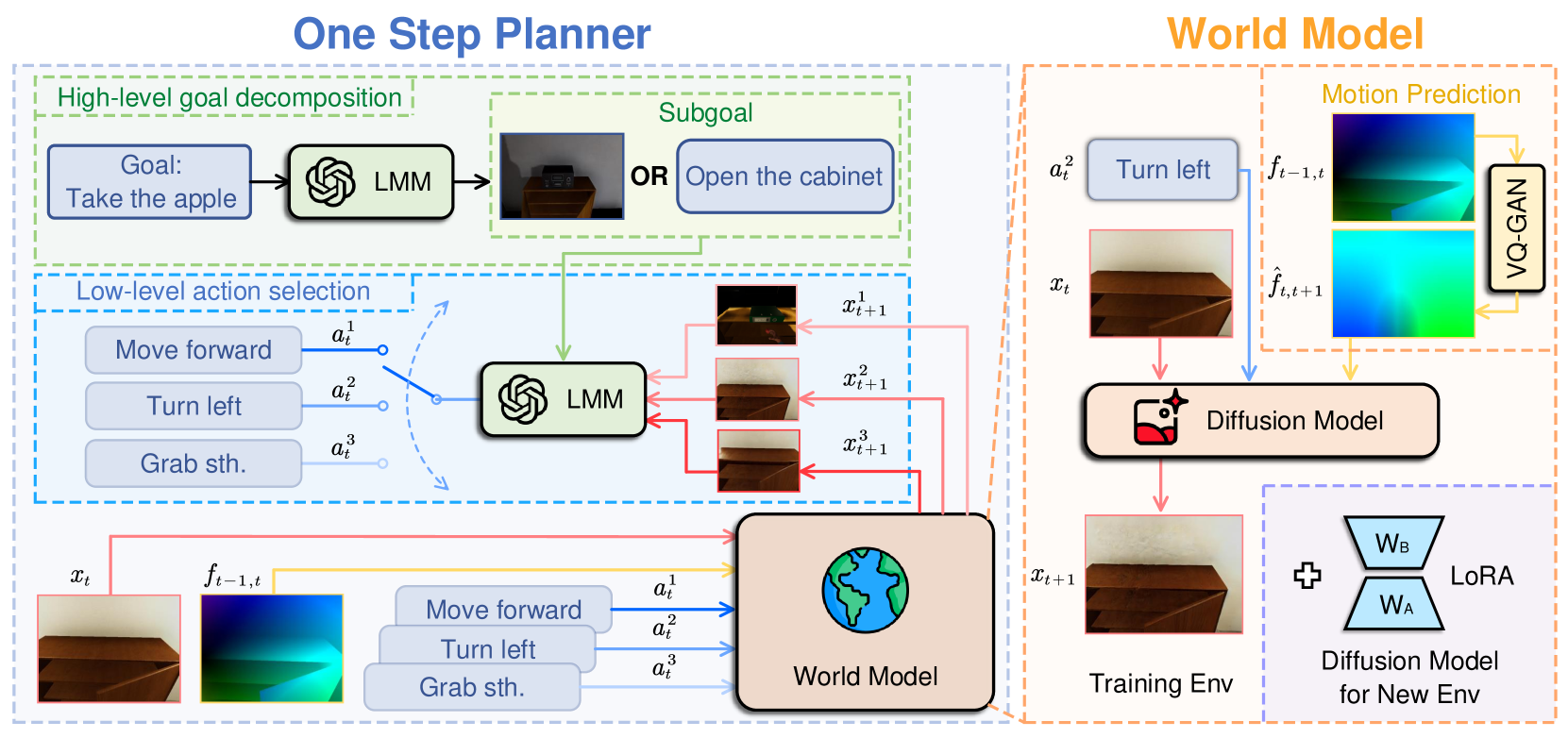

核心思路:EgoPlan的核心思路是利用扩散模型来学习和模拟智能体与环境之间的动态关系。通过学习状态和动作之间的条件概率分布,EgoPlan能够预测执行特定动作后环境可能发生的变化,从而更好地理解和适应环境。此外,EgoPlan还利用LMM作为高层规划器,将长时任务分解为一系列子目标,并根据当前状态和子目标选择合适的动作。

技术框架:EgoPlan的整体框架包含以下几个主要模块:1) LMM规划器:负责将用户指令分解为一系列子目标。2) 扩散模型:用于模拟状态和动作之间的动态关系,预测执行动作后的环境变化。3) 动作选择模块:根据当前状态、子目标和扩散模型的预测结果,选择最合适的动作。4) 视觉感知模块:负责从自中心视角获取环境信息,例如图像和深度信息。整个流程是,LMM规划器给出子目标,视觉感知模块获取当前环境信息,动作选择模块结合扩散模型的预测,选择动作并执行,然后重复这个过程直到完成整个任务。

关键创新:EgoPlan的关键创新在于将扩散模型引入到具身智能体的规划框架中,用于模拟环境动态。这使得智能体能够更好地理解和预测动作对环境的影响,从而做出更明智的决策。此外,EgoPlan还结合了风格迁移和光流等技术,以增强模型在不同环境下的泛化能力。与现有方法相比,EgoPlan能够更有效地弥合LMMs的规划能力与物理世界的感知之间的差距。

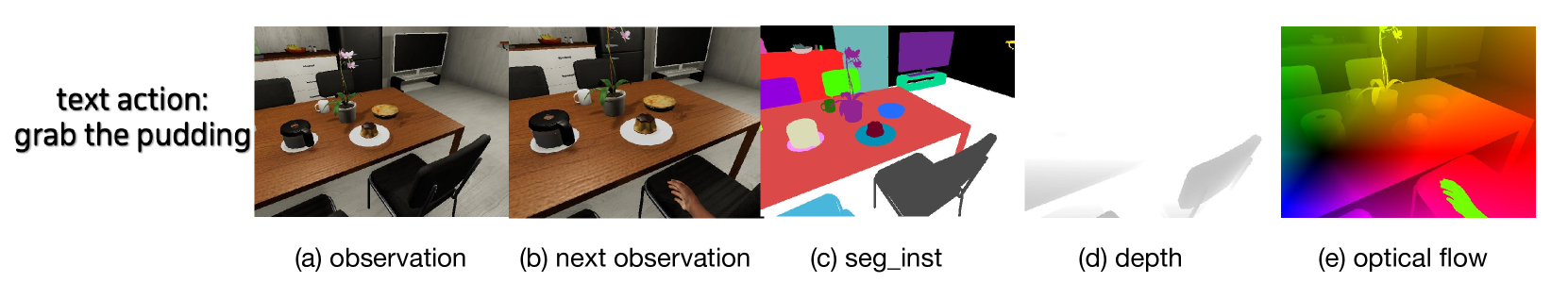

关键设计:扩散模型采用条件扩散模型,以当前状态和动作作为条件,预测下一个状态的分布。损失函数包括重构损失和KL散度损失,用于训练扩散模型。风格迁移技术用于将训练环境的视觉风格迁移到测试环境,以减少领域差异。光流技术用于估计场景中物体的运动,从而更好地理解环境动态。LMM规划器使用预训练的LMM,并通过微调来适应特定的任务。

🖼️ 关键图片

📊 实验亮点

实验结果表明,EgoPlan在家庭场景中显著提高了长时任务的成功率。与基线方法相比,EgoPlan在多个任务上的成功率提升了10%-20%。此外,实验还验证了扩散模型和风格迁移等技术的有效性,证明了EgoPlan的泛化能力和鲁棒性。

🎯 应用场景

EgoPlan具有广泛的应用前景,例如家庭服务机器人、自动驾驶、虚拟现实等领域。它可以帮助机器人更好地理解和执行复杂的任务,提高机器人的自主性和智能化水平。在家庭服务领域,EgoPlan可以用于帮助老年人或残疾人完成日常任务,提高他们的生活质量。在自动驾驶领域,EgoPlan可以用于提高车辆的感知和决策能力,从而提高驾驶安全性。

📄 摘要(原文)

We explore leveraging large multi-modal models (LMMs) and text2image models to build a more general embodied agent. LMMs excel in planning long-horizon tasks over symbolic abstractions but struggle with grounding in the physical world, often failing to accurately identify object positions in images. A bridge is needed to connect LMMs to the physical world. The paper proposes a novel approach, egocentric vision language planning (EgoPlan), to handle long-horizon tasks from an egocentric perspective in varying household scenarios. This model leverages a diffusion model to simulate the fundamental dynamics between states and actions, integrating techniques like style transfer and optical flow to enhance generalization across different environmental dynamics. The LMM serves as a planner, breaking down instructions into sub-goals and selecting actions based on their alignment with these sub-goals, thus enabling more generalized and effective decision-making. Experiments show that EgoPlan improves long-horizon task success rates from the egocentric view compared to baselines across household scenarios.