Scene123: One Prompt to 3D Scene Generation via Video-Assisted and Consistency-Enhanced MAE

作者: Yiying Yang, Fukun Yin, Jiayuan Fan, Xin Chen, Wanzhang Li, Gang Yu

分类: cs.CV

发布日期: 2024-08-10 (更新: 2024-08-20)

备注: arXiv admin note: text overlap with arXiv:2305.11588 by other authors

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

Scene123:通过视频辅助和一致性增强的MAE实现单提示3D场景生成

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 3D场景生成 视频生成 隐式神经场 掩码自编码器 视图一致性 单提示生成 AIGC

📋 核心要点

- 现有方法难以从单一输入生成具有视图一致性的大规模逼真场景。

- Scene123利用视频生成框架保证真实性和多样性,并结合MAE和隐式神经场增强视图一致性。

- 实验结果表明,Scene123能够从单个提示生成逼真且一致的场景,优于现有方法。

📝 摘要(中文)

随着人工智能生成内容(AIGC)的进步,各种方法被开发出来,用于从单个或多模态输入生成文本、图像、视频和3D对象,为模拟类人认知内容创作做出了贡献。然而,由于确保模型生成的外推视图之间的一致性的复杂性,从单个输入生成逼真的大规模场景仍然是一个挑战。受益于最新的视频生成模型和隐式神经表示,我们提出了Scene123,一种3D场景生成模型,它不仅通过视频生成框架确保了真实性和多样性,而且使用隐式神经场结合掩码自编码器(MAE)来有效地确保跨视图的未见区域的一致性。具体来说,我们首先扭曲输入图像(或从文本生成的图像)以模拟相邻视图,用MAE模型填充不可见区域。然而,这些填充的图像通常无法保持视图一致性,因此我们利用生成的视图来优化神经辐射场,从而增强几何一致性。此外,为了进一步增强生成视图的细节和纹理保真度,我们采用基于GAN的损失来对抗通过视频生成模型从输入图像导出的图像。大量的实验表明,我们的方法可以从单个提示生成逼真且一致的场景。定性和定量结果都表明,我们的方法优于现有的最先进方法。

🔬 方法详解

问题定义:现有方法在从单一图像或文本提示生成3D场景时,难以保证不同视角下场景的一致性。尤其是在填充未见区域时,容易出现几何和纹理上的不协调,导致生成结果不真实。现有方法通常难以兼顾场景的真实性、多样性和一致性。

核心思路:Scene123的核心思路是利用视频生成模型来辅助3D场景的生成,并结合Masked Autoencoders (MAE) 和隐式神经场(Neural Radiance Fields, NeRF)来增强视图一致性。通过视频生成模型,可以从单一图像生成多个视角下的图像,从而为NeRF的训练提供更多的数据。MAE用于填充未见区域,而NeRF则用于优化场景的几何结构和纹理,最终生成一致的3D场景。

技术框架:Scene123的整体框架包含以下几个主要步骤:1) 输入图像或文本提示;2) 利用视频生成模型生成多个视角下的图像;3) 使用MAE填充未见区域;4) 利用生成的图像训练NeRF;5) 使用GAN-based Loss进一步提升图像质量和细节。

关键创新:Scene123的关键创新在于将视频生成模型、MAE和NeRF结合起来,从而有效地解决了单视角3D场景生成中的一致性问题。具体来说,利用视频生成模型来提供多视角信息,利用MAE来填充未见区域,并利用NeRF来优化场景的几何结构和纹理。这种结合使得Scene123能够生成更加逼真和一致的3D场景。

关键设计:在技术细节上,Scene123使用了预训练的视频生成模型,例如Stable Diffusion。MAE的训练目标是重建被遮蔽的图像区域。NeRF的训练目标是最小化渲染图像与生成图像之间的差异。GAN-based Loss则用于提升生成图像的细节和纹理保真度。具体的损失函数包括L1 loss, perceptual loss, 和 adversarial loss。

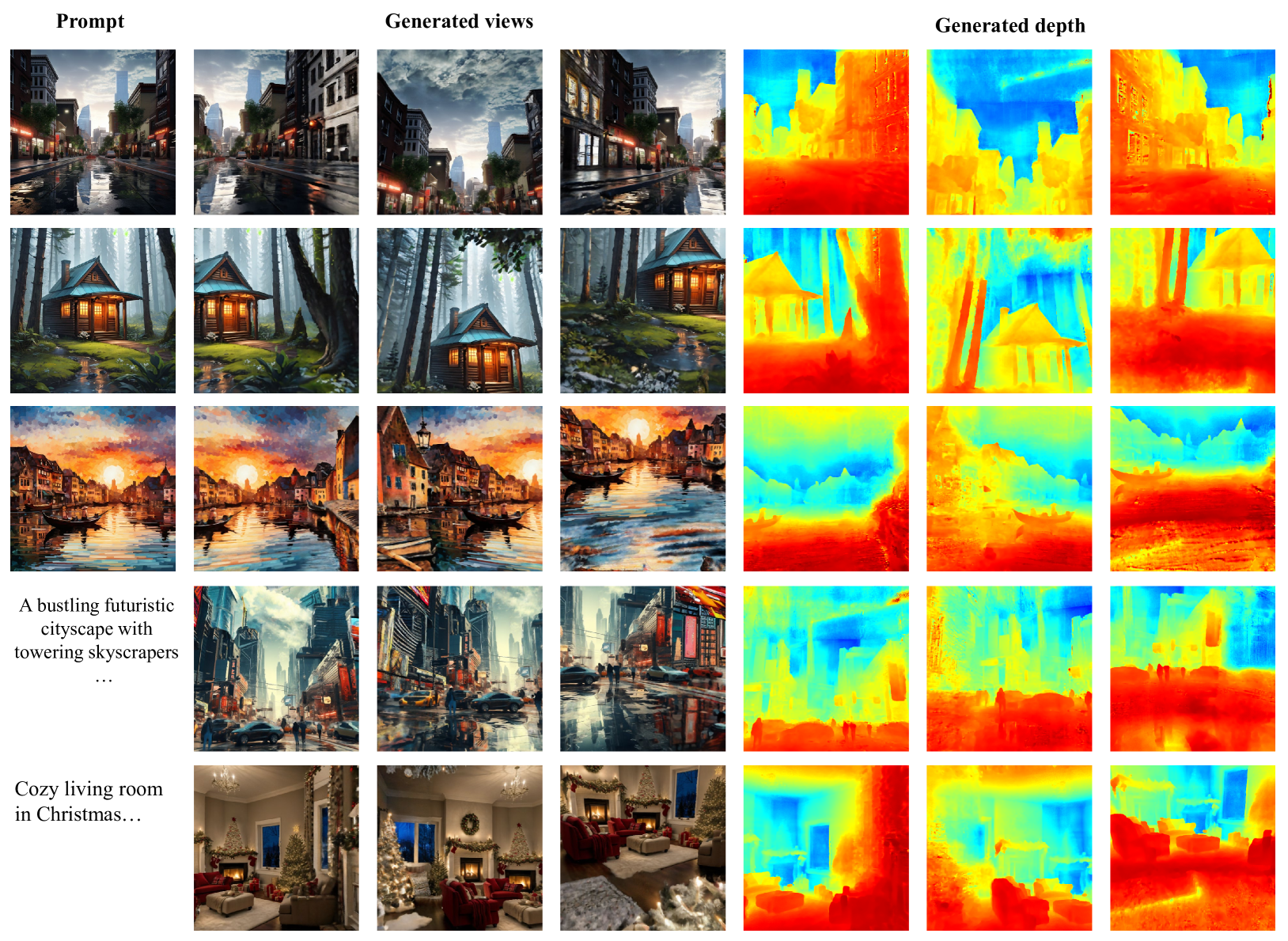

🖼️ 关键图片

📊 实验亮点

Scene123在多个数据集上进行了实验,结果表明,该方法能够生成逼真且一致的3D场景,优于现有的最先进方法。具体来说,Scene123在生成场景的真实性、多样性和一致性方面都取得了显著的提升。定性和定量结果都表明,Scene123能够生成更加逼真和一致的3D场景。

🎯 应用场景

Scene123具有广泛的应用前景,包括虚拟现实、增强现实、游戏开发、电影制作等领域。它可以用于快速生成逼真的3D场景,从而降低内容创作的成本和时间。此外,Scene123还可以用于教育和培训领域,例如,可以用于生成虚拟的教学场景,从而提高学习效果。未来,该技术有望应用于自动驾驶、机器人导航等领域,为这些领域提供更加逼真的环境模拟。

📄 摘要(原文)

As Artificial Intelligence Generated Content (AIGC) advances, a variety of methods have been developed to generate text, images, videos, and 3D objects from single or multimodal inputs, contributing efforts to emulate human-like cognitive content creation. However, generating realistic large-scale scenes from a single input presents a challenge due to the complexities involved in ensuring consistency across extrapolated views generated by models. Benefiting from recent video generation models and implicit neural representations, we propose Scene123, a 3D scene generation model, that not only ensures realism and diversity through the video generation framework but also uses implicit neural fields combined with Masked Autoencoders (MAE) to effectively ensures the consistency of unseen areas across views. Specifically, we initially warp the input image (or an image generated from text) to simulate adjacent views, filling the invisible areas with the MAE model. However, these filled images usually fail to maintain view consistency, thus we utilize the produced views to optimize a neural radiance field, enhancing geometric consistency. Moreover, to further enhance the details and texture fidelity of generated views, we employ a GAN-based Loss against images derived from the input image through the video generation model. Extensive experiments demonstrate that our method can generate realistic and consistent scenes from a single prompt. Both qualitative and quantitative results indicate that our approach surpasses existing state-of-the-art methods. We show encourage video examples at https://yiyingyang12.github.io/Scene123.github.io/.