A Recurrent YOLOv8-based framework for Event-Based Object Detection

作者: Diego A. Silva, Kamilya Smagulova, Ahmed Elsheikh, Mohammed E. Fouda, Ahmed M. Eltawil

分类: cs.CV, cs.AI

发布日期: 2024-08-09

💡 一句话要点

提出基于循环YOLOv8的事件相机目标检测框架ReYOLOv8,提升在高速运动和极端光照条件下的检测性能。

🎯 匹配领域: 支柱八:物理动画 (Physics-based Animation)

关键词: 事件相机 目标检测 循环神经网络 YOLOv8 时空建模 数据增强 低延迟 自动驾驶

📋 核心要点

- 传统RGB传感器在高速运动和极端光照条件下表现不佳,限制了自动驾驶和机器人等应用。

- ReYOLOv8通过循环神经网络建模事件数据的时空信息,并设计了低延迟编码和数据增强方法。

- 实验表明,ReYOLOv8在GEN1和PEDRo数据集上均显著提升了目标检测精度和速度,并降低了模型大小。

📝 摘要(中文)

本文提出了一种名为ReYOLOv8的先进目标检测框架,该框架通过时空建模能力增强了领先的基于帧的目标检测系统。该方法实现了一种低延迟、内存高效的事件数据编码方法,以提升系统性能。此外,还开发了一种新颖的数据增强技术,旨在利用事件数据的独特属性,从而提高检测精度。在GEN1数据集(专注于汽车应用)上,ReYOLOv8模型优于所有可比方法,在nano、small和medium尺度上分别实现了5%、2.8%和2.5%的平均精度均值(mAP)提升。这些改进是在平均减少4.43%的可训练参数数量,并保持9.2ms到15.5ms的实时处理速度的情况下实现的。在针对机器人应用的PEDRo数据集上,ReYOLOv8模型显示出9%到18%的mAP提升,模型尺寸缩小了14.5倍和3.8倍,平均速度提高了1.67倍。

🔬 方法详解

问题定义:传统基于帧的RGB传感器在高速运动和极端光照条件下容易出现运动模糊和性能下降的问题,这限制了它们在自动驾驶和机器人等领域的应用。事件相机作为一种新兴的传感器,能够克服这些问题,但如何有效地利用事件数据进行目标检测仍然是一个挑战。现有方法通常难以兼顾检测精度、速度和模型大小。

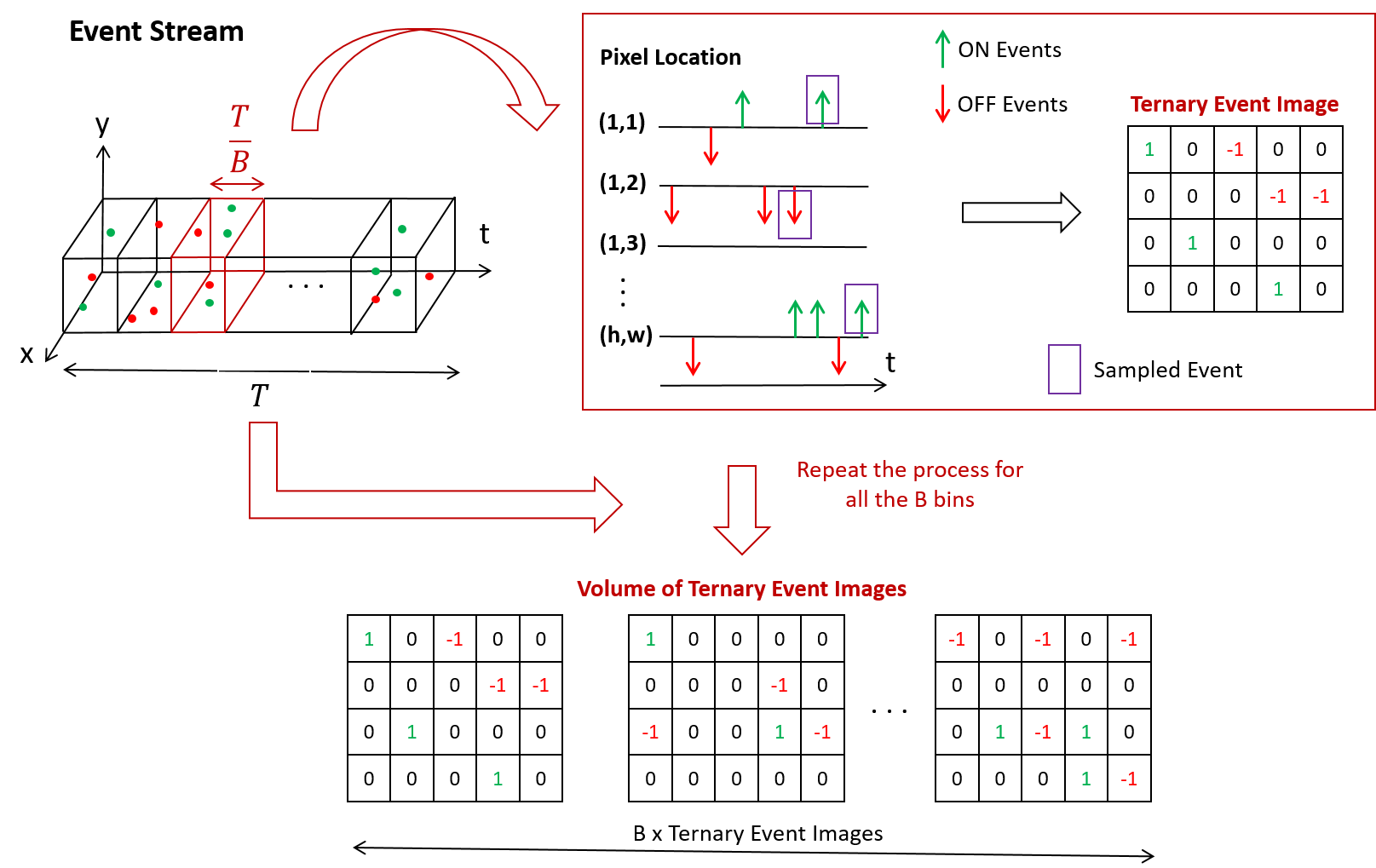

核心思路:ReYOLOv8的核心思路是将事件数据编码为时空特征,并利用循环神经网络(RNN)对这些特征进行建模,从而捕捉事件之间的时序关系。通过这种方式,ReYOLOv8能够更好地利用事件数据的信息,提高目标检测的精度和鲁棒性。此外,论文还设计了低延迟的事件数据编码方法和针对事件数据的增强策略,进一步提升了性能。

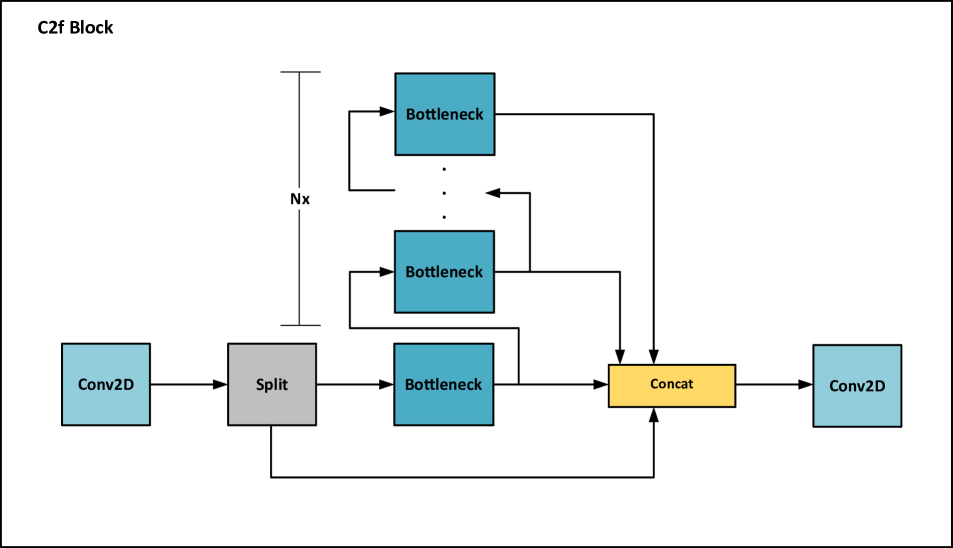

技术框架:ReYOLOv8框架基于YOLOv8目标检测器,并对其进行了改进以适应事件数据。整体流程如下:1) 事件数据被编码为时空特征表示;2) 这些特征被输入到循环神经网络中,以捕捉时序信息;3) RNN的输出被输入到YOLOv8检测器中,以预测目标的位置和类别。该框架包含事件编码模块、循环神经网络模块和YOLOv8检测模块。

关键创新:ReYOLOv8的关键创新在于将循环神经网络引入到事件相机的目标检测中,从而能够有效地利用事件数据的时序信息。此外,论文还提出了一种低延迟、内存高效的事件数据编码方法,以及一种针对事件数据的增强策略。这些创新使得ReYOLOv8在精度、速度和模型大小方面都优于现有方法。

关键设计:事件编码模块采用了一种基于体素的方法,将事件数据划分为小的体素,并统计每个体素内的事件数量。循环神经网络模块采用了GRU结构,以捕捉事件之间的时序关系。数据增强策略包括事件翻转、事件噪声添加等。损失函数采用了YOLOv8的损失函数,包括分类损失、回归损失和置信度损失。

🖼️ 关键图片

📊 实验亮点

ReYOLOv8在GEN1数据集上,相比其他方法,在nano、small和medium尺度上分别实现了5%、2.8%和2.5%的mAP提升。在PEDRo数据集上,ReYOLOv8实现了9%到18%的mAP提升,模型尺寸缩小了14.5倍和3.8倍,平均速度提高了1.67倍。这些结果表明,ReYOLOv8在精度、速度和模型大小方面都具有显著优势。

🎯 应用场景

ReYOLOv8在自动驾驶、机器人、无人机等领域具有广泛的应用前景。在自动驾驶中,ReYOLOv8可以用于检测车辆、行人、交通标志等目标,提高自动驾驶系统的安全性。在机器人领域,ReYOLOv8可以用于目标识别、物体抓取等任务,提高机器人的智能化水平。此外,ReYOLOv8还可以应用于安防监控、工业检测等领域,具有重要的实际价值和未来影响。

📄 摘要(原文)

Object detection is crucial in various cutting-edge applications, such as autonomous vehicles and advanced robotics systems, primarily relying on data from conventional frame-based RGB sensors. However, these sensors often struggle with issues like motion blur and poor performance in challenging lighting conditions. In response to these challenges, event-based cameras have emerged as an innovative paradigm. These cameras, mimicking the human eye, demonstrate superior performance in environments with fast motion and extreme lighting conditions while consuming less power. This study introduces ReYOLOv8, an advanced object detection framework that enhances a leading frame-based detection system with spatiotemporal modeling capabilities. We implemented a low-latency, memory-efficient method for encoding event data to boost the system's performance. We also developed a novel data augmentation technique tailored to leverage the unique attributes of event data, thus improving detection accuracy. Our models outperformed all comparable approaches in the GEN1 dataset, focusing on automotive applications, achieving mean Average Precision (mAP) improvements of 5%, 2.8%, and 2.5% across nano, small, and medium scales, respectively.These enhancements were achieved while reducing the number of trainable parameters by an average of 4.43% and maintaining real-time processing speeds between 9.2ms and 15.5ms. On the PEDRo dataset, which targets robotics applications, our models showed mAP improvements ranging from 9% to 18%, with 14.5x and 3.8x smaller models and an average speed enhancement of 1.67x.