Compact 3D Gaussian Splatting for Static and Dynamic Radiance Fields

作者: Joo Chan Lee, Daniel Rho, Xiangyu Sun, Jong Hwan Ko, Eunbyung Park

分类: cs.CV

发布日期: 2024-08-07

备注: Project page: https://maincold2.github.io/c3dgs/

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

提出紧凑型3D高斯溅射,用于静态和动态辐射场的压缩与加速。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 辐射场 模型压缩 神经渲染 向量量化 动态场景 实时渲染

📋 核心要点

- 现有3D高斯溅射方法需要大量高斯点以保证渲染质量,导致存储和计算成本高昂。

- 提出可学习掩码策略减少高斯点数量,并使用网格神经场和残差向量量化压缩高斯属性。

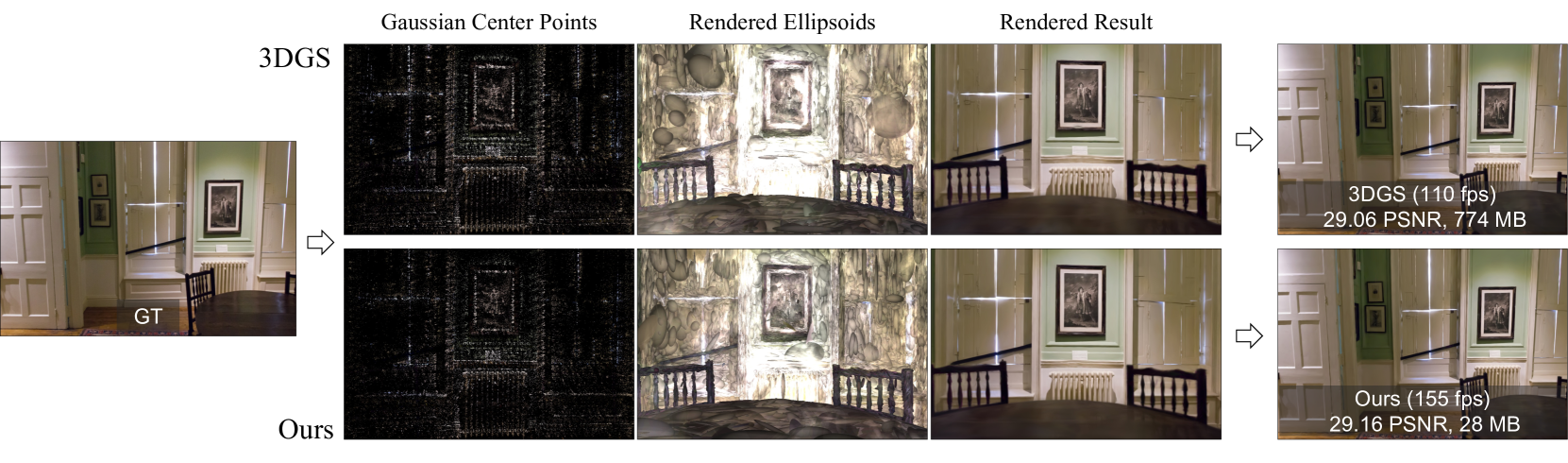

- 实验表明,该方法在静态场景下存储减少25倍以上,动态场景下减少12倍以上,同时保持高质量重建。

📝 摘要(中文)

3D高斯溅射(3DGS)作为一种新兴的表示方法,利用基于3D高斯的表示和近似的体渲染,实现了极快的渲染速度和良好的图像质量。后续研究已成功将3DGS扩展到动态3D场景。然而,3DGS及其后续方法需要大量的Gaussian点来维持渲染图像的高保真度,这导致了大量的内存和存储需求。为了解决这个问题,本文着重于两个关键目标:在不牺牲性能的情况下减少Gaussian点的数量,以及压缩Gaussian属性,如视角相关的颜色和协方差。为此,我们提出了一种可学习的掩码策略,该策略在保持高性能的同时显著减少了Gaussian的数量。此外,我们通过采用基于网格的神经场而不是依赖球谐函数,提出了一种紧凑但有效的视角相关颜色表示方法。最后,我们学习码本,通过残差向量量化来紧凑地表示几何和时间属性。通过量化和熵编码等模型压缩技术,我们始终如一地展示了相比于静态场景的3DGS,存储减少超过25倍,渲染速度得到提升,同时保持了场景表示的质量。对于动态场景,我们的方法实现了超过12倍的存储效率,并保持了与现有最先进方法相比的高质量重建。我们的工作为3D场景表示提供了一个全面的框架,实现了高性能、快速训练、紧凑性和实时渲染。

🔬 方法详解

问题定义:现有3D高斯溅射方法在表示静态和动态场景时,需要大量的3D高斯基元,导致存储空间占用大,渲染速度慢。尤其是在高分辨率场景下,这个问题更加突出。因此,如何减少高斯基元的数量,同时保持渲染质量,是本文要解决的核心问题。现有方法的痛点在于高斯基元数量与渲染质量之间的trade-off,以及高斯属性(如颜色和协方差)的存储效率。

核心思路:本文的核心思路是通过引入可学习的掩码策略来减少不重要的高斯基元,并采用更紧凑的表示方法来压缩高斯属性。具体来说,使用可学习掩码来动态地选择需要保留的高斯基元,避免了简单粗暴的剔除。同时,使用基于网格的神经场来表示视角相关的颜色,替代了传统的球谐函数,从而减少了颜色信息的存储量。此外,采用残差向量量化来压缩几何和时间属性,进一步降低了存储需求。这样设计的目的是在尽可能减少信息损失的前提下,实现高压缩率和快速渲染。

技术框架:该方法主要包含以下几个模块:1) 高斯基元初始化:使用传统方法初始化3D高斯基元。2) 可学习掩码:引入一个可学习的掩码网络,用于预测每个高斯基元的重要性,并根据重要性动态地选择需要保留的高斯基元。3) 视角相关颜色表示:使用基于网格的神经场来表示视角相关的颜色,替代了传统的球谐函数。4) 几何和时间属性压缩:采用残差向量量化来压缩几何和时间属性。5) 渲染:使用优化的渲染管线进行快速渲染。

关键创新:本文最重要的技术创新点在于:1) 可学习掩码策略:通过学习的方式动态地选择需要保留的高斯基元,避免了手动设置阈值或简单剔除带来的信息损失。2) 基于网格的神经场颜色表示:相比于传统的球谐函数,基于网格的神经场能够更紧凑地表示视角相关的颜色信息。3) 残差向量量化:通过残差向量量化,可以有效地压缩几何和时间属性,进一步降低存储需求。与现有方法的本质区别在于,本文的方法更加注重高斯基元的选择和属性的压缩,从而在保证渲染质量的前提下,实现了更高的压缩率和更快的渲染速度。

关键设计:1) 掩码网络结构:掩码网络可以使用简单的MLP结构,输入高斯基元的属性,输出一个介于0和1之间的重要性得分。2) 损失函数:损失函数包括渲染损失、掩码正则化损失和量化损失。渲染损失用于保证渲染质量,掩码正则化损失用于鼓励掩码的稀疏性,量化损失用于保证量化后的属性能够较好地重建原始属性。3) 网格神经场结构:网格神经场可以使用小的MLP网络,输入视角方向和网格坐标,输出颜色值。4) 残差向量量化参数:码本大小和残差层数是需要仔细调整的参数,需要根据具体场景进行选择。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在静态场景下相比于3DGS,存储减少超过25倍,渲染速度得到提升,同时保持了场景表示的质量。对于动态场景,该方法实现了超过12倍的存储效率,并保持了与现有最先进方法相比的高质量重建。在多个benchmark数据集上,该方法都取得了显著的性能提升,证明了其有效性和优越性。

🎯 应用场景

该研究成果可广泛应用于虚拟现实、增强现实、游戏开发、三维重建、自动驾驶等领域。通过减少存储空间和提高渲染速度,可以使得3D场景在移动设备和嵌入式系统上实现实时渲染,从而扩展了3DGS的应用范围。未来,该技术有望应用于大规模场景的建模和渲染,例如城市级别的三维地图。

📄 摘要(原文)

3D Gaussian splatting (3DGS) has recently emerged as an alternative representation that leverages a 3D Gaussian-based representation and introduces an approximated volumetric rendering, achieving very fast rendering speed and promising image quality. Furthermore, subsequent studies have successfully extended 3DGS to dynamic 3D scenes, demonstrating its wide range of applications. However, a significant drawback arises as 3DGS and its following methods entail a substantial number of Gaussians to maintain the high fidelity of the rendered images, which requires a large amount of memory and storage. To address this critical issue, we place a specific emphasis on two key objectives: reducing the number of Gaussian points without sacrificing performance and compressing the Gaussian attributes, such as view-dependent color and covariance. To this end, we propose a learnable mask strategy that significantly reduces the number of Gaussians while preserving high performance. In addition, we propose a compact but effective representation of view-dependent color by employing a grid-based neural field rather than relying on spherical harmonics. Finally, we learn codebooks to compactly represent the geometric and temporal attributes by residual vector quantization. With model compression techniques such as quantization and entropy coding, we consistently show over 25x reduced storage and enhanced rendering speed compared to 3DGS for static scenes, while maintaining the quality of the scene representation. For dynamic scenes, our approach achieves more than 12x storage efficiency and retains a high-quality reconstruction compared to the existing state-of-the-art methods. Our work provides a comprehensive framework for 3D scene representation, achieving high performance, fast training, compactness, and real-time rendering. Our project page is available at https://maincold2.github.io/c3dgs/.