Openstory++: A Large-scale Dataset and Benchmark for Instance-aware Open-domain Visual Storytelling

作者: Zilyu Ye, Jinxiu Liu, Ruotian Peng, Jinjin Cao, Zhiyang Chen, Yiyang Zhang, Ziwei Xuan, Mingyuan Zhou, Xiaoqian Shen, Mohamed Elhoseiny, Qi Liu, Guo-Jun Qi

分类: cs.CV

发布日期: 2024-08-07

💡 一句话要点

Openstory++:大规模实例感知开放域视觉故事数据集与评测基准

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉故事生成 实例感知 开放域 多模态学习 图像生成 长上下文 数据集 基准测试

📋 核心要点

- 现有图像生成模型在长上下文场景下,难以维持多个实例在图像间的一致性,主要原因是缺乏细粒度的实例特征标注。

- Openstory++数据集通过引入实例级别的标注,并结合图像和文本,以及实体为中心的图像-文本生成训练方法,来解决上述问题。

- Cohere-Bench基准测试表明,Openstory++能够有效提升视觉故事模型的质量,增强其在开放域生成任务中的表现。

📝 摘要(中文)

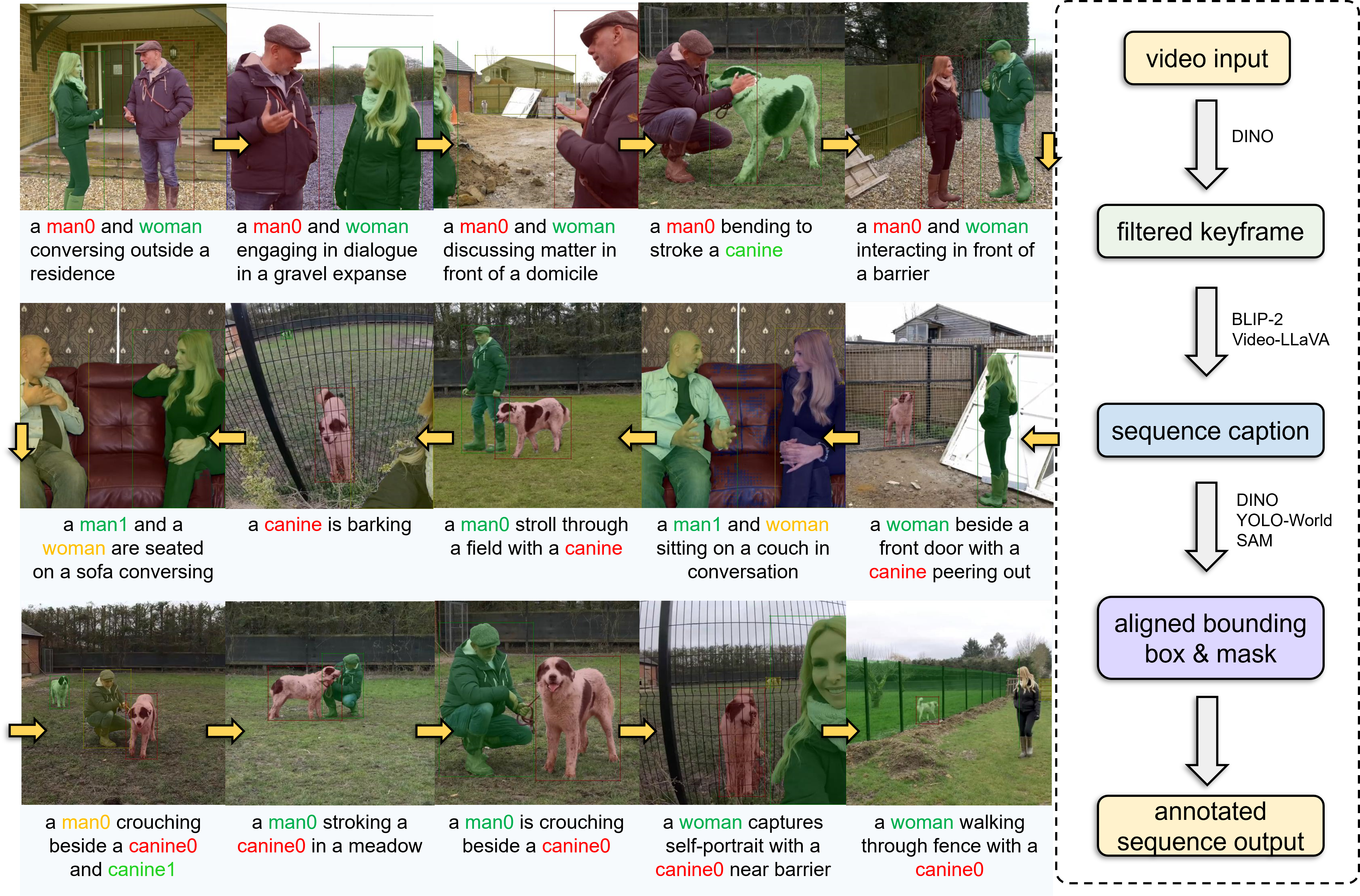

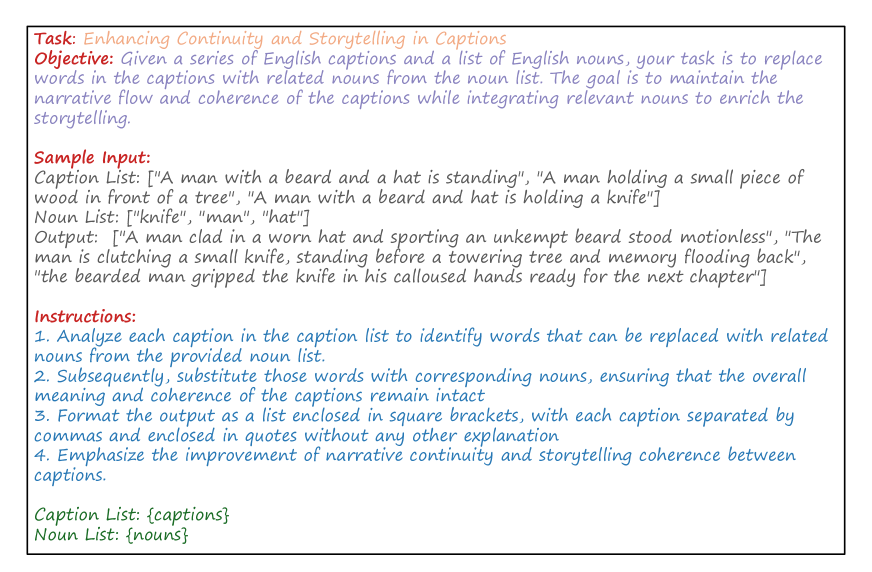

本文提出了Openstory++,一个大规模数据集,它结合了额外的实例级别标注以及图像和文本,旨在解决现有图像生成模型在处理长上下文时,无法保持多个实例在图像之间一致性的问题。此外,本文还开发了一种训练方法,强调以实体为中心的图像-文本生成,确保模型学习有效地交织视觉和文本信息。Openstory++简化了从开放域视频中提取关键帧的过程,利用视觉-语言模型生成字幕,然后由大型语言模型进行润色以实现叙事连贯性。它超越了以往的数据集,提供了一个更广阔的开放域资源,该资源结合了自动字幕、针对实例计数量身定制的高分辨率图像以及用于时间一致性的广泛帧序列。此外,本文提出了Cohere-Bench,这是一个用于评估在提供长多模态上下文时图像生成任务的开创性基准框架,包括保持给定上下文中背景、风格和实例一致性的能力。实验表明,Openstory++在培养高质量视觉故事模型方面具有优越性,增强了它们解决开放域生成任务的能力。

🔬 方法详解

问题定义:现有图像生成模型在处理具有长上下文的视觉故事时,难以保持图像中多个实例的一致性。例如,在多张图像中,同一个人或物体可能出现外观不一致的情况。这是因为现有的训练数据集缺乏细粒度的实例级别标注,导致模型无法有效学习和追踪各个实例的特征。

核心思路:本文的核心思路是构建一个包含丰富实例级别标注的大规模数据集Openstory++,并设计一种以实体为中心的图像-文本生成训练方法。通过显式地标注图像中的各个实例,并鼓励模型关注和保持这些实例在不同图像中的一致性,从而提高视觉故事生成的质量。

技术框架:Openstory++的构建流程包括以下几个主要阶段:1) 从开放域视频中提取关键帧;2) 利用视觉-语言模型为关键帧生成初始字幕;3) 使用大型语言模型对字幕进行润色,以保证叙事连贯性;4) 对图像和文本进行实例级别的标注。训练阶段采用以实体为中心的图像-文本生成方法,鼓励模型学习实例特征,并保持实例在不同图像中的一致性。Cohere-Bench基准测试用于评估模型在长多模态上下文下的图像生成能力。

关键创新:Openstory++数据集的关键创新在于其大规模和细粒度的实例级别标注。与以往的数据集相比,Openstory++提供了更丰富的实例信息,使得模型能够更好地学习和理解视觉故事中的实体关系。此外,Cohere-Bench基准测试提供了一个统一的评估框架,用于衡量模型在长多模态上下文下的图像生成能力,包括背景、风格和实例的一致性。

关键设计:Openstory++数据集包含高分辨率图像和长帧序列,以支持实例计数和时间一致性建模。在训练过程中,可以采用对比学习等方法,鼓励模型学习实例特征的表示。损失函数可以设计为包括图像生成损失、文本生成损失和实例一致性损失等,以共同优化模型的性能。具体的网络结构可以采用Transformer等常用的图像和文本生成模型,并根据需要进行修改和扩展。

🖼️ 关键图片

📊 实验亮点

Openstory++数据集在Cohere-Bench基准测试中表现出色,证明了其在培养高质量视觉故事模型方面的优越性。实验结果表明,使用Openstory++训练的模型能够更好地保持图像中实例的一致性,生成更连贯和自然的视觉故事。具体的性能数据和对比基线信息可在论文原文和项目网站上找到。

🎯 应用场景

该研究成果可应用于多个领域,包括:智能故事创作、教育娱乐、虚拟现实、游戏开发等。通过生成具有一致性和连贯性的视觉故事,可以为用户提供更丰富的交互体验和更具吸引力的内容。未来,该技术有望应用于自动化内容生成、个性化推荐等领域,具有广阔的应用前景。

📄 摘要(原文)

Recent image generation models excel at creating high-quality images from brief captions. However, they fail to maintain consistency of multiple instances across images when encountering lengthy contexts. This inconsistency is largely due to in existing training datasets the absence of granular instance feature labeling in existing training datasets. To tackle these issues, we introduce Openstory++, a large-scale dataset combining additional instance-level annotations with both images and text. Furthermore, we develop a training methodology that emphasizes entity-centric image-text generation, ensuring that the models learn to effectively interweave visual and textual information. Specifically, Openstory++ streamlines the process of keyframe extraction from open-domain videos, employing vision-language models to generate captions that are then polished by a large language model for narrative continuity. It surpasses previous datasets by offering a more expansive open-domain resource, which incorporates automated captioning, high-resolution imagery tailored for instance count, and extensive frame sequences for temporal consistency. Additionally, we present Cohere-Bench, a pioneering benchmark framework for evaluating the image generation tasks when long multimodal context is provided, including the ability to keep the background, style, instances in the given context coherent. Compared to existing benchmarks, our work fills critical gaps in multi-modal generation, propelling the development of models that can adeptly generate and interpret complex narratives in open-domain environments. Experiments conducted within Cohere-Bench confirm the superiority of Openstory++ in nurturing high-quality visual storytelling models, enhancing their ability to address open-domain generation tasks. More details can be found at https://openstorypp.github.io/