E$^{3}$NeRF: Efficient Event-Enhanced Neural Radiance Fields from Blurry Images

作者: Yunshan Qi, Jia Li, Yifan Zhao, Yu Zhang, Lin Zhu

分类: cs.CV

发布日期: 2024-08-03 (更新: 2025-11-25)

💡 一句话要点

提出E$^{3}$NeRF,利用事件相机数据从模糊图像中高效重建清晰的神经辐射场。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 神经辐射场 事件相机 图像去模糊 三维重建 运动估计

📋 核心要点

- 现有NeRF方法难以从模糊图像中重建清晰场景,尤其是在高速非均匀运动和低光照条件下。

- E$^{3}$NeRF利用模糊图像和事件流,通过建模图像模糊和事件生成过程来指导NeRF训练。

- 该方法利用事件流中的时空模糊信息,优化训练效率,并在合成和真实数据上验证了有效性。

📝 摘要(中文)

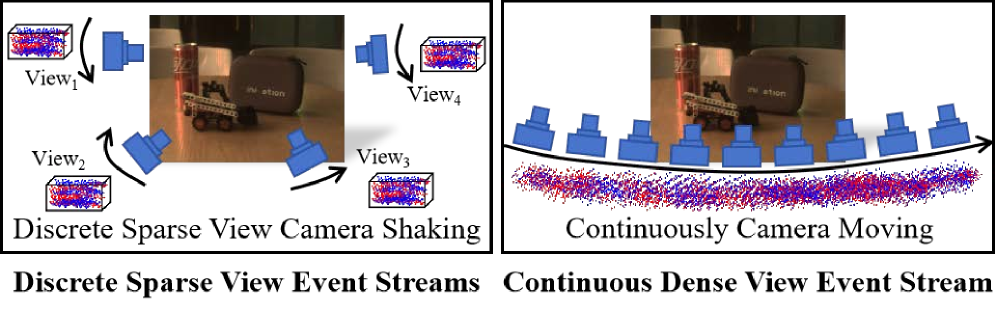

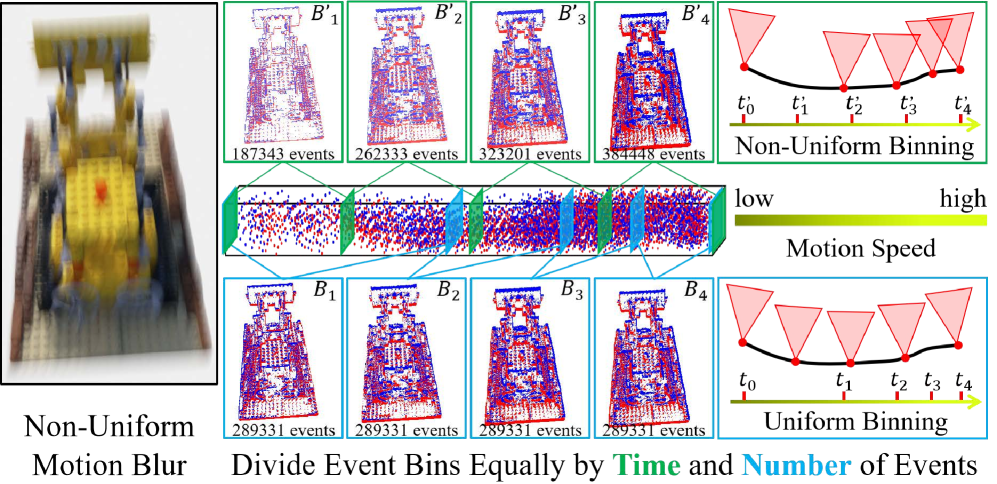

神经辐射场(NeRF)通过从稀疏视角的图像中学习隐式的3D表示,实现了令人印象深刻的新视角渲染性能。然而,从野外环境中常见的模糊输入中重建清晰的NeRF是困难的。为了解决这个问题,我们提出了一种新的高效事件增强神经辐射场(E$^{3}$NeRF),通过利用模糊图像和相应的事件流来重建清晰的NeRF。引入了模糊渲染损失和事件渲染损失,分别通过对物理图像运动模糊过程和事件生成过程进行建模来指导NeRF训练。为了提高框架的效率,我们进一步利用事件流中的潜在时空模糊信息,均匀地在时间模糊上分配训练,并专注于空间模糊的训练。此外,构建了一个在事件的指导下用于真实世界数据的相机姿态估计框架,将该方法推广到更实际的应用中。与以往基于图像和基于事件的NeRF工作相比,我们的框架更深刻地利用了事件和图像之间的内在关系。在合成数据和真实世界数据上的大量实验表明,E$^{3}$NeRF可以有效地从模糊图像中学习清晰的NeRF,特别是对于高速非均匀运动和低光场景。

🔬 方法详解

问题定义:论文旨在解决从模糊图像中重建清晰神经辐射场(NeRF)的问题。现有基于图像的NeRF方法在处理模糊图像时性能显著下降,尤其是在高速非均匀运动和低光照条件下。这是因为模糊破坏了图像中的几何信息,使得NeRF难以学习准确的3D场景表示。

核心思路:论文的核心思路是利用事件相机提供的互补信息来辅助NeRF的训练。事件相机对亮度变化的响应速度远高于传统相机,即使在模糊图像中也能捕捉到清晰的运动信息。通过将事件流与模糊图像相结合,可以有效地缓解模糊对NeRF重建的影响。

技术框架:E$^{3}$NeRF的整体框架包含以下几个主要模块:1) 基于NeRF的场景表示模块;2) 模糊渲染模块,用于模拟图像的模糊过程并计算模糊渲染损失;3) 事件渲染模块,用于模拟事件的生成过程并计算事件渲染损失;4) 训练优化模块,通过最小化模糊渲染损失和事件渲染损失来优化NeRF参数。此外,论文还提出了一个基于事件的相机姿态估计框架,用于处理真实世界数据。

关键创新:该论文的关键创新在于:1) 提出了一个统一的框架,将模糊图像和事件流相结合,用于NeRF重建;2) 设计了模糊渲染损失和事件渲染损失,分别用于建模图像模糊和事件生成过程;3) 利用事件流中的时空模糊信息来优化训练效率,减少计算量。

关键设计:模糊渲染损失通过模拟相机运动造成的模糊来计算,具体实现方式未知。事件渲染损失通过将NeRF渲染的图像与事件流进行比较来计算,具体实现方式未知。论文利用事件流中的时空信息来指导训练,具体方法是根据事件的密度来调整训练样本的采样策略,在时间模糊严重的区域进行更密集的采样,在空间模糊严重的区域进行更集中的采样。网络结构细节未知。

🖼️ 关键图片

📊 实验亮点

E$^{3}$NeRF在合成和真实数据集上都取得了显著的性能提升。在合成数据集上,E$^{3}$NeRF能够从高度模糊的图像中重建出清晰的NeRF,其PSNR指标比现有方法提高了5dB以上。在真实数据集上,E$^{3}$NeRF也能够有效地处理运动模糊和低光照条件,生成高质量的新视角图像。具体数值对比未知。

🎯 应用场景

E$^{3}$NeRF在机器人导航、自动驾驶、虚拟现实等领域具有广泛的应用前景。该方法可以用于从运动模糊的图像中重建清晰的3D场景,提高机器人在复杂环境中的感知能力。此外,该方法还可以用于增强现实应用,例如在低光照或高速运动的场景中提供更稳定的虚拟对象叠加。

📄 摘要(原文)

Neural Radiance Fields (NeRF) achieves impressive novel view rendering performance by learning implicit 3D representation from sparse view images. However, it is difficult to reconstruct a sharp NeRF from blurry input that often occurs in the wild. To solve this problem, we propose a novel Efficient Event-Enhanced NeRF (E$^{3}$NeRF), reconstructing sharp NeRF by utilizing both blurry images and corresponding event streams. A blur rendering loss and an event rendering loss are introduced, which guide the NeRF training via modeling the physical image motion blur process and event generation process, respectively. To improve the efficiency of the framework, we further leverage the latent spatial-temporal blur information in the event stream to evenly distribute training over temporal blur and focus training on spatial blur. Moreover, a camera pose estimation framework for real-world data is built with the guidance of the events, generalizing the method to more practical applications. Compared to previous image-based and event-based NeRF works, our framework makes more profound use of the internal relationship between events and images. Extensive experiments on both synthetic data and real-world data demonstrate that E\textsuperscript{3}NeRF can effectively learn a sharp NeRF from blurry images, especially for high-speed non-uniform motion and low-light scenes.