ControlMLLM: Training-Free Visual Prompt Learning for Multimodal Large Language Models

作者: Mingrui Wu, Xinyue Cai, Jiayi Ji, Jiale Li, Oucheng Huang, Gen Luo, Hao Fei, Guannan Jiang, Xiaoshuai Sun, Rongrong Ji

分类: cs.CV

发布日期: 2024-07-31 (更新: 2025-01-07)

备注: Accepted to NeurIPS 2024; Code:https://github.com/mrwu-mac/ControlMLLM

💡 一句话要点

提出ControlMLLM,通过无训练的视觉提示学习增强多模态大语言模型的指代能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大语言模型 视觉提示学习 无训练学习 注意力机制 指代理解

📋 核心要点

- 现有MLLM缺乏有效的指代能力,难以精确理解和描述图像中的特定区域。

- 通过优化可学习的潜在变量,在测试时调整视觉token,控制注意力机制,引导模型关注指代区域。

- 实验表明,该方法无需训练即可有效提升MLLM的指代能力,并具备良好的泛化性和可解释性。

📝 摘要(中文)

本文提出了一种无训练方法,通过在测试时优化可学习的潜在变量,将视觉提示注入到多模态大语言模型(MLLM)中。我们观察到,注意力机制作为MLLM的核心模块,连接了文本提示token和视觉token,最终决定了结果。我们的方法包括在测试时调整MLP输出的视觉token,控制注意力响应,以确保文本提示token关注指代区域的视觉token。我们基于能量函数优化可学习的潜在变量,增强注意力图中指代区域的强度。这使得无需大量训练成本或模型再训练即可实现详细的区域描述和推理。我们的方法为将指代能力集成到MLLM中提供了一个有希望的方向,并支持使用框、掩码、涂鸦和点进行指代。结果表明,我们的方法具有域外泛化能力和可解释性。

🔬 方法详解

问题定义:现有的多模态大语言模型(MLLM)在处理需要精确定位和描述图像特定区域的任务时表现不足,缺乏有效的指代能力。直接训练MLLM成本高昂,且难以保证泛化性。因此,如何在不进行大量训练的情况下,提升MLLM的指代能力是一个关键问题。

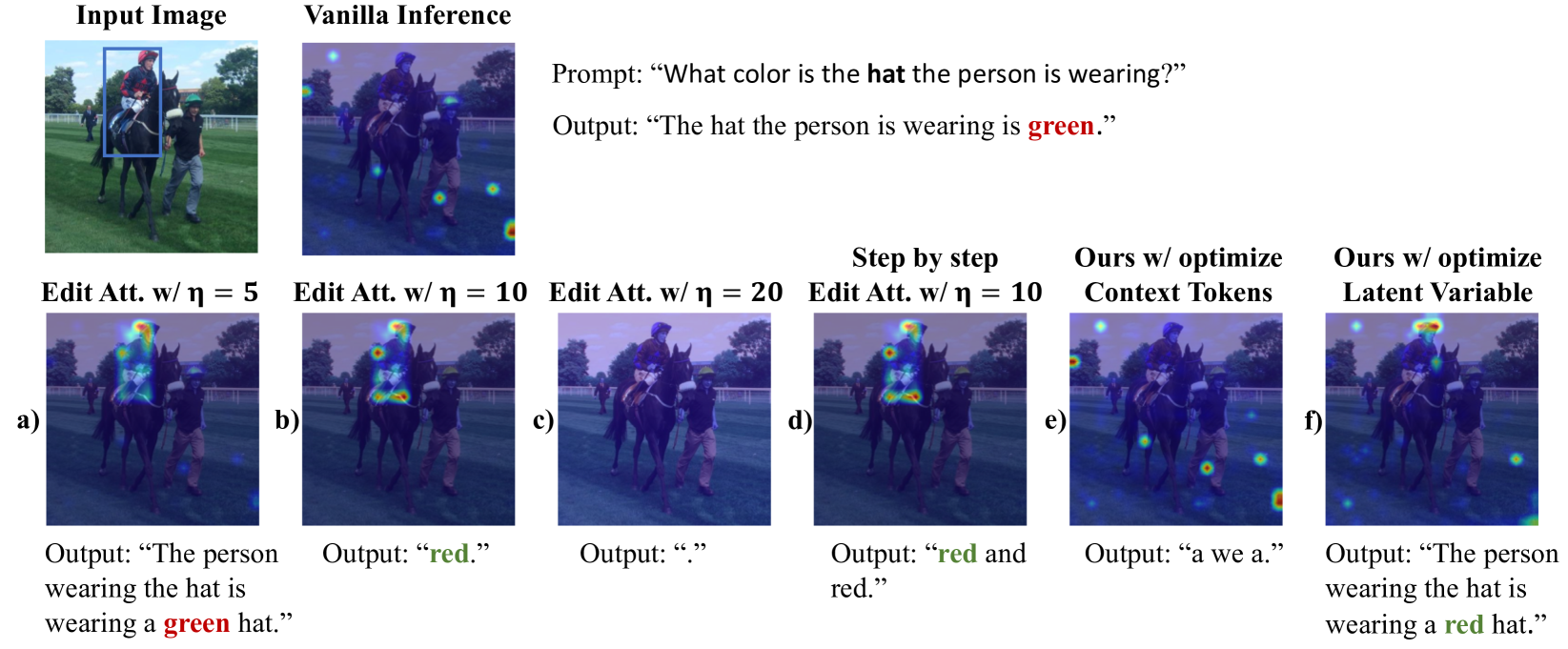

核心思路:论文的核心思路是在测试阶段,通过优化视觉token来控制MLLM的注意力机制,使得文本提示token能够更准确地关注到图像中被指代的区域。通过调整视觉token,可以增强指代区域在注意力图中的权重,从而提升模型对该区域的理解和描述能力。

技术框架:ControlMLLM方法主要包含以下几个阶段:1) 输入图像和文本提示;2) 通过MLLM提取视觉和文本特征;3) 在MLP输出的视觉token上添加可学习的潜在变量;4) 基于能量函数优化该潜在变量,目标是增强指代区域的注意力权重;5) 将调整后的视觉token输入MLLM,生成最终的描述或答案。

关键创新:该方法最重要的创新点在于提出了一种无训练的视觉提示学习方法。通过在测试时优化可学习的潜在变量,实现了对MLLM注意力机制的精细控制,从而提升了模型的指代能力。与需要大量训练数据和计算资源的微调方法相比,该方法更加高效和灵活。

关键设计:能量函数的设计是关键。该能量函数旨在最大化文本提示token对指代区域视觉token的注意力权重。具体而言,能量函数可以定义为注意力图中指代区域的平均注意力得分。优化算法采用梯度下降法,迭代更新潜在变量,直至能量函数达到最大值。此外,指代方式支持多种形式,包括框、掩码、涂鸦和点,通过不同的方式定义指代区域。

🖼️ 关键图片

📊 实验亮点

ControlMLLM在多个指代任务上取得了显著的性能提升,无需任何训练。实验结果表明,该方法在域外数据上具有良好的泛化能力,并且能够生成可解释的注意力图,验证了其有效性。例如,在指代分割任务中,该方法能够精确分割出用户指定的区域,并且优于现有的无训练方法。

🎯 应用场景

该研究成果可广泛应用于图像编辑、视觉问答、机器人导航、智能监控等领域。例如,在图像编辑中,用户可以通过文本指令精确指定需要修改的区域;在视觉问答中,模型可以更准确地理解问题中涉及的图像区域;在机器人导航中,机器人可以根据指令找到特定的目标物体。该方法降低了MLLM的应用门槛,促进了多模态交互的普及。

📄 摘要(原文)

In this work, we propose a training-free method to inject visual prompts into Multimodal Large Language Models (MLLMs) through test-time optimization of a learnable latent variable. We observe that attention, as the core module of MLLMs, connects text prompt tokens and visual tokens, ultimately determining the final results. Our approach involves adjusting visual tokens from the MLP output at test time, controlling the attention response to ensure text prompt tokens attend to visual tokens in referring regions. We optimize a learnable latent variable based on an energy function, enhancing the strength of referring regions in the attention map. This enables detailed region description and reasoning without the need for substantial training costs or model retraining. Our method offers a promising direction for integrating referring abilities into MLLMs, and supports referring with box, mask, scribble and point. The results demonstrate that our method exhibits out-of-domain generalization and interpretability.