Analysis and Improvement of Rank-Ordered Mean Algorithm in Single-Photon LiDAR

作者: William C. Yau, Weijian Zhang, Hashan Kavinga Weerasooriya, Stanley H. Chan

分类: eess.SP, cs.CV, eess.IV

发布日期: 2024-07-29

备注: 6 pages, 7 figures, submitted to the IEEE 26th International Workshop on Multimedia Signal Processing (MMSP)

💡 一句话要点

针对单光子LiDAR中ROM算法的局限性,提出改进的信号提取技术,显著提升深度估计性能。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 单光子LiDAR 深度估计 秩次均值 噪声抑制 信号提取

📋 核心要点

- 单光子LiDAR深度估计易受背景噪声干扰,传统ROM算法性能受限于反射率阈值。

- 提出基于紧密时间戳聚类的信号提取方法,理论上分析了ROM算法的失效条件并加以改进。

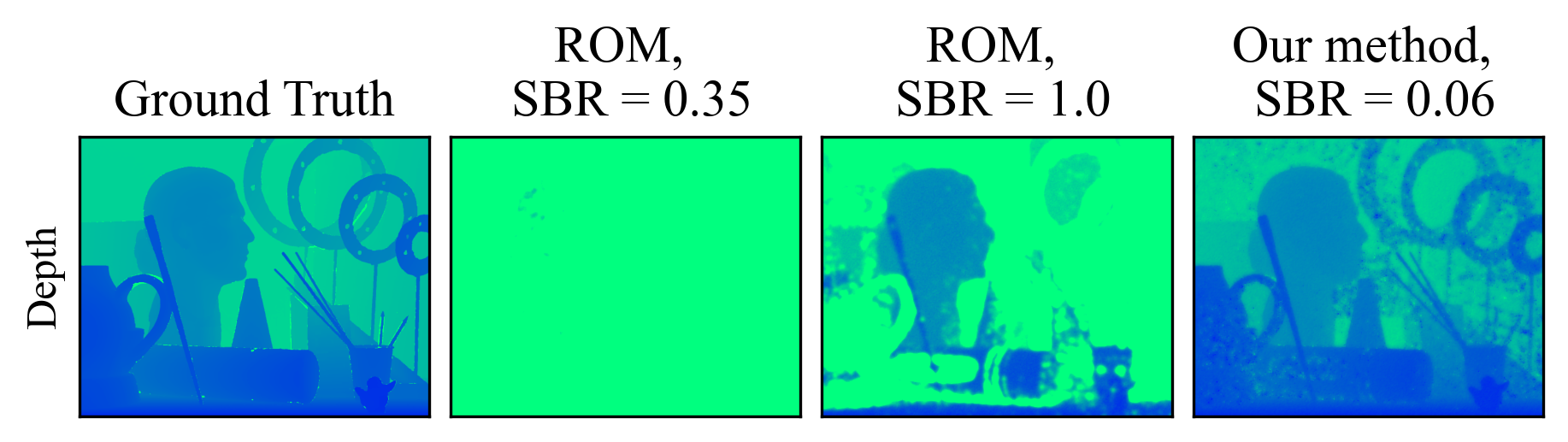

- 实验表明,新方法在低反射率和高噪声环境下,深度估计性能提升显著,图像质量大幅提高。

📝 摘要(中文)

单光子激光雷达(LiDAR)的深度估计通常通过匹配滤波器解决,但在背景噪声存在时容易出错。一种常用的抑制背景噪声的技术是Shin等人(2015)提出的秩次均值(ROM)滤波器。ROM通过选择局部邻域内中值统计量附近的一小部分时间戳来剔除噪声光子到达时间戳。尽管ROM性能良好,但其理论性能极限尚不清楚。本文从理论上表征了ROM的性能,表明当反射率降至由深度和信噪比预先确定的阈值以下时,ROM会失效,并且其精度在截止点处经历相变。基于我们的理论,我们提出了一种改进的信号提取技术,通过选择紧密的时间戳集群。实验结果表明,在相同信号强度下,所提出的算法比ROM的深度估计性能提高了3个数量级,并且在噪声水平高达信号17倍的情况下实现了高图像保真度。

🔬 方法详解

问题定义:单光子LiDAR在深度估计时,背景噪声是主要干扰因素。现有的秩次均值(ROM)算法虽然能抑制噪声,但其性能受限于反射率阈值。当目标反射率低于该阈值时,ROM算法会失效,导致深度估计精度显著下降,尤其是在远距离或低反射率目标场景下。因此,如何提高在低反射率和高噪声环境下的深度估计精度是本文要解决的关键问题。

核心思路:本文的核心思路是基于对ROM算法失效机理的理论分析,提出一种改进的信号提取技术。该技术不再简单地依赖于全局的秩次均值,而是关注时间戳的局部聚集特性。通过寻找紧密聚集的时间戳簇,可以更有效地区分信号光子和噪声光子,从而提高在低反射率条件下的信号提取能力。

技术框架:该方法主要包括以下几个阶段:1. 原始单光子事件数据采集;2. 基于时间戳的局部邻域构建;3. 紧密时间戳簇的检测与提取;4. 基于提取的时间戳簇进行深度估计。关键在于时间戳簇的检测与提取算法,它取代了传统ROM算法中基于秩次均值的简单阈值分割。

关键创新:最重要的技术创新点在于提出了基于紧密时间戳簇的信号提取方法,并从理论上分析了ROM算法的失效条件。与ROM算法相比,该方法不再依赖于全局统计量,而是关注局部时间戳的聚集特性,从而能够更有效地抑制噪声,提高在低反射率条件下的信号提取能力。

关键设计:时间戳簇的检测与提取算法是关键。具体实现细节未知,但可以推测可能涉及以下设计:1. 定义时间戳簇的紧密性度量,例如簇内时间戳的最大时间差或方差;2. 设计有效的搜索算法,以在局部邻域内寻找满足紧密性度量的时间戳簇;3. 设置合适的阈值,以区分信号簇和噪声簇。这些参数的具体设置会直接影响算法的性能,需要在实际应用中进行优化。

🖼️ 关键图片

📊 实验亮点

实验结果表明,在相同信号强度下,所提出的算法比传统的秩次均值(ROM)算法的深度估计性能提高了3个数量级。更重要的是,该算法在噪声水平高达信号17倍的情况下,仍然能够实现高图像保真度,这充分证明了其在恶劣环境下的鲁棒性和优越性。

🎯 应用场景

该研究成果可广泛应用于自动驾驶、机器人导航、三维重建、遥感等领域。尤其是在光照条件不佳或目标反射率较低的场景下,该方法能够显著提高单光子LiDAR的深度估计精度和可靠性,从而提升相关系统的性能和安全性。未来,该技术有望推动单光子LiDAR在更多实际场景中的应用。

📄 摘要(原文)

Depth estimation using a single-photon LiDAR is often solved by a matched filter. It is, however, error-prone in the presence of background noise. A commonly used technique to reject background noise is the rank-ordered mean (ROM) filter previously reported by Shin \textit{et al.} (2015). ROM rejects noisy photon arrival timestamps by selecting only a small range of them around the median statistics within its local neighborhood. Despite the promising performance of ROM, its theoretical performance limit is unknown. In this paper, we theoretically characterize the ROM performance by showing that ROM fails when the reflectivity drops below a threshold predetermined by the depth and signal-to-background ratio, and its accuracy undergoes a phase transition at the cutoff. Based on our theory, we propose an improved signal extraction technique by selecting tight timestamp clusters. Experimental results show that the proposed algorithm improves depth estimation performance over ROM by 3 orders of magnitude at the same signal intensities, and achieves high image fidelity at noise levels as high as 17 times that of signal.