ScalingGaussian: Enhancing 3D Content Creation with Generative Gaussian Splatting

作者: Shen Chen, Jiale Zhou, Zhongyu Jiang, Tianfang Zhang, Zongkai Wu, Jenq-Neng Hwang, Lei Li

分类: cs.CV

发布日期: 2024-07-26

备注: 14 pages

💡 一句话要点

ScalingGaussian:结合3D和2D扩散模型,提升高质量3D内容生成。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics) 支柱七:动作重定向 (Motion Retargeting)

关键词: 3D内容生成 扩散模型 高斯溅射 图像到3D 几何一致性 纹理优化 Score Distillation Sampling 点云稠密化

📋 核心要点

- 现有3D内容生成方法难以兼顾纹理细节和几何一致性,导致生成质量受限。

- ScalingGaussian结合3D和2D扩散模型,先用3D扩散生成点云,再用2D扩散模型细化高斯分布,提升几何和纹理。

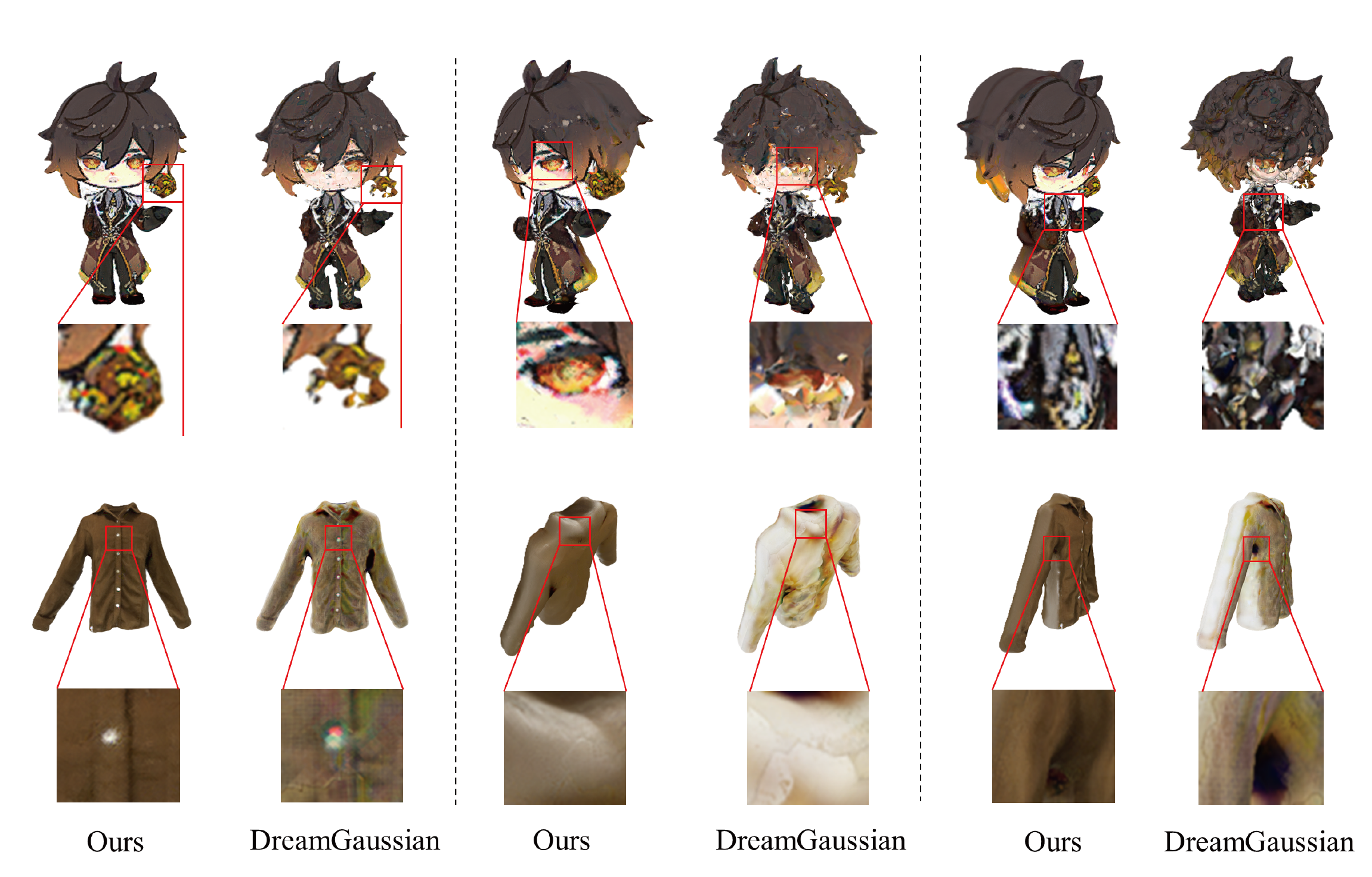

- 实验表明,ScalingGaussian能有效生成高质量3D资产,改善了几何结构和纹理细节。

📝 摘要(中文)

高质量3D资产的创建对于数字遗产保护、娱乐和机器人等应用至关重要。传统方法需要熟练的专业人员和专用软件进行3D对象的建模、纹理处理和渲染。然而,游戏和虚拟现实(VR)中对3D资产的需求不断增长,促使了易于使用的图像到3D技术的出现,使非专业人员能够生成3D内容,并减少对专家输入的依赖。现有的3D内容生成方法难以同时实现详细的纹理和强大的几何一致性。我们引入了一种新的3D内容创建框架ScalingGaussian,它结合了3D和2D扩散模型,以在生成的3D资产中实现详细的纹理和几何一致性。最初,3D扩散模型生成点云,然后通过选择局部区域、引入高斯噪声,然后使用局部密度加权选择的过程来致密化。为了细化3D高斯分布,我们利用带有Score Distillation Sampling (SDS)损失的2D扩散模型,引导3D高斯分布进行克隆和分裂。最后,3D高斯分布被转换为网格,并使用均方误差(MSE)和梯度剖面先验(GPP)损失优化表面纹理。我们的方法解决了3D扩散中常见的稀疏点云问题,从而改善了几何结构和详细的纹理。图像到3D任务的实验表明,我们的方法可以有效地生成高质量的3D资产。

🔬 方法详解

问题定义:现有图像到3D的生成方法,尤其是在使用扩散模型时,常常面临几何结构不一致和纹理细节不足的问题。3D扩散模型生成的点云通常比较稀疏,难以直接转换为高质量的3D模型。现有的方法要么侧重于几何结构,要么侧重于纹理细节,难以同时兼顾两者。

核心思路:ScalingGaussian的核心思路是结合3D扩散模型和2D扩散模型的优势。首先使用3D扩散模型生成初始的点云结构,然后利用2D扩散模型在多个视角下对3D高斯分布进行优化,从而提升纹理细节和几何一致性。通过这种方式,可以克服3D扩散模型生成点云稀疏的问题,并利用2D扩散模型强大的图像生成能力。

技术框架:ScalingGaussian的整体框架包含以下几个主要阶段: 1. 3D扩散模型生成点云:使用3D扩散模型生成初始的3D点云。 2. 点云稠密化:通过选择局部区域,引入高斯噪声,并使用局部密度加权选择来稠密化点云。 3. 3D高斯分布优化:使用带有Score Distillation Sampling (SDS)损失的2D扩散模型,引导3D高斯分布进行克隆和分裂,从而优化几何结构和纹理细节。 4. 网格转换和纹理优化:将3D高斯分布转换为网格,并使用均方误差(MSE)和梯度剖面先验(GPP)损失优化表面纹理。

关键创新:ScalingGaussian的关键创新在于结合了3D和2D扩散模型,并使用Score Distillation Sampling (SDS)损失来优化3D高斯分布。这种方法能够有效地利用2D扩散模型强大的图像生成能力,从而提升3D模型的纹理细节和几何一致性。与现有方法相比,ScalingGaussian能够生成更高质量的3D资产。

关键设计: * 点云稠密化:通过局部区域选择和高斯噪声引入,增加点云密度。 * SDS损失:使用Score Distillation Sampling (SDS)损失来引导3D高斯分布的优化,使其与2D扩散模型的输出一致。 * MSE和GPP损失:使用均方误差(MSE)和梯度剖面先验(GPP)损失来优化表面纹理,提升纹理的清晰度和真实感。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了ScalingGaussian在图像到3D生成任务中的有效性。实验结果表明,ScalingGaussian能够生成具有更详细纹理和更强几何一致性的3D模型。相较于现有方法,ScalingGaussian在视觉质量和客观指标上均有显著提升。具体性能数据未知,但摘要强调了其在改善几何结构和纹理细节方面的优势。

🎯 应用场景

ScalingGaussian在多个领域具有广泛的应用前景,包括数字遗产保护、游戏开发、虚拟现实/增强现实(VR/AR)、机器人技术等。它可以帮助非专业人员快速生成高质量的3D模型,降低3D内容创作的门槛。在机器人领域,可以用于快速生成环境模型,提升机器人的感知能力和导航能力。未来,该技术有望进一步发展,实现更加自动化和智能化的3D内容创作。

📄 摘要(原文)

The creation of high-quality 3D assets is paramount for applications in digital heritage preservation, entertainment, and robotics. Traditionally, this process necessitates skilled professionals and specialized software for the modeling, texturing, and rendering of 3D objects. However, the rising demand for 3D assets in gaming and virtual reality (VR) has led to the creation of accessible image-to-3D technologies, allowing non-professionals to produce 3D content and decreasing dependence on expert input. Existing methods for 3D content generation struggle to simultaneously achieve detailed textures and strong geometric consistency. We introduce a novel 3D content creation framework, ScalingGaussian, which combines 3D and 2D diffusion models to achieve detailed textures and geometric consistency in generated 3D assets. Initially, a 3D diffusion model generates point clouds, which are then densified through a process of selecting local regions, introducing Gaussian noise, followed by using local density-weighted selection. To refine the 3D gaussians, we utilize a 2D diffusion model with Score Distillation Sampling (SDS) loss, guiding the 3D Gaussians to clone and split. Finally, the 3D Gaussians are converted into meshes, and the surface textures are optimized using Mean Square Error(MSE) and Gradient Profile Prior(GPP) losses. Our method addresses the common issue of sparse point clouds in 3D diffusion, resulting in improved geometric structure and detailed textures. Experiments on image-to-3D tasks demonstrate that our approach efficiently generates high-quality 3D assets.