HybridDepth: Robust Metric Depth Fusion by Leveraging Depth from Focus and Single-Image Priors

作者: Ashkan Ganj, Hang Su, Tian Guo

分类: cs.CV

发布日期: 2024-07-26 (更新: 2024-12-25)

备注: WACV 2025

🔗 代码/项目: GITHUB

💡 一句话要点

提出HybridDepth,融合景深与单图先验,实现鲁棒的度量深度估计。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 深度估计 焦栈 单图深度先验 度量深度 移动设备

📋 核心要点

- 现有深度估计方法在尺度恢复、硬件兼容性和泛化能力方面存在不足,难以满足实际应用需求。

- HybridDepth融合焦栈信息和单图深度先验,利用移动设备易获取的焦栈数据,提升深度估计的准确性和结构细节。

- 实验表明,HybridDepth在多个数据集上超越现有SOTA模型,并在零样本场景下表现出强大的泛化能力。

📝 摘要(中文)

我们提出了HYBRIDDEPTH,一个鲁棒的深度估计流程,旨在解决深度估计中的关键挑战,包括尺度模糊、硬件异构性和泛化性。HYBRIDDEPTH利用焦栈数据(常见移动设备易于获取),生成精确的度量深度图。通过结合单图像深度估计的先验知识,我们的模型相比现有方法实现了更高水平的结构细节。我们测试了该流程的端到端系统,使用新开发的移动客户端捕获焦栈,然后将其发送到GPU服务器进行深度估计。全面的定量和定性分析表明,HYBRIDDEPTH在DDFF12和NYU Depth V2等常见数据集上优于最先进的模型。HYBRIDDEPTH还表现出强大的零样本泛化能力。在NYU Depth V2上训练后,HYBRIDDEPTH在ARKitScenes上的零样本性能超过了SOTA模型,并在Mobile Depth上提供了结构上更准确的深度图。代码已在https://github.com/cake-lab/HybridDepth/上提供。

🔬 方法详解

问题定义:论文旨在解决深度估计中存在的尺度模糊、硬件异构性和泛化性问题。现有的深度估计方法,例如基于单目图像的深度估计,通常存在尺度模糊的问题,难以获得准确的度量深度。而基于深度传感器的深度估计方法,又受限于特定硬件,难以在各种移动设备上通用。此外,现有方法在面对未见过的场景时,泛化能力往往较差。

核心思路:论文的核心思路是融合焦栈信息和单图深度先验。焦栈信息可以提供关于场景深度的线索,从而解决尺度模糊的问题。同时,利用单图深度估计的先验知识,可以提升深度图的结构细节和泛化能力。通过结合这两种信息来源,可以获得更准确、更鲁棒的深度估计结果。

技术框架:HybridDepth的整体框架是一个端到端的深度估计流程。首先,使用移动客户端捕获焦栈图像。然后,将焦栈图像发送到GPU服务器进行深度估计。在服务器端,HybridDepth模型融合焦栈信息和单图深度先验,生成最终的深度图。该流程包含焦栈图像采集、深度估计模型和后处理三个主要阶段。

关键创新:该论文的关键创新在于融合了焦栈信息和单图深度先验,提出了一种新的深度估计方法。与现有方法相比,HybridDepth能够更准确地恢复场景的度量深度,并具有更强的泛化能力。此外,该论文还开发了一个移动客户端,方便用户采集焦栈图像。

关键设计:HybridDepth模型使用了深度卷积神经网络(DCNN)来提取焦栈图像的特征。同时,利用预训练的单图深度估计模型来提供深度先验。在损失函数方面,使用了深度回归损失和结构相似性损失,以保证深度图的准确性和结构细节。具体的网络结构和参数设置在论文中有详细描述,但具体数值未知。

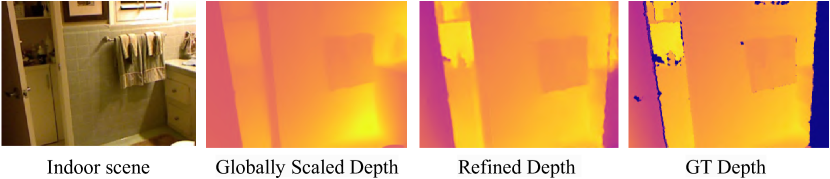

🖼️ 关键图片

📊 实验亮点

HybridDepth在DDFF12和NYU Depth V2等常见数据集上优于SOTA模型,具体提升幅度未知。在ARKitScenes数据集上,HybridDepth的零样本性能超过了SOTA模型,表明其具有强大的泛化能力。此外,HybridDepth在Mobile Depth数据集上生成了结构上更准确的深度图,证明了其在移动设备上的有效性。

🎯 应用场景

HybridDepth在增强现实、移动机器人、自动驾驶等领域具有广泛的应用前景。它可以为AR应用提供更准确的场景深度信息,提升用户体验。在机器人导航中,可以帮助机器人更好地理解周围环境,实现自主导航。在自动驾驶领域,可以提高车辆对周围环境的感知能力,增强驾驶安全性。

📄 摘要(原文)

We propose HYBRIDDEPTH, a robust depth estimation pipeline that addresses key challenges in depth estimation,including scale ambiguity, hardware heterogeneity, and generalizability. HYBRIDDEPTH leverages focal stack, data conveniently accessible in common mobile devices, to produce accurate metric depth maps. By incorporating depth priors afforded by recent advances in singleimage depth estimation, our model achieves a higher level of structural detail compared to existing methods. We test our pipeline as an end-to-end system, with a newly developed mobile client to capture focal stacks, which are then sent to a GPU-powered server for depth estimation. Comprehensive quantitative and qualitative analyses demonstrate that HYBRIDDEPTH outperforms state-of-the-art(SOTA) models on common datasets such as DDFF12 and NYU Depth V2. HYBRIDDEPTH also shows strong zero-shot generalization. When trained on NYU Depth V2, HYBRIDDEPTH surpasses SOTA models in zero-shot performance on ARKitScenes and delivers more structurally accurate depth maps on Mobile Depth. The code is available at https://github.com/cake-lab/HybridDepth/.