DragText: Rethinking Text Embedding in Point-based Image Editing

作者: Gayoon Choi, Taejin Jeong, Sujung Hong, Seong Jae Hwang

分类: cs.CV, cs.AI

发布日期: 2024-07-25 (更新: 2024-12-04)

备注: Accepted at WACV 2025; Code is released at https://github.com/MICV-yonsei/DragText

💡 一句话要点

DragText:通过优化文本嵌入增强基于点的图像编辑

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: 图像编辑 文本嵌入 扩散模型 点拖拽 语义一致性

📋 核心要点

- 现有基于点的图像编辑方法在拖拽过程中忽略了文本嵌入与图像嵌入的交互,导致编辑效果受限。

- DragText通过在拖拽过程中同步优化文本嵌入,使其与修改后的图像嵌入保持一致,从而提升编辑质量。

- 该方法易于集成到现有扩散模型中,只需少量代码即可显著提升图像编辑的性能和内容一致性。

📝 摘要(中文)

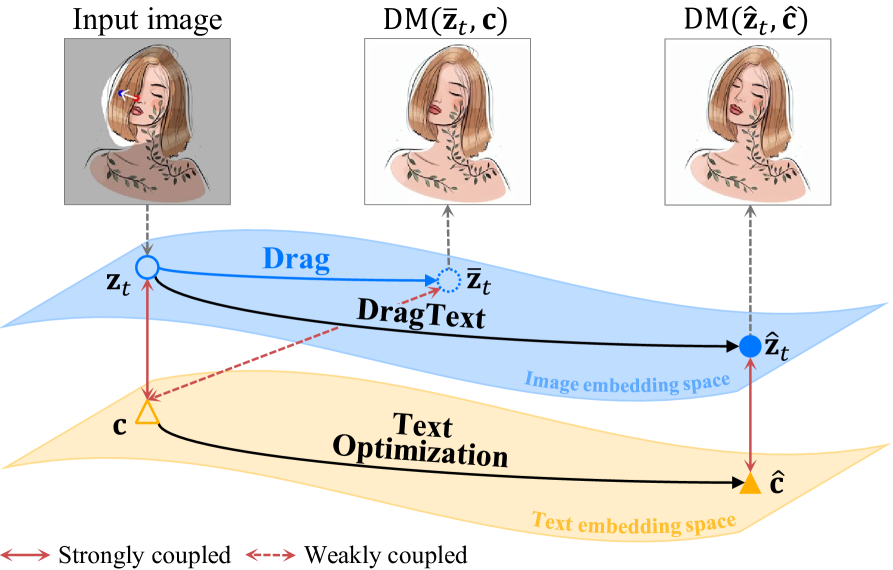

基于点的图像编辑通过内容拖拽实现精确和灵活的控制。然而,文本嵌入在编辑过程中的作用尚未得到充分研究。一个重要的未被探索的方面是文本和图像嵌入之间的交互。在扩散模型中的渐进式编辑过程中,文本嵌入保持不变。随着图像嵌入越来越偏离其初始状态,图像和文本嵌入之间的差异提出了一个重大挑战。本研究发现,文本提示显著影响拖拽过程,尤其是在保持内容完整性和实现期望的操作方面。基于这些见解,我们提出了DragText,它结合拖拽过程优化文本嵌入,以与修改后的图像嵌入相匹配。同时,我们对文本优化过程进行正则化,以保持原始文本提示的完整性。我们的方法可以无缝集成到现有的基于扩散的拖拽方法中,只需几行代码即可提高性能。

🔬 方法详解

问题定义:现有的基于扩散模型的图像编辑方法,特别是基于点拖拽的方法,在编辑过程中通常保持文本嵌入不变。然而,随着图像内容的改变,图像嵌入与固定的文本嵌入之间的语义鸿沟会逐渐增大,导致编辑效果不佳,例如内容完整性受损,或者无法达到预期的编辑目标。因此,如何弥合图像和文本嵌入之间的差异,是提升编辑质量的关键问题。

核心思路:DragText的核心思路是在图像编辑的拖拽过程中,同步优化文本嵌入,使其能够更好地匹配当前编辑状态下的图像嵌入。通过动态调整文本嵌入,可以更好地引导扩散模型生成符合编辑意图的图像,从而提高编辑的精确性和内容一致性。

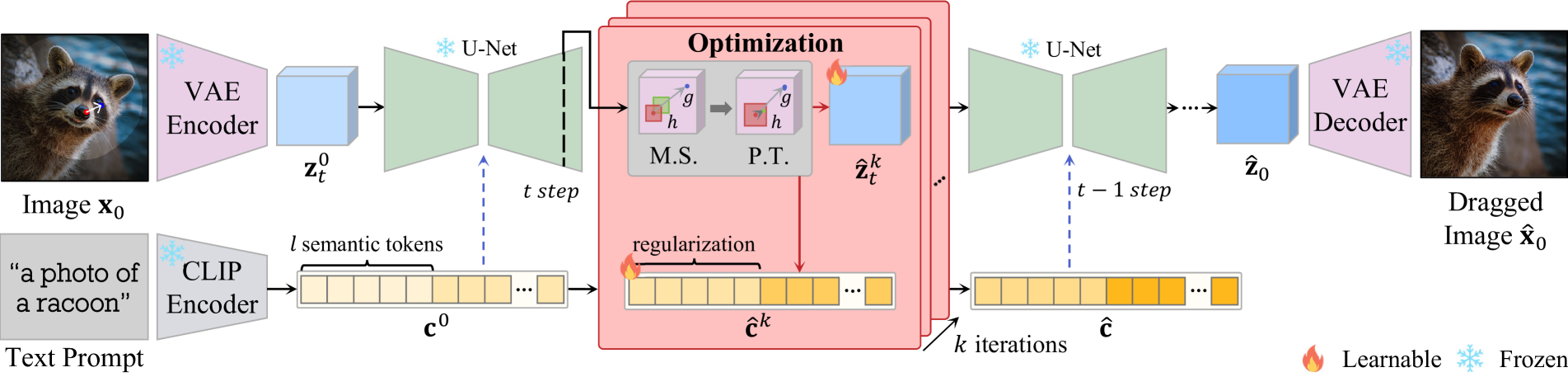

技术框架:DragText可以无缝集成到现有的基于扩散模型的拖拽编辑框架中。其主要流程是在每次迭代的拖拽步骤中,除了更新图像之外,也同步更新文本嵌入。具体来说,在扩散模型的反向过程中,同时计算图像和文本的梯度,并利用这些梯度来更新图像和文本嵌入。

关键创新:DragText的关键创新在于提出了同步优化文本嵌入的策略。与以往固定文本嵌入的方法不同,DragText允许文本嵌入随着图像编辑的进行而动态变化,从而更好地适应图像内容的变化。此外,DragText还引入了正则化项,以防止文本嵌入过度偏离原始文本提示,从而保持编辑的一致性。

关键设计:DragText的关键设计包括:1) 使用梯度下降法优化文本嵌入;2) 引入正则化项,例如L2正则化,以约束文本嵌入的变化范围;3) 调整文本嵌入的学习率,以平衡优化速度和稳定性;4) 可以选择性地对文本嵌入的某些维度进行优化,以更好地控制编辑的方向。

🖼️ 关键图片

📊 实验亮点

DragText通过同步优化文本嵌入,显著提升了基于点的图像编辑性能。实验结果表明,DragText能够生成更符合用户意图、内容更完整的编辑结果。与现有方法相比,DragText在内容一致性和编辑质量方面均有显著提升,尤其是在需要精细控制的编辑任务中表现更佳。此外,DragText的易集成性使其能够快速应用于各种现有的扩散模型。

🎯 应用场景

DragText可应用于各种图像编辑场景,例如物体重定位、形状修改、风格迁移等。该方法能够提升编辑的精确性和内容一致性,从而改善用户体验。此外,DragText还可以应用于创意设计、艺术创作等领域,帮助用户更轻松地实现他们的创作想法。未来,该技术有望在虚拟现实、增强现实等领域发挥重要作用。

📄 摘要(原文)

Point-based image editing enables accurate and flexible control through content dragging. However, the role of text embedding during the editing process has not been thoroughly investigated. A significant aspect that remains unexplored is the interaction between text and image embeddings. During the progressive editing in a diffusion model, the text embedding remains constant. As the image embedding increasingly diverges from its initial state, the discrepancy between the image and text embeddings presents a significant challenge. In this study, we found that the text prompt significantly influences the dragging process, particularly in maintaining content integrity and achieving the desired manipulation. Upon these insights, we propose DragText, which optimizes text embedding in conjunction with the dragging process to pair with the modified image embedding. Simultaneously, we regularize the text optimization process to preserve the integrity of the original text prompt. Our approach can be seamlessly integrated with existing diffusion-based drag methods, enhancing performance with only a few lines of code.