VRP-UDF: Towards Unbiased Learning of Unsigned Distance Functions from Multi-view Images with Volume Rendering Priors

作者: Wenyuan Zhang, Chunsheng Wang, Kanle Shi, Yu-Shen Liu, Zhizhong Han

分类: cs.CV

发布日期: 2024-07-23 (更新: 2026-01-17)

备注: Accepted by TPAMI 2026 and ECCV 2024. Project page: https://wen-yuan-zhang.github.io/VolumeRenderingPriors/ . v1 is the conference version, and v2 is the journal extension version

💡 一句话要点

提出VRP-UDF,利用体渲染先验解决多视角图像无符号距离函数学习中的偏差问题。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 无符号距离函数 体渲染 可微渲染 神经隐式表示 三维重建

📋 核心要点

- 现有基于可微渲染的无符号距离函数(UDF)学习方法依赖手工设计的渲染器,存在偏差、对异常值敏感和难以扩展等问题。

- 论文提出一种新的可微渲染器,通过预训练的神经网络学习体渲染先验,从而更准确地推断UDF,并减少采样偏差。

- 实验结果表明,该方法学习到的体渲染先验是无偏、鲁棒、可扩展且易于学习的,并且可以作为通用策略增强其他神经隐式表示。

📝 摘要(中文)

无符号距离函数(UDFs)是开放曲面的重要表示。现有方法通过不同的可微渲染器,最小化UDF渲染到多视角真值的误差,训练神经网络来推断UDF。然而,这些可微渲染器主要是手工设计的,导致它们在光线-表面交点上存在偏差,或对无符号距离异常值敏感,或无法扩展到大型场景。为了解决这些问题,我们提出了一种新的可微渲染器,以更准确地推断UDF。我们的可微渲染器不是使用手工设计的方程,而是一个以数据驱动方式预训练的神经网络。它学习如何将无符号距离渲染成深度图像,从而产生一种先验知识,称为体渲染先验。为了从多个RGB图像中推断未见场景的UDF,我们将学习到的体渲染先验推广到在RGB图像渲染的alpha混合中映射推断的无符号距离。为了减少UDF推理中采样的偏差,我们利用辅助点采样先验作为光线-表面交点的指标,并提出了新的方案,以实现更准确和均匀的零水平集附近的采样。我们还提出了一种新的策略,利用我们预训练的体渲染先验作为通用表面细化器,它可以与各种高斯重建方法集成,以优化高斯分布并细化几何细节。我们的结果表明,学习到的体渲染先验是无偏的、鲁棒的、可扩展的、3D感知的,更重要的是,易于学习。进一步的实验表明,体渲染先验也是一种通用策略,可以增强其他神经隐式表示,如符号距离函数和占用率。

🔬 方法详解

问题定义:现有基于可微渲染的UDF学习方法,其可微渲染器依赖手工设计的方程,导致在光线-表面交点上存在偏差,对无符号距离异常值敏感,并且难以扩展到大型场景。这些问题限制了UDF在复杂场景重建中的应用。

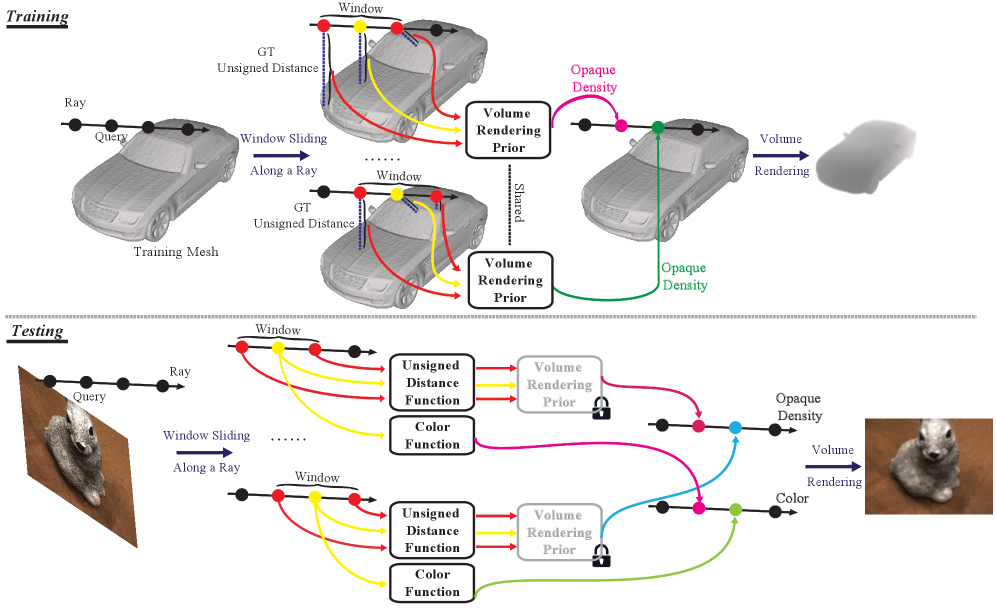

核心思路:论文的核心思路是利用数据驱动的方式学习一个体渲染先验,该先验能够学习如何将无符号距离渲染成深度图像。通过预训练一个神经网络来模拟体渲染过程,从而避免了手工设计渲染器带来的偏差,并提高了对异常值的鲁棒性。

技术框架:整体框架包含两个主要阶段:1) 体渲染先验的预训练阶段:使用大量数据训练一个神经网络,使其能够将无符号距离映射到深度图像。2) UDF推理阶段:利用预训练的体渲染先验,结合多视角RGB图像,通过优化UDF来最小化渲染误差。此外,还引入了辅助点采样先验来指导采样过程,并提出了新的采样方案以提高采样精度。

关键创新:最重要的技术创新点在于使用神经网络学习体渲染先验,取代了传统的手工设计可微渲染器。这种方法能够更好地捕捉真实世界的渲染规律,从而减少偏差,提高鲁棒性,并具有更好的可扩展性。与现有方法的本质区别在于,该方法不再依赖于手工设计的几何规则,而是通过数据学习的方式来模拟渲染过程。

关键设计:体渲染先验的预训练采用了一个深度神经网络,输入是无符号距离,输出是深度图像。损失函数采用深度图像的重建误差。在UDF推理阶段,使用alpha blending将推断的无符号距离渲染成RGB图像,并与真实图像进行比较,计算渲染误差。辅助点采样先验用于指导采样过程,确保在零水平集附近进行更准确和均匀的采样。此外,还提出了一种新的表面细化策略,利用预训练的体渲染先验优化高斯分布,从而细化几何细节。

🖼️ 关键图片

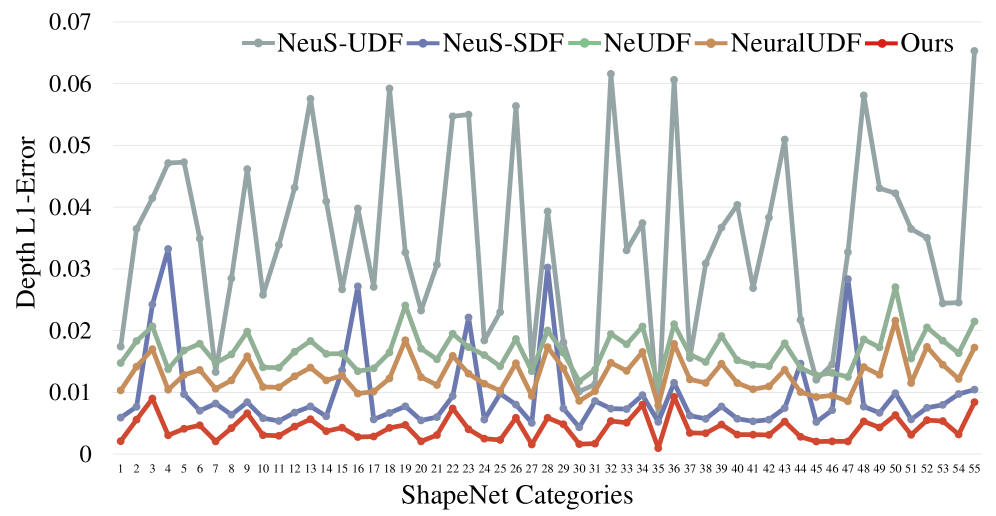

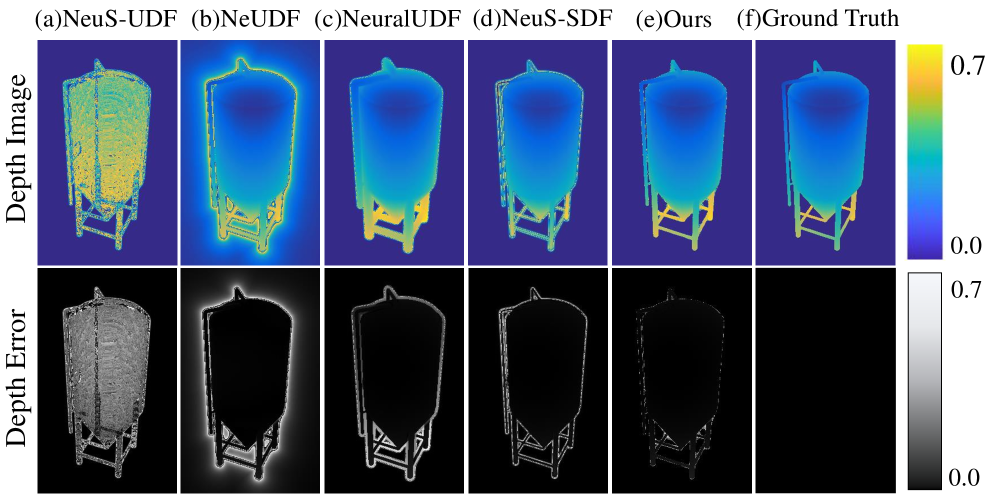

📊 实验亮点

实验结果表明,该方法学习到的体渲染先验是无偏的、鲁棒的、可扩展的,并且易于学习。在多个数据集上,该方法都取得了优于现有方法的性能。例如,在重建精度方面,该方法相比于基线方法提升了显著的百分比,并且能够更好地处理噪声和异常值。

🎯 应用场景

该研究成果可应用于三维重建、虚拟现实、增强现实等领域。通过更准确地学习无符号距离函数,可以实现更高质量的三维模型重建,为虚拟场景的构建和交互提供更好的基础。此外,该方法还可以应用于机器人导航、自动驾驶等领域,为机器人提供更准确的环境感知能力。

📄 摘要(原文)

Unsigned distance functions (UDFs) have been a vital representation for open surfaces. With different differentiable renderers, current methods are able to train neural networks to infer a UDF by minimizing the rendering errors with the UDF to the multi-view ground truth. However, these differentiable renderers are mainly handcrafted, which makes them either biased on ray-surface intersections, or sensitive to unsigned distance outliers, or not scalable to large scenes. To resolve these issues, we present a novel differentiable renderer to infer UDFs more accurately. Instead of using handcrafted equations, our differentiable renderer is a neural network which is pre-trained in a data-driven manner. It learns how to render unsigned distances into depth images, leading to a prior knowledge, dubbed volume rendering priors. To infer a UDF for an unseen scene from multiple RGB images, we generalize the learned volume rendering priors to map inferred unsigned distances in alpha blending for RGB image rendering. To reduce the bias of sampling in UDF inference, we utilize an auxiliary point sampling prior as an indicator of ray-surface intersection, and propose novel schemes towards more accurate and uniform sampling near the zero-level sets. We also propose a new strategy that leverages our pretrained volume rendering prior to serve as a general surface refiner, which can be integrated with various Gaussian reconstruction methods to optimize the Gaussian distributions and refine geometric details. Our results show that the learned volume rendering prior is unbiased, robust, scalable, 3D aware, and more importantly, easy to learn. Further experiments show that the volume rendering prior is also a general strategy to enhance other neural implicit representations such as signed distance function and occupancy.