DiffArtist: Towards Structure and Appearance Controllable Image Stylization

作者: Ruixiang Jiang, Changwen Chen

分类: cs.CV, cs.GR

发布日期: 2024-07-22 (更新: 2025-08-27)

备注: Accepted to ACM MM 2025, Homepage: https://DiffusionArtist.github.io

💡 一句话要点

DiffArtist:提出一种结构和外观可控的图像风格化方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 图像风格化 扩散模型 结构控制 外观控制 双重可控性 多模态LLM 文本驱动

📋 核心要点

- 现有风格化方法侧重外观特征迁移,忽略了结构风格化的重要性,限制了风格控制的精细度。

- DiffArtist将结构和外观生成解耦为独立的扩散过程,实现对结构和外观风格强度的精细控制。

- 实验表明,DiffArtist在风格保真度和双重可控性上优于现有方法,并提出了更符合人类偏好的评估器。

📝 摘要(中文)

艺术风格由其结构和外观元素定义。现有的神经风格化技术主要集中于传递颜色和纹理等外观层面的特征,常常忽略了同样重要的结构风格化方面。为了解决这一差距,我们提出了DiffArtist,这是第一个能够对结构和外观风格强度进行细粒度、同步控制的2D风格化方法。这种双重可控性是通过将结构和外观生成表示为单独的扩散过程来实现的,无需进一步的调整或额外的适配器。为了正确评估这种新的双重风格化能力,我们进一步提出了一个基于多模态LLM的风格化评估器,该评估器比现有的指标更符合人类的偏好。广泛的分析表明,DiffArtist在风格保真度和双重可控性方面优于最先进的方法。其文本驱动、无需训练的设计和前所未有的双重可控性使其成为各种创意应用的强大且交互式的工具。

🔬 方法详解

问题定义:现有的神经风格化方法主要关注外观层面的风格迁移,例如颜色和纹理,而忽略了图像结构的重要性。这导致风格化结果缺乏对图像结构信息的有效控制,限制了风格化效果的多样性和可控性。因此,如何实现对图像结构和外观风格的同步、精细控制是本文要解决的核心问题。

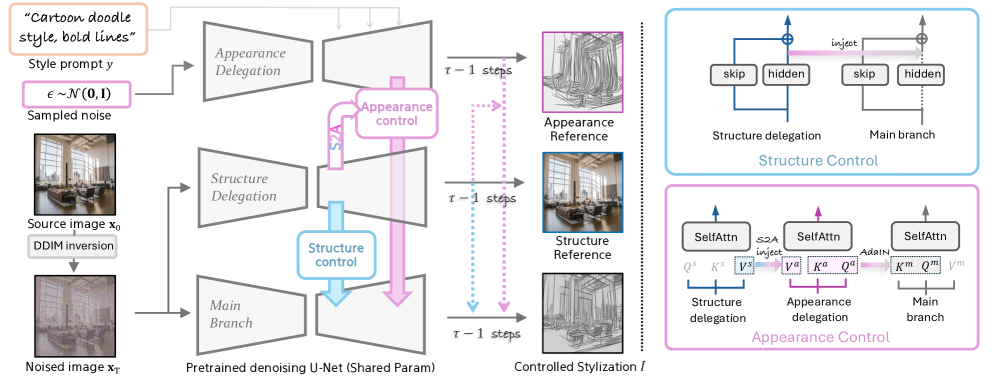

核心思路:DiffArtist的核心思路是将图像的结构和外观表示为两个独立的扩散过程。通过解耦结构和外观的生成过程,可以分别控制它们的风格强度,从而实现对图像风格化的双重可控性。这种解耦的设计使得模型能够更灵活地处理不同的风格化需求,并生成更具创意和多样性的风格化结果。

技术框架:DiffArtist的整体框架包含两个主要的扩散过程:结构扩散过程和外观扩散过程。首先,输入图像被编码成结构和外观特征。然后,这两个特征分别通过各自的扩散过程进行处理,以生成具有目标风格的结构和外观。最后,将生成的结构和外观特征解码成最终的风格化图像。该框架是训练自由的,允许文本驱动的风格化。

关键创新:DiffArtist的关键创新在于其双重可控性,即能够同时控制图像的结构和外观风格强度。与现有方法相比,DiffArtist不需要额外的调整或适配器,就可以实现对结构和外观风格的精细控制。此外,该论文还提出了一个基于多模态LLM的风格化评估器,该评估器更符合人类的偏好,能够更准确地评估风格化结果的质量。

关键设计:DiffArtist的关键设计包括:1) 使用独立的扩散过程来处理结构和外观特征,以实现解耦的风格控制;2) 采用文本驱动的方式来控制风格化过程,使得用户可以通过文本描述来指定目标风格;3) 设计了一个基于多模态LLM的风格化评估器,以更准确地评估风格化结果的质量。具体的网络结构和损失函数等技术细节在论文中进行了详细描述,但摘要中未提及。

🖼️ 关键图片

📊 实验亮点

DiffArtist在风格保真度和双重可控性方面优于现有方法。通过与现有方法的对比实验表明,DiffArtist能够生成更符合目标风格的图像,并且能够更精细地控制图像的结构和外观风格强度。此外,该论文提出的基于多模态LLM的风格化评估器也比现有指标更符合人类的偏好。

🎯 应用场景

DiffArtist具有广泛的应用前景,例如艺术创作、图像编辑、游戏设计等。它可以帮助艺术家和设计师更轻松地创建具有特定风格的图像,也可以用于图像编辑软件中,为用户提供更强大的风格化功能。此外,DiffArtist还可以应用于游戏设计中,用于生成具有独特风格的游戏场景和角色。

📄 摘要(原文)

Artistic styles are defined by both their structural and appearance elements. Existing neural stylization techniques primarily focus on transferring appearance-level features such as color and texture, often neglecting the equally crucial aspect of structural stylization. To address this gap, we introduce \textbf{DiffArtist}, the first 2D stylization method to offer fine-grained, simultaneous control over both structure and appearance style strength. This dual controllability is achieved by representing structure and appearance generation as separate diffusion processes, necessitating no further tuning or additional adapters. To properly evaluate this new capability of dual stylization, we further propose a Multimodal LLM-based stylization evaluator that aligns significantly better with human preferences than existing metrics. Extensive analysis shows that DiffArtist achieves superior style fidelity and dual-controllability compared to state-of-the-art methods. Its text-driven, training-free design and unprecedented dual controllability make it a powerful and interactive tool for various creative applications. Project homepage: https://diffusionartist.github.io.