Automatic Generation of Fashion Images using Prompting in Generative Machine Learning Models

作者: Georgia Argyrou, Angeliki Dimitriou, Maria Lymperaiou, Giorgos Filandrianos, Giorgos Stamou

分类: cs.CV

发布日期: 2024-07-20

期刊: ECCVW 2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出基于提示工程的生成模型,用于自动生成时尚图像和描述。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 时尚图像生成 提示工程 大型语言模型 Stable Diffusion 检索增强生成 零样本学习 少样本学习

📋 核心要点

- 现有时尚图像生成方法缺乏灵活性和对时尚趋势的快速适应能力,难以生成多样化和符合当代审美的图像。

- 利用大型语言模型和Stable Diffusion,结合零样本、少样本学习和思维链等提示工程技术,生成高质量的时尚图像和描述。

- 实验结果表明,检索增强生成(RAG)和少样本学习方法在生成相关和吸引人的时尚描述方面表现更优,提升了图像的创造力、连贯性和美观性。

📝 摘要(中文)

本文研究了使用大型语言模型生成定制时尚描述,并使用Stable Diffusion模型创建时尚图像的方法。该方法强调AI驱动时尚创造的适应性,采用提示工程技术,如零样本学习、少样本学习和思维链(CoT),从而产生各种颜色和纹理,增强输出的多样性。检索增强生成(RAG)是该方法的核心,它利用来自时尚资源的知识来丰富模型,确保当代表征。评估结合了CLIPscore等定量指标和定性人工判断,突出了不同风格的创造力、连贯性和审美吸引力。结果表明,RAG和少样本学习技术更受欢迎,因为它们能够产生更相关和吸引人的时尚描述。代码已开源。

🔬 方法详解

问题定义:论文旨在解决时尚图像自动生成的问题,现有方法难以快速适应时尚潮流变化,生成多样性不足,且缺乏对时尚知识的有效利用。这导致生成的图像可能不符合当代审美,缺乏创新性。

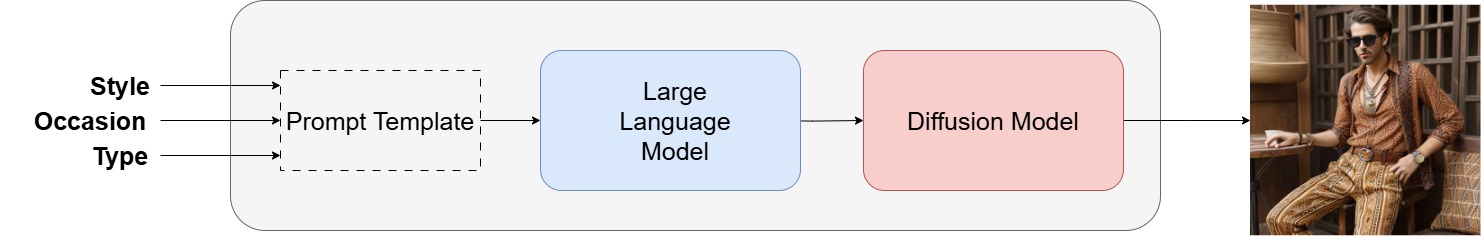

核心思路:论文的核心思路是利用大型语言模型(LLM)生成时尚描述,然后使用Stable Diffusion模型将这些描述转化为图像。通过提示工程(Prompt Engineering)来引导LLM生成更丰富、更具创意的描述,并结合检索增强生成(RAG)来引入最新的时尚知识,从而提升生成图像的质量和相关性。

技术框架:整体框架包含以下几个主要模块: 1. 时尚描述生成模块:使用大型语言模型(如未明确指定的LLM)结合零样本、少样本学习和思维链(CoT)等提示策略生成时尚描述。 2. 检索增强模块:使用RAG技术,从时尚知识库中检索相关信息,增强LLM的生成能力。 3. 图像生成模块:使用Stable Diffusion模型,将生成的时尚描述转化为图像。 4. 评估模块:使用CLIPscore等定量指标和人工评估来评价生成图像的质量。

关键创新:论文的关键创新在于将提示工程(Prompt Engineering)和检索增强生成(RAG)技术应用于时尚图像生成领域。通过不同的提示策略,如零样本、少样本学习和思维链,引导LLM生成更具创造性和多样性的时尚描述。同时,RAG技术能够使模型及时获取最新的时尚信息,从而生成更符合当代潮流的图像。

关键设计:论文中关键的设计包括: 1. 提示策略的选择:针对不同的生成目标,选择合适的提示策略,例如,使用思维链(CoT)来生成更详细的描述。 2. RAG的知识库构建:构建包含最新时尚信息的知识库,并设计有效的检索策略,确保LLM能够获取相关信息。 3. Stable Diffusion的参数调整:根据生成的时尚描述,调整Stable Diffusion模型的参数,以生成高质量的图像。 4. CLIPscore的计算方式:使用CLIP模型计算生成图像与描述之间的相似度,作为评估指标之一。

🖼️ 关键图片

📊 实验亮点

实验结果表明,结合RAG和少样本学习的提示工程方法在生成时尚描述方面表现更优,能够产生更相关和吸引人的描述。通过CLIPscore等指标和人工评估,验证了该方法在创造力、连贯性和美观性方面的优势,表明其能够生成高质量的时尚图像。

🎯 应用场景

该研究成果可应用于电商平台的商品展示、虚拟服装设计、时尚杂志的内容生成等领域。通过自动生成时尚图像和描述,可以降低内容创作成本,提高创作效率,并为用户提供更个性化的时尚体验。未来,该技术有望进一步应用于虚拟试衣、时尚搭配推荐等场景。

📄 摘要(原文)

The advent of artificial intelligence has contributed in a groundbreaking transformation of the fashion industry, redefining creativity and innovation in unprecedented ways. This work investigates methodologies for generating tailored fashion descriptions using two distinct Large Language Models and a Stable Diffusion model for fashion image creation. Emphasizing adaptability in AI-driven fashion creativity, we depart from traditional approaches and focus on prompting techniques, such as zero-shot and few-shot learning, as well as Chain-of-Thought (CoT), which results in a variety of colors and textures, enhancing the diversity of the outputs. Central to our methodology is Retrieval-Augmented Generation (RAG), enriching models with insights from fashion sources to ensure contemporary representations. Evaluation combines quantitative metrics such as CLIPscore with qualitative human judgment, highlighting strengths in creativity, coherence, and aesthetic appeal across diverse styles. Among the participants, RAG and few-shot learning techniques are preferred for their ability to produce more relevant and appealing fashion descriptions. Our code is provided at https://github.com/georgiarg/AutoFashion.