Realistic Surgical Image Dataset Generation Based On 3D Gaussian Splatting

作者: Tianle Zeng, Gerardo Loza Galindo, Junlei Hu, Pietro Valdastri, Dominic Jones

分类: cs.CV

发布日期: 2024-07-20

备注: This paper has already been accepted by INTERNATIONAL CONFERENCE ON MEDICAL IMAGE COMPUTING AND COMPUTER ASSISTED INTERVENTION (MICCAI 2024)

期刊: MICCAI2024

💡 一句话要点

提出基于3D高斯溅射的真实感手术图像数据集生成方法,解决手术数据集匮乏问题。

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics)

关键词: 3D高斯溅射 合成数据生成 手术图像数据集 机器人辅助手术 YOLOv5 计算机视觉 数据增强

📋 核心要点

- 机器人辅助微创手术(RAMIS)的自动化能力受限于缺乏全面的手术数据集,阻碍了工具跟踪、检测和定位等计算机视觉技术的应用。

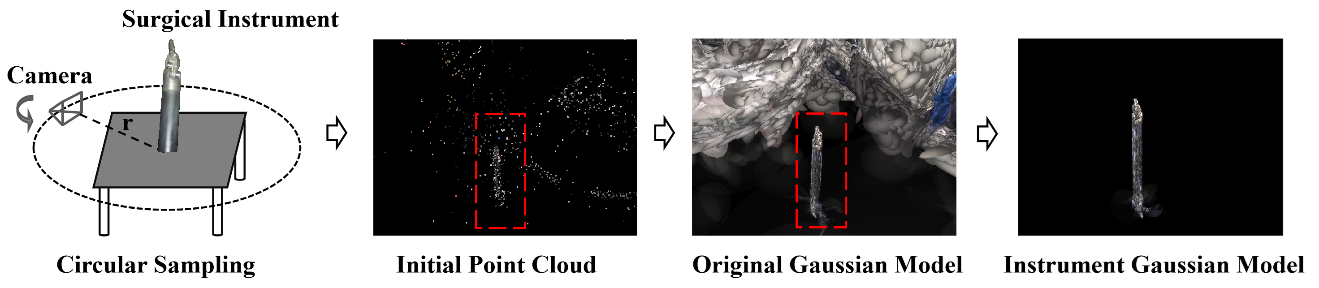

- 本文提出一种基于3D高斯溅射的合成数据生成方法,通过提取、组合手术器械和环境的3D高斯表示,生成高保真手术场景。

- 实验表明,合成数据训练的YOLOv5模型在真实数据测试集上优于真实数据训练的模型,性能提升12%,验证了方法的有效性。

📝 摘要(中文)

本文提出了一种新颖的方法,利用3D高斯溅射生成合成手术数据集。该方法提取并组合手术器械和背景手术环境的3D高斯表示,通过变换和组合生成高保真度的合成手术场景。我们开发了一个数据记录系统,能够获取手术场景中的图像以及工具和相机姿态。利用这些姿态数据,我们以合成方式复制场景,从而能够直接比较合成图像质量(PSNR为29.592)。此外,我们比较了分别在合成数据和真实数据上训练的两个YOLOv5模型,并评估了它们在未见过的真实世界测试数据集中的性能。结果表明,在真实世界数据上进行测试时,使用合成数据训练的模型性能优于使用真实世界数据训练的模型,提升了12%。

🔬 方法详解

问题定义:现有机器人辅助微创手术(RAMIS)领域,计算机视觉技术的发展受到高质量、大规模手术图像数据集匮乏的限制。真实手术数据获取成本高昂,且涉及隐私问题。因此,如何生成逼真且标注完善的合成手术图像数据集,成为一个亟待解决的问题。

核心思路:本文的核心思路是利用3D高斯溅射(3D Gaussian Splatting)技术,将手术器械和手术环境表示为3D高斯分布的集合。通过对这些高斯分布进行变换和组合,可以灵活地生成各种不同的手术场景,从而实现合成数据的快速生成。这种方法能够保证合成图像的真实感,并提供精确的姿态信息。

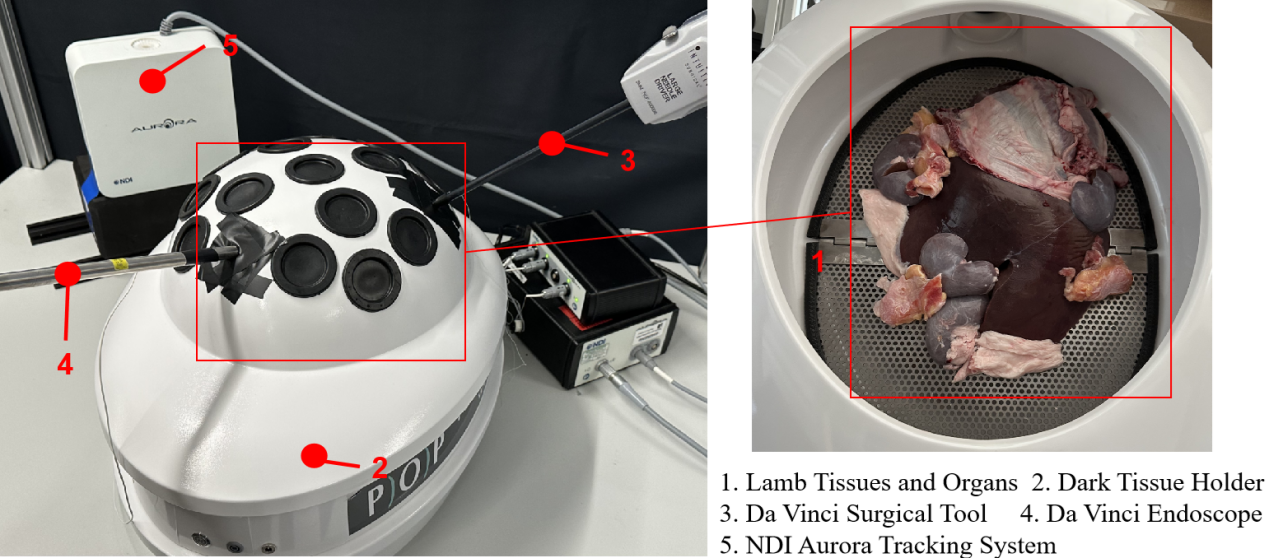

技术框架:该方法主要包含以下几个阶段:1) 数据采集:利用开发的数据记录系统,获取真实手术场景的图像以及工具和相机的姿态信息。2) 3D高斯表示提取:从采集的数据中提取手术器械和手术环境的3D高斯表示。3) 场景合成:根据设定的参数,对提取的3D高斯表示进行变换和组合,生成新的手术场景。4) 图像渲染:将合成的3D场景渲染成2D图像,并生成相应的标注信息。

关键创新:该方法的关键创新在于将3D高斯溅射技术应用于手术图像数据集的生成。与传统的基于3D模型渲染的方法相比,3D高斯溅射能够更好地捕捉真实场景的光照和纹理信息,从而生成更加逼真的合成图像。此外,该方法还能够灵活地控制场景的各种参数,例如工具的位置、姿态和光照条件,从而生成多样化的数据集。

关键设计:在3D高斯表示提取阶段,需要选择合适的参数来控制高斯分布的数量和形状。在场景合成阶段,需要设计合理的变换和组合规则,以保证合成场景的真实性和多样性。在图像渲染阶段,需要选择合适的渲染引擎和参数,以生成高质量的合成图像。此外,为了评估合成数据的质量,本文采用了PSNR指标,并比较了在合成数据和真实数据上训练的YOLOv5模型的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用该方法生成的合成图像具有较高的质量,PSNR值达到29.592。更重要的是,使用合成数据训练的YOLOv5模型在真实世界测试集上表现优异,相比于使用真实数据训练的模型,性能提升了12%。这充分验证了该方法生成合成数据的有效性,以及其在实际应用中的潜力。

🎯 应用场景

该研究成果可应用于机器人辅助微创手术的计算机视觉算法开发与验证,例如工具跟踪、手术导航等。高质量的合成数据集能够降低算法开发成本,加速算法迭代,并为算法的鲁棒性提供保障。此外,该方法还可扩展到其他医学图像领域,例如内窥镜图像分析等。

📄 摘要(原文)

Computer vision technologies markedly enhance the automation capabilities of robotic-assisted minimally invasive surgery (RAMIS) through advanced tool tracking, detection, and localization. However, the limited availability of comprehensive surgical datasets for training represents a significant challenge in this field. This research introduces a novel method that employs 3D Gaussian Splatting to generate synthetic surgical datasets. We propose a method for extracting and combining 3D Gaussian representations of surgical instruments and background operating environments, transforming and combining them to generate high-fidelity synthetic surgical scenarios. We developed a data recording system capable of acquiring images alongside tool and camera poses in a surgical scene. Using this pose data, we synthetically replicate the scene, thereby enabling direct comparisons of the synthetic image quality (29.592 PSNR). As a further validation, we compared two YOLOv5 models trained on the synthetic and real data, respectively, and assessed their performance in an unseen real-world test dataset. Comparing the performances, we observe an improvement in neural network performance, with the synthetic-trained model outperforming the real-world trained model by 12%, testing both on real-world data.