DISCO: Embodied Navigation and Interaction via Differentiable Scene Semantics and Dual-level Control

作者: Xinyu Xu, Shengcheng Luo, Yanchao Yang, Yong-Lu Li, Cewu Lu

分类: cs.CV

发布日期: 2024-07-20

备注: ECCV 2024

🔗 代码/项目: GITHUB

💡 一句话要点

DISCO:提出基于可微场景语义和双层控制的具身导航与交互方法

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱三:空间感知与语义 (Perception & Semantics) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 导航与交互 可微场景表示 双层控制 ALFRED基准

📋 核心要点

- 现有具身智能体在复杂环境中进行导航和交互时,缺乏对场景语义的有效建模,导致任务规划困难。

- DISCO通过引入可微场景表示,动态学习对象和可供性的丰富语义,从而实现更有效的导航规划。

- 实验表明,DISCO在ALFRED基准测试中,即使没有逐步指令,也能显著提升未见场景中的任务成功率。

📝 摘要(中文)

本文研究了具身智能体中的基本移动操作,即如何基于指令性的动词-名词对进行导航和交互。我们提出了DISCO,它在上下文场景建模和高效控制方面具有显著的进步。DISCO融合了对象和可供性的丰富语义的可微场景表示,这些表示是在运行中动态学习的,并促进导航规划。此外,我们提出了利用全局和局部线索的双层由粗到精的动作控制,以高效地完成移动操作任务。DISCO可以轻松地集成到具身任务中,例如具身指令跟随。为了验证我们的方法,我们以大规模长时程视觉-语言导航和交互任务的ALFRED基准作为测试平台。在广泛的实验中,我们进行了全面的评估,并证明DISCO在未见场景中的成功率比现有技术高出+8.6%,即使没有逐步的指令。

🔬 方法详解

问题定义:论文旨在解决具身智能体在复杂环境中,如何根据给定的动词-名词指令,高效地进行导航和交互的问题。现有方法通常难以有效地建模场景语义,导致智能体无法准确理解指令意图,从而影响任务完成的效率和成功率。此外,现有方法在动作控制方面也存在不足,难以实现精细化的操作。

核心思路:DISCO的核心思路是利用可微场景表示来建模环境的语义信息,并结合双层控制策略来实现高效的导航和交互。通过可微场景表示,智能体可以动态地学习对象和可供性的信息,从而更好地理解场景和指令。双层控制策略则允许智能体在全局层面进行粗略的导航规划,并在局部层面进行精细的动作控制,从而提高任务完成的效率和准确性。

技术框架:DISCO的整体框架包含以下几个主要模块:1) 场景感知模块:负责从视觉输入中提取场景特征,并构建可微场景表示。2) 语义理解模块:负责解析指令,并将其映射到场景中的目标对象和可供性。3) 导航规划模块:基于可微场景表示和指令信息,生成全局导航路径。4) 动作控制模块:根据全局导航路径和局部环境信息,生成精细的动作序列。整个流程是端到端可微的,可以通过反向传播进行优化。

关键创新:DISCO的关键创新在于以下两点:1) 提出了可微场景表示,能够动态地学习对象和可供性的丰富语义信息,从而实现更有效的场景建模。2) 提出了双层控制策略,将全局导航规划和局部动作控制相结合,从而提高了任务完成的效率和准确性。与现有方法相比,DISCO能够更好地理解场景和指令,并生成更合理的导航路径和动作序列。

关键设计:在可微场景表示方面,论文采用了基于图神经网络的结构,将场景中的对象表示为节点,对象之间的关系表示为边。通过图神经网络,可以有效地学习对象之间的依赖关系,并提取场景的全局语义信息。在双层控制策略方面,论文采用了分层强化学习的方法,首先训练一个全局导航策略,然后在全局导航策略的指导下,训练一个局部动作控制策略。损失函数包括导航损失、交互损失和语义一致性损失等。

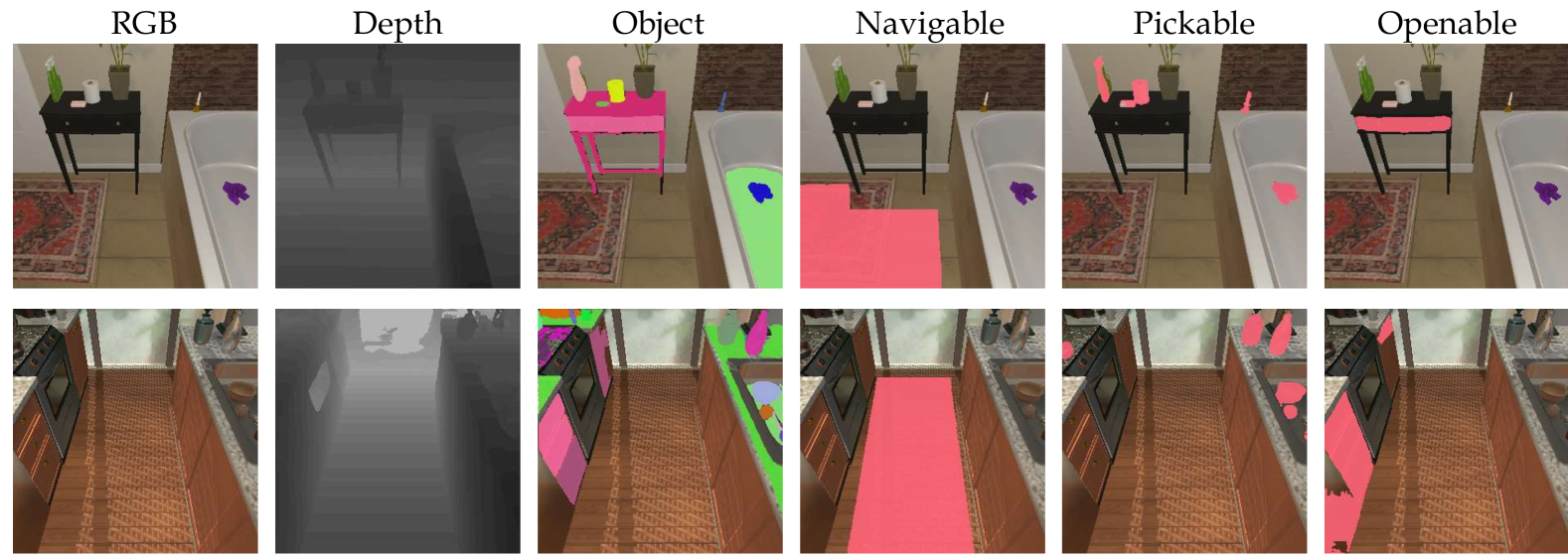

🖼️ 关键图片

📊 实验亮点

实验结果表明,DISCO在ALFRED基准测试中取得了显著的性能提升。在未见场景中,DISCO的成功率比现有技术高出+8.6%,即使没有逐步的指令。这表明DISCO能够有效地建模场景语义,并生成合理的导航路径和动作序列。此外,实验还验证了DISCO在不同任务上的泛化能力,表明其具有较强的鲁棒性和适应性。

🎯 应用场景

DISCO具有广泛的应用前景,可以应用于智能家居、机器人助手、自动驾驶等领域。例如,在智能家居中,DISCO可以帮助机器人理解用户的指令,并完成各种家务任务,如导航到指定地点、拾取物品、打开电器等。在自动驾驶领域,DISCO可以帮助车辆理解交通场景,并做出合理的驾驶决策,如避让行人、变换车道等。该研究的未来影响在于推动具身智能体在复杂环境中的应用,提高人机交互的效率和自然性。

📄 摘要(原文)

Building a general-purpose intelligent home-assistant agent skilled in diverse tasks by human commands is a long-term blueprint of embodied AI research, which poses requirements on task planning, environment modeling, and object interaction. In this work, we study primitive mobile manipulations for embodied agents, i.e. how to navigate and interact based on an instructed verb-noun pair. We propose DISCO, which features non-trivial advancements in contextualized scene modeling and efficient controls. In particular, DISCO incorporates differentiable scene representations of rich semantics in object and affordance, which is dynamically learned on the fly and facilitates navigation planning. Besides, we propose dual-level coarse-to-fine action controls leveraging both global and local cues to accomplish mobile manipulation tasks efficiently. DISCO easily integrates into embodied tasks such as embodied instruction following. To validate our approach, we take the ALFRED benchmark of large-scale long-horizon vision-language navigation and interaction tasks as a test bed. In extensive experiments, we make comprehensive evaluations and demonstrate that DISCO outperforms the art by a sizable +8.6% success rate margin in unseen scenes, even without step-by-step instructions. Our code is publicly released at https://github.com/AllenXuuu/DISCO.