OE-BevSeg: An Object Informed and Environment Aware Multimodal Framework for Bird's-eye-view Vehicle Semantic Segmentation

作者: Jian Sun, Yuqi Dai, Chi-Man Vong, Qing Xu, Shengbo Eben Li, Jianqiang Wang, Lei He, Keqiang Li

分类: cs.CV

发布日期: 2024-07-18

💡 一句话要点

OE-BevSeg:面向自动驾驶,提出对象感知和环境感知的BEV语义分割框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: BEV语义分割 自动驾驶 多模态融合 环境感知 对象增强

📋 核心要点

- 现有BEV分割方法在理解和增强BEV空间特征方面存在不足,尤其是在长距离环境特征和目标对象细节的捕捉上。

- OE-BevSeg通过环境感知的BEV压缩器进行全局环境感知,并利用中心信息对象增强模块进行局部目标对象增强。

- 实验表明,OE-BevSeg在nuScenes数据集上,无论是纯相机还是多模态融合任务,均取得了最先进的车辆分割结果。

📝 摘要(中文)

鸟瞰图(BEV)语义分割在自动驾驶系统中至关重要。它通过将2D多视角图像投影到3D世界空间中来实现对自我车辆周围环境的感知。 近年来,BEV分割取得了显著进展,这归功于更好的视角转换模块、更大的图像编码器或更多的时间信息。然而,仍然存在两个问题:1)缺乏对BEV空间特征的有效理解和增强,尤其是在准确捕获长距离环境特征方面;2)难以识别目标对象的精细细节。为了解决这些问题,我们提出了OE-BevSeg,这是一个端到端的多模态框架,通过全局环境感知和局部目标对象增强来提高BEV分割性能。OE-BevSeg采用了一种环境感知的BEV压缩器。基于BEV周围环境的主要组成随距离间隔增加而变化的先验知识,利用长序列全局建模来提高模型对环境的理解和感知。从丰富分割结果中目标对象信息的角度出发,我们引入了中心信息对象增强模块,使用中心度信息来监督和指导分割头,从而从局部增强的角度提高分割性能。此外,我们设计了一个多模态融合分支,将多视角RGB图像特征与雷达/激光雷达特征相结合,实现了显著的性能提升。大量的实验表明,无论是在纯相机还是多模态融合BEV分割任务中,我们的方法在nuScenes数据集上都取得了最先进的车辆分割结果,证明了其在自动驾驶领域的卓越适用性。

🔬 方法详解

问题定义:现有的BEV语义分割方法在理解和增强BEV空间特征方面存在不足,具体体现在两个方面:一是难以准确捕获长距离的环境特征,导致对全局环境的感知能力不足;二是难以识别目标对象的精细细节,影响分割精度。这些问题限制了BEV语义分割在自动驾驶等领域的应用效果。

核心思路:OE-BevSeg的核心思路是通过全局环境感知和局部目标对象增强来提高BEV分割性能。全局环境感知通过环境感知的BEV压缩器实现,利用长序列全局建模来提高模型对环境的理解和感知。局部目标对象增强通过中心信息对象增强模块实现,利用中心度信息来监督和指导分割头,从而提高分割性能。

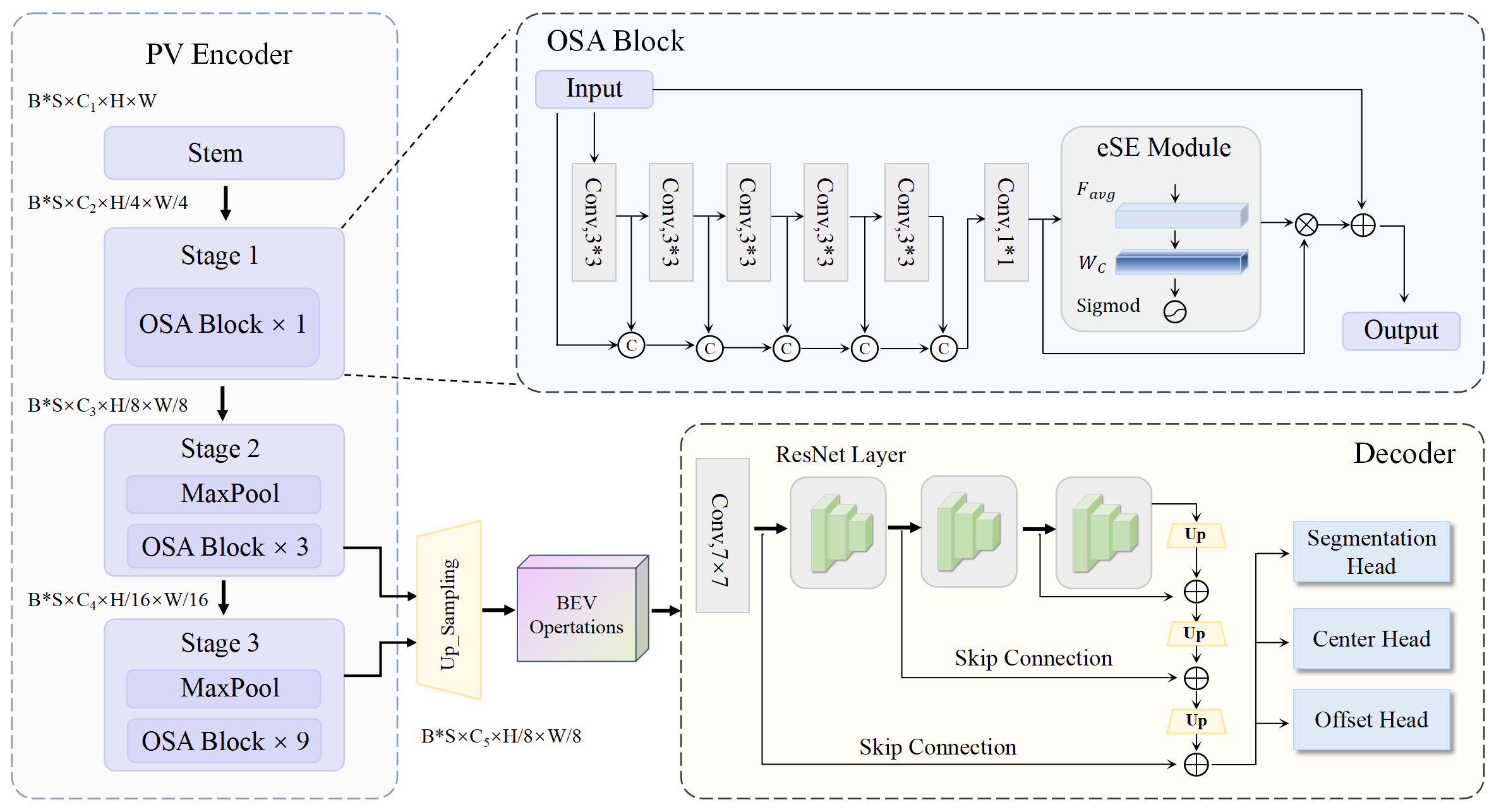

技术框架:OE-BevSeg是一个端到端的多模态框架,主要包含以下几个模块:1) 环境感知的BEV压缩器:用于提取BEV空间特征,并利用长序列全局建模来增强对环境的感知能力。2) 中心信息对象增强模块:用于利用中心度信息来监督和指导分割头,从而提高分割精度。3) 多模态融合分支:用于将多视角RGB图像特征与雷达/激光雷达特征相结合,从而提高分割性能。整体流程是:首先,多视角图像和雷达/激光雷达数据经过各自的特征提取器,然后将图像特征投影到BEV空间,并与雷达/激光雷达特征进行融合。接着,BEV特征经过环境感知的BEV压缩器和中心信息对象增强模块,最后通过分割头输出分割结果。

关键创新:OE-BevSeg的关键创新在于以下两点:1) 提出了环境感知的BEV压缩器,能够有效地提取BEV空间特征,并利用长序列全局建模来增强对环境的感知能力。2) 提出了中心信息对象增强模块,能够利用中心度信息来监督和指导分割头,从而提高分割精度。与现有方法相比,OE-BevSeg能够更好地理解和增强BEV空间特征,从而提高分割性能。

关键设计:环境感知的BEV压缩器利用Transformer结构进行长序列全局建模,具体参数设置未知。中心信息对象增强模块使用centerness信息作为监督信号,损失函数的设计未知。多模态融合分支的具体融合方式未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,OE-BevSeg在nuScenes数据集上取得了最先进的车辆分割结果,显著优于现有方法。具体性能数据和提升幅度在论文中未明确给出,但摘要中提到“by a large margin”,表明性能提升显著。该方法在纯相机和多模态融合两种场景下均表现出色,证明了其良好的泛化能力。

🎯 应用场景

OE-BevSeg在自动驾驶领域具有广泛的应用前景,可以用于提高车辆对周围环境的感知能力,从而提高驾驶安全性。此外,该方法还可以应用于智能交通、机器人导航等领域,具有重要的实际价值和未来影响。通过更精确的BEV语义分割,可以实现更高级别的自动驾驶功能,例如更精准的路径规划和更安全的避障策略。

📄 摘要(原文)

Bird's-eye-view (BEV) semantic segmentation is becoming crucial in autonomous driving systems. It realizes ego-vehicle surrounding environment perception by projecting 2D multi-view images into 3D world space. Recently, BEV segmentation has made notable progress, attributed to better view transformation modules, larger image encoders, or more temporal information. However, there are still two issues: 1) a lack of effective understanding and enhancement of BEV space features, particularly in accurately capturing long-distance environmental features and 2) recognizing fine details of target objects. To address these issues, we propose OE-BevSeg, an end-to-end multimodal framework that enhances BEV segmentation performance through global environment-aware perception and local target object enhancement. OE-BevSeg employs an environment-aware BEV compressor. Based on prior knowledge about the main composition of the BEV surrounding environment varying with the increase of distance intervals, long-sequence global modeling is utilized to improve the model's understanding and perception of the environment. From the perspective of enriching target object information in segmentation results, we introduce the center-informed object enhancement module, using centerness information to supervise and guide the segmentation head, thereby enhancing segmentation performance from a local enhancement perspective. Additionally, we designed a multimodal fusion branch that integrates multi-view RGB image features with radar/LiDAR features, achieving significant performance improvements. Extensive experiments show that, whether in camera-only or multimodal fusion BEV segmentation tasks, our approach achieves state-of-the-art results by a large margin on the nuScenes dataset for vehicle segmentation, demonstrating superior applicability in the field of autonomous driving.