ActionSwitch: Class-agnostic Detection of Simultaneous Actions in Streaming Videos

作者: Hyolim Kang, Jeongseok Hyun, Joungbin An, Youngjae Yu, Seon Joo Kim

分类: cs.CV

发布日期: 2024-07-17

备注: ECCV2024

💡 一句话要点

ActionSwitch:提出一种类别无关的在线动作检测框架,用于检测流视频中的并发动作。

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction)

关键词: 在线动作检测 时序动作定位 类别无关 重叠动作 视频流 保守损失 动作识别

📋 核心要点

- 现有在线时序动作定位方法难以处理视频流中常见的重叠动作,且过度依赖类别信息,限制了其应用范围。

- ActionSwitch 提出一种类别无关的在线时序动作定位框架,通过消除对类别信息的依赖,提升了对各种场景的适应性。

- ActionSwitch 引入“保守损失”,将保守决策原则融入损失函数,并在 Epic-Kitchens 100 和 FineAction 等数据集上取得了领先性能。

📝 摘要(中文)

在线时序动作定位(On-TAL)是一项关键任务,旨在视频流中动作结束时立即识别动作实例,这是从基于帧的在线动作检测(OAD)的一大进步。然而,检测重叠动作的挑战经常被忽视,即使它在流视频中很常见。目前能够处理并发动作的方法严重依赖于类别信息,限制了它们的灵活性。本文介绍ActionSwitch,这是第一个类别无关的On-TAL框架,能够检测重叠动作。通过消除对类别信息的依赖,ActionSwitch为各种情况提供了更广泛的适用性,包括同一类别的重叠动作或类别信息不可用的场景。该方法还辅以提出的“保守损失”,它直接将保守的决策原则嵌入到On-TAL的损失函数中。我们的ActionSwitch在复杂的 Epic-Kitchens 100 和 FineAction 数据集上实现了最先进的性能。

🔬 方法详解

问题定义:论文旨在解决在线时序动作定位(On-TAL)中,现有方法无法有效检测流视频中重叠动作,且过度依赖类别信息的问题。现有方法在处理同一类别的重叠动作或类别信息缺失的场景时表现不佳,限制了其通用性。

核心思路:ActionSwitch 的核心思路是设计一个类别无关的 On-TAL 框架,通过不依赖类别信息,从而能够检测各种类型的重叠动作。此外,引入“保守损失”来指导模型做出更可靠的决策,避免过早或错误的动作预测。

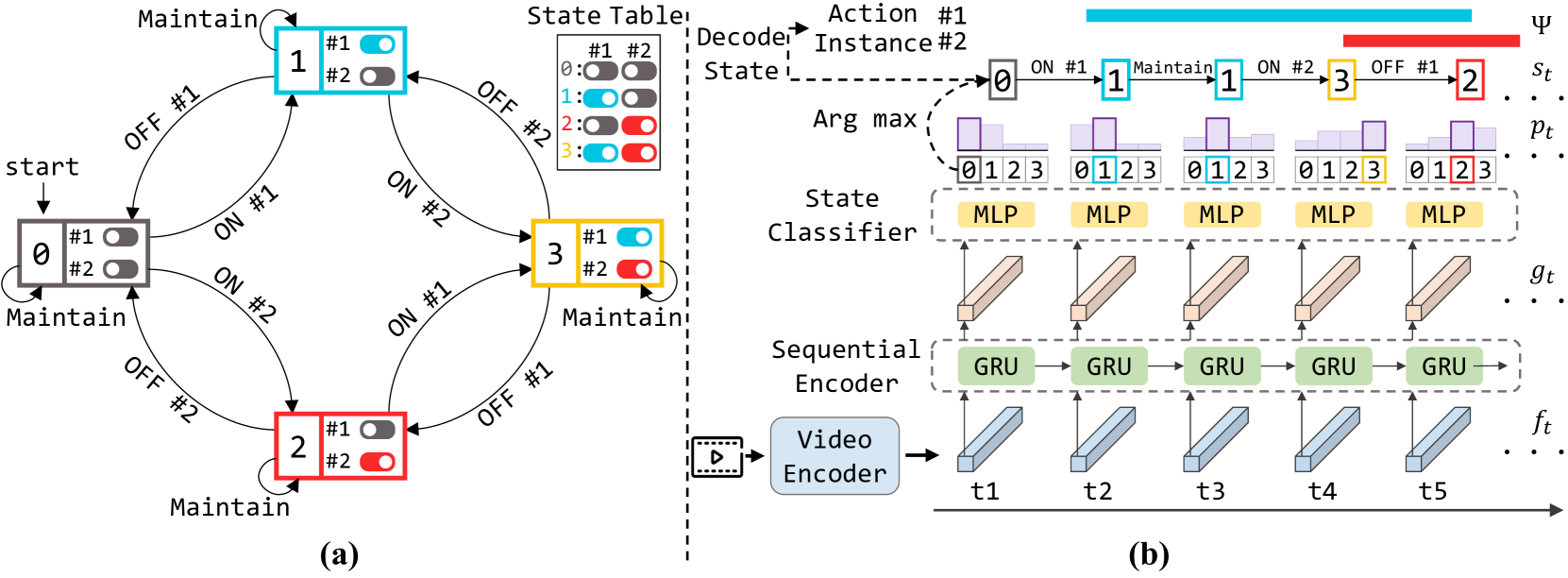

技术框架:ActionSwitch 框架包含特征提取模块、动作提议生成模块和动作提议分类与定位模块。首先,使用预训练的视觉模型提取视频帧的特征。然后,动作提议生成模块基于提取的特征生成潜在的动作片段。最后,动作提议分类与定位模块对这些提议进行分类和精确定位,输出最终的动作检测结果。整个过程以在线方式进行,即逐帧处理视频流。

关键创新:ActionSwitch 的关键创新在于其类别无关的设计和“保守损失”的引入。类别无关的设计使其能够处理各种类型的重叠动作,而无需依赖类别信息。保守损失则鼓励模型在没有足够证据的情况下保持谨慎,从而减少误判。

关键设计:保守损失的设计是关键。它通过惩罚过早或过于自信的预测,促使模型在观察到更多信息后再做出决策。具体的损失函数形式未知,但其核心思想是平衡精度和召回率,避免模型过于激进。

🖼️ 关键图片

📊 实验亮点

ActionSwitch 在 Epic-Kitchens 100 和 FineAction 数据集上取得了最先进的性能。Epic-Kitchens 100 是一个具有挑战性的第一人称视角数据集,包含大量的重叠动作。FineAction 数据集则包含细粒度的动作类别。ActionSwitch 在这两个数据集上的优异表现证明了其在处理复杂场景和细粒度动作方面的能力。具体的性能数据未知。

🎯 应用场景

ActionSwitch 具有广泛的应用前景,例如智能监控、机器人导航、视频内容分析等领域。在智能监控中,它可以用于实时检测异常行为,例如打架、盗窃等。在机器人导航中,它可以帮助机器人理解周围环境中的人类活动,从而做出更合理的决策。在视频内容分析中,它可以用于自动标注视频中的动作,提高视频检索和推荐的效率。

📄 摘要(原文)

Online Temporal Action Localization (On-TAL) is a critical task that aims to instantaneously identify action instances in untrimmed streaming videos as soon as an action concludes -- a major leap from frame-based Online Action Detection (OAD). Yet, the challenge of detecting overlapping actions is often overlooked even though it is a common scenario in streaming videos. Current methods that can address concurrent actions depend heavily on class information, limiting their flexibility. This paper introduces ActionSwitch, the first class-agnostic On-TAL framework capable of detecting overlapping actions. By obviating the reliance on class information, ActionSwitch provides wider applicability to various situations, including overlapping actions of the same class or scenarios where class information is unavailable. This approach is complemented by the proposed "conservativeness loss", which directly embeds a conservative decision-making principle into the loss function for On-TAL. Our ActionSwitch achieves state-of-the-art performance in complex datasets, including Epic-Kitchens 100 targeting the challenging egocentric view and FineAction consisting of fine-grained actions.