Close the Sim2real Gap via Physically-based Structured Light Synthetic Data Simulation

作者: Kaixin Bai, Lei Zhang, Zhaopeng Chen, Fang Wan, Jianwei Zhang

分类: cs.CV, cs.AI

发布日期: 2024-07-17

备注: 7 pages, 2024 IEEE International Conference on Robotics and Automation

🔗 代码/项目: PROJECT_PAGE

💡 一句话要点

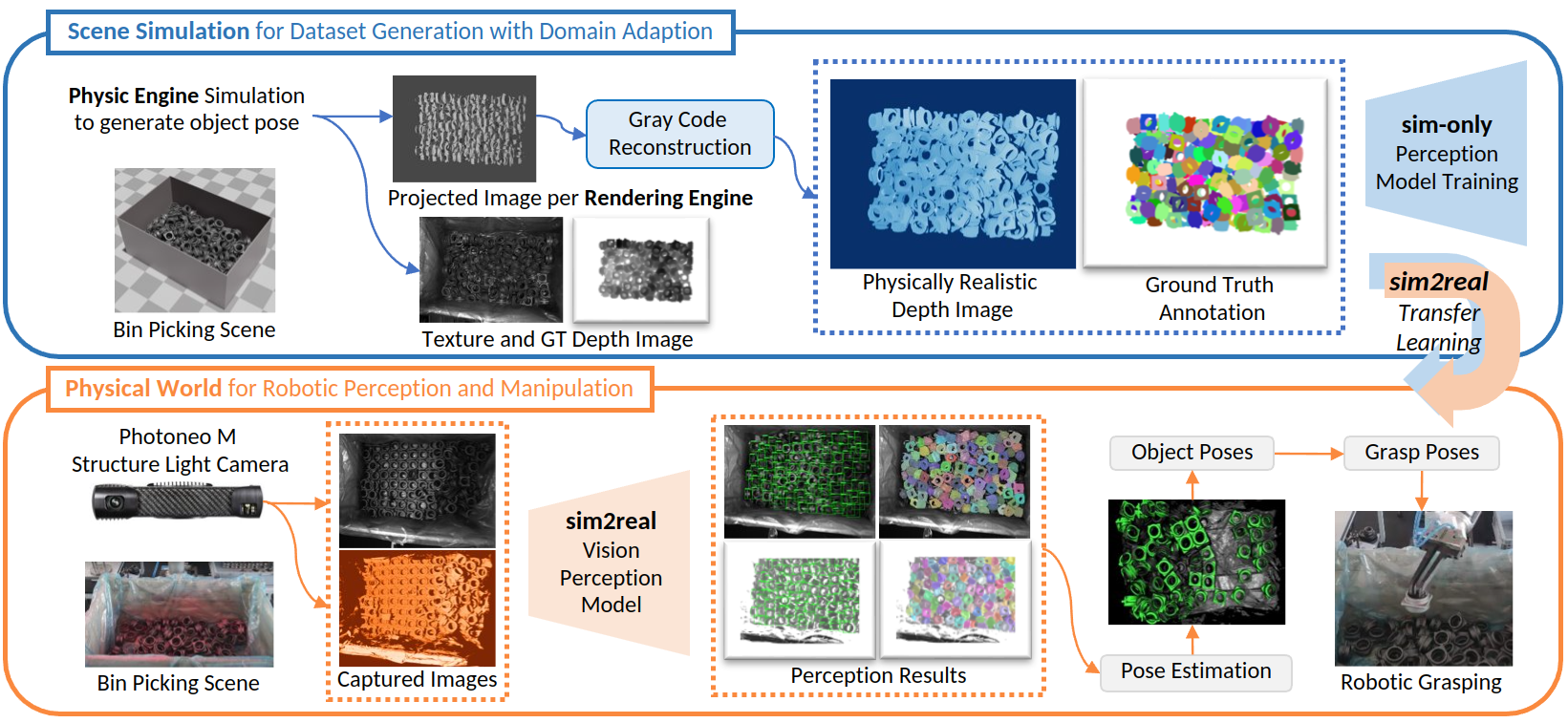

提出基于物理的结构光合成数据模拟系统,缩小Sim2Real差距,应用于工业机器人抓取。

🎯 匹配领域: 支柱一:机器人控制 (Robot Control)

关键词: Sim2Real 结构光 合成数据 工业机器人 深度学习 机器人抓取 物理模拟

📋 核心要点

- 工业机器人深度学习应用受限于数据获取和标注,传统域随机化方法需要大量场景和模型优化。

- 提出基于物理的结构光模拟系统,生成RGB和物理真实的深度图像,专门用于工业抓取场景。

- 通过实验验证,该方法能有效缩小Sim2Real差距,提升深度学习模型在工业抓取任务中的性能。

📝 摘要(中文)

深度学习在工业机器人项目中的应用受到数据获取和标注的限制。为了解决这个问题,并克服以往基于域随机化的Sim2Real方法中场景和模型优化需求,本文提出了一种创新的、基于物理的结构光模拟系统,能够生成RGB图像和物理上真实的深度图像,优于以往的数据集生成工具。我们创建了一个专为机器人工业抓取场景定制的RGBD数据集,并在对象检测、实例分割以及工业机器人抓取中的Sim2Real视觉感知等任务上进行了评估。通过缩小Sim2Real差距并增强深度学习训练,我们促进了深度学习模型在工业环境中的应用。项目详情见https://baikaixinpublic.github.io/structured light 3D synthesizer/。

🔬 方法详解

问题定义:工业机器人领域中,深度学习模型的训练需要大量标注数据,而真实场景数据的获取和标注成本高昂。现有的Sim2Real方法,如域随机化,通常需要对场景和模型进行大量的优化,过程繁琐且效果有限。因此,如何高效地生成高质量的合成数据,以缩小Sim2Real差距,是亟待解决的问题。

核心思路:本文的核心思路是构建一个基于物理的结构光模拟系统,该系统能够模拟结构光投影的过程,从而生成逼真的RGB图像和深度图像。通过模拟真实世界的光照、材质和传感器特性,使得合成数据更接近真实数据,从而减小Sim2Real的差距。

技术框架:该系统主要包含以下几个模块:1) 场景建模模块:用于创建工业机器人抓取场景的三维模型,包括物体、机器人和环境等。2) 结构光模拟模块:模拟结构光投影仪向场景投射特定图案的光,并计算光线与物体表面的交互。3) 图像生成模块:根据光线追踪的结果,生成RGB图像和深度图像。4) 数据集生成模块:将生成的图像和对应的标注信息保存为数据集。

关键创新:该方法最重要的创新点在于其基于物理的结构光模拟。与传统的基于渲染的合成数据生成方法不同,该方法考虑了光线的物理特性,能够生成更逼真的深度图像。此外,该方法还针对工业机器人抓取场景进行了优化,例如,考虑了工业环境中常见的噪声和干扰。

关键设计:在结构光模拟模块中,使用了光线追踪算法来计算光线与物体表面的交互。为了提高渲染效率,采用了加速结构,如BVH树。在图像生成模块中,考虑了传感器的噪声模型,以模拟真实传感器的输出。此外,还设计了一系列参数,用于控制光照、材质和传感器特性,以便生成多样化的合成数据。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用该方法生成的合成数据训练的深度学习模型,在真实场景中表现出良好的泛化能力。例如,在对象检测任务中,使用合成数据训练的模型,其mAP指标与使用真实数据训练的模型相当,甚至在某些情况下有所提升。此外,该方法还成功地应用于工业机器人抓取任务,实现了较高的抓取成功率。

🎯 应用场景

该研究成果可广泛应用于工业机器人领域,例如,可用于训练机器人进行物体识别、姿态估计和抓取等任务。通过使用合成数据进行预训练,可以显著减少对真实数据的依赖,降低数据采集和标注的成本。此外,该方法还可以用于机器人系统的设计和优化,例如,可以模拟不同光照条件下的传感器性能,从而选择合适的传感器。

📄 摘要(原文)

Despite the substantial progress in deep learning, its adoption in industrial robotics projects remains limited, primarily due to challenges in data acquisition and labeling. Previous sim2real approaches using domain randomization require extensive scene and model optimization. To address these issues, we introduce an innovative physically-based structured light simulation system, generating both RGB and physically realistic depth images, surpassing previous dataset generation tools. We create an RGBD dataset tailored for robotic industrial grasping scenarios and evaluate it across various tasks, including object detection, instance segmentation, and embedding sim2real visual perception in industrial robotic grasping. By reducing the sim2real gap and enhancing deep learning training, we facilitate the application of deep learning models in industrial settings. Project details are available at https://baikaixinpublic.github.io/structured light 3D synthesizer/.