HIMO: A New Benchmark for Full-Body Human Interacting with Multiple Objects

作者: Xintao Lv, Liang Xu, Yichao Yan, Xin Jin, Congsheng Xu, Shuwen Wu, Yifan Liu, Lincheng Li, Mengxiao Bi, Wenjun Zeng, Xiaokang Yang

分类: cs.CV, cs.AI

发布日期: 2024-07-17 (更新: 2024-09-11)

备注: Project page: https://lvxintao.github.io/himo, accepted by ECCV 2024

💡 一句话要点

HIMO:一个用于全身人与多物体交互的新基准数据集

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱五:交互与反应 (Interaction & Reaction)

关键词: 人与物体交互 HOI生成 多物体交互 动作捕捉 扩散模型

📋 核心要点

- 现有HOI数据集主要关注单物体交互,忽略了多物体交互的普遍性,限制了数字替身的应用。

- 提出HIMO数据集,包含大规模全身人与多物体交互的动作捕捉数据,并设计了基于文本提示的HOI合成任务。

- 设计双分支条件扩散模型和自回归生成流程,实验表明模型具有良好的泛化能力,能处理未见过的物体和时间组合。

📝 摘要(中文)

随着数字替身的巨大进步,生成人与物体交互(HOI)至关重要。现有的数据集通常仅限于人与单个物体的交互,而忽略了普遍存在的多物体操作。因此,我们提出了HIMO,一个大规模的全身人与多物体交互的MoCap数据集,包含3.3K个4D HOI序列和4.08M个3D HOI帧。我们还使用详细的文本描述和时间分割对HIMO进行标注,对基于完整文本提示或分割文本提示作为细粒度时间线控制的HOI合成这两个新任务进行基准测试。为了解决这些新任务,我们提出了一种具有互交互模块的双分支条件扩散模型用于HOI合成。此外,还设计了一种自回归生成管道,以获得HOI片段之间的平滑过渡。实验结果证明了对未见过的物体几何形状和时间组合的泛化能力。

🔬 方法详解

问题定义:论文旨在解决现有HOI数据集缺乏对人与多个物体交互场景的覆盖,导致模型难以生成复杂交互动作的问题。现有方法主要关注单物体交互,无法有效建模多物体交互中的复杂关系和时序依赖性。

核心思路:论文的核心思路是构建一个大规模、高质量的全身人与多物体交互数据集HIMO,并基于此数据集提出新的HOI合成任务和相应的模型。通过数据集的丰富性和任务的挑战性,推动HOI生成领域的发展。

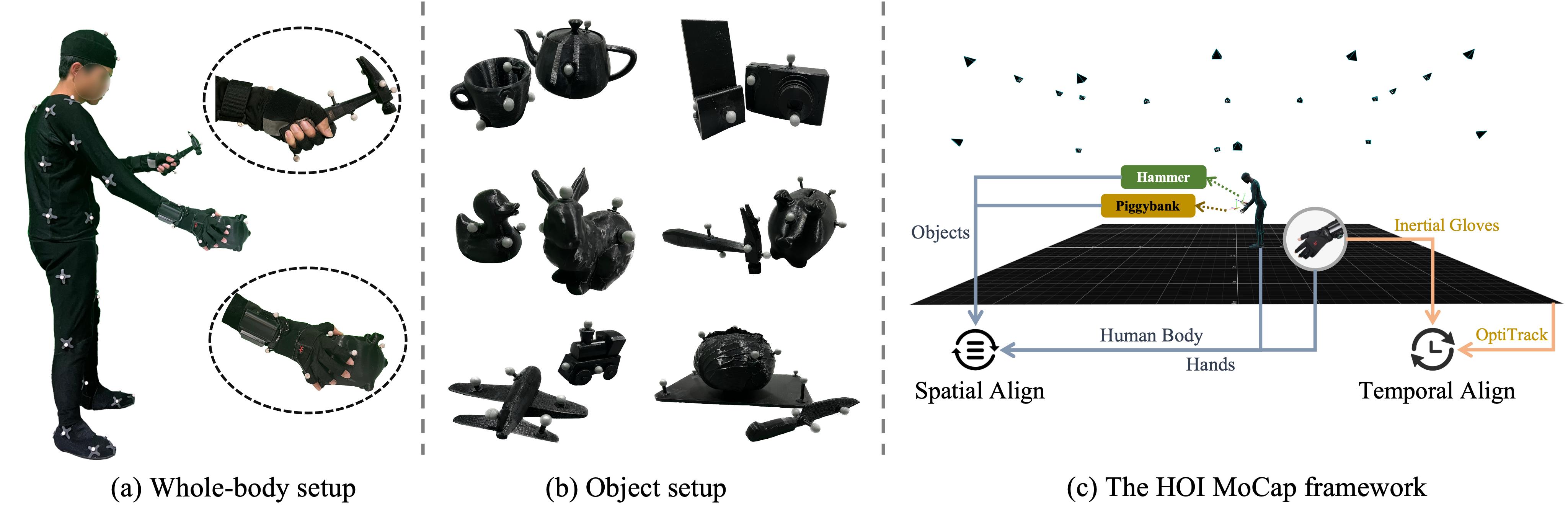

技术框架:论文的技术框架主要包含两个部分:一是HIMO数据集的构建,包括数据采集、处理和标注;二是基于HIMO数据集的HOI合成模型,该模型采用双分支条件扩散模型,并结合互交互模块和自回归生成流程。双分支分别处理人体和物体,互交互模块用于建模二者之间的关系,自回归生成流程用于保证时序连贯性。

关键创新:论文的关键创新在于:1) 提出了HIMO数据集,填补了多物体交互HOI数据集的空白;2) 设计了基于文本提示的HOI合成任务,更贴近实际应用场景;3) 提出了双分支条件扩散模型,并引入互交互模块,有效建模了人与多物体之间的复杂关系。

关键设计:双分支条件扩散模型中,一个分支处理人体运动,另一个分支处理物体运动。互交互模块通过注意力机制建模人体和物体之间的关系。自回归生成流程通过预测下一帧的运动,保证HOI序列的时序连贯性。损失函数包括重建损失和对抗损失,用于提高生成HOI的真实性和多样性。具体的参数设置和网络结构细节在论文中有详细描述,此处未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在HIMO数据集上取得了良好的性能,能够生成逼真的人与多物体交互动画。该方法在未见过的物体几何形状和时间组合上表现出良好的泛化能力。具体的性能数据和对比基线未知,需要在论文中查找。

🎯 应用场景

该研究成果可广泛应用于虚拟现实、增强现实、游戏开发、数字替身等领域。例如,可以用于生成逼真的人与多物体交互动画,提升用户在虚拟环境中的沉浸感和交互体验。此外,该研究还可以应用于机器人控制领域,使机器人能够更好地理解和执行复杂的人机协作任务。

📄 摘要(原文)

Generating human-object interactions (HOIs) is critical with the tremendous advances of digital avatars. Existing datasets are typically limited to humans interacting with a single object while neglecting the ubiquitous manipulation of multiple objects. Thus, we propose HIMO, a large-scale MoCap dataset of full-body human interacting with multiple objects, containing 3.3K 4D HOI sequences and 4.08M 3D HOI frames. We also annotate HIMO with detailed textual descriptions and temporal segments, benchmarking two novel tasks of HOI synthesis conditioned on either the whole text prompt or the segmented text prompts as fine-grained timeline control. To address these novel tasks, we propose a dual-branch conditional diffusion model with a mutual interaction module for HOI synthesis. Besides, an auto-regressive generation pipeline is also designed to obtain smooth transitions between HOI segments. Experimental results demonstrate the generalization ability to unseen object geometries and temporal compositions.