StyleSplat: 3D Object Style Transfer with Gaussian Splatting

作者: Sahil Jain, Avik Kuthiala, Prabhdeep Singh Sethi, Prakanshul Saxena

分类: cs.CV

发布日期: 2024-07-12

备注: for code and results, see http://bernard0047.github.io/stylesplat

💡 一句话要点

StyleSplat:基于高斯溅射的3D物体风格迁移方法

🎯 匹配领域: 支柱三:空间感知与语义 (Perception & Semantics) 支柱六:视频提取与匹配 (Video Extraction)

关键词: 3D风格迁移 高斯溅射 局部风格化 神经渲染 风格迁移学习

📋 核心要点

- 现有3D风格迁移方法速度慢,或无法将风格迁移局限于特定物体,限制了创作自由。

- StyleSplat通过联合分割和特征匹配,实现快速、可定制的局部3D物体风格迁移。

- 实验证明,StyleSplat在多种场景和风格下有效,提升了3D内容创作的控制性和定制性。

📝 摘要(中文)

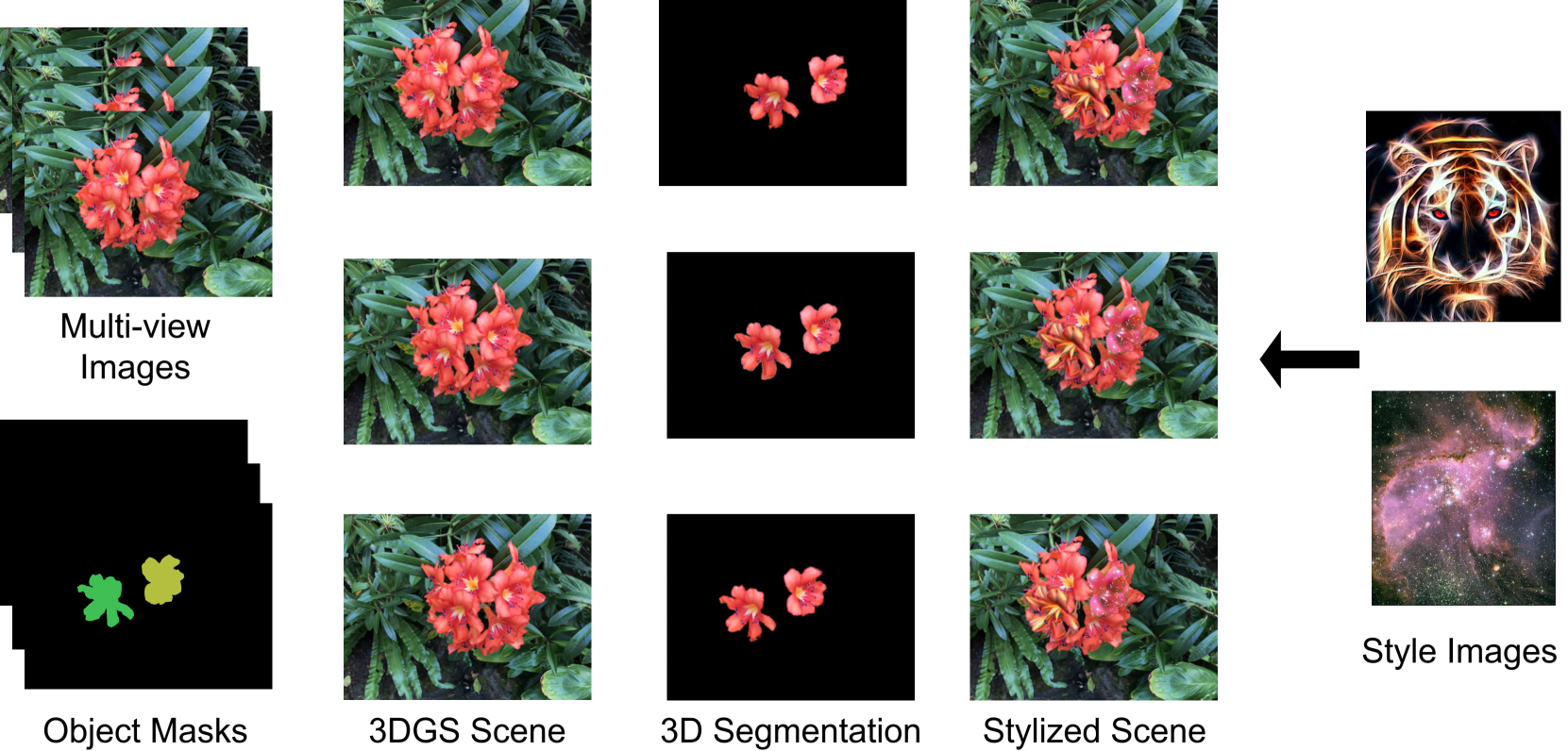

本文提出StyleSplat,一种轻量级的风格迁移方法,用于对由3D高斯表示的场景中的3D物体进行风格化,其风格来自参考风格图像。该方法首先使用3D高斯溅射学习场景的逼真表示,同时分割出独立的3D物体。然后,使用最近邻特征匹配损失来微调所选物体的高斯参数,使其球谐系数与风格图像对齐,以确保一致性和视觉吸引力。StyleSplat支持快速、可定制的风格迁移,并能对场景中的多个物体进行局部风格化,每个物体可以应用不同的风格。实验结果表明,该方法在各种3D场景和风格上均有效,增强了3D创建的控制和定制能力。

🔬 方法详解

问题定义:现有的3D风格迁移方法通常计算量大,速度慢,难以实时交互。更重要的是,它们通常无法实现对场景中特定物体的局部风格迁移,限制了用户对风格化过程的精细控制。因此,如何快速且精确地对3D场景中的特定物体进行风格迁移是一个关键问题。

核心思路:StyleSplat的核心思路是利用3D高斯溅射(3D Gaussian Splatting)技术,将3D场景表示为一组带有属性的高斯分布。通过联合学习场景的逼真表示和物体的分割,可以针对性地对特定物体的高斯参数进行调整,使其风格与参考图像匹配。这种基于高斯参数的调整比直接操作渲染图像更高效,也更容易实现局部风格迁移。

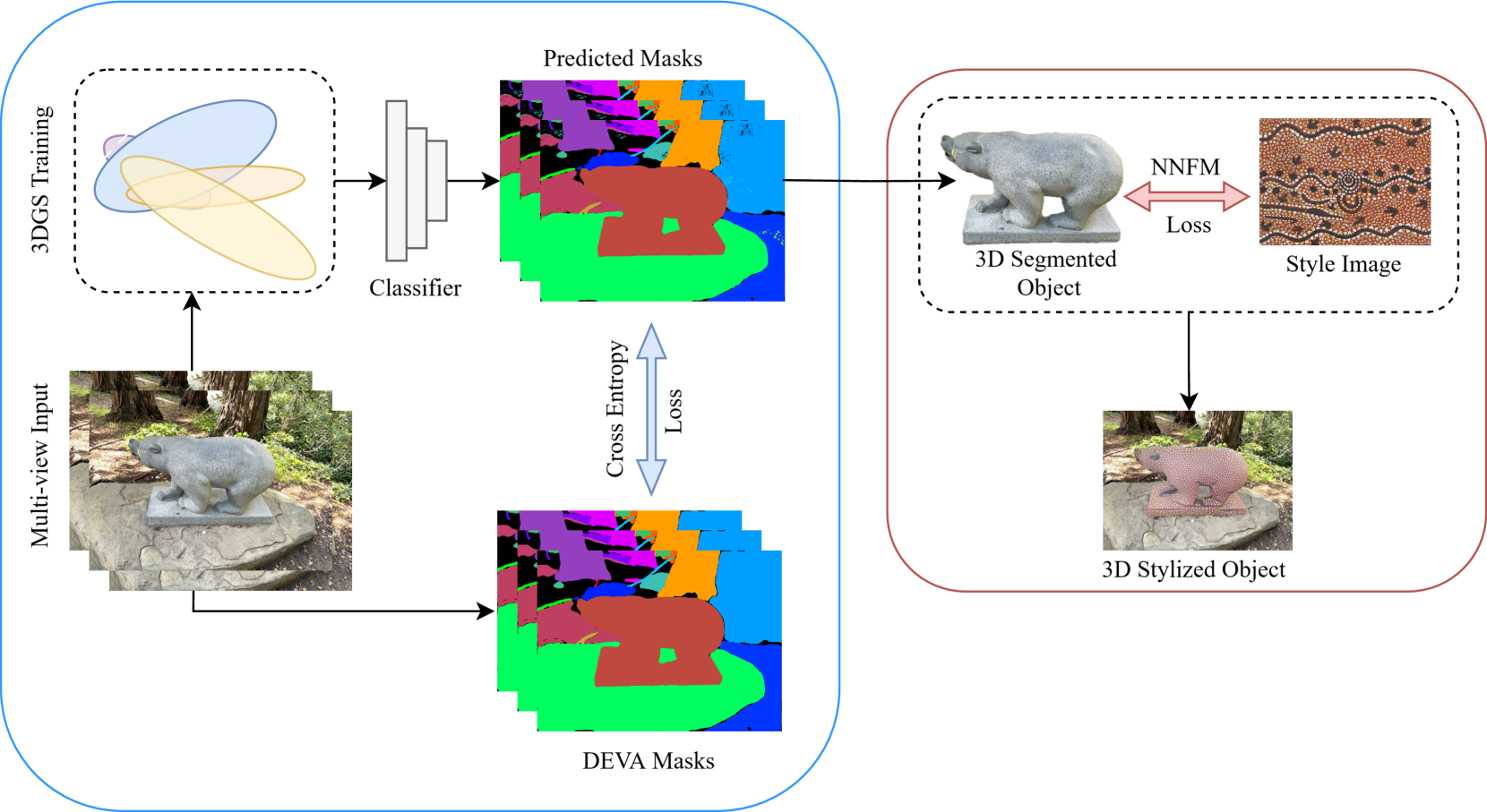

技术框架:StyleSplat的整体框架包含以下几个主要阶段:1) 场景重建与分割:使用3D高斯溅射技术重建3D场景,并同时学习场景中各个物体的分割掩码。2) 风格特征提取:从参考风格图像中提取风格特征。3) 高斯参数微调:针对选定的物体,使用最近邻特征匹配损失,微调其对应高斯分布的球谐系数,使其风格与参考图像的风格特征对齐。4) 渲染:使用调整后的高斯参数重新渲染场景,得到风格迁移后的结果。

关键创新:StyleSplat的关键创新在于将风格迁移问题转化为对3D高斯参数的优化问题。与传统的基于图像的风格迁移方法相比,StyleSplat可以直接操作3D表示,从而实现更高效、更精确的局部风格迁移。此外,联合学习场景重建和物体分割,使得可以针对性地对特定物体进行风格化,提供了更大的灵活性和控制力。

关键设计:StyleSplat的关键设计包括:1) 最近邻特征匹配损失:使用预训练的视觉模型(如CLIP)提取风格图像和渲染图像的特征,然后使用最近邻搜索来找到匹配的特征,并计算损失,以指导高斯参数的调整。2) 球谐系数调整:通过调整高斯分布的球谐系数来改变物体的颜色和纹理,从而实现风格迁移。3) 分割掩码的联合学习:在场景重建的同时,使用额外的损失函数来鼓励分割掩码的准确性,从而确保可以精确地选择要进行风格化的物体。

🖼️ 关键图片

📊 实验亮点

StyleSplat在多个3D场景和风格上进行了实验,结果表明它可以有效地将参考图像的风格迁移到3D物体上。与现有的风格迁移方法相比,StyleSplat在速度和局部风格化能力方面具有显著优势。例如,StyleSplat可以在几分钟内完成对一个复杂场景的风格迁移,并且可以对场景中的多个物体应用不同的风格。

🎯 应用场景

StyleSplat在游戏开发、电影制作、虚拟现实和增强现实等领域具有广泛的应用前景。它可以帮助艺术家和设计师快速地将不同的艺术风格应用于3D模型和场景,从而加速内容创作流程,并提供更大的创作自由。此外,StyleSplat还可以用于创建个性化的3D内容,例如,根据用户的喜好定制虚拟化身的风格。

📄 摘要(原文)

Recent advancements in radiance fields have opened new avenues for creating high-quality 3D assets and scenes. Style transfer can enhance these 3D assets with diverse artistic styles, transforming creative expression. However, existing techniques are often slow or unable to localize style transfer to specific objects. We introduce StyleSplat, a lightweight method for stylizing 3D objects in scenes represented by 3D Gaussians from reference style images. Our approach first learns a photorealistic representation of the scene using 3D Gaussian splatting while jointly segmenting individual 3D objects. We then use a nearest-neighbor feature matching loss to finetune the Gaussians of the selected objects, aligning their spherical harmonic coefficients with the style image to ensure consistency and visual appeal. StyleSplat allows for quick, customizable style transfer and localized stylization of multiple objects within a scene, each with a different style. We demonstrate its effectiveness across various 3D scenes and styles, showcasing enhanced control and customization in 3D creation.