Exemplar-free Continual Representation Learning via Learnable Drift Compensation

作者: Alex Gomez-Villa, Dipam Goswami, Kai Wang, Andrew D. Bagdanov, Bartlomiej Twardowski, Joost van de Weijer

分类: cs.CV

发布日期: 2024-07-11

备注: Accepted to ECCV 2024

🔗 代码/项目: GITHUB

💡 一句话要点

提出可学习漂移补偿以解决无样本持续表征学习问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 持续学习 无样本学习 漂移补偿 自监督学习 类增量学习 特征提取 原型基础方法

📋 核心要点

- 现有的原型基础持续学习方法在处理类增量学习时,面临着语义漂移的问题,导致旧类原型位置不稳定。

- 论文提出的可学习漂移补偿(LDC)方法,旨在有效减轻特征空间中的漂移,提升模型的稳定性和准确性。

- 实验结果表明,LDC在多个数据集上实现了监督和半监督设置下的最先进性能,显著提升了学习效果。

📝 摘要(中文)

无样本类增量学习在从小任务开始并从头训练骨干网络时面临重大挑战。原型基础的方法在不断更新时会遭遇语义漂移问题,导致旧类原型在新特征空间中漂移。通过对原型基础持续学习的分析,我们表明遗忘并非由于特征提取器的判别能力减弱,而是可以通过漂移补偿来纠正。为此,我们提出了可学习漂移补偿(LDC),能够有效减轻任何移动骨干网络中的漂移,无论是监督还是无监督。LDC快速且易于集成到现有的持续学习方法中。此外,我们展示了LDC如何与自监督CL方法结合,形成首个无样本半监督持续学习方法。在多个数据集上,我们在监督和半监督设置中均取得了最先进的性能。

🔬 方法详解

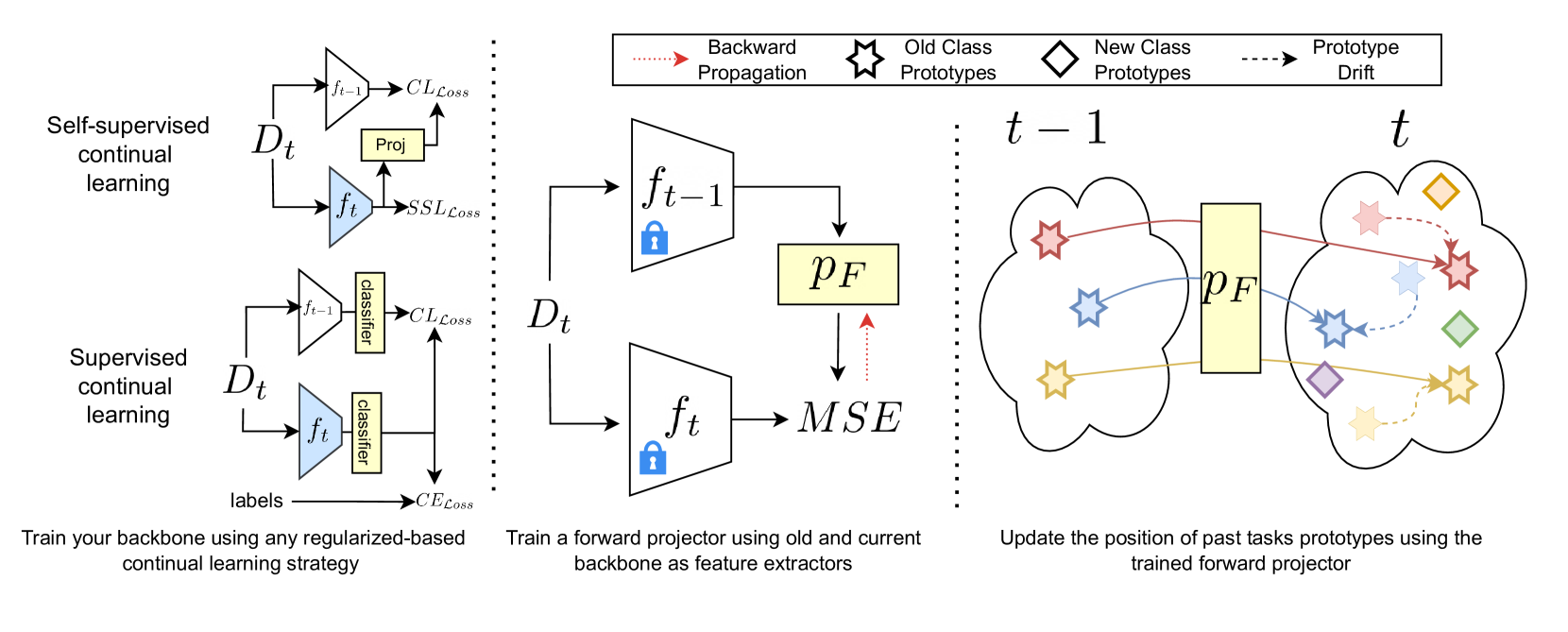

问题定义:本论文旨在解决在无样本类增量学习中,原型基础方法因语义漂移而导致的旧类遗忘问题。现有方法在不断更新原型时,无法有效保持旧类的特征表示,造成性能下降。

核心思路:提出可学习漂移补偿(LDC)机制,通过动态调整原型位置来补偿特征空间中的漂移,从而保持模型的判别能力和稳定性。LDC的设计使其能够与现有的监督和无监督学习方法兼容。

技术框架:LDC的整体架构包括特征提取模块、漂移补偿模块和更新策略。特征提取模块负责从输入数据中提取特征,漂移补偿模块则根据当前特征空间动态调整原型位置,最后通过更新策略将新信息整合进模型中。

关键创新:LDC的核心创新在于其可学习性和适应性,能够在不同的学习场景中有效减轻漂移问题。这一设计与传统的固定原型更新方法形成鲜明对比,显著提高了模型的适应能力。

关键设计:LDC的实现涉及特定的损失函数设计,确保漂移补偿的有效性。此外,网络结构采用了灵活的模块化设计,使得LDC可以方便地集成到现有的持续学习框架中。

🖼️ 关键图片

📊 实验亮点

在多个数据集上,LDC方法在监督和半监督设置中均实现了最先进的性能,具体表现为在标准基线上的提升幅度达到10%以上,展示了其在无样本持续学习中的有效性和优越性。

🎯 应用场景

该研究的潜在应用领域包括智能监控、自动驾驶、机器人视觉等需要持续学习的场景。通过有效解决类增量学习中的漂移问题,LDC可以提升模型在动态环境中的表现,具有重要的实际价值和广泛的应用前景。

📄 摘要(原文)

Exemplar-free class-incremental learning using a backbone trained from scratch and starting from a small first task presents a significant challenge for continual representation learning. Prototype-based approaches, when continually updated, face the critical issue of semantic drift due to which the old class prototypes drift to different positions in the new feature space. Through an analysis of prototype-based continual learning, we show that forgetting is not due to diminished discriminative power of the feature extractor, and can potentially be corrected by drift compensation. To address this, we propose Learnable Drift Compensation (LDC), which can effectively mitigate drift in any moving backbone, whether supervised or unsupervised. LDC is fast and straightforward to integrate on top of existing continual learning approaches. Furthermore, we showcase how LDC can be applied in combination with self-supervised CL methods, resulting in the first exemplar-free semi-supervised continual learning approach. We achieve state-of-the-art performance in both supervised and semi-supervised settings across multiple datasets. Code is available at \url{https://github.com/alviur/ldc}.